リテール [代理人] では、次のことができます。 モデル(一部または全体)を別のエグゼキュータで実行します。このメカニズムでは、 GPU や Edge TPU(Tensor)などのさまざまなオンデバイス アクセラレータを 処理ユニットなど)で構成されます。これによりデベロッパーは メソッドをデフォルトの TFLite から分離し、推論を高速化しました。

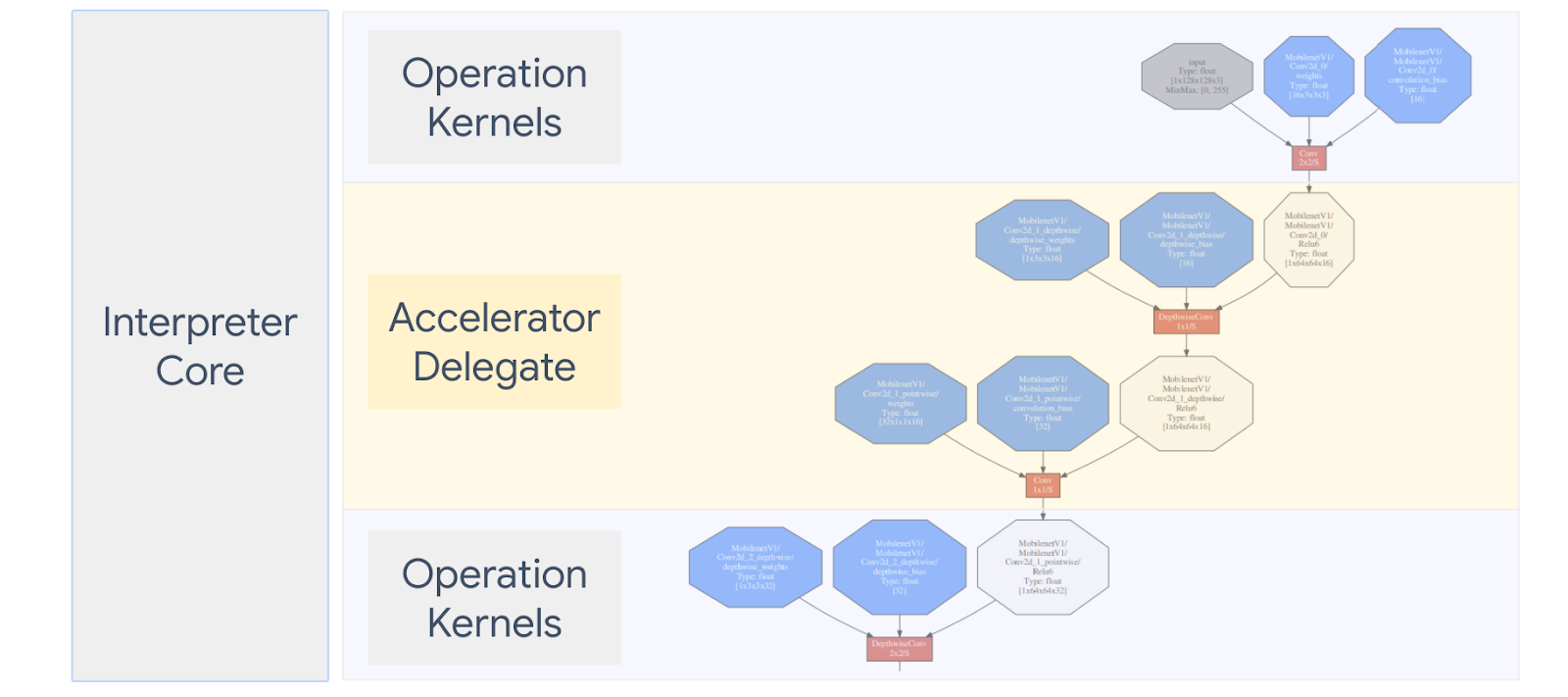

下の図は代理人をまとめたものです。詳細については、以下のセクションで説明します。

カスタム デリゲートを作成する必要があるタイミング

LiteRT には、次のようなターゲット アクセラレータのデリゲートが幅広く用意されています。 GPU、DSP、EdgeTPU です。

独自の委任を作成すると、次のような場合に便利です。

- 他の ML 推論エンジンを統合したい 委任できます。

- 既知の要求に対するランタイムを改善するカスタム ハードウェア アクセラレータがある 説明します。

- 開発者が CPU の最適化(演算子の融合など)を開発していて、 特定のモデルを高速化できます

代理人の仕組み

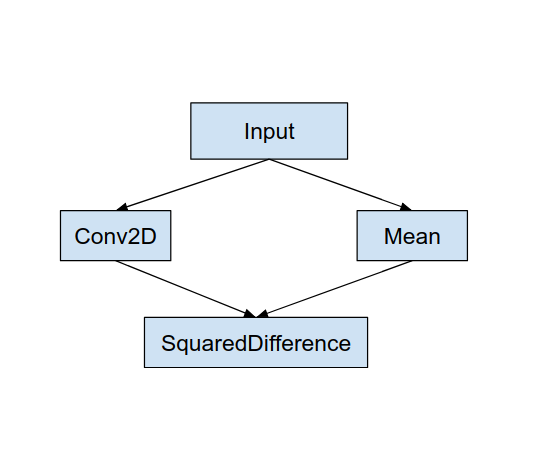

次のような単純なモデルグラフと委任「MyDelegate」について考えてみましょう。 より高速に実装できます

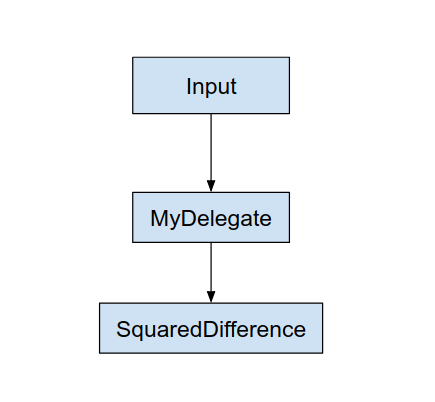

この「MyDelegate」を適用すると、元の LiteRT グラフが 次のように更新します。

上のグラフは、LiteRT で元のグラフを分割して得られたものです。 次の 2 つのルールがあります。

- デリゲートが処理できる特定の操作は、 引き続き元のコンピューティング ワークフローを満たしながら、パーティショニングできます。 オペレーション間の依存関係が 解消されます

- 委任対象の各パーティションには、割り当てられていない入力ノードと出力ノードのみが デリゲートによって処理されます。

デリゲートによって処理される各パーティションは、デリゲート ノード( デリゲート カーネルとも呼ばれる)によって、 呼び出すことができます。

モデルによっては、最終的なグラフに 1 つ以上のノードができ、 後者はデリゲートが一部の op をサポートしていないことを意味します。一般に デリゲートで複数のパーティションを処理することは望ましくありません。 デリゲートからメイングラフに切り替えると、デリゲートのオーバーヘッドが 委任されたサブグラフから結果が生成されるメイングラフに結果を渡す メモリのコピーによって発生する障害(たとえば GPU 間)このようなオーバーヘッドは 特にメモリコピーが大量にある場合に、パフォーマンスが向上します。

独自のカスタム デリゲートの実装

委任の追加には、 SimpleDelegate API

新しいデリゲートを作成するには、2 つのインターフェースを実装し、 インターフェース メソッドの独自の実装をサポートします。

1 ~SimpleDelegateInterface

このクラスは、委譲の機能を表します。委譲の機能 カーネルを作成するためのファクトリ クラスがあります。この Factory クラスでは、 できます。詳細については、このモジュールの C++ ヘッダー ファイル。 コード内のコメントでは、各 API について詳しく説明しています。

2 - SimpleDelegateKernelInterface

このクラスは、サーバーを初期化、準備、実行するロジックをカプセル化します。 委任されたパーティションに分割されます

次の機能があります。 定義)

- Init(...): 1 回限りの初期化を行うために 1 回呼び出されます。

- Prepare(...): このノードの異なるインスタンスごとに呼び出されます。 委任されたパーティションが複数あってもかまいません通常はメモリーを使って これは、テンソルのサイズを変更するたびに呼び出されるためです。

- Invoke(...): 推論のために呼び出されます。

例

この例では、2 つのクライアントのみをサポートできる非常にシンプルなデリゲートを作成します。 float32 テンソルのみの演算(ADD)と(SUB)のタイプ。

// MyDelegate implements the interface of SimpleDelegateInterface.

// This holds the Delegate capabilities.

class MyDelegate : public SimpleDelegateInterface {

public:

bool IsNodeSupportedByDelegate(const TfLiteRegistration* registration,

const TfLiteNode* node,

TfLiteContext* context) const override {

// Only supports Add and Sub ops.

if (kTfLiteBuiltinAdd != registration->builtin_code &&

kTfLiteBuiltinSub != registration->builtin_code)

return false;

// This delegate only supports float32 types.

for (int i = 0; i < node->inputs->size; ++i) {

auto& tensor = context->tensors[node->inputs->data[i]];

if (tensor.type != kTfLiteFloat32) return false;

}

return true;

}

TfLiteStatus Initialize(TfLiteContext* context) override { return kTfLiteOk; }

const char* Name() const override {

static constexpr char kName[] = "MyDelegate";

return kName;

}

std::unique_ptr<SimpleDelegateKernelInterface> CreateDelegateKernelInterface()

override {

return std::make_unique<MyDelegateKernel>();

}

};

次に、

SimpleDelegateKernelInterface

// My delegate kernel.

class MyDelegateKernel : public SimpleDelegateKernelInterface {

public:

TfLiteStatus Init(TfLiteContext* context,

const TfLiteDelegateParams* params) override {

// Save index to all nodes which are part of this delegate.

inputs_.resize(params->nodes_to_replace->size);

outputs_.resize(params->nodes_to_replace->size);

builtin_code_.resize(params->nodes_to_replace->size);

for (int i = 0; i < params->nodes_to_replace->size; ++i) {

const int node_index = params->nodes_to_replace->data[i];

// Get this node information.

TfLiteNode* delegated_node = nullptr;

TfLiteRegistration* delegated_node_registration = nullptr;

TF_LITE_ENSURE_EQ(

context,

context->GetNodeAndRegistration(context, node_index, &delegated_node,

&delegated_node_registration),

kTfLiteOk);

inputs_[i].push_back(delegated_node->inputs->data[0]);

inputs_[i].push_back(delegated_node->inputs->data[1]);

outputs_[i].push_back(delegated_node->outputs->data[0]);

builtin_code_[i] = delegated_node_registration->builtin_code;

}

return kTfLiteOk;

}

TfLiteStatus Prepare(TfLiteContext* context, TfLiteNode* node) override {

return kTfLiteOk;

}

TfLiteStatus Eval(TfLiteContext* context, TfLiteNode* node) override {

// Evaluate the delegated graph.

// Here we loop over all the delegated nodes.

// We know that all the nodes are either ADD or SUB operations and the

// number of nodes equals ''inputs_.size()'' and inputs[i] is a list of

// tensor indices for inputs to node ''i'', while outputs_[i] is the list of

// outputs for node

// ''i''. Note, that it is intentional we have simple implementation as this

// is for demonstration.

for (int i = 0; i < inputs_.size(); ++i) {

// Get the node input tensors.

// Add/Sub operation accepts 2 inputs.

auto& input_tensor_1 = context->tensors[inputs_[i][0]];

auto& input_tensor_2 = context->tensors[inputs_[i][1]];

auto& output_tensor = context->tensors[outputs_[i][0]];

TF_LITE_ENSURE_EQ(

context,

ComputeResult(context, builtin_code_[i], &input_tensor_1,

&input_tensor_2, &output_tensor),

kTfLiteOk);

}

return kTfLiteOk;

}

private:

// Computes the result of addition of 'input_tensor_1' and 'input_tensor_2'

// and store the result in 'output_tensor'.

TfLiteStatus ComputeResult(TfLiteContext* context, int builtin_code,

const TfLiteTensor* input_tensor_1,

const TfLiteTensor* input_tensor_2,

TfLiteTensor* output_tensor) {

if (NumElements(input_tensor_1) != NumElements(input_tensor_2) ||

NumElements(input_tensor_1) != NumElements(output_tensor)) {

return kTfLiteDelegateError;

}

// This code assumes no activation, and no broadcasting needed (both inputs

// have the same size).

auto* input_1 = GetTensorData<float>(input_tensor_1);

auto* input_2 = GetTensorData<float>(input_tensor_2);

auto* output = GetTensorData<float>(output_tensor);

for (int i = 0; i < NumElements(input_tensor_1); ++i) {

if (builtin_code == kTfLiteBuiltinAdd)

output[i] = input_1[i] + input_2[i];

else

output[i] = input_1[i] - input_2[i];

}

return kTfLiteOk;

}

// Holds the indices of the input/output tensors.

// inputs_[i] is list of all input tensors to node at index 'i'.

// outputs_[i] is list of all output tensors to node at index 'i'.

std::vector<std::vector<int>> inputs_, outputs_;

// Holds the builtin code of the ops.

// builtin_code_[i] is the type of node at index 'i'

std::vector<int> builtin_code_;

};

新しいデリゲートのベンチマークと評価を行う

TFLite には、TFLite モデルに対して迅速にテストできるツールセットが用意されています。

- Model Benchmark Tool: このツールは TFLite モデルを使用し、ランダムな入力を生成してから、 指定した回数の実行でモデルを実行します。レイテンシの集計値が 示します。

- 推論差分ツール: 特定のモデルに対して、ツールがランダムなガウスデータを生成して渡します。 2 つの異なる TFLite インタープリタ ユーザー定義の仕様を使用します。1 秒あたりのリクエスト数、 各インタープリタからの出力テンソルの差を 指定することもできます。このツールは精度をデバッグする際にも サポートします。

- 画像分類と変換のために タスク固有の評価ツールもあります 物体検知機能も備えていますこれらのツールは こちら

さらに、TFLite には、カーネルとオペレーションの単体テストが大量に用意されています。 より多くのカバレッジで新しいデリゲートをテストし、通常の委任状態を TFLite の実行パスが破損していない。

新しいデリゲートに TFLite のテストとツールを再利用するには、次のコマンドを使用します。 次の 2 つのオプションのいずれかを選択できます

最適なアプローチの選択

どちらの方法でも、以下に詳述するようにいくつかの変更が必要です。ただし、最初の デリゲートを静的にリンクし、テストの再構築が必要。 ベンチマークと評価ツールが用意されています。対照的に 2 つ目は デリゲートを共有ライブラリとして使用し、作成/削除の機能をエクスポーズする必要があります。 メソッドも指定できます。

そのため、外部デリゲート メカニズムは TFLite の ビルド済みの LiteRT ツールバイナリ。 ただし、あまり明確ではなく、自動化システムの設定はより複雑になる可能性があります。 統合テストを実行できますわかりやすくするために、委任登録事業者のアプローチを使用します。

オプション 1: 委任登録事業者を利用する

「 委任登録事業者 委任プロバイダのリストを保持し、各プロバイダのリストで TFLite のデリゲートはコマンドライン フラグに基づいているため、 説明します。新しいデリゲートを前述のすべての LiteRT ツールに接続する 最初に新しい委任プロバイダを作成し BUILD ルールにいくつかの変更を加えるだけです。この完全な例は 統合プロセスを以下に示します(コードは こちらをご覧ください)。

SimpleDelegate API を実装するデリゲートがあり、 外部「C」この「ダミー」を作成/削除するための APIデリゲートします。

// Returns default options for DummyDelegate.

DummyDelegateOptions TfLiteDummyDelegateOptionsDefault();

// Creates a new delegate instance that need to be destroyed with

// `TfLiteDummyDelegateDelete` when delegate is no longer used by TFLite.

// When `options` is set to `nullptr`, the above default values are used:

TfLiteDelegate* TfLiteDummyDelegateCreate(const DummyDelegateOptions* options);

// Destroys a delegate created with `TfLiteDummyDelegateCreate` call.

void TfLiteDummyDelegateDelete(TfLiteDelegate* delegate);

「DummyDelegate」をベンチマーク ツールと推論ツールと統合するには、 次のような DelegateProvider を使用します。

class DummyDelegateProvider : public DelegateProvider {

public:

DummyDelegateProvider() {

default_params_.AddParam("use_dummy_delegate",

ToolParam::Create<bool>(false));

}

std::vector<Flag> CreateFlags(ToolParams* params) const final;

void LogParams(const ToolParams& params) const final;

TfLiteDelegatePtr CreateTfLiteDelegate(const ToolParams& params) const final;

std::string GetName() const final { return "DummyDelegate"; }

};

REGISTER_DELEGATE_PROVIDER(DummyDelegateProvider);

std::vector<Flag> DummyDelegateProvider::CreateFlags(ToolParams* params) const {

std::vector<Flag> flags = {CreateFlag<bool>("use_dummy_delegate", params,

"use the dummy delegate.")};

return flags;

}

void DummyDelegateProvider::LogParams(const ToolParams& params) const {

TFLITE_LOG(INFO) << "Use dummy test delegate : ["

<< params.Get<bool>("use_dummy_delegate") << "]";

}

TfLiteDelegatePtr DummyDelegateProvider::CreateTfLiteDelegate(

const ToolParams& params) const {

if (params.Get<bool>("use_dummy_delegate")) {

auto default_options = TfLiteDummyDelegateOptionsDefault();

return TfLiteDummyDelegateCreateUnique(&default_options);

}

return TfLiteDelegatePtr(nullptr, [](TfLiteDelegate*) {});

}

BUILD ルールの定義は、インフラストラクチャ リソースを ライブラリは常にリンクされ、オプティマイザーによってドロップされません。

#### The following are for using the dummy test delegate in TFLite tooling ####

cc_library(

name = "dummy_delegate_provider",

srcs = ["dummy_delegate_provider.cc"],

copts = tflite_copts(),

deps = [

":dummy_delegate",

"//tensorflow/lite/tools/delegates:delegate_provider_hdr",

],

alwayslink = 1, # This is required so the optimizer doesn't optimize the library away.

)

次に、以下の 2 つのラッパールールを BUILD ファイルに追加して、 ベンチマーク ツールと推論ツール、その他の評価ツールが用意されています。 委任する必要があります

cc_binary(

name = "benchmark_model_plus_dummy_delegate",

copts = tflite_copts(),

linkopts = task_linkopts(),

deps = [

":dummy_delegate_provider",

"//tensorflow/lite/tools/benchmark:benchmark_model_main",

],

)

cc_binary(

name = "inference_diff_plus_dummy_delegate",

copts = tflite_copts(),

linkopts = task_linkopts(),

deps = [

":dummy_delegate_provider",

"//tensorflow/lite/tools/evaluation/tasks:task_executor_main",

"//tensorflow/lite/tools/evaluation/tasks/inference_diff:run_eval_lib",

],

)

cc_binary(

name = "imagenet_classification_eval_plus_dummy_delegate",

copts = tflite_copts(),

linkopts = task_linkopts(),

deps = [

":dummy_delegate_provider",

"//tensorflow/lite/tools/evaluation/tasks:task_executor_main",

"//tensorflow/lite/tools/evaluation/tasks/imagenet_image_classification:run_eval_lib",

],

)

cc_binary(

name = "coco_object_detection_eval_plus_dummy_delegate",

copts = tflite_copts(),

linkopts = task_linkopts(),

deps = [

":dummy_delegate_provider",

"//tensorflow/lite/tools/evaluation/tasks:task_executor_main",

"//tensorflow/lite/tools/evaluation/tasks/coco_object_detection:run_eval_lib",

],

)

次のように、このデリゲート プロバイダを TFLite カーネルテストに接続することもできます。 こちらをご覧ください。

方法 2: 外部デリゲートを活用する

この方法では、まず外部デリゲート アダプタを作成し、 external_delegate_adaptor.cc 下に示します。なお、この方法は、 オプション 1(前述)。

TfLiteDelegate* CreateDummyDelegateFromOptions(char** options_keys,

char** options_values,

size_t num_options) {

DummyDelegateOptions options = TfLiteDummyDelegateOptionsDefault();

// Parse key-values options to DummyDelegateOptions.

// You can achieve this by mimicking them as command-line flags.

std::unique_ptr<const char*> argv =

std::unique_ptr<const char*>(new const char*[num_options + 1]);

constexpr char kDummyDelegateParsing[] = "dummy_delegate_parsing";

argv.get()[0] = kDummyDelegateParsing;

std::vector<std::string> option_args;

option_args.reserve(num_options);

for (int i = 0; i < num_options; ++i) {

option_args.emplace_back("--");

option_args.rbegin()->append(options_keys[i]);

option_args.rbegin()->push_back('=');

option_args.rbegin()->append(options_values[i]);

argv.get()[i + 1] = option_args.rbegin()->c_str();

}

// Define command-line flags.

// ...

std::vector<tflite::Flag> flag_list = {

tflite::Flag::CreateFlag(...),

...,

tflite::Flag::CreateFlag(...),

};

int argc = num_options + 1;

if (!tflite::Flags::Parse(&argc, argv.get(), flag_list)) {

return nullptr;

}

return TfLiteDummyDelegateCreate(&options);

}

#ifdef __cplusplus

extern "C" {

#endif // __cplusplus

// Defines two symbols that need to be exported to use the TFLite external

// delegate. See tensorflow/lite/delegates/external for details.

TFL_CAPI_EXPORT TfLiteDelegate* tflite_plugin_create_delegate(

char** options_keys, char** options_values, size_t num_options,

void (*report_error)(const char*)) {

return tflite::tools::CreateDummyDelegateFromOptions(

options_keys, options_values, num_options);

}

TFL_CAPI_EXPORT void tflite_plugin_destroy_delegate(TfLiteDelegate* delegate) {

TfLiteDummyDelegateDelete(delegate);

}

#ifdef __cplusplus

}

#endif // __cplusplus

次に示すように、対応する BUILD ターゲットを作成して動的ライブラリをビルドします。 下にあります。

cc_binary(

name = "dummy_external_delegate.so",

srcs = [

"external_delegate_adaptor.cc",

],

linkshared = 1,

linkstatic = 1,

deps = [

":dummy_delegate",

"//tensorflow/lite/c:common",

"//tensorflow/lite/tools:command_line_flags",

"//tensorflow/lite/tools:logging",

],

)

この外部委任 .so ファイルを作成すると、バイナリをビルドするか、 バイナリがリンクされていれば、新しいデリゲートで実行するためのビルド済みのもの。 external_delegate_provider このライブラリは、Terraform の記述のとおり、コマンドライン フラグを こちらをご覧ください。 注: この外部の委任プロバイダは、すでに既存の ツールが用意されています。

説明を参照する こちら ダミー デリゲートのベンチマークを行う方法の例を示しています。 外部委任アプローチの場合ですテストと検証には、同様のコマンドを使用できます。 評価ツールも用意されています

外部デリゲートは、対応する C++ です。 次に示すように、LiteRT Python バインディングでのデリゲートの実装 こちらをご覧ください。 したがって、ここで作成された動的な外部デリゲート アダプタ ライブラリは、 直接使用できます。

リソース

ナイトリー版のビルド済み TFLite ツールバイナリのダウンロード リンク

| OS | ARCH | BINARY_NAME |

| Linux | x86_64 | |

| 腕 | ||

| aarch64 | ||

| Android | 腕 | |

| aarch64 |