9. APRIL 2025

Code verstehen: So nutzt Jolt AI die Gemini API

Entwickler, die mit umfangreichen Codebases im Produktionsmaßstab arbeiten, kennen das Problem. Kontext verstehen, relevante Dateien finden und Änderungen vornehmen – das kann sich wie ein Labyrinth anfühlen. Jolt AI geht dieses Problem mit einem Tool zur Codegenerierung und einem Chat-Tool an, das speziell für reale Codebasen mit mehr als 100.000 Zeilen entwickelt wurde. Ihre Geheimwaffe für Geschwindigkeit und Genauigkeit? Die Gemini API, insbesondere Gemini 2.0 Flash.

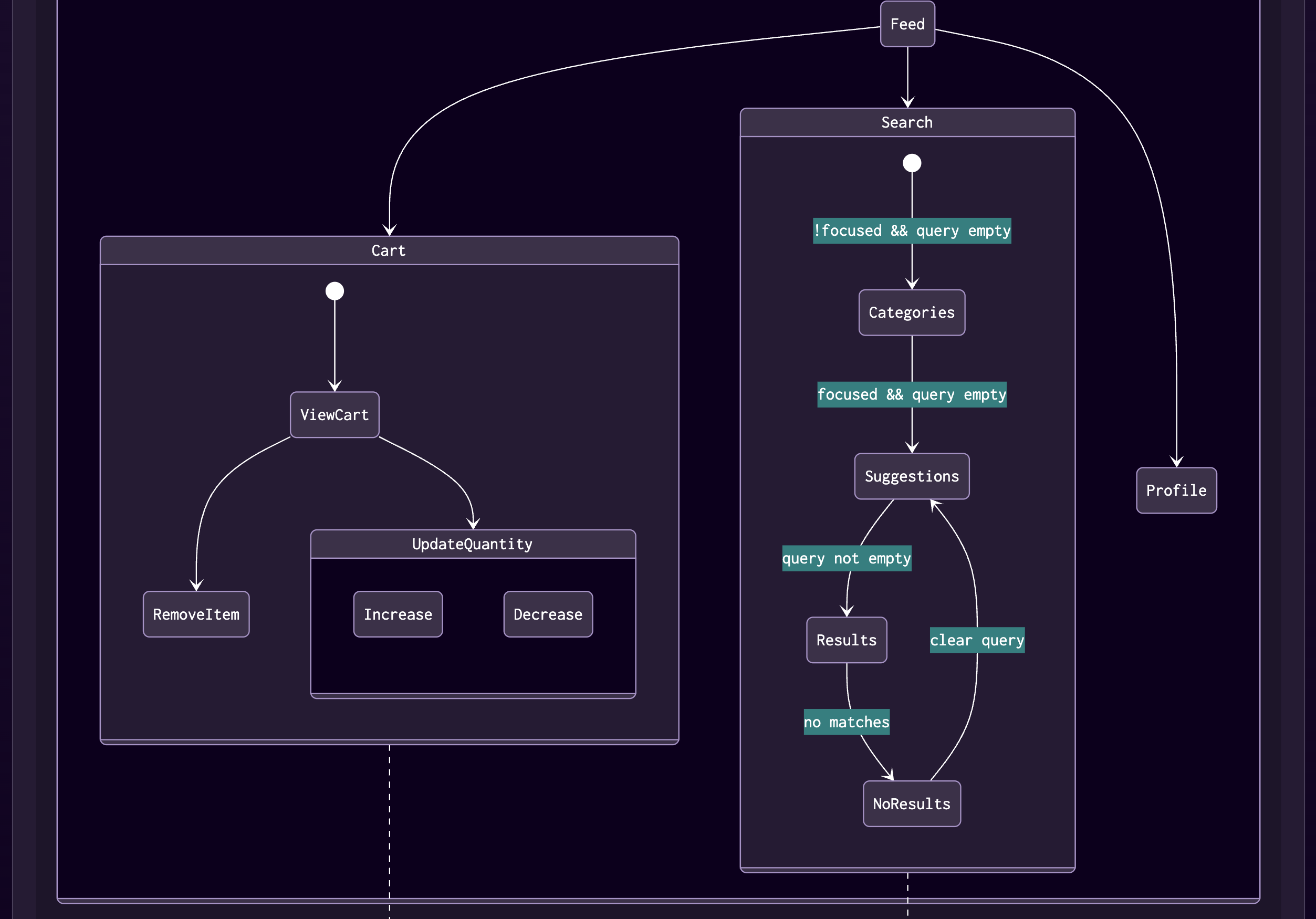

Jolt AI hat sich zum Ziel gesetzt, Entwicklern zu ermöglichen, jede Codebasis sofort zu verstehen und dazu beizutragen. Viele der heutigen Tools haben Probleme mit großen, vorhandenen Codebases und erfordern, dass Nutzer Kontextdateien manuell auswählen. Das ist mühsam und unpraktisch. Jolt AI verwendet eine neuartige semantische Suche, mit der die relevanten Kontextdateien genau und automatisch identifiziert werden. Das ist ein echter Gamechanger für die Entwicklung von Funktionen, die Fehlerbehebung, das Onboarding und vieles mehr.

Die Herausforderung für Jolt AI bestand darin, ein Modell zu finden, das die Suchpipeline mit der richtigen Mischung aus Geschwindigkeit, Konsistenz und Codeverständnis unterstützen kann. „Wir wollten drei KI-basierte Schritte in unserer Code-Suchpipeline beschleunigen“, erklärt Yev Spektor, CEO von Jolt AI. „Jeder Schritt erfordert Kenntnisse verschiedener Programmiersprachen, Frameworks, Nutzercode und Nutzerabsichten.“

Gemini 2.0 Flash: Schnelligkeit und besseres Codeverständnis

Gemini 2.0 Flash Für Jolt AI hat dieses Modell den gewünschten Leistungssprung gebracht. „Nach einigen Anpassungen der Prompts konnten wir mit Gemini 2.0 Flash konsistentere und qualitativ hochwertigere Ergebnisse erzielen als mit einem langsameren, größeren Modell eines anderen Anbieters“, so Spektor.

Wie nutzt Jolt AI Gemini 2.0 Flash? Sie unterstützt mehrere wichtige Schritte in der Pipeline für die Codesuche und bietet die Geschwindigkeit und Genauigkeit, die zum Navigieren und Verstehen riesiger Repositories erforderlich sind. Die genauen Details sind zwar ihr „Geheimnis“, aber die Auswirkungen sind klar: Mit Gemini 2.0 Flash kann Jolt AI schnell die richtigen Informationen in komplexen Codebases finden.

Die Umstellung auf die Gemini API war bemerkenswert effizient. „Es hat ein paar Stunden gedauert, das SDK zu implementieren, und zwei Tage, um Prompts zu optimieren und zu testen“, berichtet Spektor. Das Team nutzte Google AI Studio auch für die Ideenfindung und Optimierung von Prompts, was den Entwicklungsprozess beschleunigte.

Die Ergebnisse: schneller, hochwertiger und kostengünstiger

Die Umstellung auf Gemini 2.0 Flash hat für Jolt AI beeindruckende Ergebnisse erzielt:

- 70–80% kürzere Antwortzeiten:Die KI-basierten Schritte in der Suchpipeline sind deutlich schneller.

- Hochwertigere und konsistentere Antworten:Nutzer erhalten mehr als doppelt so schnell bessere Ergebnisse.

- 80% niedrigere Kosten:Die migrierten KI-Arbeitslasten sind jetzt deutlich kostengünstiger.

„Wir erhalten qualitativ hochwertigere Antworten für unsere Nutzer mehr als doppelt so schnell“, betont Spektor. Diese Kombination aus Geschwindigkeit, Qualität und Kosteneinsparungen unterstreicht die Leistungsfähigkeit von Gemini 2.0 Flash für leistungsintensive Anwendungen.

Zukunftsorientierung und Statistiken für Entwickler

Jolt AI erweitert die IDE-Unterstützung aktiv und plant ein JetBrains-Plug-in sowie die API-Zugänglichkeit. Spektor ist von dem breiteren Potenzial von Jolt AI für Unternehmen begeistert, von der Unterstützung von Entwicklern und Engineering-Leitern bis hin zur Unterstützung von Kundensupportteams und der Ermöglichung automatisierter KI-Codepipelines.

Spektor blickt auf seine Erfahrungen mit der Gemini API zurück und gibt anderen Entwicklern folgenden Rat:

„Gemini 2.0 Flash ist leistungsfähiger, als Sie vielleicht denken. Es ist sehr gut im Recall – viel besser als einige langsame, teurere Modelle.“ Er empfiehlt Entwicklern außerdem, sich die neuesten Modelle der Gemini-Familie anzusehen: „Die neue Generation, Gemini 2.0 Flash und Gemini 2.5 Pro, muss genauer betrachtet werden. Mit Gemini 2.0 Flash ist unser Produkt mehr als doppelt so schnell geworden und die Qualität der Antworten hat sich verbessert. Die neuen Modelle sind ein großer Schritt nach vorn.“

Die Erfolgsgeschichte von Jolt AI zeigt, wie die Geschwindigkeit und Leistungsfähigkeit von Gemini 2.0 Flash KI-basierte Entwicklertools deutlich verbessern können, insbesondere solche, die sich mit den Komplexitäten großer Codebasen befassen.

Bereit zum Erstellen? Dokumentation zur Gemini API – Google AI Studio