9 באפריל 2025

סוכני AI עם תפוקה גבוהה ועלות נמוכה באמצעות Gemini Flash ב-Langbase

כדי לבנות סוכני AI שיכולים לנהל באופן אוטונומי את הפעולות שלהם ואת הכלים החיצוניים שלהם, בדרך כלל צריך להתמודד עם בעיות שקשורות לשילוב ולתשתית. Langbase מסירה את הנטל של ניהול המורכבויות הבסיסיות האלה, ומספקת פלטפורמה ליצירה ולפריסה של סוכני AI ללא שרת שמבוססים על מודלים כמו Gemini, והכול ללא מסגרת.

מאז ההשקה של Gemini Flash, המשתמשים ב-Langbase הבינו במהירות את היתרונות של הביצועים והעלויות בשימוש במודלים הקלים האלה ליצירת חוויות אינטראקטיביות עם AI.

שיפור יכולת ההתאמה לשינויים ושימוש מהיר יותר בסוכני AI באמצעות Gemini Flash

פלטפורמת Langbase מספקת גישה למודלים של Gemini דרך Gemini API, ומאפשרת למשתמשים לבחור מודלים מהירים שיכולים להתמודד עם משימות מורכבות ולעבד כמויות גדולות של נתונים. זמן טעינה קצר הוא קריטי כדי לספק חוויה חלקה בזמן אמת, ולכן משפחת המודלים Gemini Flash מתאימה במיוחד ליצירת סוכנים שפונים למשתמשים.

בנוסף לקיצור של 28% בזמני התגובה, משתמשי הפלטפורמה נהנו מחיסכון של 50% בעלויות ומגידול של 78% בנפח העבודה כשהם השתמשו ב-Gemini 1.5 Flash. היכולת לטפל בנפח גדול של בקשות בלי לפגוע בביצועים הופכת את מודלי Gemini Flash לבחירה ברורה עבור אפליקציות עם ביקוש גבוה לתרחישי שימוש כמו יצירת תוכן לרשתות חברתיות, סיכום של מאמרי מחקר וניתוח פעיל של מסמכים רפואיים.

31.1 טוקנים/שנייה

תפוקה גבוהה ב-78% עם Flash לעומת מודלים דומים

7.8x

חלון הקשר גדול יותר עם Flash לעומת מודלים דומים

28%

זמני תגובה מהירים יותר עם Flash בהשוואה למודלים דומים

50%

עלויות נמוכות יותר עם Flash בהשוואה למודלים דומים

- מקור: הבלוג של Langbase

איך Langbase מפשט את פיתוח הסוכנים

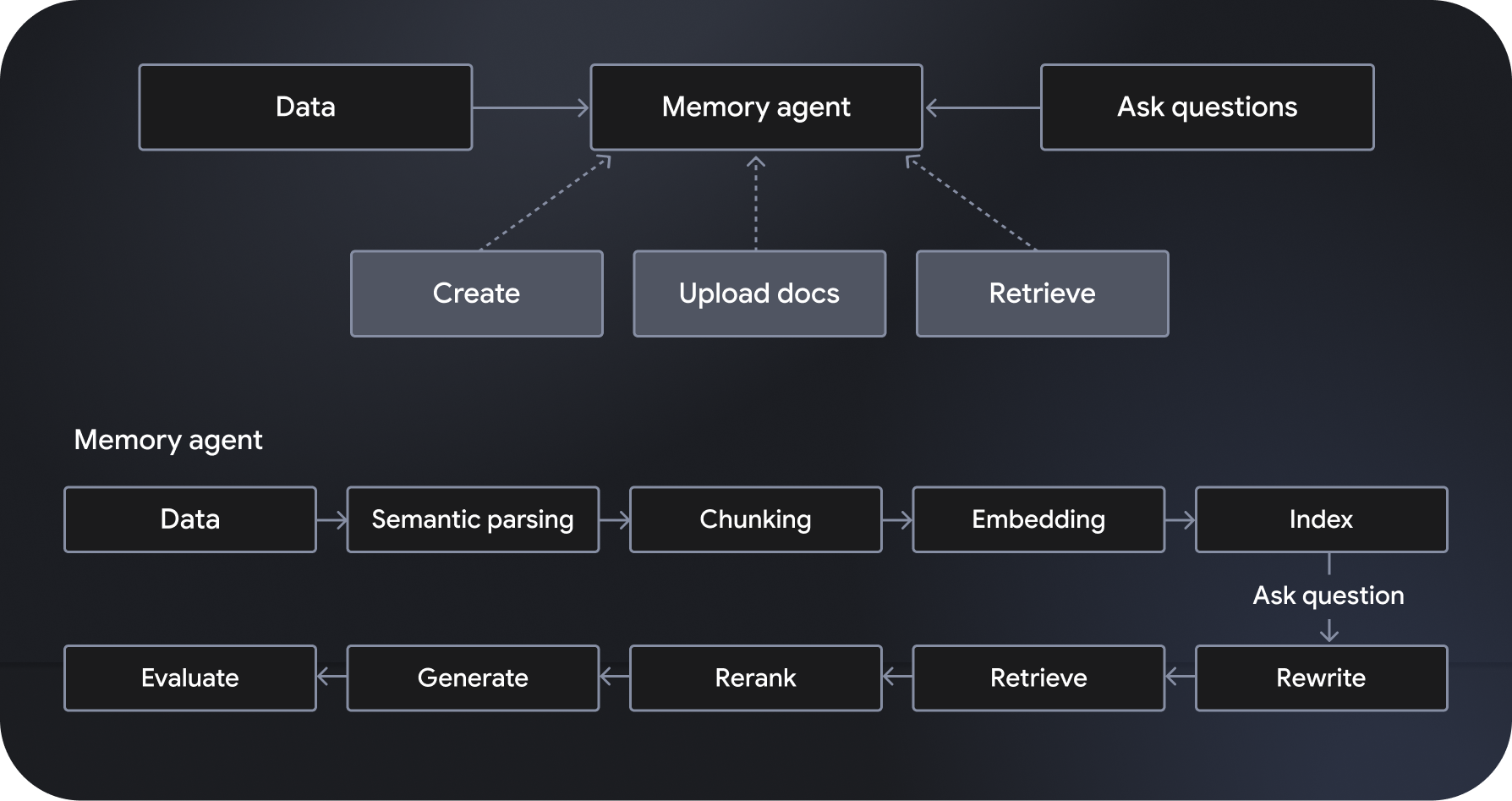

Langbase היא פלטפורמה מודולרית לפיתוח ולפריסה של סוכני AI ללא שרת (serverless), שמאפשרת ליצור סוכני AI ללא שרת. הוא מציע מערכות RAG (שליפה משופרת גנרטיבית) סמנטיות, ניתנות להתאמה לעומס ועם ניהול מלא, שנקראות סוכני זיכרון. תכונות נוספות כוללות תזמור תהליכי עבודה, ניהול נתונים, טיפול באינטראקציות עם משתמשים ושילוב עם שירותים חיצוניים.

סוכני צינורות, שמבוססים על מודלים כמו Gemini 2.0 Flash, פועלים בהתאם להוראות שניתנו להם ויש להם גישה לכלים מתקדמים, כולל חיפוש וסריקה באינטרנט. לעומת זאת, סוכני זיכרון ניגשים באופן דינמי לנתונים רלוונטיים כדי ליצור תשובות מבוססות. ממשקי ה-API של Pipe ו-Memory של Langbase מאפשרים למפתחים ליצור תכונות עוצמתיות על ידי חיבור של יכולות ניתוח עוצמתיות למקורות נתונים חדשים, וכך להרחיב את הידע והשימושיות של מודלים של AI.

סוכני AI מאפשרים ליצור אפליקציות חזקות יותר, כי הם מבצעים אוטומציה של תהליכים מורכבים, משפרים את היעילות של תהליכי העבודה ומספקים למשתמשים חוויות מותאמות אישית. השילוב של יכולות נימוק חזקות, עלויות נמוכות ומהירויות גבוהות הופך את מודלי Gemini Flash לבחירה מועדפת בקרב משתמשי Langbase. מומלץ לעיין בפלטפורמה כדי להתחיל לבנות ולפרוס סוכני AI יעילים וניתנים להרחבה.