2024년 10월 30일

Gemini API를 사용하여 AI 에이전트를 프로덕션에 도입

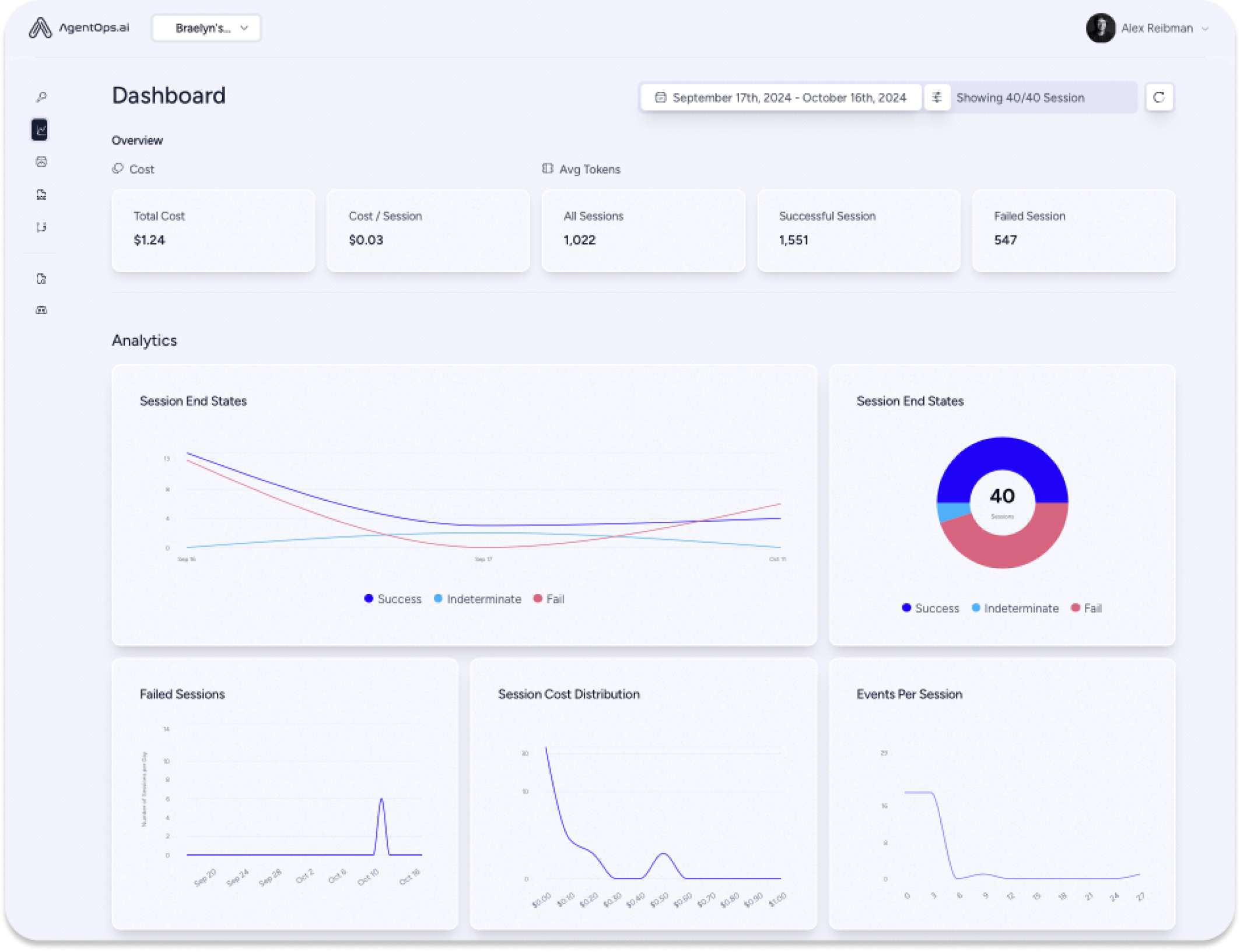

AI 에이전트를 빌드하고 배포하는 것은 흥미로운 분야이지만, 프로덕션 환경에서 이러한 복잡한 시스템을 관리하려면 강력한 관측 가능성이 필요합니다. 에이전트 모니터링, LLM 비용 추적, 벤치마킹 등을 위한 Python SDK인 AgentOps를 사용하면 특히 Gemini API의 강력한 기능과 비용 효율성을 결합할 때 개발자가 프로토타입에서 프로덕션까지 에이전트를 가져갈 수 있습니다.

Gemini의 장점

AgentOps를 개발한 팀인 Agency AI의 COO인 Adam Silverman은 대규모로 AI 에이전트를 배포하는 기업에 비용이 중요한 요소라고 설명합니다. 'LLM 호출에 월 80,000달러를 지출하는 기업도 있습니다. Gemini 1.5를 사용하면 동일한 출력에 수천 달러가 들었을 것입니다.'

이러한 비용 효율성과 Gemini의 강력한 언어 이해 및 생성 기능을 결합하면 정교한 AI 에이전트를 빌드하는 개발자에게 이상적인 선택이 됩니다. 실버먼은 'Gemini 1.5 Flash는 더 큰 모델과 비슷한 품질을 제공하면서도 비용은 훨씬 적게 들고 속도는 매우 빠릅니다'라고 말합니다. 따라서 개발자는 비용이 과도하게 청구될 걱정 없이 복잡한 다단계 에이전트 워크플로를 구축하는 데 집중할 수 있습니다.

'다른 LLM 제공업체의 개별 에이전트 실행 비용은 실행당 500달러 이상입니다. Gemini (1.5 Flash-8B)를 사용하면 동일한 실행에 50달러 미만의 비용이 듭니다.”

AI 에이전트 지원

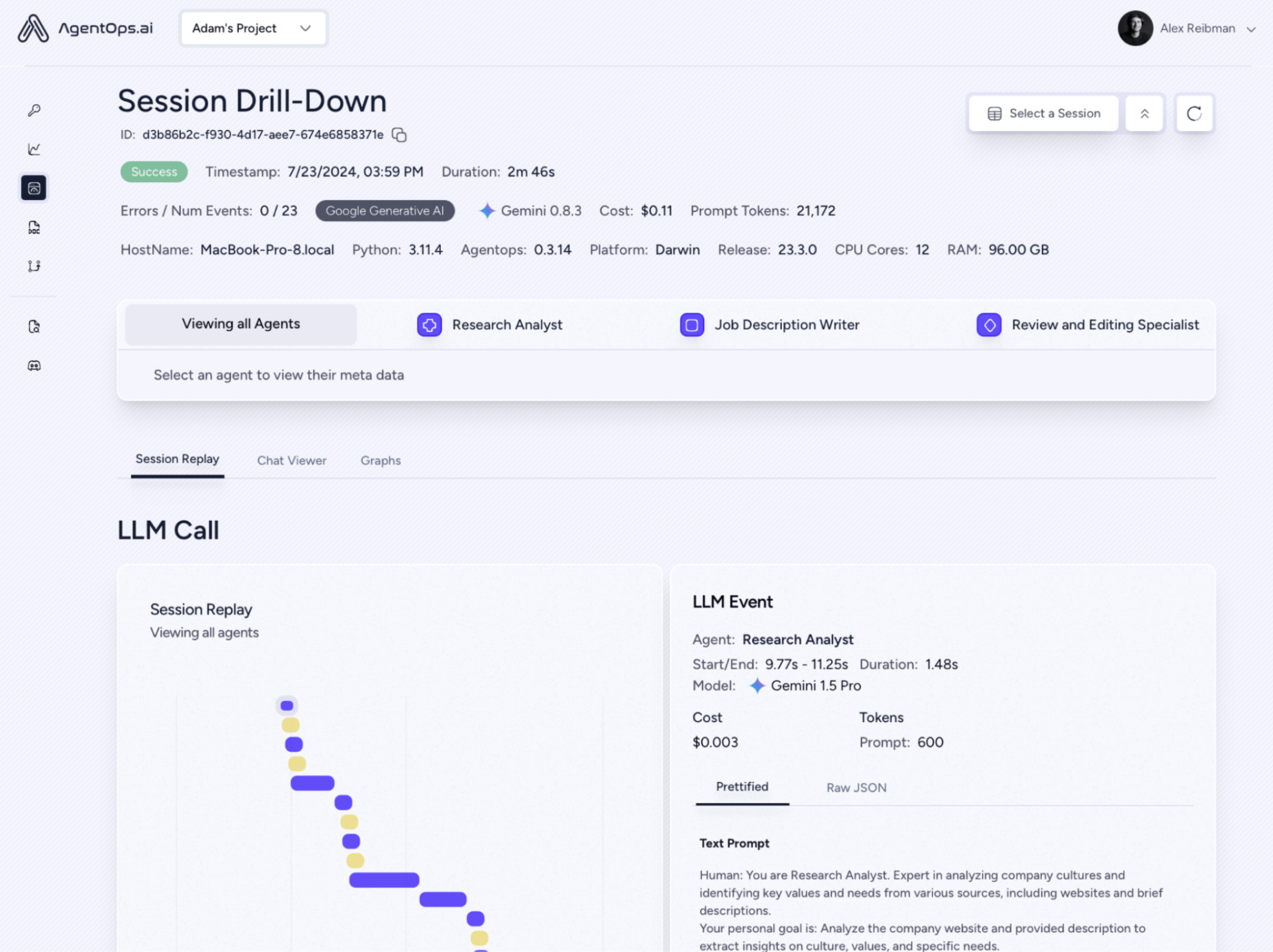

AgentOps는 LLM 호출뿐만 아니라 모든 에이전트 상호작용에 관한 데이터를 캡처하여 멀티 에이전트 시스템이 작동하는 방식을 포괄적으로 파악할 수 있도록 지원합니다. 이 세부적인 수준의 정보는 엔지니어링 및 규정 준수팀에 필수적이며 디버깅, 최적화, 감사 추적에 중요한 통계를 제공합니다.

Gemini 모델을 AgentOps와 통합하는 것은 매우 간단하며 LiteLLM을 사용하면 몇 분밖에 걸리지 않습니다. 개발자는 Gemini API 호출을 빠르게 파악하고, 비용을 실시간으로 추적하고, 프로덕션에서 에이전트의 안정성을 보장할 수 있습니다.

향후 계획

AgentOps는 에이전트 개발자가 프로젝트를 확장할 수 있도록 지원하기 위해 최선을 다하고 있습니다. Agency AI는 기업이 저렴하고 확장 가능한 에이전트를 빌드하는 복잡성을 해결하는 데 도움을 주어 AgentOps와 Gemini API를 결합하는 가치 제안을 더욱 공고히 합니다. 실버먼은 '가격에 민감한 개발자들이 에이전트를 빌드하도록 유도하고 있습니다'라고 강조합니다.

Gemini 사용을 고려하는 개발자에게 Silverman은 '사용해 보면 놀라실 겁니다'라고 조언합니다.