9 DE ABRIL DE 2025

Agentes de IA de alta capacidad de procesamiento y bajo costo con Gemini Flash en Langbase

Por lo general, la creación de agentes de IA capaces de administrar de forma autónoma sus operaciones y herramientas externas requiere superar obstáculos relacionados con la integración y la infraestructura. Langbase elimina la carga de administrar estas complejidades subyacentes y proporciona una plataforma para crear e implementar agentes de IA sin servidores potenciados por modelos como Gemini, todo sin un framework.

Desde el lanzamiento de Gemini Flash, los usuarios de Langbase se dieron cuenta rápidamente de las ventajas de rendimiento y costos de usar estos modelos livianos para experiencias basadas en agentes.

Cómo lograr escalabilidad y agentes de IA más rápidos con Gemini Flash

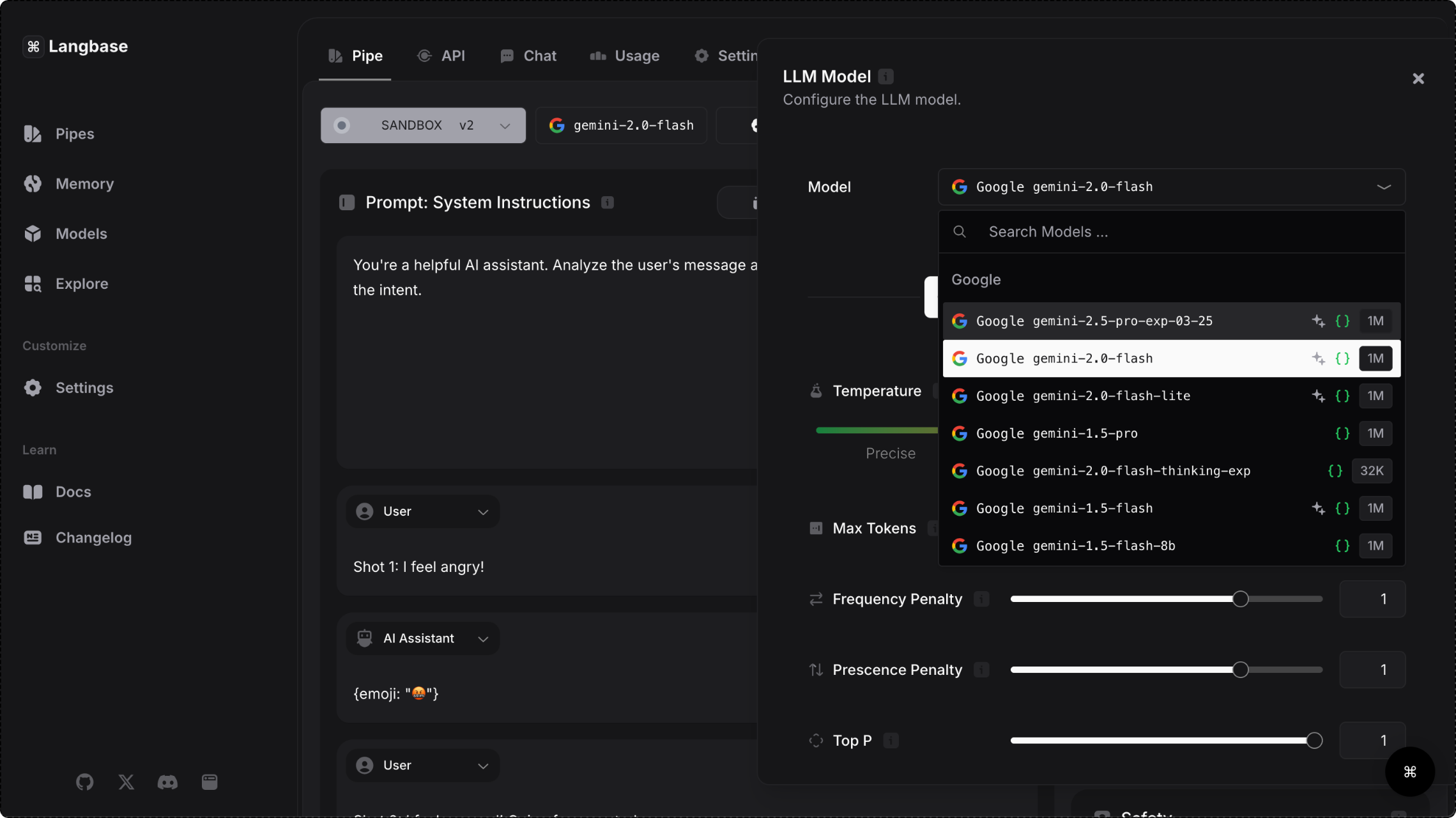

La plataforma Langbase proporciona acceso a los modelos de Gemini a través de la API de Gemini, lo que permite a los usuarios elegir modelos rápidos que pueden manejar tareas complejas y procesar grandes cantidades de datos. Dado que la baja latencia es fundamental para brindar una experiencia fluida en tiempo real, la familia de modelos Gemini Flash es especialmente adecuada para crear agentes orientados al usuario.

Además de tiempos de respuesta un 28% más rápidos, los usuarios de la plataforma experimentaron una reducción del 50% en los costos y un aumento del 78% en el rendimiento de sus operaciones cuando utilizaron Gemini 1.5 Flash. La capacidad de manejar un gran volumen de solicitudes sin comprometer el rendimiento hace que los modelos de Gemini Flash sean una opción obvia para las aplicaciones de alta demanda en casos de uso como la creación de contenido para redes sociales, el resumen de documentos de investigación y el análisis activo de documentos médicos.

31.1 tokens/s

Un 78% más de rendimiento con Flash en comparación con modelos similares

7.8 veces

Ventana de contexto más grande con Flash en comparación con modelos similares

28%

Tiempos de respuesta más rápidos con Flash en comparación con modelos similares

50%

Menores costos con Flash en comparación con modelos similares

- Fuente: Blog de Langbase

Cómo Langbase simplifica el desarrollo de agentes

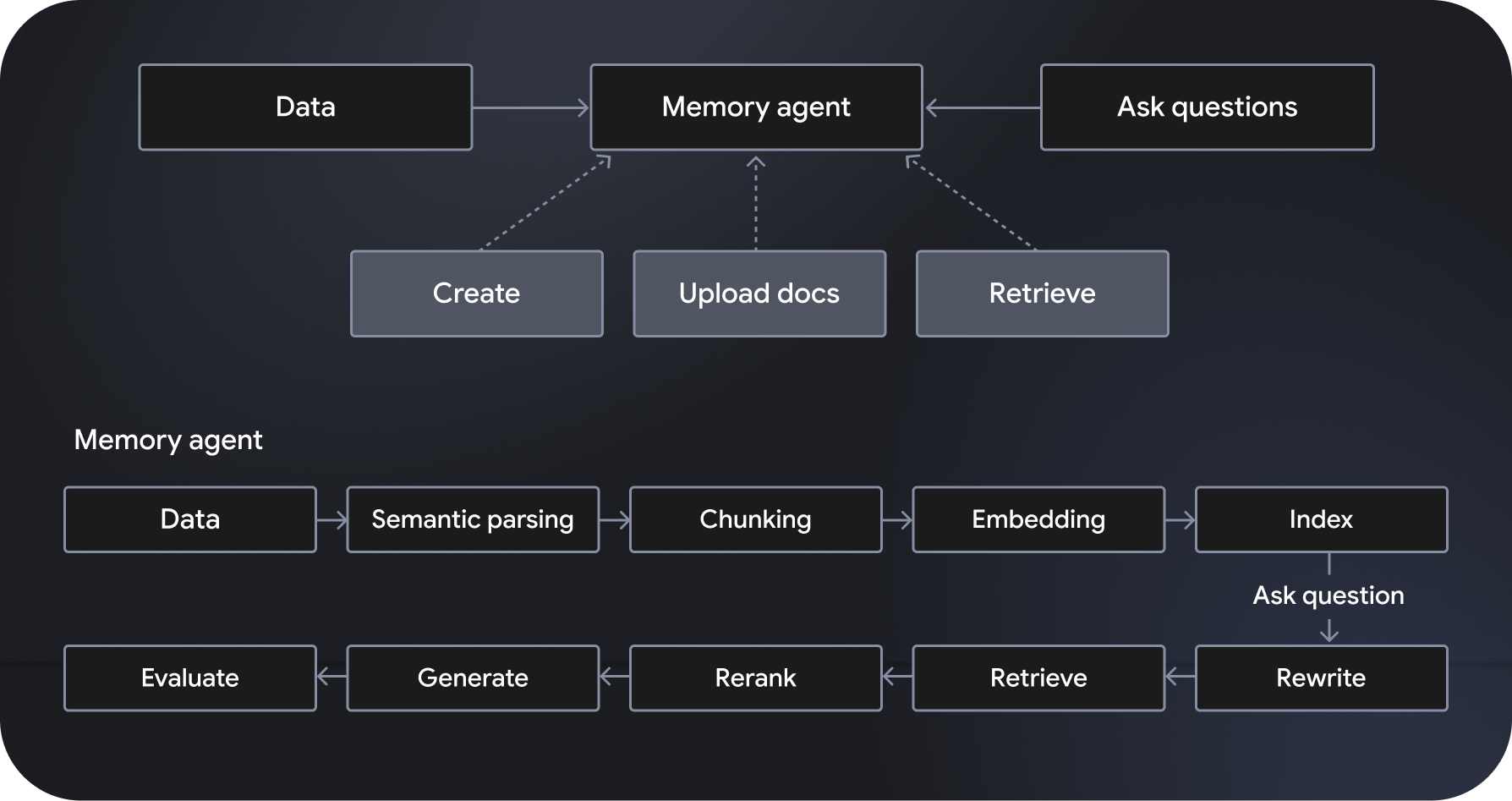

Langbase es una plataforma de desarrollo y de implementación de agentes de IA sin servidores y componibles que permite la creación de agentes de IA sin servidores. Ofrece sistemas de generación mejorada por recuperación (RAG) semántica escalables y completamente administrados, conocidos como “agentes de memoria”. Las funciones adicionales incluyen la organización de flujos de trabajo, la administración de datos, el manejo de la interacción del usuario y la integración con servicios externos.

Potenciados por modelos como Gemini 2.0 Flash, los “agentes de canalización” cumplen y actúan según las instrucciones especificadas, y tienen acceso a herramientas potentes, como la búsqueda y el rastreo web. Por otro lado, los agentes de memoria acceden de forma dinámica a los datos pertinentes para generar respuestas fundamentadas. Las APIs de Pipe y Memory de Langbase permiten que los desarrolladores creen funciones potentes conectando un razonamiento sólido a nuevas fuentes de datos, lo que expande el conocimiento y la utilidad de los modelos de IA.

Al automatizar procesos complicados, mejorar la eficiencia del flujo de trabajo y brindar a los usuarios experiencias altamente personalizadas, los agentes de IA abren posibilidades para aplicaciones más potentes. La combinación de un razonamiento potente, costos bajos y velocidades más rápidas hace que los modelos de Gemini Flash sean la opción preferida para los usuarios de Langbase. Explora la plataforma para comenzar a crear e implementar agentes de IA altamente eficientes y escalables.