জেমা ওপেন মডেল

মিথুন মডেল তৈরি করতে ব্যবহৃত একই গবেষণা এবং প্রযুক্তি থেকে তৈরি হালকা ওজনের, অত্যাধুনিক ওপেন মডেলের একটি পরিবার

জেমা 2 চেষ্টা করুন

আউটসাইজ পারফরম্যান্স এবং অতুলনীয় দক্ষতার জন্য পুনরায় ডিজাইন করা হয়েছে, জেমা 2 বিভিন্ন হার্ডওয়্যারের উপর জ্বলন্ত-দ্রুত অনুমানের জন্য অপ্টিমাইজ করে।

5-শট

MMLU

MMLU বেঞ্চমার্ক হল একটি পরীক্ষা যা প্রাক-প্রশিক্ষণের সময় বৃহৎ ভাষার মডেল দ্বারা অর্জিত জ্ঞানের পরিধি এবং সমস্যা সমাধানের ক্ষমতা পরিমাপ করে।

25-শট

ARC-C

ARC-c বেঞ্চমার্ক হল ARC-e ডেটাসেটের আরও বেশি ফোকাসড সাবসেট, যেখানে শুধুমাত্র সাধারণ (পুনরুদ্ধার-বেস এবং শব্দ সহ-ঘটনা) অ্যালগরিদম দ্বারা ভুল উত্তর দেওয়া প্রশ্ন রয়েছে।

5-শট

GSM8K

GSM8K বেঞ্চমার্ক একটি ভাষা মডেলের গ্রেড-স্কুল-স্তরের গণিত সমস্যাগুলি সমাধান করার ক্ষমতা পরীক্ষা করে যার জন্য প্রায়শই একাধিক পদক্ষেপের যুক্তির প্রয়োজন হয়।

3-5-শট

AGIEval

AGIEval বেঞ্চমার্ক মানুষের বৌদ্ধিক ক্ষমতা মূল্যায়ন করার জন্য ডিজাইন করা বাস্তব-বিশ্ব পরীক্ষা থেকে প্রাপ্ত প্রশ্ন ব্যবহার করে একটি ভাষা মডেলের সাধারণ বুদ্ধিমত্তা পরীক্ষা করে।

3-শট, CoT

বিবিএইচ

বিবিএইচ (বিআইজি-বেঞ্চ হার্ড) বেঞ্চমার্ক বর্তমান ভাষার মডেলের ক্ষমতার বাইরে বিবেচিত কাজগুলির উপর ফোকাস করে, বিভিন্ন যুক্তি এবং বোঝার ডোমেন জুড়ে তাদের সীমা পরীক্ষা করে।

3-শট, F1

ড্রপ

DROP হল একটি রিডিং কম্প্রিহেনশন বেঞ্চমার্ক যার জন্য অনুচ্ছেদের উপর আলাদা যুক্তির প্রয়োজন হয়।

5-শট

উইনোগ্রান্ডে

Winogrande বেঞ্চমার্ক বাইনারি বিকল্পগুলির সাথে অস্পষ্ট ফিল-ইন-দ্য-শূন্য কাজগুলি সমাধান করার জন্য একটি ভাষা মডেলের ক্ষমতা পরীক্ষা করে, সাধারণীকৃত কমনসেন্স যুক্তির প্রয়োজন হয়।

10-শট

HellaSwag

HellaSwag বেঞ্চমার্ক একটি গল্পের সবচেয়ে যৌক্তিক সমাপ্তি নির্বাচন করে একটি ভাষা মডেলের সাধারণ জ্ঞানের যুক্তি বোঝার এবং প্রয়োগ করার ক্ষমতাকে চ্যালেঞ্জ করে।

4-শট

গণিত

MATH একটি ভাষা মডেলের জটিল গাণিতিক শব্দ সমস্যাগুলি সমাধান করার ক্ষমতা মূল্যায়ন করে, যার জন্য যুক্তি, বহু-পদক্ষেপ সমস্যা-সমাধান এবং গাণিতিক ধারণাগুলির বোঝার প্রয়োজন।

0-শট

ARC-ই

ARC-e বেঞ্চমার্ক প্রকৃত গ্রেড-স্কুল স্তর, বহুনির্বাচনী বিজ্ঞানের প্রশ্নগুলির সাথে একটি ভাষা মডেলের উন্নত প্রশ্ন-উত্তর দক্ষতা পরীক্ষা করে।

0-শট

PIQA

PIQA বেঞ্চমার্ক একটি ভাষা মডেলের দৈনন্দিন শারীরিক মিথস্ক্রিয়া সম্পর্কে প্রশ্নের উত্তর দিয়ে শারীরিক কমনসেন্স জ্ঞান বোঝার এবং প্রয়োগ করার ক্ষমতা পরীক্ষা করে।

0-শট

SIQA

SIQA বেঞ্চমার্ক মানুষের ক্রিয়াকলাপ এবং তাদের সামাজিক প্রভাব সম্পর্কে প্রশ্ন জিজ্ঞাসা করে একটি ভাষা মডেলের সামাজিক মিথস্ক্রিয়া এবং সামাজিক সাধারণ জ্ঞানের বোঝার মূল্যায়ন করে।

0-শট

বুলক

BoolQ বেঞ্চমার্ক একটি ভাষা মডেলের স্বাভাবিকভাবে হ্যাঁ/না প্রশ্নের উত্তর দেওয়ার ক্ষমতা পরীক্ষা করে, বাস্তব-বিশ্বের প্রাকৃতিক ভাষা অনুমান কাজগুলি করার মডেলের ক্ষমতা পরীক্ষা করে।

5-শট

ট্রিভিয়াকিউএ

TriviaQA বেঞ্চমার্ক প্রশ্ন-উত্তর-প্রমাণ ট্রিপল সহ পড়ার বোঝার দক্ষতা পরীক্ষা করে।

5-শট

NQ

NQ (প্রাকৃতিক প্রশ্ন) বেঞ্চমার্ক বাস্তব-বিশ্বের প্রশ্ন-উত্তর পরিস্থিতির অনুকরণ করে সমগ্র উইকিপিডিয়া নিবন্ধগুলির মধ্যে উত্তরগুলি খুঁজে পাওয়ার এবং বোঝার জন্য একটি ভাষা মডেলের ক্ষমতা পরীক্ষা করে।

পাস@1

হিউম্যান ইভাল

হিউম্যানইভাল বেঞ্চমার্ক একটি ভাষা মডেলের কোড তৈরির ক্ষমতা পরীক্ষা করে এর সমাধানগুলি প্রোগ্রামিং সমস্যার জন্য কার্যকরী ইউনিট পরীক্ষায় উত্তীর্ণ হয় কিনা তা মূল্যায়ন করে।

3-শট

এমবিপিপি

MBPP বেঞ্চমার্ক মৌলিক প্রোগ্রামিং ধারণা এবং স্ট্যান্ডার্ড লাইব্রেরি ব্যবহারের উপর ফোকাস করে মৌলিক পাইথন প্রোগ্রামিং সমস্যাগুলি সমাধান করার জন্য একটি ভাষা মডেলের ক্ষমতা পরীক্ষা করে।

100%

75%

৫০%

২৫%

0%

100%

75%

৫০%

২৫%

0%

জেমা ঘ

2.5B

জেমা 2

2.6B

মিস্ট্রাল

7B

লামা ৩

8 বি

জেমা ঘ

7B

জেমা 2

9B

জেমা 2

27বি

জেমা ঘ

2.5B

জেমা 2

2.6B

মিস্ট্রাল

7B

লামা ৩

8 বি

জেমা ঘ

7B

জেমা 2

9B

জেমা 2

27বি

জেমা ঘ

2.5B

জেমা 2

2.6B

মিস্ট্রাল

7B

লামা ৩

8 বি

জেমা ঘ

7B

জেমা 2

9B

জেমা 2

27বি

জেমা ঘ

2.5B

জেমা 2

2.6B

মিস্ট্রাল

7B

লামা ৩

8 বি

জেমা ঘ

7B

জেমা 2

9B

জেমা 2

27বি

জেমা ঘ

2.5B

জেমা 2

2.6B

মিস্ট্রাল

7B

লামা ৩

8 বি

জেমা ঘ

7B

জেমা 2

9B

জেমা 2

27বি

জেমা ঘ

2.5B

জেমা 2

2.6B

মিস্ট্রাল

7B

লামা ৩

8 বি

জেমা ঘ

7B

জেমা 2

9B

জেমা 2

27বি

জেমা ঘ

2.5B

জেমা 2

2.6B

মিস্ট্রাল

7B

লামা ৩

8 বি

জেমা ঘ

7B

জেমা 2

9B

জেমা 2

27বি

জেমা ঘ

2.5B

জেমা 2

2.6B

মিস্ট্রাল

7B

লামা ৩

8 বি

জেমা ঘ

7B

জেমা 2

9B

জেমা 2

27বি

জেমা ঘ

2.5B

জেমা 2

2.6B

মিস্ট্রাল

7B

জেমা ঘ

7B

জেমা 2

9B

জেমা 2

27বি

জেমা ঘ

2.5B

জেমা 2

2.6B

মিস্ট্রাল

7B

জেমা ঘ

7B

জেমা 2

9B

জেমা 2

27বি

জেমা ঘ

2.5B

জেমা 2

2.6B

মিস্ট্রাল

7B

জেমা ঘ

7B

জেমা 2

9B

জেমা 2

27বি

জেমা ঘ

2.5B

জেমা 2

2.6B

মিস্ট্রাল

7B

জেমা ঘ

7B

জেমা 2

9B

জেমা 2

27বি

জেমা ঘ

2.5B

জেমা 2

2.6B

মিস্ট্রাল

7B

জেমা ঘ

7B

জেমা 2

9B

জেমা 2

27বি

জেমা ঘ

2.5B

জেমা 2

2.6B

মিস্ট্রাল

7B

জেমা ঘ

7B

জেমা 2

9B

জেমা 2

27বি

জেমা ঘ

2.5B

জেমা 2

2.6B

মিস্ট্রাল

7B

জেমা ঘ

7B

জেমা 2

9B

জেমা 2

27বি

জেমা ঘ

2.5B

জেমা 2

2.6B

মিস্ট্রাল

7B

জেমা ঘ

7B

জেমা 2

9B

জেমা 2

27বি

জেমা ঘ

2.5B

জেমা 2

2.6B

মিস্ট্রাল

7B

জেমা ঘ

7B

জেমা 2

9B

জেমা 2

27বি

*এগুলি হল প্রাক-প্রশিক্ষিত মডেলের মানদণ্ড, অন্যান্য পদ্ধতির সাথে পারফরম্যান্সের বিস্তারিত জানার জন্য প্রযুক্তিগত প্রতিবেদনটি দেখুন।

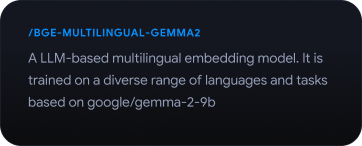

গবেষণা মডেল

বর্ধিত জেমা মডেল পরিবার আবিষ্কার করুন

Gemmaverse অন্বেষণ

সম্প্রদায়ের তৈরি জেমা মডেল এবং সরঞ্জামগুলির একটি বিশাল ইকোসিস্টেম, আপনার উদ্ভাবনকে শক্তি এবং অনুপ্রাণিত করতে প্রস্তুত

নির্মাণ করুন

জেম্মা দিয়ে নির্মাণ শুরু করুন

জেমা কুকবুক পড়ুন

গুগলের খোলা মডেলের জন্য ব্যবহারিক উদাহরণ ও টিউটোরিয়াল

নোটবুক অন্বেষণ