Men-deploy AI di seluruh aplikasi seluler, web, dan tersemat

-

Di perangkat

Mengurangi latensi. Berfungsi secara offline. Menjaga data Anda tetap lokal & pribadi.

-

Lintas platform

Jalankan model yang sama di Android, iOS, web, dan tersemat.

-

Multi-framework

Kompatibel dengan model JAX, Keras, PyTorch, dan TensorFlow.

-

Stack edge AI lengkap

Framework fleksibel, solusi siap pakai, akselerator hardware

Solusi siap pakai dan framework fleksibel

API low-code untuk tugas AI umum

API lintas platform untuk menangani tugas AI generatif, visi, teks, dan audio umum.

Mulai menggunakan tugas MediaPipeMen-deploy model kustom lintas platform

Jalankan model JAX, Keras, PyTorch, dan TensorFlow dengan performa tinggi di perangkat Android, iOS, web, dan tersemat, yang dioptimalkan untuk ML tradisional dan AI generatif.

Mulai menggunakan LiteRT

Mempersingkat siklus pengembangan dengan visualisasi

Visualisasikan transformasi model Anda melalui konversi dan kuantisasi. Debug hotspot dengan menempatkan hasil benchmark.

Mulai menggunakan Penjelajah Model

Mem-build pipeline kustom untuk fitur ML yang kompleks

Buat tugas Anda sendiri dengan membuat rantai beberapa model ML secara efektif bersama dengan logika pra-pemrosesan dan pasca-pemrosesan. Menjalankan pipeline yang dipercepat (GPU & NPU) tanpa pemblokiran di CPU.

Memulai MediaPipe Framework

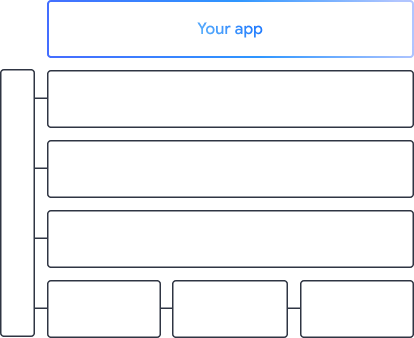

Alat dan framework yang mendukung aplikasi Google

Jelajahi stack edge AI lengkap, dengan produk di setiap tingkat — mulai dari API low-code hingga library akselerasi khusus hardware.

MediaPipe Tasks

MediaPipe Tasks

Buat fitur AI dengan cepat ke dalam aplikasi seluler dan web menggunakan API low-code untuk tugas umum yang mencakup AI generatif, computer vision, teks, dan audio.

AI Generatif

Integrasikan model bahasa dan gambar generatif langsung ke dalam aplikasi Anda dengan API siap pakai.

Vision

Jelajahi berbagai tugas visi yang mencakup segmentasi, klasifikasi, deteksi, pengenalan, dan landmark tubuh.

Teks & audio

Klasifikasikan teks dan audio dalam berbagai kategori, termasuk bahasa, sentimen, dan kategori kustom Anda sendiri.

Mulai

Framework MediaPipe

Framework MediaPipe

Framework tingkat rendah yang digunakan untuk membuat pipeline ML dengan akselerasi berperforma tinggi, sering kali menyertakan beberapa model ML yang digabungkan dengan pra-pemrosesan dan pascapemrosesan.

LiteRT

LiteRT

Men-deploy model AI yang dibuat dalam framework apa pun di seluruh perangkat seluler, web, dan mikrokontroler dengan akselerasi khusus hardware yang dioptimalkan.

Multi-framework

Mengonversi model dari JAX, Keras, PyTorch, dan TensorFlow untuk dijalankan di edge.

Lintas platform

Jalankan model yang sama persis di Android, iOS, web, dan mikrokontroler dengan SDK native.

Ringan & cepat

Runtime LiteRT yang efisien hanya memerlukan beberapa megabyte dan memungkinkan akselerasi model di seluruh CPU, GPU, dan NPU.

Mulai

Penjelajah Model

Penjelajah Model

Jelajahi, debug, dan bandingkan model Anda secara visual. Menempatkan tolok ukur performa dan angka untuk menemukan hotspot yang bermasalah.

Gemini Nano di Android & Chrome

Membuat pengalaman AI generatif menggunakan model di perangkat Google yang paling canggih