मोबाइल, वेब, और एम्बेड किए गए ऐप्लिकेशन में एआई को डिप्लॉय करना

-

डिवाइस पर मौजूद

इंतज़ार का समय कम करना. ऑफ़लाइन काम करें. अपने डेटा को स्थानीय और निजी रखें.

-

क्रॉस-प्लैटफ़ॉर्म

Android, iOS, वेब, और एम्बेड किए गए प्लैटफ़ॉर्म पर एक ही मॉडल चलाएं.

-

मल्टी-फ़्रेमवर्क

JAX, Keras, PyTorch, और TensorFlow मॉडल के साथ काम करता है.

-

एआई का पूरा एज स्टैक

ज़रूरत के मुताबिक फ़्रेमवर्क, टर्नकी समाधान, और हार्डवेयर एक्सेलेरेटर

पहले से तैयार समाधान और सुविधाजनक फ़्रेमवर्क

एआई से जुड़े सामान्य टास्क के लिए कम कोड वाले एपीआई

क्रॉस-प्लैटफ़ॉर्म एपीआई, जो जनरेटिव एआई, विज़न, टेक्स्ट, और ऑडियो से जुड़े सामान्य टास्क को हल करने में मदद करते हैं.

MediaPipe टास्क का इस्तेमाल शुरू करनाकस्टम मॉडल को अलग-अलग प्लैटफ़ॉर्म पर डिप्लॉय करना

Android, iOS, वेब, और एम्बेड किए गए डिवाइसों पर JAX, Keras, PyTorch, और TensorFlow मॉडल को बेहतर तरीके से चलाएं. ये मॉडल, पारंपरिक एमएल और जनरेटिव एआई के लिए ऑप्टिमाइज़ किए गए हैं.

LiteRT का इस्तेमाल शुरू करें

विज़ुअलाइज़ेशन की मदद से, डेवलपमेंट साइकल को छोटा करना

कन्वर्ज़न और क्वांटिज़ेशन की मदद से, अपने मॉडल के ट्रांसफ़ॉर्मेशन को विज़ुअलाइज़ करें. बेंचमार्क के नतीजों को ओवरले करके, हॉटस्पॉट डीबग करें.

मॉडल एक्सप्लोरर का इस्तेमाल शुरू करें

एमएल की जटिल सुविधाओं के लिए कस्टम पाइपलाइन बनाना

डेटा को पहले और बाद में प्रोसेस करने के लॉजिक के साथ-साथ, कई एमएल मॉडल को बेहतर तरीके से जोड़कर, अपना टास्क बनाएं. सीपीयू को ब्लॉक किए बिना, बेहतर परफ़ॉर्मेंस वाली (GPU और NPU) पाइपलाइन चलाएं.

MediaPipe फ़्रेमवर्क का इस्तेमाल शुरू करना

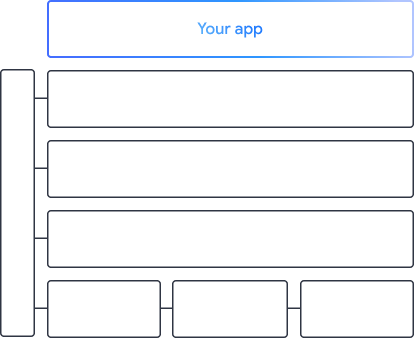

Google के ऐप्लिकेशन को बेहतर बनाने वाले टूल और फ़्रेमवर्क

एआई एज स्टैक को एक्सप्लोर करें. इसमें हर लेवल के प्रॉडक्ट शामिल हैं. जैसे, कम कोड वाले एपीआई से लेकर, हार्डवेयर के हिसाब से तेज़ी से काम करने वाली लाइब्रेरी तक.

MediaPipe Tasks

MediaPipe Tasks

कम कोड वाले एपीआई का इस्तेमाल करके, मोबाइल और वेब ऐप्लिकेशन में एआई की सुविधाएं तुरंत जोड़ें. इन सुविधाओं का इस्तेमाल, जनरेटिव एआई, कंप्यूटर विज़न, टेक्स्ट, और ऑडियो से जुड़े सामान्य टास्क के लिए किया जा सकता है.

जनरेटिव एआई

इस्तेमाल के लिए तैयार एपीआई की मदद से, जनरेटिव भाषा और इमेज मॉडल को सीधे अपने ऐप्लिकेशन में इंटिग्रेट करें.

Vision

विज़न से जुड़े कई तरह के टास्क एक्सप्लोर करें. इनमें सेगमेंटेशन, क्लासिफ़िकेशन, पहचान, पहचानने, और शरीर के लैंडमार्क शामिल हैं.

टेक्स्ट और ऑडियो

टेक्स्ट और ऑडियो को कई कैटगरी में बांटें. इनमें भाषा, सेंटीमेंट, और अपनी पसंद के मुताबिक बनाई गई कैटगरी शामिल हैं.

अपनी प्रोफ़ाइल बनाना शुरू करें

MediaPipe फ़्रेमवर्क

MediaPipe फ़्रेमवर्क

यह एक लो लेवल फ़्रेमवर्क है. इसका इस्तेमाल, बेहतर परफ़ॉर्मेंस वाली एमएल पाइपलाइन बनाने के लिए किया जाता है. इसमें आम तौर पर, प्री और पोस्ट प्रोसेसिंग के साथ कई एमएल मॉडल शामिल होते हैं.

LiteRT

LiteRT

किसी भी फ़्रेमवर्क में बनाए गए एआई मॉडल को मोबाइल, वेब, और माइक्रोकंट्रोलर पर डिप्लॉय करें. साथ ही, हार्डवेयर के हिसाब से तेज़ी लाने की सुविधा का इस्तेमाल करें.

मल्टी-फ़्रेमवर्क

JAX, Keras, PyTorch, और TensorFlow के मॉडल को एज पर चलाने के लिए बदलें.

क्रॉस-प्लैटफ़ॉर्म

नेटिव SDK टूल की मदद से, Android, iOS, वेब, और माइक्रोकंट्रोलर पर एक ही मॉडल चलाएं.

लाइटवेट और तेज़

LiteRT का बेहतर रनटाइम सिर्फ़ कुछ मेगाबाइट का होता है. साथ ही, यह सीपीयू, जीपीयू, और एनपीयू पर मॉडल को तेज़ी से चलाने की सुविधा देता है.

अपनी प्रोफ़ाइल बनाना शुरू करें

मॉडल एक्सप्लोरर

मॉडल एक्सप्लोरर

अपने मॉडल को विज़ुअल तौर पर एक्सप्लोर करें, डीबग करें, और उनकी तुलना करें. समस्या वाले हॉटस्पॉट की पहचान करने के लिए, परफ़ॉर्मेंस के मानदंड और संख्याओं को ओवरले करें.

Android और Chrome में Gemini Nano

Google के सबसे बेहतरीन, डिवाइस पर मौजूद मॉडल का इस्तेमाल करके, जनरेटिव एआई के अनुभव बनाएं