2024 年 10 月 30 日

使用 Gemini API 将 AI 智能体投入生产

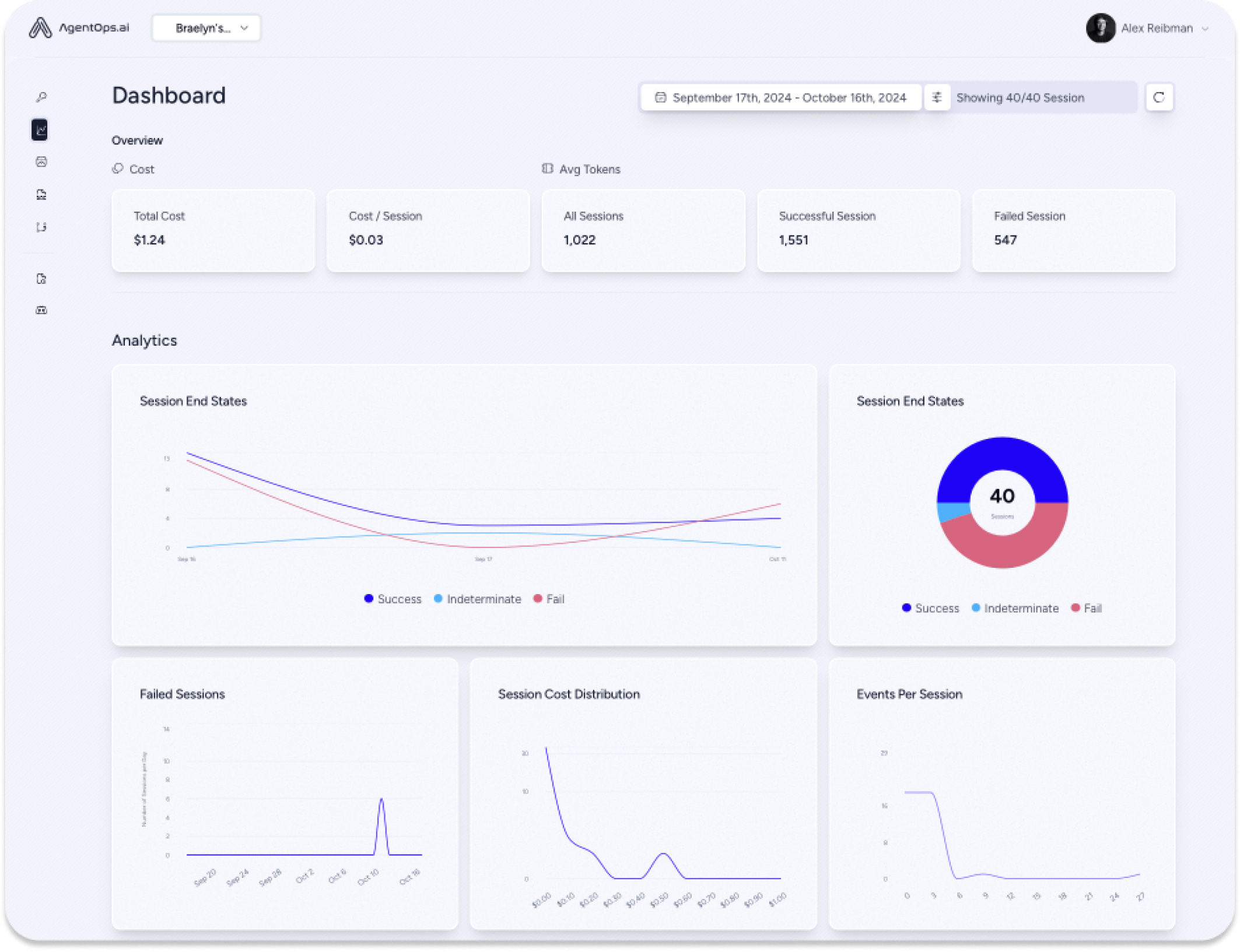

构建和部署 AI 智能体是一项令人兴奋的创新,但在生产环境中管理这些复杂的系统需要强大的可观测性。AgentOps 是一款用于代理监控、LLM 成本跟踪、基准比较等的 Python SDK,可帮助开发者将代理从原型转化为生产版本,尤其是在与 Gemini API 的强大功能和成本效益相结合时。

Gemini 的优势

AgentOps 背后的团队 Agency AI 的首席运营官 Adam Silverman 解释说,对于大规模部署 AI 智能体的企业而言,成本是一个关键因素。“我们看到,有些企业每月在 LLM 调用方面的支出高达 8 万美元。如果使用 Gemini 1.5,同样的输出需要花费数千美元。”

这种高性价比与 Gemini 强大的语言理解和生成能力相结合,使其成为开发者构建复杂 AI 代理的理想选择。Silverman 表示:“Gemini 1.5 Flash 能以更低的成本实现与更大的模型相媲美的质量,而且速度非常快。”这样,开发者就可以专注于构建复杂的多步代理工作流,而不必担心成本过高。

“我们看到,使用其他 LLM 提供商的单个代理运行的费用超过了每次运行 500 美元。如果使用 Gemini(1.5 Flash-8B),这些运行的费用不到 50 美元。”

为 AI 代理提供支持

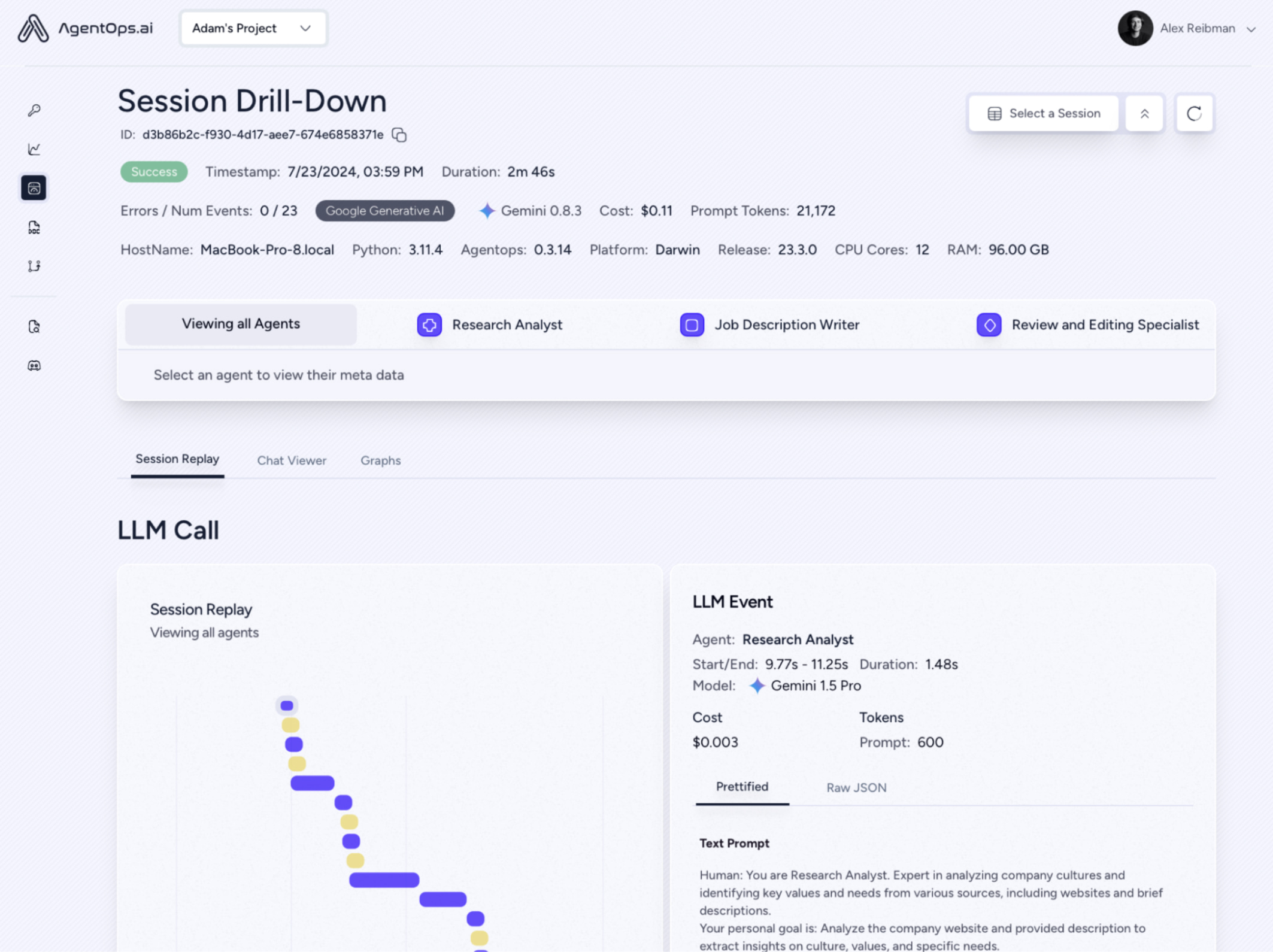

AgentOps 会捕获每次代理互动的数据,而不仅仅是 LLM 调用,从而全面了解多代理系统的运作方式。这种精细的细节对于工程团队和合规团队至关重要,可为调试、优化和审核跟踪提供关键的数据洞见。

将 Gemini 模型与 AgentOps 集成非常简单,通常只需几分钟即可完成(使用 LiteLLM)。开发者可以快速了解其 Gemini API 调用情况、实时跟踪费用,并确保其代理在生产环境中的可靠性。

展望未来

AgentOps 致力于在代理开发者扩展项目时为其提供支持。Agency AI 正在帮助企业应对构建经济实惠且可扩缩的代理的复杂性,进一步巩固将 AgentOps 与 Gemini API 相结合的价值主张。正如 Silverman 所强调的那样,“它正吸引更多注重价格的开发者来构建代理。”

对于考虑使用 Gemini 的开发者,Silverman 的建议很明确:“不妨试一试,你会感到惊喜。”