AI Edge 的 Google Cloud 解決方案,可大規模測試及評估裝置端機器學習 (ML)。

在各種行動裝置上最佳化機器學習模型效能並不容易。手動測試速度緩慢、成本高昂,且大多數開發人員都無法存取,因此實際模型效能往往存在不確定性。Google AI Edge Portal 支援在各種行動裝置上進行 LiteRT 模型基準化測試,協助開發人員找出大規模部署機器學習模型的最佳設定,解決上述問題。

最佳化行動裝置機器學習模型部署作業

簡化並加快各種硬體環境的測試週期: 在幾分鐘內,輕鬆評估數百部代表性行動裝置的模型效能。

主動確保模型品質並及早找出問題:在部署前,找出特定硬體效能變化或迴歸 (例如特定晶片組或記憶體受限的裝置)。

降低裝置測試成本並使用最新硬體:在多樣化的實體裝置上測試 (目前有來自各種 Android OEM 的 100 多種裝置型號),且裝置數量持續增加,不必自行維護實驗室,省下相關費用和複雜程序。

根據資料做出明智決策,並取得實用的業務洞察資料:Google AI Edge Portal 提供豐富的成效資料和比較結果,有助您取得重要的業務洞察資料,放心引導模型最佳化,並驗證部署準備狀態。

基準範例:

Google AI Edge Portal 如何協助您評估 LiteRT 模型

選取裝置:使用特定硬體篩選器 (包括 NPU 支援、裝置層級、品牌、晶片組和 RAM),從我們廣泛的裝置池中選取目標裝置。你也可以使用我們精選的捷徑,立即存取熱門裝置清單。

建立設定:為基準化工作選擇 CPU、GPU 或 NPU 加速器。

進階自訂:調整所選加速器的硬體專屬設定,或繼續使用預設值。

NPU 支援:硬體加速功能現在支援 NPU,包括 30 多款 Qualcomm 裝置。

- 預先 (AOT) 編譯:建議用於正式環境等級的效能,可大幅加快初始化速度,並減少記憶體用量。如要使用這個模式,您必須為所選裝置中的每個獨特 SoC 提供已編譯的模型。

- 即時 (JIT) 編譯:支援在所選裝置上編譯單一模型。

上傳模型:使用 UI 上傳模型檔案,或在 Google Cloud Storage 值區中指向模型檔案。

在 100 部以上的裝置上建立新的基準測試作業。(注意:GIF 經過加速和編輯,以求簡潔)

然後提交工作並等待完成。準備就緒後,即可在互動式資訊主頁中查看結果:

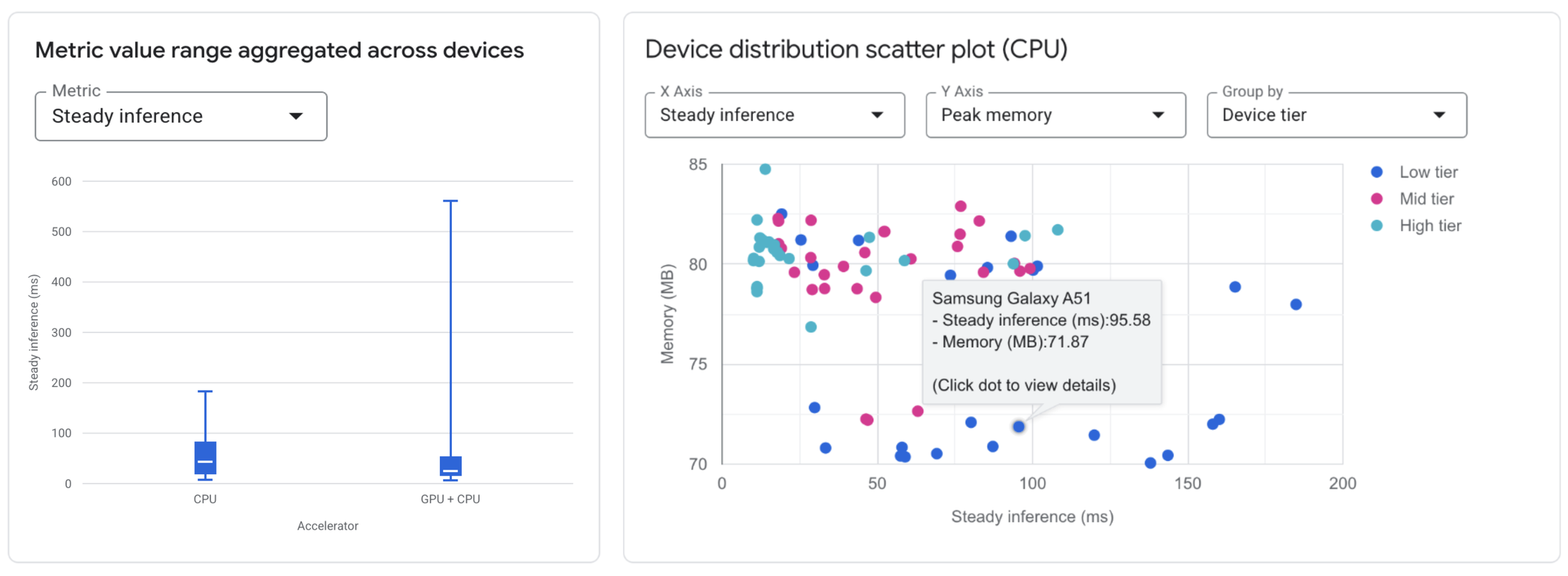

比較設定:快速查看在所有測試裝置上使用不同加速器時,效能指標 (例如平均延遲時間、記憶體用量上限) 的差異。

分析裝置影響:查看特定模型設定在所選裝置範圍內的成效。使用直方圖和散佈圖,快速找出與裝置特徵相關的效能差異。

詳細指標:存取詳細的排序表格,其中顯示每個裝置的特定指標 (初始化時間、推論延遲時間、記憶體用量) 和硬體規格。使用「加速器分配」表格驗證硬體使用率,瞭解模型作業在核心間的分配情形 (適用於 CPU 和 GPU,NPU 支援即將推出)。

在互動式資訊主頁上查看基準測試結果。(注意:為求精簡,GIF 經過加速和編輯)

加入 Google AI Edge Portal 不公開預先發布版

Google AI Edge Portal 目前為不公開預先發布版,僅限已加入許可清單的 Google Cloud 客戶使用。在不公開預先發布期間,我們將依據預先發布條款提供免費存取權。

如果您是使用 LiteRT 建構行動裝置 ML 應用程式的開發人員或團隊,需要各種 Android 硬體的可靠基準化資料,並願意提供意見回饋協助塑造產品的未來,那麼這個預先發布版本就是您的理想選擇。如要申請存取權,請填寫這份註冊表單。透過許可清單授予存取權。