AI Edge 的 Google Cloud 解决方案,用于大规模测试和基准比较设备端机器学习 (ML)。

在各种移动设备上优化机器学习模型性能可能极具挑战性。手动测试速度慢、成本高,而且大多数开发者都无法进行,这会导致实际模型性能存在不确定性。Google AI Edge 门户网站通过在各种移动设备上实现 LiteRT 模型基准比较来解决此问题,帮助开发者找到大规模机器学习模型部署的最佳配置。

优化移动机器学习部署

简化并加快各种硬件环境中的测试周期:在几分钟内轻松评估模型在数百种代表性移动设备上的性能。

主动确保模型质量并尽早发现问题:在部署之前,准确找出特定于硬件的性能变化或回归(例如在特定芯片组或内存受限的设备上)。

降低设备测试成本并使用最新硬件:在不断壮大的各种实体设备群(目前有来自各种 Android OEM 的 100 多种设备型号)上进行测试,而无需承担维护自有实验室的费用和复杂性。

发掘强大的数据驱动型决策和商业智能:Google AI Edge 门户网站提供丰富的性能数据和比较结果,可提供关键的商业智能,帮助您自信地指导模型优化并验证部署准备情况。

基准示例:

Google AI Edge Portal 如何帮助您对 LiteRT 模型进行基准比较

选择设备:使用特定的硬件过滤条件(包括 NPU 支持、设备层级、品牌、芯片组和 RAM)从我们庞大的设备池中选择目标设备。或者,您也可以使用我们精选的快捷方式,以便快速访问热门设备列表。

创建配置:为基准比较任务选择 CPU、GPU 或 NPU 加速器。

高级自定义:调整所选加速器的硬件专用设置,或继续使用默认值。

NPU 支持:硬件加速功能现在包括 NPU,支持 30 多款 Qualcomm 设备。

- 预先 (AOT) 编译:建议用于生产级性能,可显著加快初始化速度并减少内存占用。此模式要求为所选设备中的每个唯一 SoC 提供已编译的模型。

- 即时 (JIT) 编译:支持在所选设备上编译单个模型。

上传模型:使用界面上传模型文件,或在 Google Cloud Storage 存储分区中指向该文件。

在 100 多部设备上创建新的基准测试作业。(注意:GIF 经过加速和编辑,以求简洁)

然后,提交作业并等待完成。准备就绪后,在互动式信息中心内探索结果:

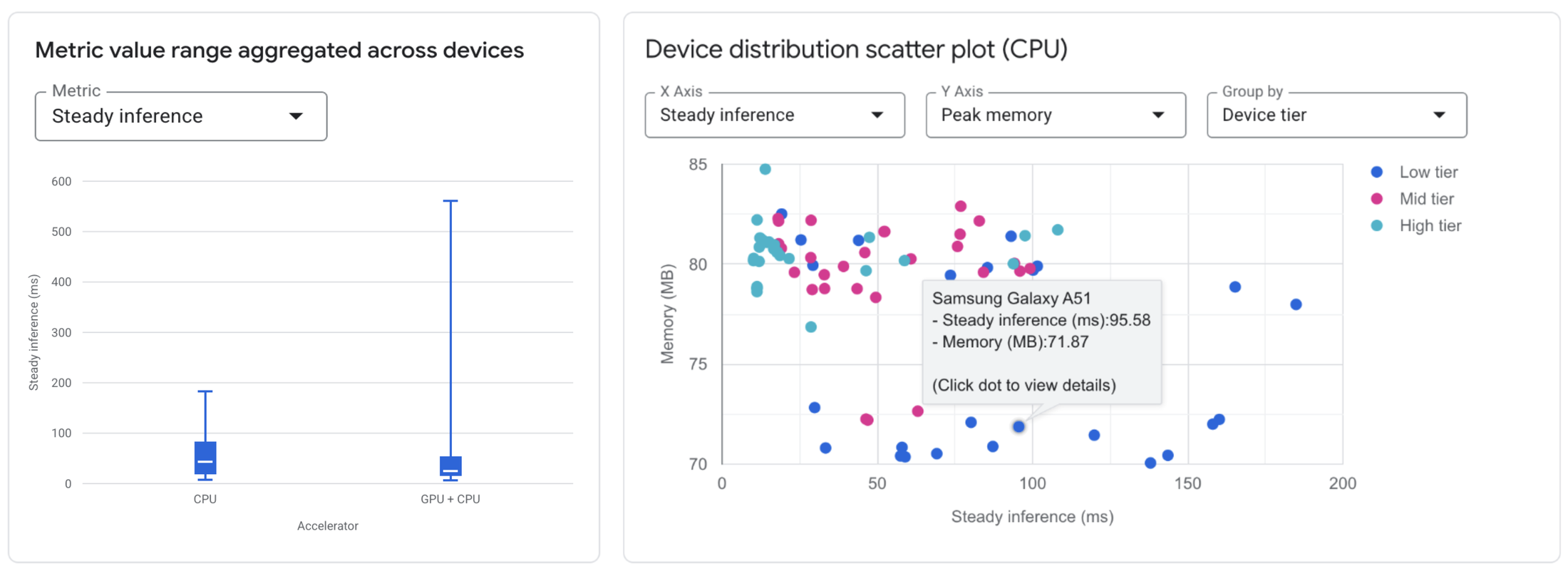

比较配置:直观地了解在所有测试设备上使用不同加速器时,性能指标(例如平均延迟时间、峰值内存)有何不同。

分析设备影响:了解特定模型配置在所选设备范围内的表现。使用直方图和散点图快速识别与设备特征相关的性能变化。

详细指标:访问详细的可排序表格,其中显示了每部设备的具体指标(初始化时间、推理延迟时间、内存用量)及其硬件规格。通过“加速器分配”表格验证硬件利用率,该表格显示了模型操作在内核中的分布情况(适用于 CPU 和 GPU,即将支持 NPU)。

在交互式信息中心内查看基准结果。(注意:GIF 经过加速和编辑,以求简洁)

加入 Google AI Edge Portal 非公开预览计划

Google AI Edge Portal 目前处于非公开预览阶段,仅面向已列入许可名单的 Google Cloud 客户开放。在此非公开预览版期间,您可以免费使用此功能,但需遵守预览版条款。

此预览版非常适合以下开发者和团队:使用 LiteRT 构建移动机器学习应用,需要各种 Android 硬件上的可靠基准比较数据,并愿意提供反馈来帮助塑造产品的未来。如需申请访问权限,请点击此处填写报名表单,表达您的意向。通过许可名单授予访问权限。