Solução do Google Cloud da AI Edge para testes e comparativos de aprendizado de máquina (ML) no dispositivo em grande escala.

Otimizar a performance de modelos de ML em diversos dispositivos móveis pode ser um desafio. O teste manual é lento, caro e geralmente inacessível para a maioria dos desenvolvedores, o que gera incertezas no desempenho do modelo no mundo real. O portal do Google AI Edge resolve isso ativando a comparativa de modelos do LiteRT em uma ampla variedade de dispositivos móveis, ajudando os desenvolvedores a encontrar as melhores configurações para a implantação de modelos de ML em grande escala.

Otimizar a implantação de ML em dispositivos móveis

Simplifique e acelere os ciclos de teste em todo o cenário de hardware diversificado: avalie sem esforço a performance do modelo em centenas de dispositivos móveis representativos em minutos.

Garanta a qualidade do modelo de maneira proativa e identifique problemas com antecedência: detecte variações ou regressões de desempenho específicas do hardware (como em chipsets ou dispositivos com restrição de memória) antes da implantação.

Reduza o custo de teste de dispositivos e acesse o hardware mais recente: teste em uma frota diversificada e em constante crescimento de dispositivos físicos (atualmente, mais de 100 modelos de dispositivos de vários OEMs Android) sem o custo e a complexidade de manter seu próprio laboratório.

Tome decisões eficientes com base em dados e Business Intelligence: o portal do Google AI Edge oferece dados de performance e comparações avançados, fornecendo o Business Intelligence crucial necessário para orientar com confiança a otimização do modelo e validar a prontidão para implantação.

Exemplo de comparativo de mercado:

Como o portal do Google AI Edge ajuda você a comparar seus modelos do LiteRT

Selecionar dispositivos: escolha seus dispositivos de destino no nosso amplo conjunto usando filtros de hardware específicos, incluindo suporte a NPU, nível do dispositivo, marca, chipset e RAM. Ou use nossos atalhos selecionados para acessar instantaneamente as listas de dispositivos mais usadas.

Criar configurações: escolha entre aceleradores de CPU, GPU ou NPU para suas tarefas de comparativo de mercado.

Personalização avançada: ajuste as configurações específicas do hardware para o acelerador selecionado ou continue com os valores padrão.

Suporte a NPU: os recursos de aceleração de hardware agora incluem NPUs, com uma frota de mais de 30 dispositivos Qualcomm.

- Compilação Ahead-Of-Time (AOT): recomendada para desempenho em nível de produção, oferecendo inicialização significativamente mais rápida e um menor consumo de memória. Esse modo exige que você forneça modelos compilados para cada SoC exclusivo na seleção de dispositivos.

- Compilação just-in-time (JIT): oferece suporte a um único modelo para compilação em dispositivos selecionados.

Fazer upload de modelos: envie o arquivo modelo usando a interface ou aponte para ele no bucket do Google Cloud Storage.

Crie um novo job de comparativo em mais de 100 dispositivos. (Observação: o GIF foi acelerado e editado para ser mais breve)

Envie o job e aguarde a conclusão. Quando tudo estiver pronto, analise os resultados no painel interativo:

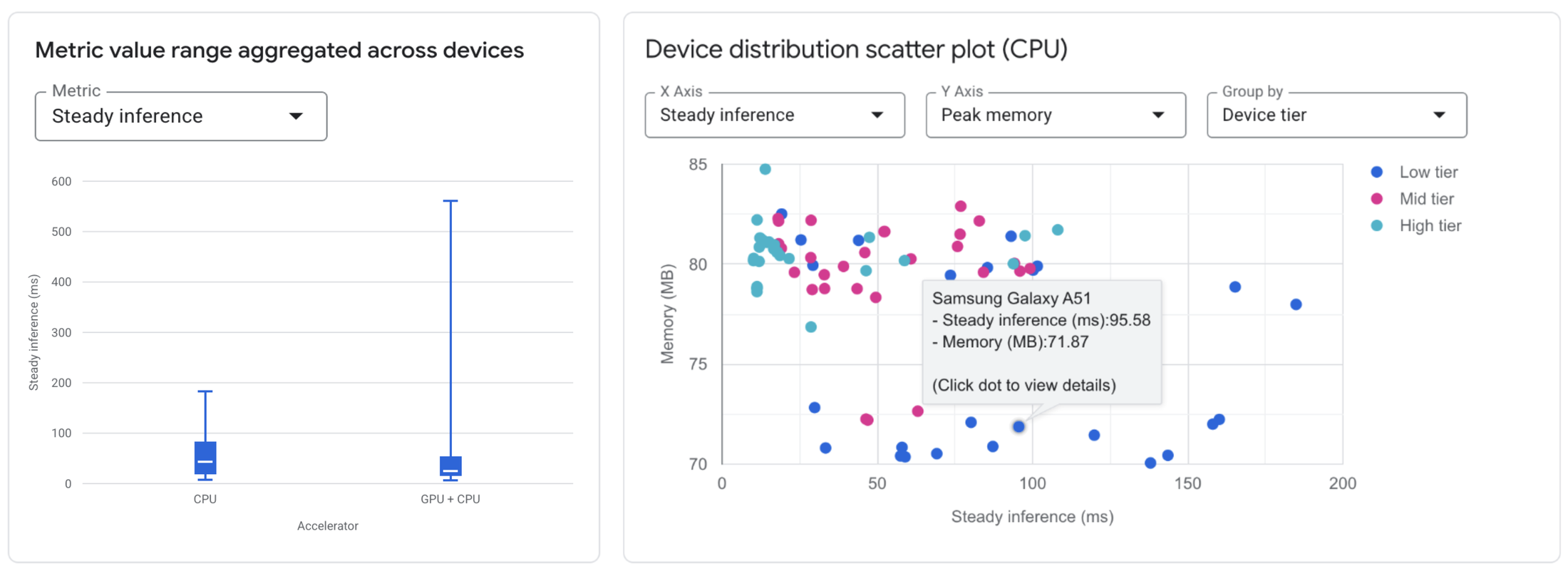

Comparar configurações: visualize rapidamente como as métricas de desempenho (por exemplo, latência média, pico de memória) mudam ao usar diferentes aceleradores em todos os dispositivos testados.

Analisar o impacto do dispositivo: veja como uma configuração de modelo específica funciona em toda a variedade de dispositivos selecionados. Use histogramas e diagramas de dispersão para identificar rapidamente variações de performance relacionadas às características do dispositivo.

Métricas detalhadas: acesse uma tabela detalhada e classificável que mostra métricas específicas (tempo de inicialização, latência de inferência, uso da memória) para cada dispositivo individual, além das especificações de hardware. Verifique a utilização do hardware com a tabela "Alocação de aceleradores", que mostra como as operações de modelo são distribuídas entre os kernels (disponível para CPU e GPU, com suporte a NPU em breve).

Confira os resultados do comparativo de mercado no painel interativo. (Observação: o GIF foi acelerado e editado para ser mais breve)

Participe do pré-lançamento particular do Google AI Edge Portal

O Google AI Edge Portal está disponível em prévia particular para clientes do Google Cloud na lista de permissões. Durante esse período de prévia particular, o acesso é fornecido sem custo financeiro, sujeito aos termos da prévia.

Essa prévia é ideal para desenvolvedores e equipes que criam aplicativos de ML para dispositivos móveis com o LiteRT e precisam de dados de comparativo de mercado confiáveis em diversos hardwares Android e querem dar feedback para ajudar a moldar o futuro do produto. Para solicitar acesso, preencha o formulário de inscrição aqui e mostre seu interesse. O acesso é concedido por uma lista de permissões.