Solution Google Cloud d'AI Edge pour tester et comparer le machine learning (ML) sur l'appareil à grande échelle.

Il peut être difficile d'optimiser les performances des modèles de ML sur différents appareils mobiles. Les tests manuels sont lents, coûteux et souvent inaccessibles à la plupart des développeurs, ce qui entraîne des incertitudes quant aux performances réelles des modèles. Le portail Google AI Edge résout ce problème en permettant le benchmarking des modèles LiteRT sur un large éventail d'appareils mobiles, ce qui aide les développeurs à trouver les meilleures configurations pour le déploiement de modèles de ML à grande échelle.

Optimiser le déploiement du ML mobile

Simplifiez et accélérez les cycles de test sur différents types de matériel : Évaluez facilement les performances des modèles sur des centaines d'appareils mobiles représentatifs en quelques minutes.

Assurez-vous de la qualité des modèles de manière proactive et identifiez les problèmes rapidement : identifiez les variations ou régressions de performances spécifiques au matériel (par exemple, sur des chipsets ou des appareils à mémoire limitée) avant le déploiement.

Réduisez les coûts de test des appareils et accédez aux derniers matériels : testez votre application sur une flotte variée et en constante expansion d'appareils physiques (actuellement plus de 100 modèles d'appareils de différents OEM Android) sans les dépenses et la complexité liées à la gestion de votre propre laboratoire.

Prenez des décisions efficaces basées sur les données et l'informatique décisionnelle : le portail Google AI Edge fournit des données et des comparaisons détaillées sur les performances. Il offre ainsi l'informatique décisionnelle essentielle pour optimiser les modèles en toute confiance et valider leur préparation au déploiement.

Exemple de benchmark :

Comment le portail Google AI Edge vous aide à comparer vos modèles LiteRT

Sélectionnez des appareils : sélectionnez vos appareils cibles dans notre vaste pool à l'aide de filtres matériels spécifiques, y compris la prise en charge de l'unité de traitement neuronal (NPU), le niveau de l'appareil, la marque, le chipset et la RAM. Vous pouvez également utiliser nos raccourcis pour accéder instantanément aux listes d'appareils populaires.

Créer des configurations : choisissez entre les accélérateurs CPU, GPU ou NPU pour vos tâches de benchmarking.

Personnalisation avancée : ajustez les paramètres spécifiques au matériel pour l'accélérateur sélectionné ou utilisez les valeurs par défaut.

Prise en charge des NPU : les fonctionnalités d'accélération matérielle incluent désormais les NPU, avec une flotte de plus de 30 appareils Qualcomm.

- Compilation Ahead-Of-Time (AOT) : recommandée pour les performances de niveau production, elle offre une initialisation beaucoup plus rapide et une empreinte mémoire plus faible. Ce mode nécessite de fournir des modèles compilés pour chaque SoC unique de votre sélection d'appareils.

- Compilation juste-à-temps (JIT) : compatible avec un seul modèle pour la compilation sur les appareils sélectionnés.

Importer des modèles : importez votre fichier de modèle à l'aide de l'interface utilisateur ou pointez vers celui-ci dans votre bucket Google Cloud Storage.

Créez un job de benchmark sur plus de 100 appareils. (Remarque : Le GIF est accéléré et modifié pour plus de concision.)

Ensuite, envoyez votre job et attendez qu'il soit terminé. Une fois les résultats prêts, explorez-les dans le tableau de bord interactif :

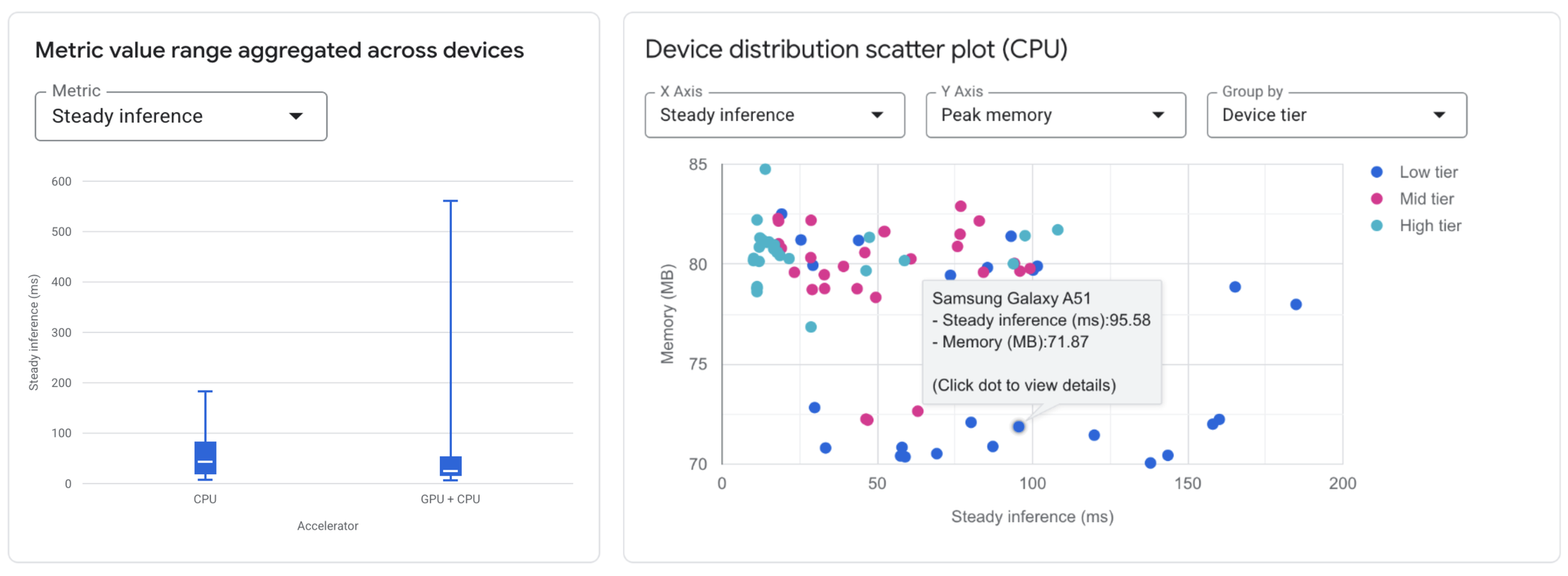

Comparer les configurations : visualisez rapidement les différences entre les métriques de performances (par exemple, la latence moyenne et la mémoire maximale) lorsque vous utilisez différents accélérateurs sur tous les appareils testés.

Analyser l'impact sur les appareils : découvrez les performances d'une configuration de modèle spécifique sur la gamme d'appareils sélectionnés. Utilisez des histogrammes et des graphiques de dispersion pour identifier rapidement les variations de performances liées aux caractéristiques des appareils.

Métriques détaillées : accédez à un tableau détaillé et triable affichant des métriques spécifiques (temps d'initialisation, latence d'inférence, utilisation de la mémoire) pour chaque appareil, ainsi que ses caractéristiques matérielles. Vérifiez l'utilisation du matériel avec le tableau "Attribution d'accélérateurs", qui indique comment les opérations de modèle sont distribuées entre les noyaux (disponible pour le CPU et le GPU, avec la prise en charge du NPU bientôt disponible).

Affichez les résultats du benchmark dans le tableau de bord interactif. (Remarque : Le GIF est accéléré et modifié pour plus de concision.)

Participer à la preview privée de Google AI Edge Portal

Le portail Google AI Edge est disponible en aperçu privé pour les clients Google Cloud ajoutés à la liste d'autorisation. Pendant cette période de preview privée, l'accès est fourni sans frais, sous réserve des conditions de la preview.

Cet aperçu est idéal pour les développeurs et les équipes qui créent des applications de ML mobiles avec LiteRT et qui ont besoin de données de benchmarking fiables sur différents matériels Android. Il s'adresse également à ceux qui sont prêts à fournir des commentaires pour façonner l'avenir du produit. Pour demander l'accès, remplissez ce formulaire d'inscription. L'accès est accordé par le biais d'une liste d'autorisation.