オンデバイス ML を大規模にテストしてベンチマーク評価するための AI Edge の Google Cloud ソリューション。

さまざまなモバイル デバイスで ML モデルのパフォーマンスを最適化することは難しい場合があります。手動テストは時間がかかり、費用もかさむため、ほとんどのデベロッパーにとっては現実的ではありません。そのため、実際のモデルのパフォーマンスには不確実性が生じます。Google AI Edge Portal は、幅広いモバイル デバイスで LiteRT モデルのベンチマーク評価を可能にすることで、この問題を解決します。これにより、開発者は ML モデルの大規模なデプロイに最適な構成を見つけることができます。

モバイル ML デプロイの最適化

多様なハードウェア環境でのテストサイクルの簡素化と高速化: 数百種類の代表的なモバイル デバイスでのモデルのパフォーマンスを簡単に評価できます。

モデル品質の事前保証、問題の早期発見: デプロイ前に、ハードウェア固有のパフォーマンスの変動や低下(特定のチップセットやメモリ制約のあるデバイスなど)を特定できます。

デバイステストの費用削減と最新ハードウェアへのアクセス: 自社でラボを維持する費用や手間をかけることなく、実機でテストできます。現在、さまざまな Android OEM の 100 以上のデバイスモデルを用意しており、これからも増えていく予定です。

データドリブンな意思決定とビジネス インテリジェンスの実現: Google AI Edge Portal は、豊富なパフォーマンス データと比較情報を提示し、モデルの最適化と導入準備状況の検証を確実に行うために必要となる重要なビジネス インテリジェンスを提供します。

ベンチマークの例:

Google AI Edge Portal で LiteRT モデルをベンチマーク評価する手順

デバイスを選択する: NPU サポート、デバイスティア、ブランド、チップセット、RAM などの特定のハードウェア フィルタを使用して、広範なプールから対象デバイスを選択します。また、キュレーションされたショートカットを使用すると、人気のデバイスリストにすぐにアクセスできます。

構成を作成: ベンチマーク タスク用に CPU、GPU、NPU のいずれかのアクセラレータを選択します。

高度なカスタマイズ: 選択したアクセラレータのハードウェア固有の設定を調整するか、デフォルト値で続行します。

NPU のサポート: ハードウェア アクセラレーション機能に NPU が追加され、30 以上の Qualcomm デバイスがサポートされるようになりました。

- 事前(AOT)コンパイル: 本番環境レベルのパフォーマンスにおすすめです。初期化が大幅に高速化され、メモリ使用量が削減されます。このモードでは、デバイス選択で選択した一意の SoC ごとにコンパイル済みモデルを提供する必要があります。

- ジャストインタイム(JIT)コンパイル: 選択したデバイス全体でコンパイルする単一のモデルをサポートします。

モデルをアップロードする: UI を使用してモデルファイルをアップロードするか、Google Cloud Storage バケット内のモデルファイルを指定します。

100 台以上のデバイスで新しいベンチマーク ジョブを作成している例(注: 簡潔にするために画像を加工しています)。

その後、ジョブを送信して完了するまで待ちます。完了すると、インタラクティブ ダッシュボードで結果を確認できます。

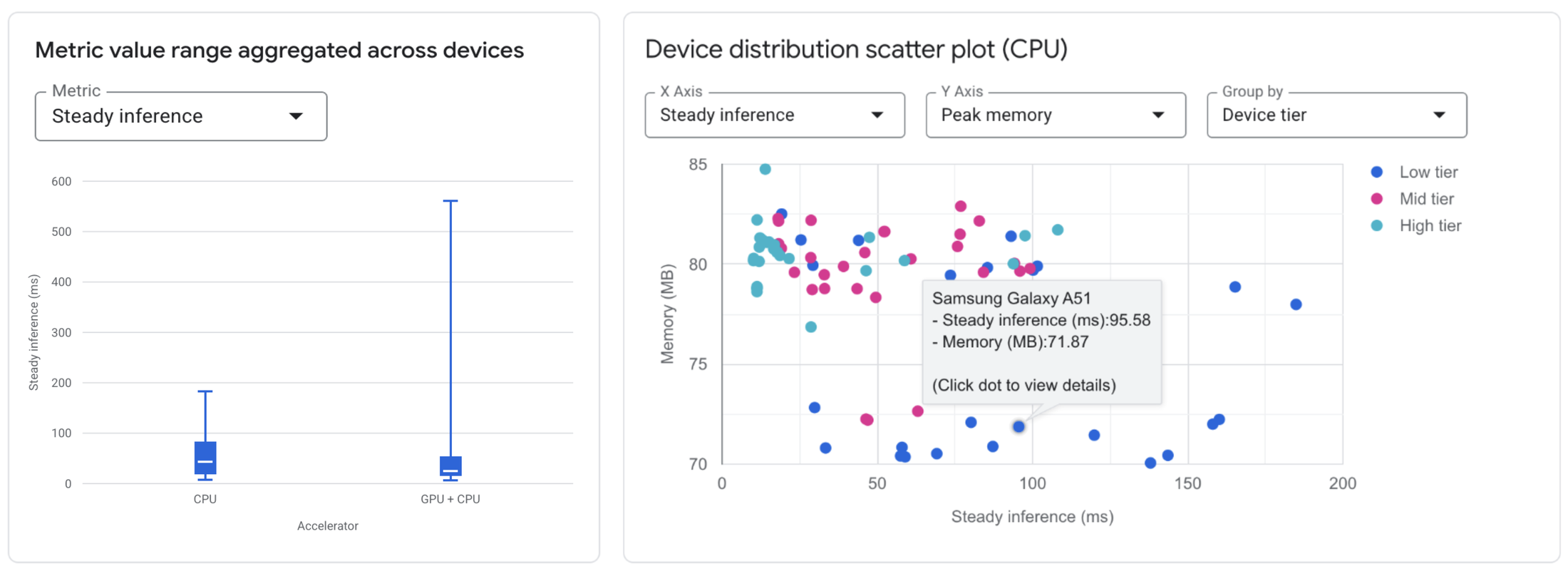

構成を比較する: テストしたすべてのデバイスで、異なるアクセラレータを使用した場合のパフォーマンス指標(平均レイテンシ、ピーク メモリなど)の違いを簡単に可視化できます。

デバイスへの影響を分析する: 選択したさまざまなデバイスで、特定のモデル構成がどのように機能するかを確認できます。ヒストグラムと散布図を使用して、デバイスの特性に関連するパフォーマンスの変動を迅速に特定できます。

詳細な指標: 各デバイスの特定の指標(初期化時間、推論レイテンシ、メモリ使用量)を示すテーブルが表示されます。テーブルにはこれらの詳細な情報とともに、各デバイスのハードウェア仕様も表示され、必要に応じて並べ替えることができます。アクセラレータ割り当てテーブルでハードウェア使用率を確認します。このテーブルには、モデル オペレーションがカーネルにどのように分散されているかが表示されます(CPU と GPU で使用可能。NPU サポートは近日提供予定)。

ベンチマーク結果が表示されているインタラクティブなダッシュボード(注: 簡潔にするために画像を加工しています)。

Google AI Edge Portal の限定公開プレビューにご参加ください

Google AI Edge Portal は、許可リストに登録されている Google Cloud のお客様を対象に限定公開プレビュー版として提供されます。限定公開プレビューの期間中は無料で利用可能で、プレビュー版の利用規約が適用されます。

このプレビュー版は、LiteRT を使用してモバイル ML アプリケーションを構築しており、さまざまな Android ハードウェアにわたる信頼性の高いベンチマーク データを必要としているデベロッパーや開発チームに最適です。また、Google AI Edge Portal の未来の形作っていくために、フィードバックの提供にご協力くださる方が対象となります。アクセスをご希望の場合は、こちらのフォームからお申し込みください。アクセスは許可リストを通じてご提供いたします。