Detektorët e objekteve mund të identifikojnë se cili nga një grup i njohur objektesh mund të jetë i pranishëm dhe të japin informacion në lidhje me pozicionet e tyre brenda imazhit të dhënë ose një transmetimi video. Një detektor objektesh është i trajnuar për të zbuluar praninë dhe vendndodhjen e klasave të shumta të objekteve. Për shembull, një model mund të trajnohet me imazhe që përmbajnë copa të ndryshme frutash, së bashku me një etiketë që specifikon klasën e frutave që ato përfaqësojnë (p.sh. një mollë, një banane ose një luleshtrydhe), dhe të dhëna që specifikojnë se ku shfaqet secili objekt në imazh. Shihni shembullin e zbulimit të objekteve për më shumë informacion në lidhje me detektorët e objekteve.

Përdorni API-n e ObjectDetector të Bibliotekës së Detyrave për të vendosur detektorët tuaj të personalizuar të objekteve ose ata të parapërgatitur në aplikacionet tuaja mobile.

Karakteristikat kryesore të API-t ObjectDetector

Përpunimi i imazhit hyrës, duke përfshirë rrotullimin, ndryshimin e madhësisë dhe konvertimin e hapësirës së ngjyrave.

Etiketo vendndodhjen e hartës.

Pragu i pikëve për të filtruar rezultatet.

Rezultatet e zbulimit Top-k.

Etiketo listën e lejimeve dhe listën e mohimeve.

Modelet e mbështetura të detektorëve të objekteve

Modelet e mëposhtme garantohen të jenë të pajtueshme me API-n ObjectDetector .

Modelet e para-trajnuara të zbulimit të objekteve në TensorFlow Hub .

Modele të krijuara nga AutoML Vision Edge Object Detection .

Modele të krijuara nga TensorFlow Lite Model Maker për detektor objektesh .

Modele të personalizuara që plotësojnë kërkesat e përputhshmërisë së modelit .

Ekzekutoni përfundimin në Java

Shihni aplikacionin referues të Zbulimit të Objekteve për një shembull se si të përdorni ObjectDetector në një aplikacion Android.

Hapi 1: Importoni varësinë e Gradle dhe cilësimet e tjera

Kopjoni skedarin e modelit .tflite në direktorinë e aseteve të modulit Android ku do të ekzekutohet modeli. Specifikoni që skedari nuk duhet të kompresohet dhe shtoni bibliotekën TensorFlow Lite në skedarin build.gradle të modulit:

android {

// Other settings

// Specify tflite file should not be compressed for the app apk

aaptOptions {

noCompress "tflite"

}

}

dependencies {

// Other dependencies

// Import the Task Vision Library dependency

implementation 'org.tensorflow:tensorflow-lite-task-vision'

// Import the GPU delegate plugin Library for GPU inference

implementation 'org.tensorflow:tensorflow-lite-gpu-delegate-plugin'

}

Hapi 2: Përdorimi i modelit

// Initialization

ObjectDetectorOptions options =

ObjectDetectorOptions.builder()

.setBaseOptions(BaseOptions.builder().useGpu().build())

.setMaxResults(1)

.build();

ObjectDetector objectDetector =

ObjectDetector.createFromFileAndOptions(

context, modelFile, options);

// Run inference

List<Detection> results = objectDetector.detect(image);

Shihni kodin burimor dhe javadoc për më shumë opsione për të konfiguruar ObjectDetector .

Ekzekutoni përfundimin në iOS

Hapi 1: Instaloni varësitë

Biblioteka e Detyrave mbështet instalimin duke përdorur CocoaPods. Sigurohuni që CocoaPods është instaluar në sistemin tuaj. Ju lutemi shihni udhëzuesin e instalimit të CocoaPods për udhëzime.

Ju lutemi shihni udhëzuesin e CocoaPods për detaje mbi shtimin e pod-eve në një projekt Xcode.

Shtoni pod-in TensorFlowLiteTaskVision në Podfile.

target 'MyAppWithTaskAPI' do

use_frameworks!

pod 'TensorFlowLiteTaskVision'

end

Sigurohuni që modeli .tflite që do të përdorni për nxjerrjen e përfundimeve është i pranishëm në paketën e aplikacionit tuaj.

Hapi 2: Përdorimi i modelit

I shpejtë

// Imports

import TensorFlowLiteTaskVision

// Initialization

guard let modelPath = Bundle.main.path(forResource: "ssd_mobilenet_v1",

ofType: "tflite") else { return }

let options = ObjectDetectorOptions(modelPath: modelPath)

// Configure any additional options:

// options.classificationOptions.maxResults = 3

let detector = try ObjectDetector.detector(options: options)

// Convert the input image to MLImage.

// There are other sources for MLImage. For more details, please see:

// https://developers.google.com/ml-kit/reference/ios/mlimage/api/reference/Classes/GMLImage

guard let image = UIImage (named: "cats_and_dogs.jpg"), let mlImage = MLImage(image: image) else { return }

// Run inference

let detectionResult = try detector.detect(mlImage: mlImage)

Objektivi-C

// Imports

#import <TensorFlowLiteTaskVision/TensorFlowLiteTaskVision.h>

// Initialization

NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"ssd_mobilenet_v1" ofType:@"tflite"];

TFLObjectDetectorOptions *options = [[TFLObjectDetectorOptions alloc] initWithModelPath:modelPath];

// Configure any additional options:

// options.classificationOptions.maxResults = 3;

TFLObjectDetector *detector = [TFLObjectDetector objectDetectorWithOptions:options

error:nil];

// Convert the input image to MLImage.

UIImage *image = [UIImage imageNamed:@"dogs.jpg"];

// There are other sources for GMLImage. For more details, please see:

// https://developers.google.com/ml-kit/reference/ios/mlimage/api/reference/Classes/GMLImage

GMLImage *gmlImage = [[GMLImage alloc] initWithImage:image];

// Run inference

TFLDetectionResult *detectionResult = [detector detectWithGMLImage:gmlImage error:nil];

Shihni kodin burimor për më shumë opsione për të konfiguruar TFLObjectDetector .

Ekzekutoni përfundimin në Python

Hapi 1: Instaloni paketën pip

pip install tflite-support

Hapi 2: Përdorimi i modelit

# Imports

from tflite_support.task import vision

from tflite_support.task import core

from tflite_support.task import processor

# Initialization

base_options = core.BaseOptions(file_name=model_path)

detection_options = processor.DetectionOptions(max_results=2)

options = vision.ObjectDetectorOptions(base_options=base_options, detection_options=detection_options)

detector = vision.ObjectDetector.create_from_options(options)

# Alternatively, you can create an object detector in the following manner:

# detector = vision.ObjectDetector.create_from_file(model_path)

# Run inference

image = vision.TensorImage.create_from_file(image_path)

detection_result = detector.detect(image)

Shihni kodin burimor për më shumë opsione për të konfiguruar ObjectDetector .

Ekzekutoni përfundimin në C++

// Initialization

ObjectDetectorOptions options;

options.mutable_base_options()->mutable_model_file()->set_file_name(model_path);

std::unique_ptr<ObjectDetector> object_detector = ObjectDetector::CreateFromOptions(options).value();

// Create input frame_buffer from your inputs, `image_data` and `image_dimension`.

// See more information here: tensorflow_lite_support/cc/task/vision/utils/frame_buffer_common_utils.h

std::unique_ptr<FrameBuffer> frame_buffer = CreateFromRgbRawBuffer(

image_data, image_dimension);

// Run inference

const DetectionResult result = object_detector->Detect(*frame_buffer).value();

Shihni kodin burimor për më shumë opsione për të konfiguruar ObjectDetector .

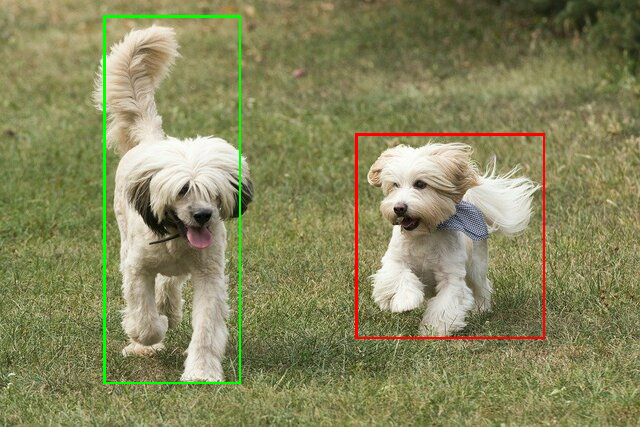

Rezultatet e shembujve

Ja një shembull i rezultateve të zbulimit të ssd mobilenet v1 nga TensorFlow Hub.

Results:

Detection #0 (red):

Box: (x: 355, y: 133, w: 190, h: 206)

Top-1 class:

index : 17

score : 0.73828

class name : dog

Detection #1 (green):

Box: (x: 103, y: 15, w: 138, h: 369)

Top-1 class:

index : 17

score : 0.73047

class name : dog

Renderoni kutitë kufizuese në imazhin hyrës:

Provoni mjetin e thjeshtë demo CLI për ObjectDetector me modelin tuaj dhe të dhënat e testimit.

Kërkesat e përputhshmërisë së modelit

API-ja e ObjectDetector pret një model TFLite me Metadata të Modelit TFLite të detyrueshme. Shihni shembuj të krijimit të metadatave për detektorët e objekteve duke përdorur API-në e Shkruesit të Metadatave TensorFlow Lite .

Modelet e pajtueshme të detektorëve të objekteve duhet të plotësojnë kërkesat e mëposhtme:

Tensori i imazhit të hyrjes: (kTfLiteUInt8/kTfLiteFloat32)

- madhësia e hyrjes së imazhit

[batch x height x width x channels]. - Përfundimi i grupit nuk mbështetet (

batchduhet të jetë 1). - Mbështeten vetëm hyrjet RGB (

channelsduhet të jenë 3). - Nëse lloji është kTfLiteFloat32, NormalizationOptions duhet t'i bashkëngjiten meta të dhënave për normalizimin e hyrjes.

- madhësia e hyrjes së imazhit

Tensorët e daljes duhet të jenë 4 daljet e një

DetectionPostProcess, dmth:- Tensori i vendndodhjeve (kTfLiteFloat32)

- tensor me madhësi

[1 x num_results x 4], vargu i brendshëm që përfaqëson kutitë kufizuese në formën [sipër, majtas, djathtas, poshtë]. - BoundingBoxProperties duhet t'i bashkëngjiten meta të dhënave dhe duhet të specifikojnë

type=BOUNDARIESdhe `coordinate_type=RATIO. Tensori i klasave (kTfLiteFloat32)

tenzor me madhësi

[1 x num_results], ku secila vlerë përfaqëson indeksin e numrit të plotë të një klase.Hartat opsionale (por të rekomanduara) të etiketave mund të bashkëngjiten si AssociatedFile-s me llojin TENSOR_VALUE_LABELS, që përmbajnë një etiketë për rresht. Shihni shembullin e skedarit të etiketës . AssociatedFile i parë i tillë (nëse ka) përdoret për të mbushur fushën

class_nametë rezultateve. Fushadisplay_nameplotësohet nga AssociatedFile (nëse ka) lokalizimi i të cilit përputhet me fushëndisplay_names_localetëObjectDetectorOptionstë përdorur në kohën e krijimit ("en" si parazgjedhje, dmth. Anglisht). Nëse asnjëra prej këtyre nuk është e disponueshme, vetëm fusha eindextë rezultateve do të plotësohet.Tensori i rezultateve (kTfLiteFloat32)

tenzor me madhësi

[1 x num_results], ku secila vlerë përfaqëson rezultatin e objektit të zbuluar.Numri i tensorit të zbulimit (kTfLiteFloat32)

numër i plotë num_results si një tenzor me madhësi

[1].