Ndërtuar mbi themelin e testuar në beteja të TensorFlow Lite

LiteRT nuk është thjesht i ri; është gjenerata e ardhshme e kohës së të mësuarit automatik (machine learning runtime) më të përhapur në botë. Ai fuqizon aplikacionet që përdorni çdo ditë, duke ofruar vonesë të ulët dhe privatësi të lartë në miliarda pajisje.

I besuar nga aplikacionet më të rëndësishme të Google

Mbi 100 mijë aplikacione, miliarda përdorues globalë

Pikat kryesore të LiteRT

Gati për platforma të ndryshme

Çliro GenAI

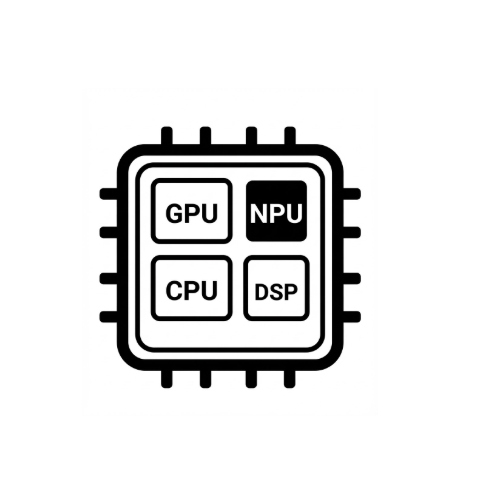

Përshpejtimi i thjeshtuar i harduerit

Mbështetje për shumë korniza

Vendose nëpërmjet LiteRT

Përmirësoni rrjedhën e punës së të mësuarit të thellë nga trajnimi deri te vendosja në pajisje.

1. Merrni një model

Përdorni modele të para-trajnuara .tflite ose konvertoni modelet PyTorch, JAX ose TensorFlow në .tflite.

2. Optimizo

Përdorni mjetet e optimizimit LiteRT për të kuantizuar modelet tuaja pas trajnimit.

3. Vraponi

Vendosni modelin tuaj me LiteRT dhe zgjidhni përshpejtuesin optimal për aplikacionin tuaj.

Zgjidhni Rrugën Tuaj të Zhvillimit

Përdorni LiteRT për të vendosur inteligjencën artificiale kudo - nga aplikacionet celulare me performancë të lartë deri te pajisjet IoT me burime të kufizuara.

Përdorues ekzistues i TFLite

Kalimi në LiteRT për të shfrytëzuar performancën e përmirësuar dhe API-të e unifikuara në të gjitha platformat (Android, Desktop, Web).

BYOM: Sillni modelet tuaja

Kam një model PyTorch, që kërkon të zbatojë përvoja vizuale ose audio në pajisje.

Vendosja e modeleve gjeneruese të inteligjencës artificiale

Krijimi i chatbot-eve të sofistikuar në pajisje duke përdorur modele të optimizuara GenAI me peshë të hapur si Gemma ose një model tjetër me peshë të hapur.

[I Avancuar] Ekspert i Modelit

Krijimi i modeleve të personalizuara ose kryerja e optimizimeve të thella të CPU/GPU/NPU specifike për harduerin për performancë maksimale.

Mostrat, modelet dhe demonstrimet

Shihni shembullin e aplikacionit LiteRT në GitHub

Aplikacione shembullore të plota, nga fillimi në fund.

Shihni modelet e gjeneratës së inteligjencës artificiale

Modele të Inteligjencës Artificiale të Gjeneratës, të para-trajnuara dhe të gatshme për përdorim.

Shihni demo - Aplikacioni Google AI Edge Gallery

Një galeri që shfaq raste përdorimi të ML/GenAI në pajisje duke përdorur LiteRT.

Blogje dhe Njoftime

Qëndroni të azhurnuar me njoftimet më të fundit, analizat e thella teknike dhe standardet e performancës nga ekipi i LiteRT.

LiteRT: Korniza universale për AI në pajisje

Korniza e unifikuar e ML në pajisje e Google, që evoluon nga TFLite për vendosje me performancë të lartë.

MediaTek NPU dhe LiteRT: Fuqizimi i gjeneratës së ardhshme të inteligjencës artificiale në pajisje

Zgjerimi i mbështetjes për përshpejtimin e NPU-së në çipet MediaTek për inteligjencë artificiale me efikasitet të lartë.

Zhbllokimi i Performancës Maksimale në NPU-në e Qualcomm me LiteRT

Zhbllokimi i performancës revolucionare për IA gjeneruese në Njësitë e Përpunimit Neural të Qualcomm.

LiteRT: Performanca maksimale, e thjeshtuar

Prezantimi i API-t CompiledModel për përzgjedhjen e automatizuar të pajisjeve dhe ekzekutimin asinkron.

GenAI në pajisje në Chrome, Chromebook Plus dhe Pixel Watch me LiteRT-LM

Vendosni modele gjuhësore në pajisje që vishen dhe platforma të bazuara në shfletues duke përdorur LiteRT-LM.

Modelet e vogla të gjuhës Google AI Edge, multimodaliteti dhe thirrja e funksioneve

Njohuritë më të fundit mbi RAG, multimodalitetin dhe thirrjen e funksioneve për modelet e gjuhës edge

Bashkohuni me Komunitetin

Komuniteti LiteRT GitHub

Kontribuoni drejtpërdrejt në projekt dhe bashkëpunoni me zhvilluesit kryesorë.

Hugging Face Humbing Face Hub

Qasuni në modele të optimizuara me peshë të hapur në Hugging Face Hub.