نشر الذكاء الاصطناعي على مستوى التطبيقات المتوافقة مع الأجهزة الجوّالة والويب والتطبيقات المضمّنة

-

على الجهاز

تقليل وقت الاستجابة العمل بلا اتصال بالإنترنت الحفاظ على خصوصية بياناتك والاحتفاظ بها على الجهاز

-

عبر أنظمة أساسية متعددة

تشغيل النموذج نفسه على Android وiOS والويب والتطبيقات المضمّنة

-

إطارات عمل متعددة

تتوافق مع نماذج JAX وKeras وPyTorch وTensorFlow.

-

حزمة الذكاء الاصطناعي الكاملة للأجهزة الطرفية

الأطر المرنة والحلول الجاهزة وأدوات تسريع الأجهزة

الحلول الجاهزة والأُطر المرنة

واجهات برمجة تطبيقات سهلة الاستخدام للمهام الشائعة للذكاء الاصطناعي

واجهات برمجة تطبيقات متوافقة مع جميع المنصات لتنفيذ المهام الشائعة للذكاء الاصطناعي التوليدي والعناصر المرئية والنصوص والمحتوى الصوتي

البدء في استخدام مهام MediaPipeنشر النماذج المخصّصة على جميع المنصّات

يمكنك تشغيل نماذج JAX وKeras وPyTorch وTensorFlow بأداء عالٍ على أجهزة Android وiOS والويب والأجهزة المضمّنة، وهي محسّنة لتقنيات تعلُّم الآلة التقليدية والذكاء الاصطناعي التوليدي.

بدء استخدام LiteRT

تقصير دورات التطوير باستخدام العروض المرئية

عرض عملية تحويل النموذج من خلال التحويل والتحويل الكمي تصحيح أخطاء نقاط الاتصال من خلال تراكب نتائج معايير الأداء

بدء استخدام "مستكشف النماذج"

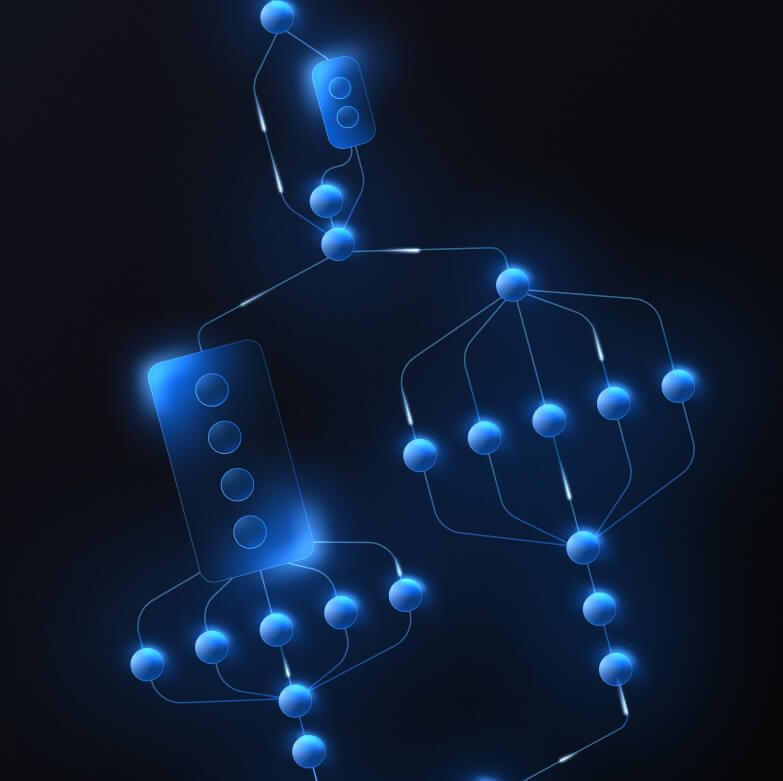

إنشاء مسارات مخصّصة لميزات تعلُّم الآلة المعقّدة

يمكنك إنشاء مهمتك الخاصة من خلال ربط نماذج تعلُّم آلة متعددة بأداء عالٍ مع منطق المعالجة التمهيدية واللاحقة. تشغيل مسارات معالجة مُسرَّعة (باستخدام وحدة معالجة الرسومات ووحدة المعالجة العصبية) بدون حظر وحدة المعالجة المركزية

البدء باستخدام MediaPipe Framework

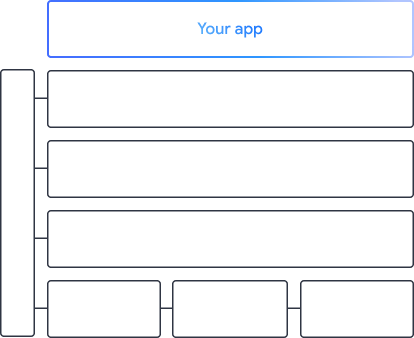

الأدوات وأطر العمل التي تُشغِّل تطبيقات Google

استكشِف حِزمة الذكاء الاصطناعي (AI) الكاملة للأجهزة الطرفية، مع المنتجات على جميع المستويات، بدءًا من واجهات برمجة التطبيقات ذات الرموز البرمجية المنخفضة وصولاً إلى مكتبات التسريع الخاصة بالأجهزة.

MediaPipe Tasks

MediaPipe Tasks

يمكنك إنشاء ميزات الذكاء الاصطناعي بسرعة في تطبيقات الأجهزة الجوّالة والويب باستخدام واجهات برمجة التطبيقات التي تستخدم رمزًا برمجيًا بسيطًا للمهام الشائعة التي تشمل الذكاء الاصطناعي التوليدي وأدوات الرؤية الحاسوبية والنصوص والمحتوى الصوتي.

الذكاء الاصطناعي التوليدي

يمكنك دمج نماذج اللغة والصور التوليدية مباشرةً في تطبيقاتك باستخدام واجهات برمجة تطبيقات جاهزة للاستخدام.

البصر

استكشِف مجموعة كبيرة من مهام الرؤية التي تشمل التقسيم والتصنيف والاكتشاف والتعرّف على معالم الجسم.

النص والصوت

تصنيف النصوص والمحتوى الصوتي ضمن العديد من الفئات، بما في ذلك اللغة والمشاعر والفئات المخصّصة

البدء

إطار عمل MediaPipe

إطار عمل MediaPipe

إطار عمل من المستوى الأدنى يُستخدَم لإنشاء مسارات تعلُّم آلة سريعة وعالية الأداء، وغالبًا ما تتضمّن نماذج تعلُّم آلة متعددة مع المعالجة قبل وبعد.

LiteRT

LiteRT

يمكنك نشر نماذج الذكاء الاصطناعي التي تم إنشاؤها في أي إطار عمل على الأجهزة الجوّالة والويب ووحدات التحكّم الصغيرة باستخدام ميزة تسريع محسّن للأجهزة.

إطارات عمل متعددة

تحويل النماذج من JAX وKeras وPyTorch وTensorFlow لتشغيلها على الأجهزة الطرفية

عبر أنظمة أساسية متعددة

يمكنك تشغيل النموذج نفسه على أجهزة Android وiOS والويب وأجهزة التحكم الدقيقة باستخدام حِزم تطوير البرامج (SDK) الأصلية.

خفيفة وسريعة

لا تستهلك بيئة التشغيل الفعّالة في LiteRT سوى بضعة ميغابايت، كما تتيح تسريع النموذج على مستوى وحدة المعالجة المركزية ووحدة معالجة الرسومات ووحدات المعالجة العصبية.

البدء

مستكشف النماذج

مستكشف النماذج

استكشاف النماذج وإزالة الأخطاء فيها ومقارنتها بشكل مرئي يمكنك عرض مقاييس الأداء والأرقام الرقمية لتحديد نقاط الذروة التي تواجه مشاكل.

Gemini Nano في Android وChrome

إنشاء تجارب الذكاء الاصطناعي التوليدي باستخدام أقوى نموذج على الجهاز من Google