ติดตั้งใช้งาน AI ในแอปพลิเคชันบนอุปกรณ์เคลื่อนที่ เว็บ และแอปพลิเคชันที่ฝัง

-

ในอุปกรณ์

ลดเวลาในการตอบสนอง ทำงานแบบออฟไลน์ เก็บข้อมูลไว้ในเครื่องและเก็บไว้เป็นส่วนตัว

-

ข้ามแพลตฟอร์ม

เรียกใช้รูปแบบเดียวกันใน Android, iOS, เว็บ และแบบฝัง

-

หลายเฟรมเวิร์ก

ใช้ได้กับโมเดล JAX, Keras, PyTorch และ TensorFlow

-

สแต็ก AI Edge แบบสมบูรณ์

เฟรมเวิร์กแบบยืดหยุ่น โซลูชันแบบสําเร็จรูป โปรแกรมเร่งฮาร์ดแวร์

โซลูชันสำเร็จรูปและเฟรมเวิร์กที่มีความยืดหยุ่น

API แบบเขียนโค้ดน้อยสำหรับงานทั่วไปของ AI

API แบบข้ามแพลตฟอร์มเพื่อจัดการงานทั่วไปของ Generative AI, การมองเห็น, ข้อความ และเสียง

เริ่มต้นใช้งาน Tasks ของ MediaPipeติดตั้งใช้งานโมเดลที่กําหนดเองข้ามแพลตฟอร์ม

เรียกใช้โมเดล JAX, Keras, PyTorch และ TensorFlow ได้อย่างมีประสิทธิภาพบน Android, iOS, เว็บ และอุปกรณ์แบบฝัง ซึ่งเพิ่มประสิทธิภาพสำหรับ ML แบบดั้งเดิมและ Generative AI

เริ่มต้นใช้งาน LiteRT

ย่นวงจรการพัฒนาด้วยการแสดงข้อมูลผ่านภาพ

แสดงภาพการเปลี่ยนแปลงของโมเดลผ่านการเปลี่ยนรูปแบบและการแปลงค่า แก้ไขข้อบกพร่องของจุดสำคัญโดยการวางซ้อนผลการเปรียบเทียบ

เริ่มต้นใช้งานโปรแกรมสำรวจรูปแบบการระบุแหล่งที่มา

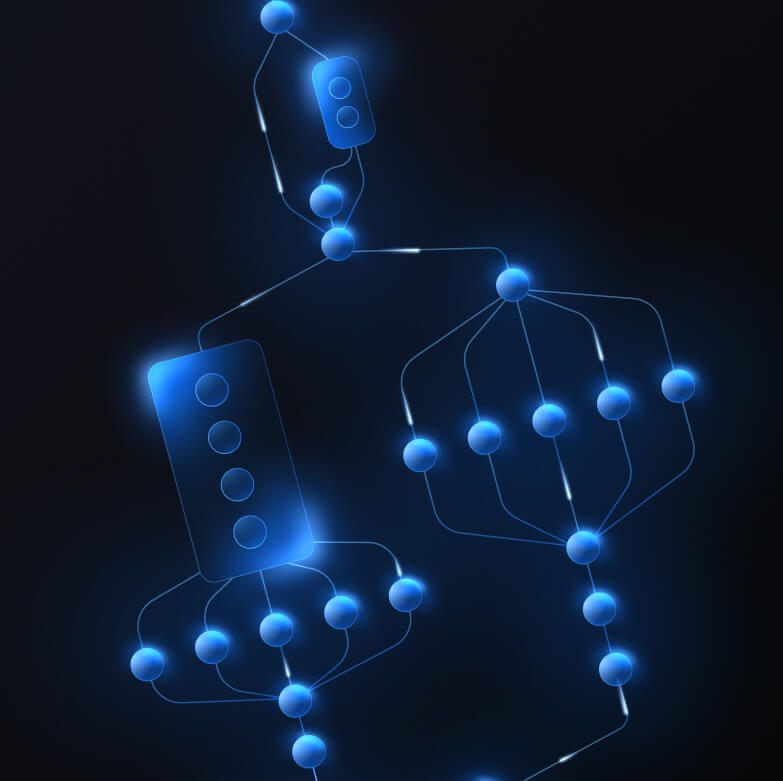

สร้างไปป์ไลน์ที่กําหนดเองสําหรับฟีเจอร์ ML ที่ซับซ้อน

สร้างงานของคุณเองด้วยการต่อโมเดล ML หลายรายการเข้าด้วยกันอย่างมีประสิทธิภาพ พร้อมกับตรรกะการประมวลผลก่อนและหลัง เรียกใช้ไปป์ไลน์ที่เร่งความเร็ว (GPU และ NPU) โดยไม่บล็อก CPU

เริ่มต้นใช้งานเฟรมเวิร์ก MediaPipe

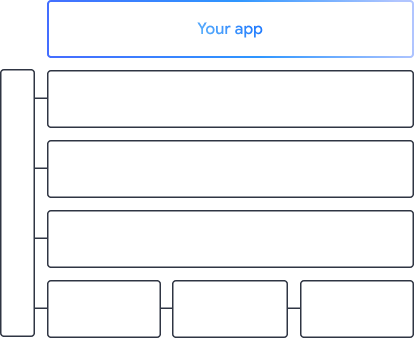

เครื่องมือและเฟรมเวิร์กที่ช่วยขับเคลื่อนแอปของ Google

สำรวจแพ็กเกจ AI Edge แบบสมบูรณ์ที่มีผลิตภัณฑ์ในทุกระดับ ตั้งแต่ API แบบ Low-Code ไปจนถึงไลบรารีการเร่งเฉพาะฮาร์ดแวร์

MediaPipe Tasks

MediaPipe Tasks

สร้างฟีเจอร์ AI ในแอปบนอุปกรณ์เคลื่อนที่และเว็บได้อย่างรวดเร็วโดยใช้ API แบบใช้โค้ดน้อยสำหรับงานทั่วไปที่ครอบคลุม Generative AI, คอมพิวเตอร์วิทัศน์, ข้อความ และเสียง

Generative AI

ผสานรวมโมเดลภาษาและรูปภาพแบบ Generative เข้ากับแอปโดยตรงด้วย API ที่พร้อมใช้งาน

การมองเห็น

สำรวจงานด้านภาพที่หลากหลาย ตั้งแต่การแบ่งกลุ่ม การแยกประเภท การตรวจจับ การจดจำ และจุดสังเกตของร่างกาย

ข้อความและเสียง

จัดประเภทข้อความและเสียงในหมวดหมู่ต่างๆ ซึ่งรวมถึงภาษา ความรู้สึก และหมวดหมู่ที่คุณกำหนดเอง

เริ่มต้นใช้งาน

เฟรมเวิร์ก MediaPipe

เฟรมเวิร์ก MediaPipe

เฟรมเวิร์กระดับล่างที่ใช้สร้างไปป์ไลน์ ML ที่เร่งประสิทธิภาพสูง ซึ่งมักมีโมเดล ML หลายรายการรวมกับการประมวลผลก่อนและหลัง

LiteRT

LiteRT

ติดตั้งใช้งานโมเดล AI ที่เขียนขึ้นในเฟรมเวิร์กใดก็ได้ในอุปกรณ์เคลื่อนที่ เว็บ และไมโครคอนโทรลเลอร์ด้วยการเร่งเฉพาะฮาร์ดแวร์ที่เพิ่มประสิทธิภาพ

หลายเฟรมเวิร์ก

แปลงโมเดลจาก JAX, Keras, PyTorch และ TensorFlow ให้ทำงานบนอุปกรณ์ Edge ได้

ข้ามแพลตฟอร์ม

เรียกใช้โมเดลเดียวกันใน Android, iOS, เว็บ และไมโครคอนโทรลเลอร์ด้วย SDK เดิม

เบาและรวดเร็ว

รันไทม์ที่มีประสิทธิภาพของ LiteRT ใช้พื้นที่เพียงไม่กี่เมกะไบต์และเปิดใช้การเร่งโมเดลใน CPU, GPU และ NPU

เริ่มต้นใช้งาน

โปรแกรมสำรวจรูปแบบการระบุแหล่งที่มา

โปรแกรมสำรวจรูปแบบการระบุแหล่งที่มา

สํารวจ แก้ไขข้อบกพร่อง และเปรียบเทียบโมเดลด้วยภาพ วางการเปรียบเทียบประสิทธิภาพและตัวเลขซ้อนกันเพื่อระบุจุดที่มีปัญหา

Gemini Nano ใน Android และ Chrome

สร้างประสบการณ์ Generative AI โดยใช้โมเดลในอุปกรณ์ที่มีประสิทธิภาพสูงสุดของ Google