Wenn Sie generative KI in Ihre Anwendung einbinden, können Sie sondern auch um die Sicherheit und den Datenschutz, die Ihre Nutzenden erwarten.

Sicherheit bei der Entwicklung

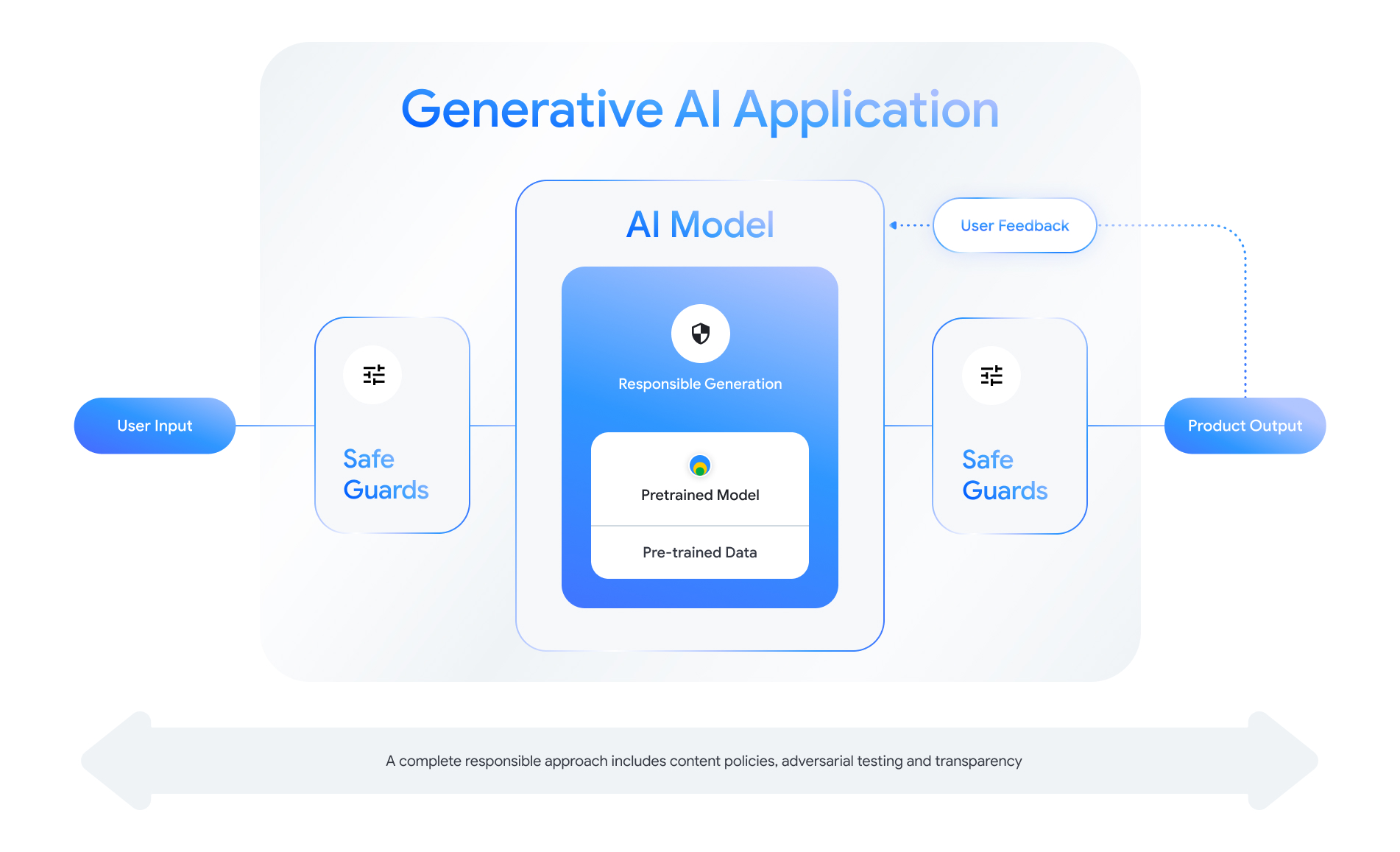

Jede Funktion, die generative KI unterstützt, bietet Möglichkeiten, mehr Sicherheit zu schaffen. Als Wie in der folgenden Abbildung dargestellt, können Sie über Sicherheit denken, indem Sie KI-Modell, das diese Funktion in der Mitte aktiviert. Dieses Modell sollte:

- Ausgerichtet, um die zugewiesene Aufgabe auszuführen

- Geschützt durch Sicherheitsmaßnahmen Ein- und Ausgaben werden abgelehnt. und

- Ganzheitlich bewertet, um zu beurteilen, wie das Modell und auf Interaktionen reagieren, die die Sicherheit beeinträchtigen.

In der „Verantwortungsbewusste KI-Produkte entwickeln“ Sitzung von Google I/O 2024, um mehr über Designüberlegungen, Denkübungen, und Prototyping-Methoden, die Ihnen helfen können, .

Darüber hinaus können Sie sich Best Practices und Beispiele für Folgendes ansehen:

- Definition der Richtlinien, die das Verhalten der KI steuern Ihre Anwendung;

- Transparenzartefakte für die Kommunikation erstellen Ihren verantwortungsvollen Umgang mit Ihren Nutzern; und

- Anwendung vor böswilliger Nutzung schützen

Denken Sie vor allem daran, dass ein vernünftiger Umgang mit Sicherheit und Verantwortung die selbstreflektierend und anpassungsfähig an technische, kulturelle und prozessbezogene Herausforderungen zu stellen. Binden Sie sich und Ihr Team regelmäßig ein, um Ihre um bestmögliche Ergebnisse zu erzielen.

Richtlinien auf Systemebene definieren

In den Richtlinien zur Sicherheit von Inhalten wird festgelegt, welche Arten von schädlichen Inhalten nicht zulässig sind auf einer Onlineplattform. Sie kennen die Inhaltsrichtlinien von Plattformen wie YouTube oder Google Play. Inhalt Richtlinien für generative KI-Anwendungen ähnlich: Sie definieren, welche Art von Inhalte, die Ihre Anwendung nicht generieren sollte, und sie enthält Anleitungen zur Feinabstimmung von Modellen und welche Absicherungen Sie hinzufügen sollten.

Ihre Richtlinien sollten den Anwendungsfall Ihrer Anwendung widerspiegeln. Beispiel: auf generativer KI basierendes Produkt, das Ideen für Familienaktivitäten kann es eine Richtlinie geben, die die Erstellung von Gewalt darstellen, da sie Nutzern schaden könnten. Umgekehrt Eine Anwendung, die von Nutzern vorgeschlagene Science-Fiction-Geschichten zusammenfasst, kann die Erzeugung von Gewalt zulassen möchten, da diese ein Thema in diesem Genre.

Ihre Sicherheitsrichtlinien sollten die Erstellung schädlicher Inhalte untersagen oder illegal sein. Außerdem muss angegeben werden, welche Arten von generierten Inhalten den die Leiste für Ihre App. Sie können auch erwägen, für pädagogische, dokumentarische, wissenschaftliche oder künstlerische Inhalte, kann sonst als schädlich eingestuft werden.

Die Definition klarer Richtlinien mit einer sehr detaillierten Detailebene, einschließlich mit Beispielen von der Richtlinie ausgenommen ist, Produkt. Ihre Richtlinien werden in jedem Schritt der Modellentwicklung verwendet. Für Daten Bereinigen oder Beschriften, können Ungenauigkeiten zu falschen Labels, zu oft entfernten zu wenig entfernt werden, was sich auf die Sicherheitsantworten Ihres Modells auswirkt. Für führen unzureichende Richtlinien zu einem hohen Interrater. Varianz, wodurch sich schwerer feststellen lässt, ob Ihr Modell den zu entwickeln.

Hypothetische Richtlinien (nur zur Veranschaulichung)

Im Folgenden finden Sie einige Beispiele für Richtlinien, die Sie für Ihre sofern sie Ihrem Anwendungsfall entsprechen.

| Richtlinienkategorie | Richtlinie |

|---|---|

| Vertrauliche personenidentifizierbare Informationen | In der Anwendung werden keine sensiblen und personenidentifizierbaren Informationen rezitiert. Daten (z.B. E-Mail-Adresse, Kreditkartennummer oder Sozialversicherungsnummer einer Privatperson). |

| Hassrede | Die App generiert keine negativen oder schädlichen Inhalte Ausrichtung auf Identität und/oder geschützte Merkmale (z.B. rassistische Bemerkungen, Werbung für Diskriminierung, Aufrufe zu Gewalt gegen geschützte Gruppen). |

| Belästigung | Die App wird nicht bösartig, einschüchternd, schikanierend, oder missbräuchliche Inhalte, die auf andere Personen ausgerichtet sind (z.B. physische Drohungen, Leugnung tragischer Ereignisse, Verunglimpfung der Opfer Gewalt). |

| Gefährliche Inhalte | Die App liefert keine Anleitungen oder Ratschläge zur Schädigung sich selbst und/oder anderen nutzen (z.B. der Zugriff auf oder der Bau von Schusswaffen und Sprengkörper, Werbung für Terrorismus, Anweisungen für Suizid). |

| sexuell explizit | Die Anwendung generiert keine Inhalte, die Verweise auf sexuelle Handlungen oder andere anzügliche Inhalte (z.B. sexuell explizite Darstellungen) Beschreibungen oder Inhalte, die Erregung auslösen sollen). |

| Zugang zu schädlichen Waren und Dienstleistungen ermöglichen | Die App generiert keine Inhalte, die Zugang zu potenziell schädlichen Waren, Dienstleistungen und Aktivitäten (z.B. den Zugang zu Werbung für Glücksspiele, Arzneimittel Feuerwerkskörper, sexuelle Dienstleistungen). |

| Schädliche Inhalte | Die Anwendung generiert keine Anweisungen zur Ausführung eines illegalen oder betrügerische Aktivitäten (z.B. die Erzeugung von Phishing, Spam oder Massenwerbesendungen oder Jailbreaking-Methoden. |

Transparenzartefakte

Dokumentation ist eine wichtige Methode, um für Entwickelnde Transparenz zu schaffen, Regierungen, politischen Akteuren und Endnutzern Ihres Produkts. Dies kann Folgendes beinhalten: detaillierte technische Berichte oder Modelle, Daten und Systemkarten grundlegende Informationen auf der Grundlage von Sicherheits- und anderen Modellen angemessen zu veröffentlichen. Bewertungen. Transparenz-Artefakte sind mehr als Kommunikationsmittel. sie bieten auch Unterstützung für KI-Forscher, Bereitsteller und Downstream-Entwickler bei den verantwortungsvollen Umgang mit dem Modell. Die Informationen sind hilfreich für Endanwendende Ihr Produkt, die mehr über das Modell erfahren möchten.

Beachten Sie die folgenden Transparenzrichtlinien:

- Zeigen Sie den Nutzern klar, wenn sie mit einer experimentellen Funktion interagieren. generative KI-Technologie und hebt die Möglichkeit eines unerwarteten Modells hervor. verhalten.

- Eine ausführliche Dokumentation dazu bieten, wie der Generative-AI-Dienst oder das Generative-AI-Produkt verständliche Sprache. Erwägen Sie die Veröffentlichung von strukturierten Transparenzartefakte wie Modellkarten. Diese Karten enthalten die vorgesehen ist, und fassen Sie die Bewertungen zusammen, während der Modellentwicklung.

- Zeigen Sie den Teilnehmenden, wie sie Feedback geben und welche Kontrolle sie haben, z. B.

als:

<ph type="x-smartling-placeholder">

- </ph>

- Bereitstellung von Mechanismen, mit denen Nutzer faktenbasierte Fragen validieren können

- „Mag ich“- und „Mag ich nicht“-Symbole für Nutzerfeedback

- Links zum Melden von Problemen und zur Unterstützung für eine schnelle Reaktion auf Nutzerfeedback

- Nutzersteuerung zum Speichern oder Löschen von Nutzeraktivitäten

Sichere KI-Systeme

Auf generativer KI basierende Anwendungen bieten komplexe Angriffsflächen die im Vergleich zu herkömmlichen Anwendungen vielfältigere Maßnahmen erfordern. Das Secure AI Framework (SAIF) von Google bietet eine ganzheitliche Konzeptionelles Framework, um zu überlegen, wie Sie Ihre generative KI-fähige Anwendung entwerfen für eine sichere Verwendung. Anhand dieses Rahmenwerks können Sie beurteilen, Ausrichtung, Bewertung von Angreifern und Sicherheitsmaßnahmen zum Schutz Ihrer Anwendung, Denken Sie jedoch daran, dass dies nur die ersten Schritte sind. Weitere Änderungen an dass Organisationspraktiken, Monitoring und Benachrichtigungen Sicherheitsziele für Ihren spezifischen Anwendungsfall und Kontext zu erreichen.

Entwicklerressourcen

Beispiele für Richtlinien für Generative AI:

- Die Gemini API und die PaLM API von Cloud bieten eine Liste von Sicherheitsattributen, die als Grundlage für die Richtlinien.

- Beispiele für Richtlinien im Fortschritte bei den KI-Grundsätzen von Google 2023.

- Die MLCommons Association, ein technisches Konsortium, das auf Eine Philosophie der offenen Zusammenarbeit zur Verbesserung von KI-Systemen, Referenz 6 Gefahren, mit denen sie Modelle zur Sicherheit von KI im Rahmen ihrer eigenen AI Safety Benchmark.

Es gibt keine einzige Vorlage für Transparenzartefakte im Branche, aber vorhandene Modellkarten können als Ausgangspunkt dienen. um eigene zu erstellen:

- Gemmas Modellkarte

- Modellkartenvorlage aus dem ursprünglichen Modellkartenpapier

- Modellkarten von Google Cloud APIs