7 Kasım 2024

Gemini Modellerinin Uzun Bağlamıyla Yapay Zeka Kodlama Asistanlarını Güçlendirme

Uzun bağlam pencerelerinin uygulanmasıyla ilgili en heyecan verici alanlardan biri kod oluşturma ve anlama konusudur. Büyük kod tabanları, karmaşık ilişkilerin ve bağımlılıkların derinlemesine anlaşılmasını gerektirir. Bu, geleneksel yapay zeka modellerinin anlamakta zorlandığı bir şeydir. Büyük bağlam pencereleriyle kod miktarını artırarak kod oluşturma ve anlama konusunda yeni bir doğruluk ve fayda düzeyi elde edebiliriz.

Gerçek dünyadaki kodlama senaryolarında uzun bağlam pencerelerinin potansiyelini keşfetmek için Gemini 1.5 Pro ve Flash gibi LLM'leri destekleyen Cody yapay zeka kodlama asistanının geliştiricisi Sourcegraph ile iş ortaklığı yaptık. Sourcegraph'ın kod arama ve yapay zeka kod oluşturma işlemlerine kod zekasını entegre etmeye odaklanması ve Cody'yi Palo Alto Networks ve Leidos gibi büyük ve karmaşık kod tabanlarına sahip işletmelerde başarıyla kullanması, bu keşif için ideal bir iş ortağı olmasını sağladı.

Sourcegraph'ın Yaklaşımı ve Sonuçları

Sourcegraph, Cody'nin 1 milyon parçalık bağlam penceresiyle (Google'ın Gemini 1.5 Flash'i kullanılarak) performansını üretim sürümüyle karşılaştırdı. Bu doğrudan karşılaştırma, genişletilmiş bağlamın avantajlarını belirlemelerini sağladı. Bu model, büyük kod tabanlarıyla çalışan geliştiriciler için çok önemli bir görev olan teknik soruları yanıtlama konusunda uzmanlaşmıştır. Derin kod bilgisi gerektiren zorlu sorulardan oluşan bir veri kümesi kullandılar.

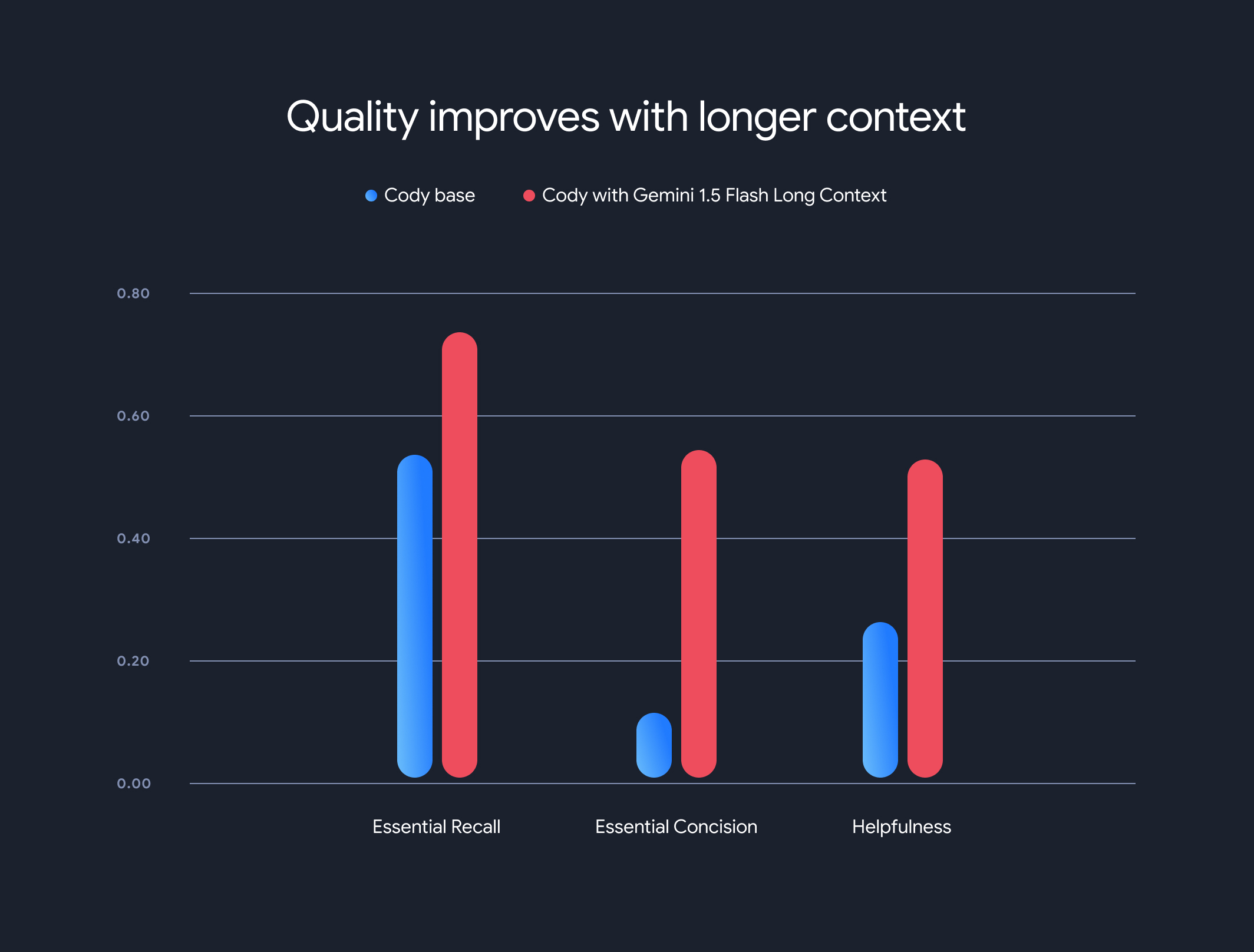

Sonuçlar çarpıcıydı. Sourcegraph'in temel kıyaslama ölçütlerinden üçü (Essential Recall, Essential Concision ve Helpfulness), daha uzun bağlam kullanıldığında önemli ölçüde iyileşme gösterdi.

Önemli hatırlama: Yanıttaki önemli bilgilerin oranı önemli ölçüde arttı.

Temel Kısa ve Öz Olma (Essential Concision): Yanıt uzunluğuna göre normalleştirilmiş temel bilgi oranı da iyileşerek daha kısa ve öz, alakalı yanıtlar verildiğini gösterdi.

Fayda düzeyi: Yanıt uzunluğuna göre normalleştirilmiş genel fayda düzeyi puanı önemli ölçüde arttı. Bu, daha kullanıcı dostu bir deneyim sunulduğunu gösteriyor.

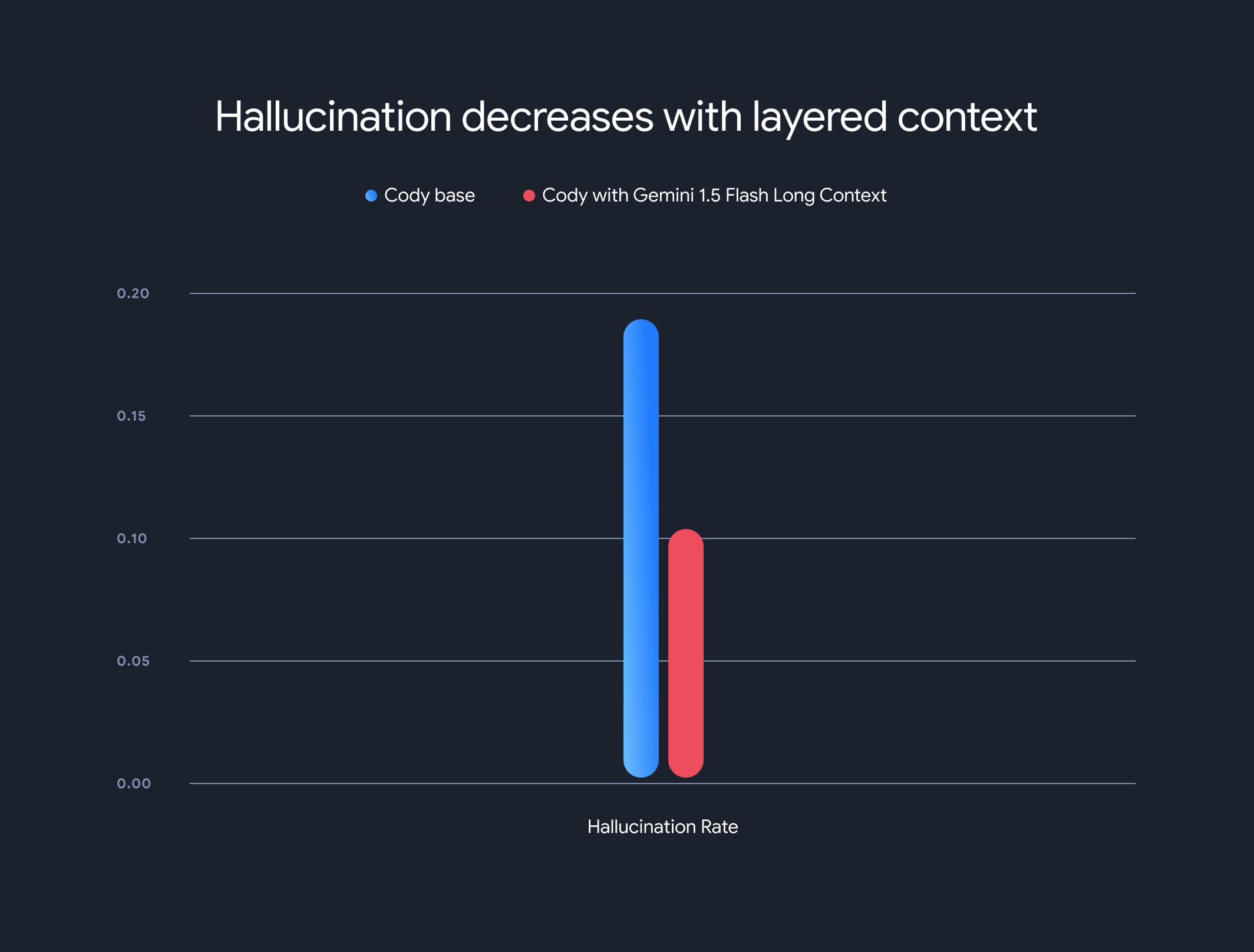

Ayrıca, uzun bağlamlı modellerin kullanılması, genel halüsinasyon oranını (olgusal olarak yanlış bilgilerin üretilmesi) önemli ölçüde azalttı. Halüsinasyon oranı% 18,97'den %10,48'e düşerek doğruluk ve güvenilirlikte önemli bir iyileşme sağlandı.

Ödünleşimler ve Gelecekteki Yön

Uzun bağlamın önemli avantajları olsa da bazı dezavantajları vardır. İlk jetona kadar geçen süre, bağlamın uzunluğuyla doğrusal olarak artar. Sourcegraph, bu sorunu azaltmak için model yürütme durumu önbelleğe alma amacıyla bir önceden getirme mekanizması ve katmanlı bağlam modeli mimarisi uyguladı. Gemini 1.5 Flash ve Pro uzun bağlam modelleriyle, ilk parçaya kadar geçen süre 1 MB bağlamlar için 30-40 saniyeden yaklaşık 5 saniyeye düşürüldü. Bu, gerçek zamanlı kod oluşturma ve teknik yardım için önemli bir gelişmedir.

Bu işbirliği, uzun bağlamlı modellerin kod anlama ve oluşturma konusunda devrim yaratma potansiyelini gösteriyor. Büyük bağlam pencereleriyle daha da yenilikçi uygulamalar ve paradigmalar sunmak için Sourcegraph gibi şirketlerle iş ortaklığı yapmaktan heyecan duyuyoruz.

Sourcegraph'ın ayrıntılı değerlendirme metodolojileri, karşılaştırmaları ve analizleri hakkında daha fazla bilgi edinmek için (örnekler dahil) ayrıntılı blog yayınını inceleyin.