Gemini や Gemini などの AI モデルのプロンプトを作成する ユーザーの意図を完璧に捉える Gemma は、簡単なタスクではありません。多くの場合、プロンプトを手動で作成し、さまざまなユースケースでテストして、ニーズに合っていることを確認する必要があります。結果に基づいて、プロンプトをターゲットに絞って更新できます。たとえば、ある部分の単語を変更したり、別の部分に新しい文を追加したりします。このプロセスは原則に沿っておらず、最良の結果が得られない可能性があります。

Google は、LLM を使用して以下を行う手法を開発 プロンプト テンプレートを自動的に更新し、 フィードバックを提供することを目的としています。フィードバックは、プロンプトとモデルの出力とともに LLM に送信され、意図した動作に合わせてプロンプトが更新されます。

この方法は次の 2 つの方法で使用できます。

- オープンソースの

model-alignmentPython ライブラリを使用すると、 ソフトウェアやワークフローに柔軟に組み込めます。 - このアプローチのバージョンは Vertex AI Studio に統合されており、数回のクリックでこのワークフローを使用できます。

オープンソース ライブラリ

Model Alignment は、オープンソースの Python ライブラリです。PyPI のパッケージとしてリリースされており、API を介して人間からのフィードバックに基づくプロンプトの調整を可能にします。このライブラリは、 人間のフィードバックによって更新されるプロンプト ラベル付きデータからの自動分類器作成。

Model Alignment ライブラリを使用して Gemma のプロンプト テンプレートをキュレートする

|

|

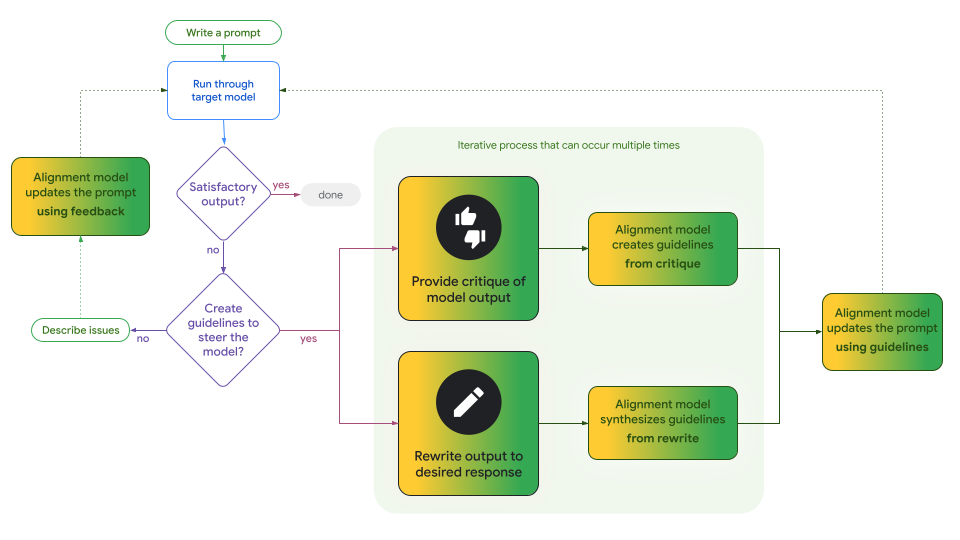

このライブラリは、プロンプト テンプレートを自動的に更新するための 2 つのワークフローをサポートしています。

- プリンシパルからの反復的な更新。このワークフローでは、LLM を使用して ガイドラインを間接的に批判することであり、 またはモデル出力を直接編集した結果です。Google Chat では 1 つ以上のガイドラインを繰り返し作成してから、LLM に プロンプト テンプレートが更新され、これらのガイドラインに準拠します。ガイドラインを手動でキュレートして、LLM で抽出されたガイドラインと一緒に含めることもできます。

- モデル出力の直接的な批評。このワークフローでは その出力を、プロンプトとモデルとともにフィードし、 LLM に直接送信して、更新されたプロンプト テンプレートを生成します。

この 2 つのワークフローはどちらもアプリケーションに役立ちます。注目すべきトレードオフは、ガイドラインの存在です。ガイドラインは、透明性へのアプローチなど、有用で具体的なプロセス アーティファクトになる可能性があります。

図 1. このフローチャートは、2 つのモデル アライメント ライブラリ ワークフローが分岐する場所と方法を示しています。これにより、ガイドラインに基づく更新やプロンプト テンプレートの直接更新が可能になります。このプロセスは反復的であり、これらのワークフローは いつでも切り替えることができます。

Gemini を使用して、両方のワークフローを使用して Gemma 2 のプロントをアライメントする Colab ノートブックをご覧ください。

Vertex AI Studio でのアライメント

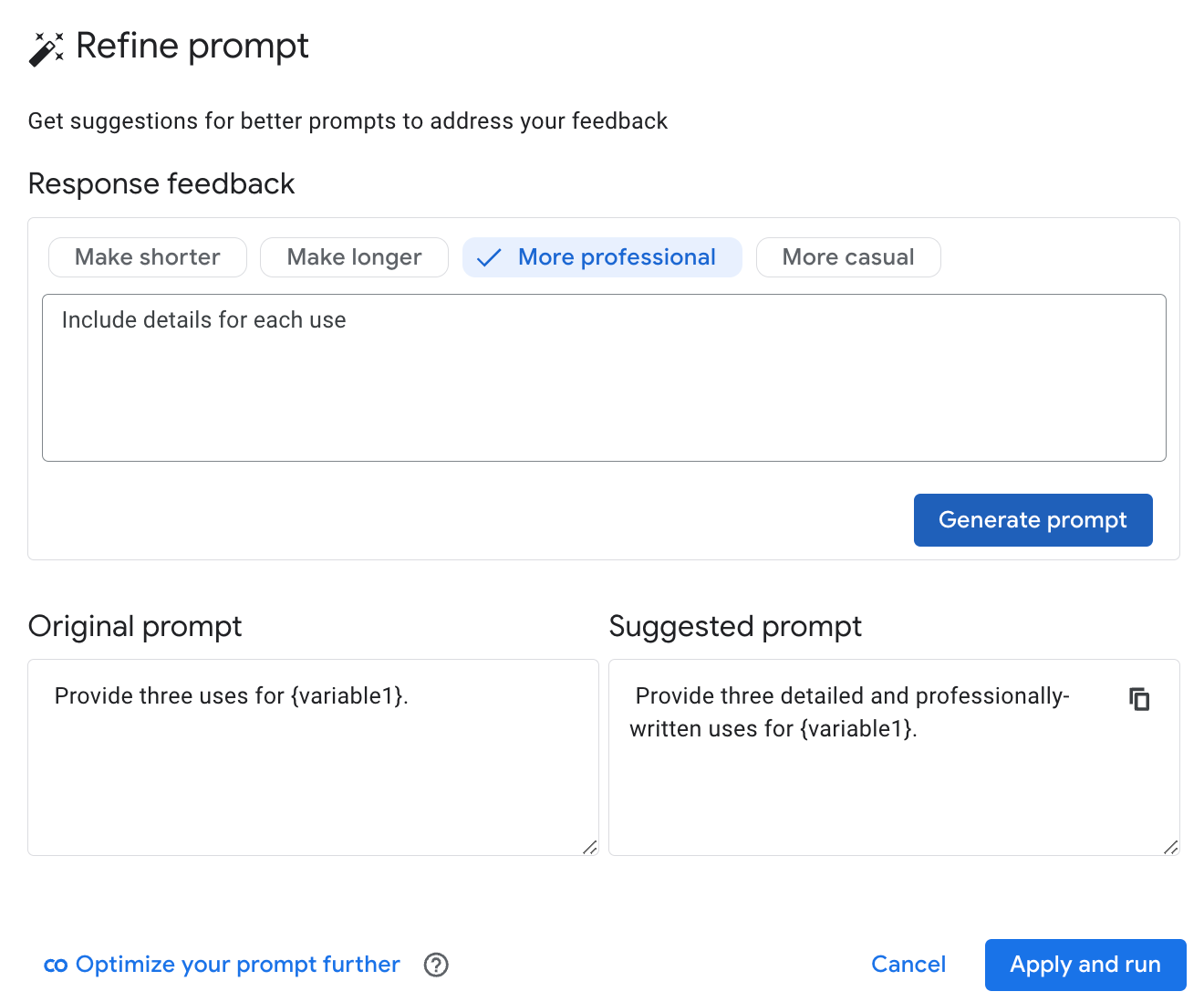

Google の Vertex AI Studio に 直接のワークフローに基づく「プロンプトを絞り込む」機能 オープンソース ライブラリから入手して、オーサリングを補完し、 実行、評価、比較の各ツールが用意されています。

プロンプトを実行した後、モデルがどのように動作しているかを 動作し、Vertex AI Studio は Gemini を使用して下書きを作成します。 リライトします。提案された変更を承認して、更新されたプロンプトを再実行できます ボタンをクリックするか、フィードバックを更新して Gemini に別の下書きを作成させることができます できます。

図 2. 「プロンプトを絞り込む」Vertex AI Studio の機能を使用して ユーザーのフィードバックに基づいてプロンプトを更新します。

リンク

モデルの調整を自分で調べる:

- この Colab ノートブックを実行します。このノートブックでは、Gemini を使用して、両方のアライメント アプローチを使用してオープン重み Gemma 2 モデルのさまざまなプロンプトをアライメントします。

- 「プロンプトを絞り込む」を試すモデルアライメント機能、 Vertex AI Studio。