Bộ công cụ này cung cấp tài nguyên và công cụ để áp dụng các phương pháp hay nhất cho sử dụng các mô hình mở có trách nhiệm, chẳng hạn như Gemma, bao gồm:

- Hướng dẫn thiết lập chính sách an toàn, tính năng điều chỉnh mức độ an toàn và thuật toán phân loại độ an toàn và đánh giá mô hình.

- Công cụ diễn giải học tập để kiểm tra và gỡ lỗi hành vi của Gemma theo lời nhắc.

- Trình so sánh LLM để chạy và trực quan hoá thông tin so sánh kết quả đánh giá.

- Phương pháp xây dựng bộ phân loại an toàn mạnh mẽ với các ví dụ tối thiểu.

Phiên bản này của bộ công cụ chỉ tập trung vào các mô hình chuyển văn bản từ tiếng Anh sang văn bản. Bạn có thể đưa ra ý kiến phản hồi để giúp bộ công cụ này trở nên hữu ích hơn thông qua ý kiến phản hồi đường liên kết cơ chế ở cuối trang.

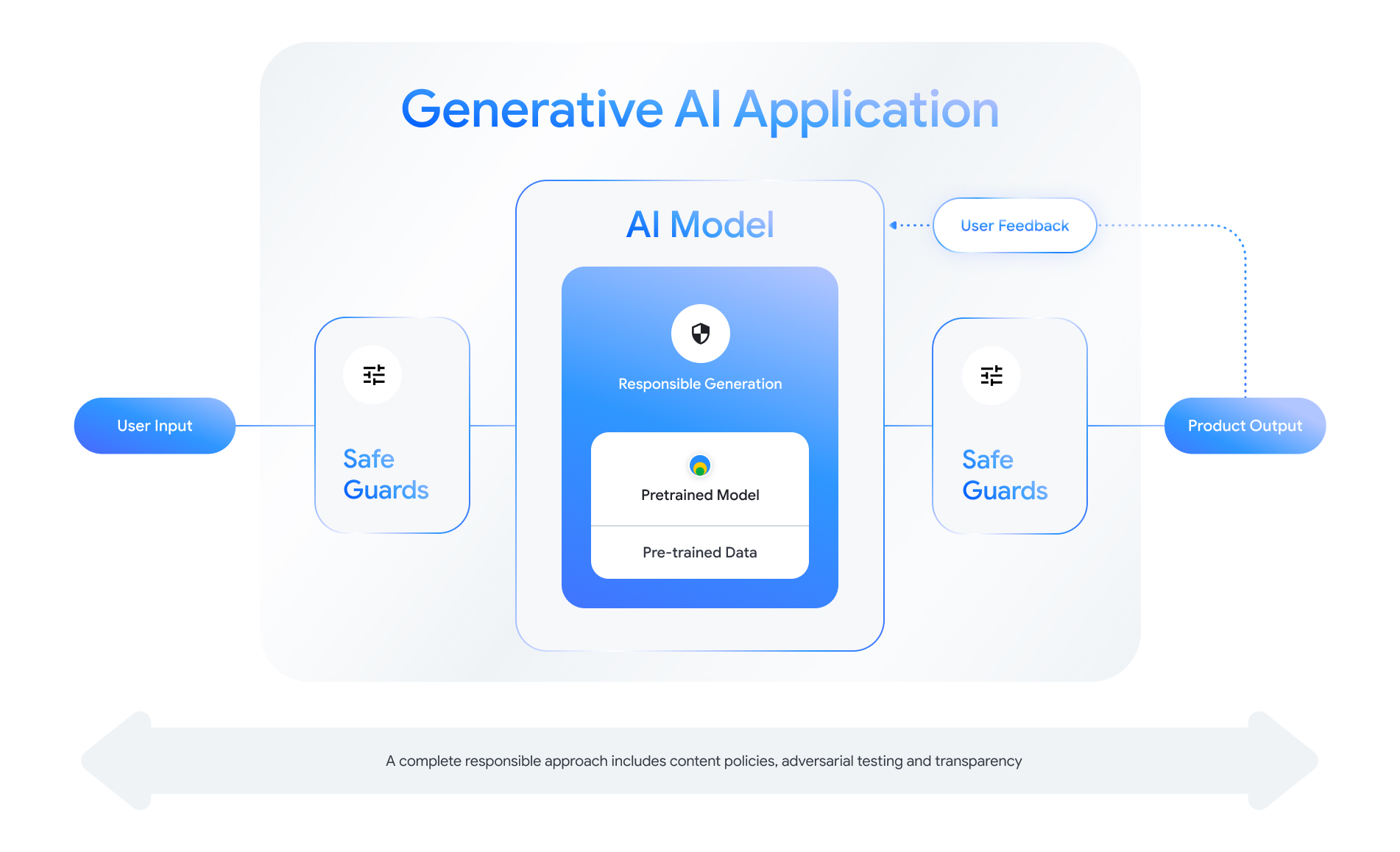

Khi xây dựng ứng dụng bằng Gemma, bạn nên tiếp cận một cách toàn diện về trách nhiệm đồng thời xem xét mọi thách thức có thể xảy ra ở cấp độ ứng dụng và mô hình. Bộ công cụ này bao gồm các kỹ thuật rủi ro và giảm thiểu để giải quyết vấn đề an toàn, quyền riêng tư, sự công bằng và trách nhiệm giải trình.

Hãy tìm hiểu phần còn lại của bộ công cụ này để biết thêm thông tin và hướng dẫn: