Menjalankan LLM di perangkat dengan LiteRT-LM

Framework inferensi open source yang siap produksi dan dirancang untuk menghadirkan deployment LLM lintas platform berperforma tinggi di perangkat edge.

Mengapa LiteRT-LM?

Lintas-platform

Deploy LLM di Android, iOS, Web, dan Desktop.

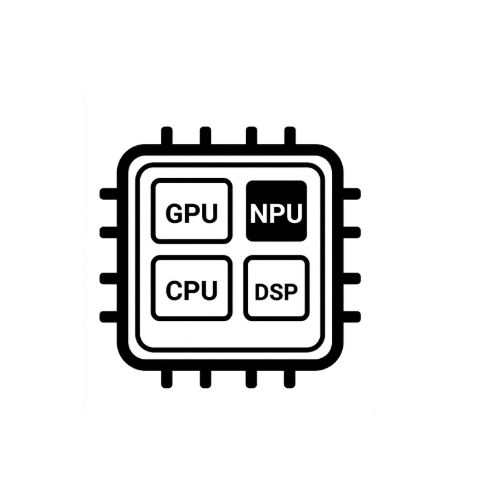

Dipercepat hardware

Maksimalkan performa dengan akselerasi GPU dan NPU.

Kemampuan GenAI yang Luas

Dukungan untuk LLM populer serta multi-modalitas (Vision, Audio) dan Penggunaan Alat.

Bergabung dengan Komunitas

LiteRT-LM di GitHub

Berkontribusi pada project open source, melaporkan masalah, dan melihat contoh.

Hugging Face

Download model yang telah dikonversi sebelumnya (Gemma, Qwen, dan lainnya), dan bergabunglah dalam diskusi.

Blog dan Pengumuman

Hadirkan kemampuan agentic canggih ke edge dengan Gemma 4.

Deploy Gemma 4 dalam aplikasi dan di berbagai perangkat dengan performa dan jangkauan yang luar biasa menggunakan LiteRT-LM.

GenAI di perangkat di Chrome, Chromebook Plus, dan Pixel Watch

Men-deploy model bahasa di platform berbasis browser dan perangkat wearable menggunakan LiteRT-LM dalam skala besar.

Panggilan fungsi di perangkat di Google AI Edge Gallery

Pelajari cara menyetel FunctionGemma dan mengaktifkan kemampuan panggilan fungsi yang didukung oleh LiteRT-LM Tool Use API.

Model bahasa kecil, multi-modalitas, dan pemanggilan fungsi Google AI Edge

Insight terbaru tentang RAG, multimodalitas, dan panggilan fungsi untuk model bahasa edge.