अपने ऐप्लिकेशन में जेन एआई जोड़ने से लोगों को बहुत ज़्यादा फ़ायदा मिल सकता है हालाँकि, इस पर खास ध्यान देने की ज़रूरत होती है, ताकि सुरक्षा और निजता का ऐसा जो आपके उपयोगकर्ताओं की उम्मीदों के हिसाब से सही हैं.

सुरक्षा के लिए बनाया गया डिज़ाइन

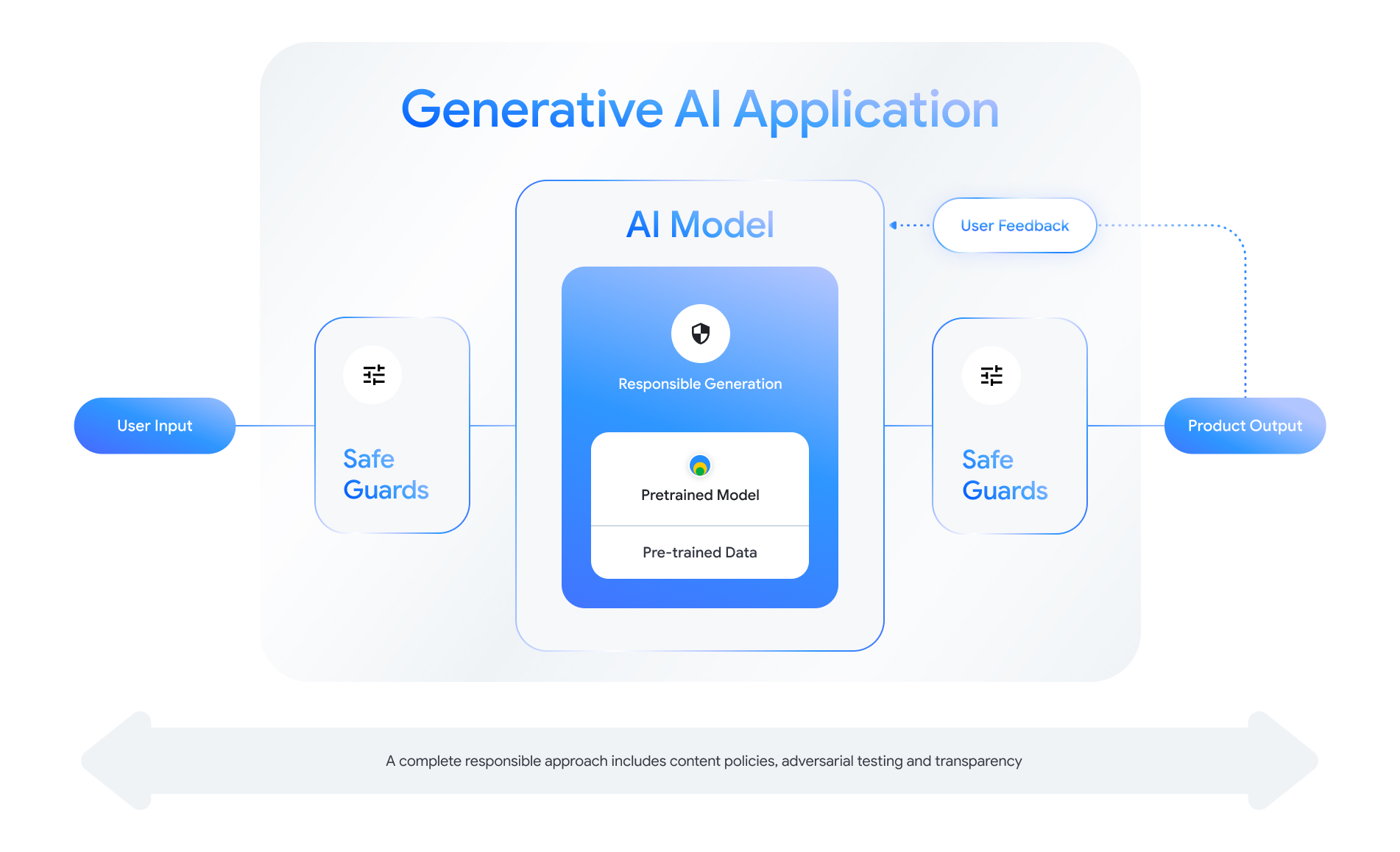

जनरेटिव एआई की मदद से काम करने वाली हर सुविधा, सुरक्षा की लेयर को डिज़ाइन करने के मौके देती है. जैसे नीचे दी गई इमेज में दिखाया गया है. सुरक्षा के बारे में सोचने का एक तरीका यह है कि एआई (AI) मॉडल, जो इस सुविधा को बीच में चालू करता है. यह मॉडल ऐसा होना चाहिए:

- असाइन किए गए टास्क को पूरा करने के लिए अलाइन किया;

- सुरक्षा के उपायों की मदद से सुरक्षित किया गया है, ताकि यह पक्का किया जा सके कि लोग सीमा से बाहर हैं इनपुट और आउटपुट अस्वीकार कर दिए गए हों; और

- आकलन किया गया, ताकि यह आकलन किया जा सके कि मॉडल और जो सुरक्षा पर असर डालने वाले इंटरैक्शन का जवाब देते हैं.

ज़्यादा जानकारी के लिए "ज़िम्मेदार एआई प्रॉडक्ट बनाना" सेशन शुरू Google I/O 2024 का मकसद, डिज़ाइन से जुड़ी ज़रूरी बातों, आइडिया पर होने वाली एक्सरसाइज़, और अन्य और प्रोटोटाइपिंग के ऐसे तरीके बताओ जिनसे ज़िम्मेदारी के साथ विकास के लिए बढ़ावा मिलता हो करते हैं.

इसके अलावा, यहां बताए गए सबसे सही तरीकों के बारे में भी जाना जा सकता है और इनके उदाहरण भी देखे जा सकते हैं:

- ऐसी नीतियां तय करना जिनसे यह तय होगा कि एआई किस तरह काम करेगा आपका आवेदन;

- लोगों तक पहुंचने के लिए, पारदर्शिता से जुड़े आर्टफ़ैक्ट बनाए जा रहे हैं अपने उपयोगकर्ताओं के प्रति अपना ज़िम्मेदार व्यवहार; और

- नुकसान पहुंचाने वाले इस्तेमाल से आपके ऐप्लिकेशन की सुरक्षा करना.

इन सबसे अहम बात यह है कि सुरक्षा और ज़िम्मेदारी से निपटने का सबसे मज़बूत तरीका जो तकनीक, सांस्कृतिक, और प्रक्रिया के हिसाब से आत्मचिंतन और अपनाए चुनौतियां. अपनी टीम और खुद की नियमित तौर पर समीक्षा करके, का इस्तेमाल किया जा सकता है.

सिस्टम-लेवल की नीतियां तय करें

कॉन्टेंट की सुरक्षा से जुड़ी नीतियों में बताया गया है कि नुकसान पहुंचाने वाले किस तरह के कॉन्टेंट की अनुमति नहीं है ऑनलाइन प्लैटफ़ॉर्म पर किस तरह का है. ऐसा हो सकता है कि आपको प्लैटफ़ॉर्म की कॉन्टेंट नीतियों के बारे में पता हो जैसे, YouTube या Google Play. कंटेंट जनरेटिव एआई के ऐप्लिकेशन के लिए नीतियां एक जैसी हैं. इनसे तय होता है कि ऐसा कॉन्टेंट जिसे आपके ऐप्लिकेशन को जनरेट नहीं करना चाहिए. साथ ही, वे मॉडल को ट्यून करने का तरीका बताते हैं और सुरक्षा के कौनसे सही उपाय जोड़े जा सकते हैं.

आपकी नीतियों को आपके ऐप्लिकेशन के इस्तेमाल के उदाहरण की जानकारी देनी चाहिए. उदाहरण के लिए, जनरेटिव एआई की सुविधा वाला प्रॉडक्ट, जिसे फ़ैमिली की गतिविधियों के आधार पर आइडिया दिया जा सकता है समुदाय के सुझावों की एक ऐसी नीति हो सकती है जो ऐसा कॉन्टेंट जो हिंसक है, क्योंकि इससे लोगों को नुकसान पहुंच सकता है. इसके उलट, ऐसा ऐप्लिकेशन जो उपयोगकर्ताओं द्वारा प्रस्तावित विज्ञान कथा कहानी के विचारों को सारांशित करता है हिंसा को बढ़ावा देना चाहते हैं, क्योंकि दुनिया भर में यह शैली.

आपकी सुरक्षा नीतियों की मदद से ऐसा कॉन्टेंट जनरेट होने पर पाबंदी लगाई जानी चाहिए जो नुकसान पहुंचाने वाला हो और गैर-कानूनी हो. साथ ही, इसमें यह बताया जाना चाहिए कि जनरेट किए गए कॉन्टेंट किस तरह के हैं उस बार को शामिल करना होगा. आप विज्ञापन देने वालों के साथ-साथ ऐसे कॉन्टेंट को अपवाद के तौर पर अनुमति दी जा सकती है जिसमें शिक्षा, डॉक्यूमेंट्री, विज्ञान या कला के मकसद से बनाया गया कॉन्टेंट शामिल हो नुकसान पहुंचाने वाला कॉन्टेंट हो सकता है.

पूरी जानकारी के साथ साफ़ तौर पर नीतियां तय करना. इनमें ये बातें भी शामिल हैं अपवाद के साथ-साथ नीति के अपवादों में, सदस्य बनाने के लिए प्रॉडक्ट. आपकी नीतियों का इस्तेमाल, मॉडल डेवलपमेंट के हर चरण में किया जाता है. डेटा के लिए डेटा को गलत तरीके से लेबल करने, उसे हटाने, या डेटा को गलत तरीके से लेबल करने की वजह से डेटा को हटाना है, जिससे आपके मॉडल के सुरक्षा जवाबों पर असर पड़ेगा. इसके लिए आकलन के मकसद और गलत जानकारी वाली नीतियों की मदद से इंटर-रेटर को ज़्यादा रेटिंग मिलेगी अंतर होता है, जिससे यह पता लगाना और भी मुश्किल हो जाता है कि आपका मॉडल आपकी सुरक्षा को पूरा करता है या नहीं मानकों के बारे में बताया गया है.

काल्पनिक नीतियां (सिर्फ़ इलस्ट्रेशन के लिए)

नीचे उन नीतियों के कुछ उदाहरण दिए गए हैं जिन्हें अपने विज्ञापनों की समीक्षा के लिए इस्तेमाल किया जा सकता है दिया गया है, बशर्ते वे आपके इस्तेमाल के उदाहरण से मेल खाते हों.

| नीति की कैटगरी | नीति |

|---|---|

| व्यक्तिगत पहचान से जुड़ी संवेदनशील जानकारी (एसपीआईआई) | ऐप्लिकेशन में कोई संवेदनशील और व्यक्तिगत पहचान से जुड़ी जानकारी नहीं सुनाई जाएगी जानकारी (उदाहरण के लिए, ईमेल, क्रेडिट कार्ड नंबर, या किसी निजी व्यक्ति की सामाजिक सुरक्षा संख्या). |

| नफ़रत फैलाने वाली भाषा | ऐप्लिकेशन नेगेटिव या नुकसान पहुंचाने वाला कॉन्टेंट जनरेट नहीं करेगा जो पहचान और/या सुरक्षित विशेषताओं को निशाना बनाते हैं (जैसे, नस्लीय टिप्पणियां, भेदभाव को बढ़ावा देना, संरक्षित व्यक्ति के ख़िलाफ़ हिंसा को बढ़ावा देना ग्रुप) के तौर पर शामिल होना चाहिए. |

| उत्पीड़न | ऐप्लिकेशन नुकसान पहुंचाने वाला, डराने-धमकाने वाला, या किसी दूसरे व्यक्ति को टारगेट करने वाला बुरे बर्ताव वाला कॉन्टेंट (उदाहरण के लिए, शारीरिक धमकी देना, दुखद घटनाओं से इनकार करना, पीड़ितों को नीचा दिखाना हिंसा). |

| खतरनाक कॉन्टेंट | ऐप्लिकेशन नुकसान पहुंचाने के बारे में कोई निर्देश या सलाह जनरेट नहीं करेगा या खुद को और/या अन्य लोगों (उदाहरण के लिए, बंदूकें ऐक्सेस करना या बनाना और विस्फोटक डिवाइस, आतंकवाद का प्रचार, आत्महत्या. |

| सेक्शुअल ऐक्ट दिखाने वाला कॉन्टेंट | ऐप्लिकेशन ऐसा कॉन्टेंट जनरेट नहीं करेगा जिसमें इसके रेफ़रंस शामिल हों सेक्शुअल ऐक्ट या अन्य भद्दा कॉन्टेंट (जैसे, सेक्शुअल ऐक्ट दिखाने वाला कॉन्टेंट) ब्यौरा, जिसका मकसद उत्तेजित करना हो. |

| नुकसान पहुंचाने वाले सामान और सेवाओं का ऐक्सेस देना | ऐप्लिकेशन ऐसा कॉन्टेंट जनरेट नहीं करेगा जो ऐसे सामान, सेवाओं, और गतिविधियों को ऐक्सेस करना जिनकी वजह से नुकसान हो सकता है. जुए, दवाइयों, और अन्य आतिशबाज़ी, सेक्शुअल सेवाएं). |

| नुकसान पहुंचाने वाला कॉन्टेंट | ऐप्लिकेशन गैर-कानूनी काम करने के लिए निर्देश जनरेट नहीं करेगा या धोखाधड़ी वाली गतिविधियों से जुड़ा डेटा शेयर करना. जैसे, फ़िशिंग, स्पैम या एक साथ कई लोगों को लुभाने के मकसद से बनाया गया कॉन्टेंट और जेलब्रेक करने के तरीके. |

पारदर्शिता से जुड़े आर्टफ़ैक्ट

डेवलपर के लिए पारदर्शिता बनाए रखने के लिए, दस्तावेज़ एक मुख्य तरीका है. आपके प्रॉडक्ट की सरकारें, नीति बनाने वाले लोग, और असली उपयोगकर्ता. यह ज़रूरी है ऐसी पूरी जानकारी वाली तकनीकी रिपोर्ट या मॉडल, डेटा, और सिस्टम कार्ड रिलीज़ करना सुरक्षा और अन्य मॉडल के आधार पर, सार्वजनिक तौर पर ज़रूरी जानकारी देना आकलन. पारदर्शिता से जुड़े आर्टफ़ैक्ट, कम्यूनिकेशन सेवाओं से कहीं ज़्यादा अहम हैं; वे साथ ही, एआई रिसर्च करने वाले लोगों, डिप्लॉयर, और डाउनस्ट्रीम डेवलपर को ज़िम्मेदारी के साथ मॉडल का इस्तेमाल करना. यह जानकारी इसके असली उपयोगकर्ताओं के लिए मददगार होती है अपने प्रॉडक्ट को भी सेव कर सकते हैं.

पारदर्शिता के लिए कुछ दिशा-निर्देश:

- एक्सपेरिमेंट में शामिल उपयोगकर्ताओं को साफ़ तौर पर जानकारी दें जनरेटिव एआई टेक्नोलॉजी और अनचाहे मॉडल की संभावना को हाइलाइट करना व्यवहार.

- जनरेटिव एआई की सेवा या प्रॉडक्ट के बारे में पूरी जानकारी देने वाला दस्तावेज़ उपलब्ध कराएं समझने लायक भाषा में किया गया है. स्ट्रक्चर्ड कॉन्टेंट पब्लिश करने के बारे में सोचें पारदर्शिता से जुड़े आर्टफ़ैक्ट शामिल हैं, जैसे कि मॉडल कार्ड. ये कार्ड आपको और उन आकलनों का सारांश बनाना जिन्हें आपने मॉडल के इस्तेमाल के लिए तय किया है मॉडल डेवलपमेंट के दौरान किया जाता है.

- लोगों को दिखाएं कि वे सुझाव कैसे दे सकते हैं और कैसे आप इसे अपने हिसाब से कंट्रोल कर सकते हैं, जैसे

जैसे:

- उपयोगकर्ताओं को तथ्यों पर आधारित सवालों की पुष्टि करने के तरीके उपलब्ध कराना

- लोगों के सुझाव, राय या शिकायत के लिए, पसंद और नापसंद करने के आइकॉन

- समस्याओं की शिकायत करने के लिए लिंक और उन पर तुरंत कार्रवाई करने में मदद करना उपयोगकर्ता के सुझाव, शिकायत या राय

- उपयोगकर्ता गतिविधि को सेव करने या मिटाने के लिए उपयोगकर्ता का कंट्रोल

सिक्योर एआई सिस्टम

जनरेटिव एआई की सुविधा वाले ऐप्लिकेशन, ज़्यादा मुश्किल हमलों का सामना कर सकते हैं जिन्हें पारंपरिक तरीकों के मुकाबले अलग-अलग तरह के खतरों को कम करने की ज़रूरत है. Google का Secure AI Framework (SAIF) बेहतर नतीजे देता है आपको जनरेटिव एआई की सुविधा वाले ऐप्लिकेशन को डिज़ाइन करने के बारे में सोचना चाहिए सुरक्षित तरीके से इस्तेमाल करने के लिए. इस फ़्रेमवर्क की मदद से, ऑडियंस की ज़रूरतों का आकलन करने में मदद मिलेगी अलाइनमेंट, कानूनी आकलन, और आपके ऐप्लिकेशन की सुरक्षा के लिए असरदार सुरक्षा उपाय, हालांकि, याद रखें कि ये सिर्फ़ शुरुआती ब्लॉक हैं. अतिरिक्त बदलाव संगठन के तौर-तरीकों, निगरानी, और सूचना की ज़रूरत पड़ सकती है. इस्तेमाल के उदाहरण और संदर्भ के हिसाब से, सुरक्षा से जुड़े अपने लक्ष्यों को हासिल किया जा सकता है.

डेवलपर संसाधन

जनरेटिव एआई की नीतियों के उदाहरण:

- Cloud Gemini API और PaLM API सुरक्षा से जुड़े एट्रिब्यूट की सूची, जो सुरक्षा देने की बुनियाद हो सकती है की नीतियों के बारे में ज़्यादा जानें.

- इसमें शामिल नीतियों का उदाहरण: Google के एआई से जुड़े सिद्धांतों की प्रोग्रेस से जुड़ा साल 2023 का अपडेट.

- MLCommons असोसिएशन, इस पर बना एक इंजीनियरिंग कंसोर्टियम सभी के साथ मिलकर काम करने की फ़िलॉसफ़ी, जिसमें एआई सिस्टम को बेहतर बनाया गया है. ऐसे खतरों पर आधारित है जो एआई सुरक्षा पर मॉडल का आकलन करते हैं. एआई की सुरक्षा के मानदंड.

पूरी दुनिया में पारदर्शिता से जुड़े आर्टफ़ैक्ट के लिए कोई एक टेंप्लेट नहीं है इंडस्ट्री, लेकिन मौजूदा मॉडल कार्ड से अपनी क्वेरी बनाने के लिए:

- जेमा का मॉडल कार्ड

- ओरिजनल मॉडल कार्ड पेपर से मॉडल कार्ड टेंप्लेट

- Google Cloud API से मॉडल कार्ड