این جعبه ابزار منابع و ابزارهایی را برای اعمال بهترین شیوه ها برای استفاده مسئولانه از مدل های باز مانند Gemma فراهم می کند، از جمله:

- راهنمای تنظیم سیاست های ایمنی، تنظیم ایمنی، طبقه بندی کننده های ایمنی و ارزیابی مدل.

- ابزار تفسیرپذیری یادگیری برای بررسی و اشکالزدایی رفتار جما در پاسخ به درخواستها.

- مقایسه کننده LLM برای اجرا و تجسم نتایج ارزیابی مقایسه ای.

- روشی برای ساخت طبقهبندیکنندههای ایمنی قوی با حداقل نمونهها.

این نسخه از جعبه ابزار فقط بر روی مدل های متن به متن انگلیسی تمرکز دارد. میتوانید از طریق پیوند مکانیزم بازخورد در پایین صفحه، بازخوردی برای مفیدتر کردن این جعبه ابزار ارائه دهید.

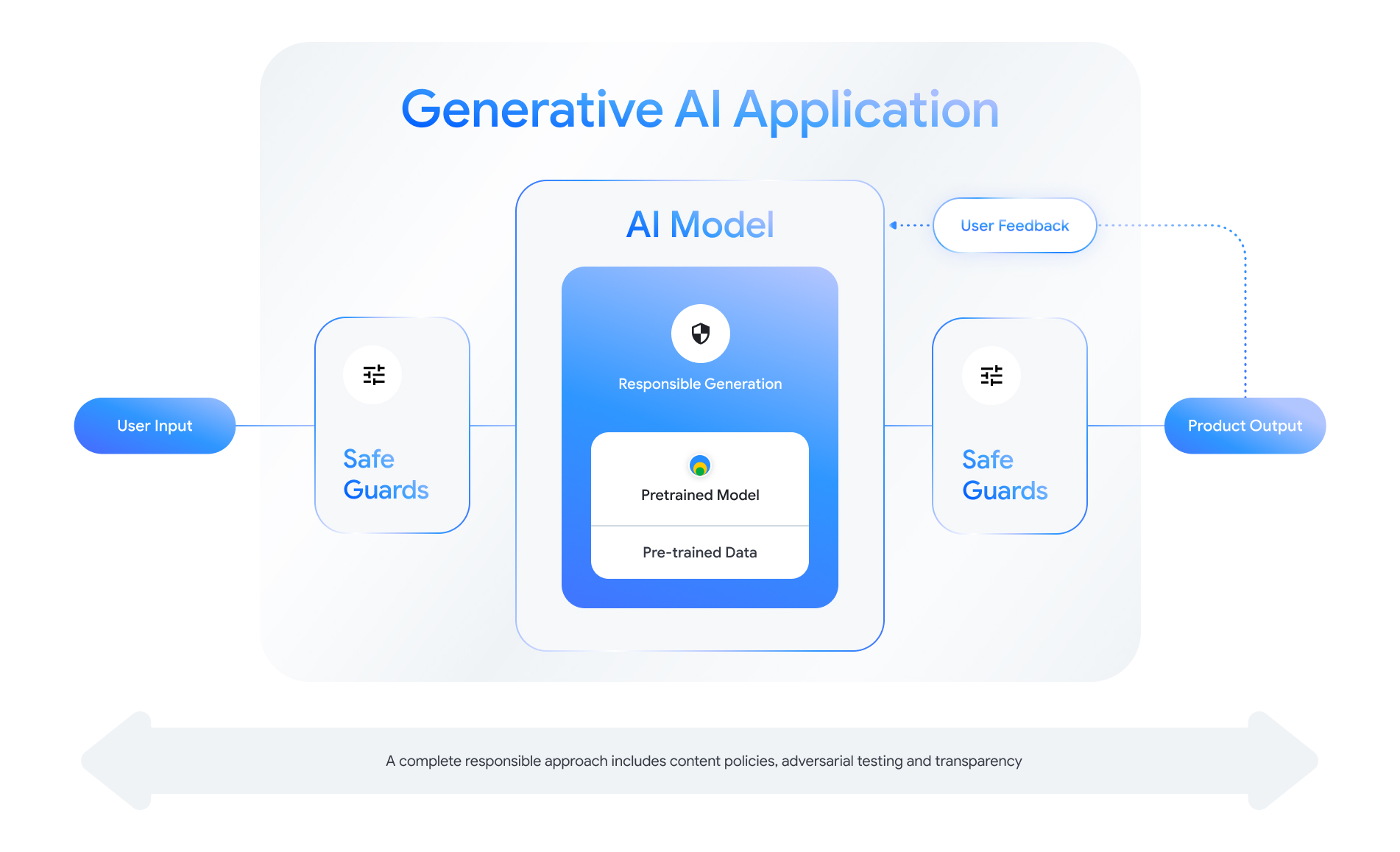

هنگام ساختن با Gemma، باید رویکردی جامع به مسئولیت داشته باشید و تمام چالشهای احتمالی را در سطوح برنامه و مدل در نظر بگیرید. این مجموعه ابزار، تکنیک های ریسک و کاهش را برای رسیدگی به ایمنی، حریم خصوصی، انصاف و مسئولیت پذیری پوشش می دهد.

برای اطلاعات بیشتر و راهنمایی بقیه این جعبه ابزار را بررسی کنید: