Udostępnia on zasoby i narzędzia pozwalające stosować sprawdzone metody odpowiedzialne korzystanie z modeli otwartych, takich jak Gemma, w tym:

- Wskazówki dotyczące ustawiania zasad bezpieczeństwa, dostrajania bezpieczeństwa i klasyfikatorów zabezpieczeń. i weryfikacja modelu.

- narzędzie do analizowania interpretowalności, na debugowanie zachowania Gemmy w odpowiedzi na prompty.

- Narzędzie do porównywania LLM do uruchamiania i wizualizacji procesów porównawczych wyników oceny.

- Metodologia tworzenia niezawodnych klasyfikatorów bezpieczeństwa z minimalną liczbą przykładów.

Ta wersja zestawu narzędzi koncentruje się wyłącznie na modelach zamiany tekstu na tekst w języku angielskim. Ty możemy przesyłać opinie, dzięki którym możemy zwiększyć przydatność tego narzędzia u dołu strony.

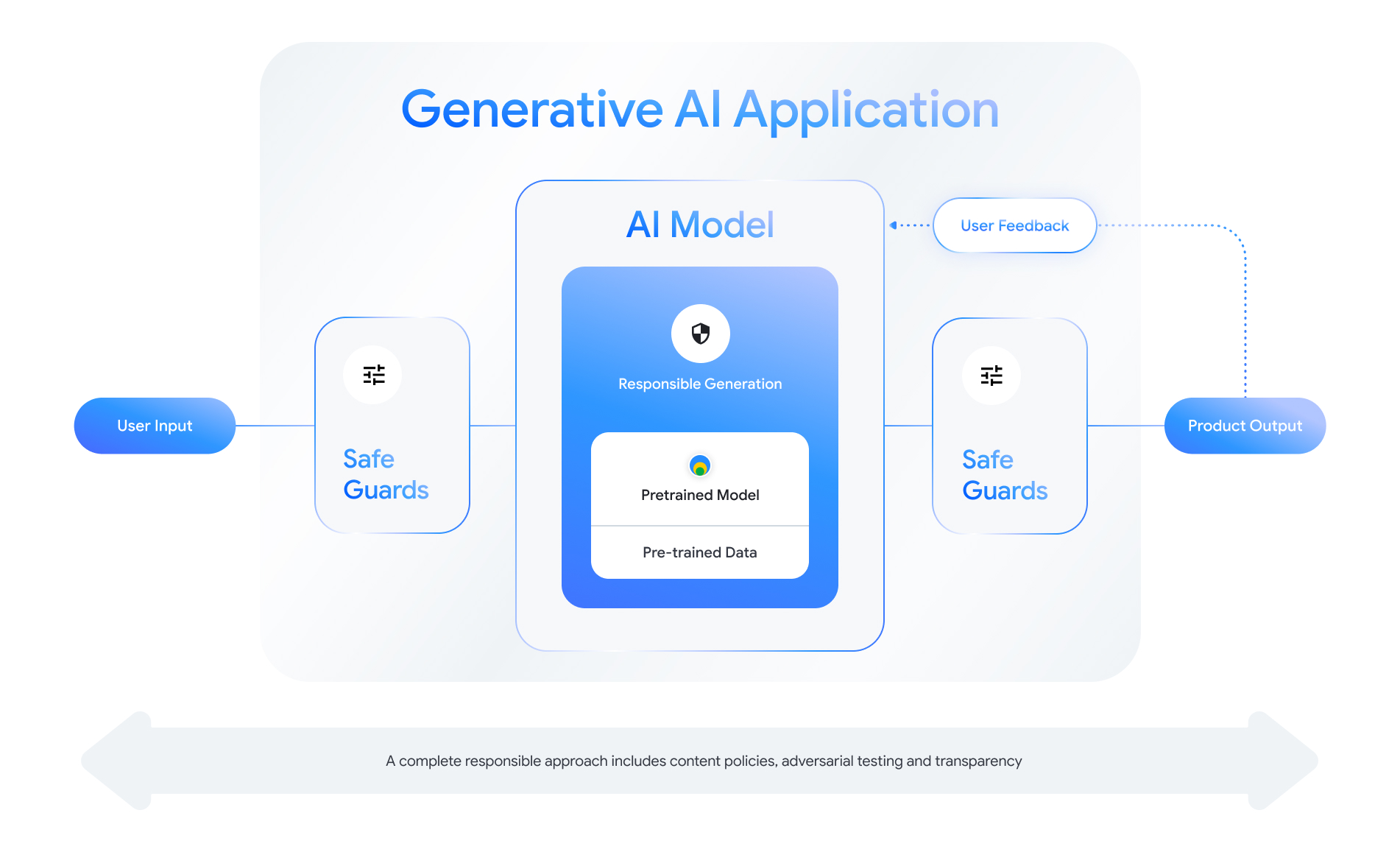

Tworząc treści we współpracy z Gemmą, zastosuj całościowe podejście do odpowiedzialności. i bierzemy pod uwagę wszystkie możliwe wyzwania na poziomach aplikacji i modelu. Obejmuje on techniki minimalizowania ryzyka w zakresie bezpieczeństwa, prywatności, uczciwością i odpowiedzialnością.

Aby uzyskać więcej informacji i wskazówek, zapoznaj się z pozostałą częścią tego zestawu narzędzi: