9 KWIETNIA 2025 R.

Optimal AI korzysta z interfejsu Gemini API, aby skrócić czas weryfikacji kodu o 50%

Sprawdzanie kodu, choć ma kluczowe znaczenie dla jakości, często staje się wąskim gardłem w szybkim procesie tworzenia oprogramowania. Optimal AI to zmienia. Ich misja: „zaoszczędzić czas inżynierów” dzięki wykorzystaniu AI do automatyzacji procesów inżynieryjnych i związanych z przepisami. Ich rozwiązania to m.in. Optibot, czyli narzędzie do weryfikacji kodu oparte na AI, które koncentruje się na bezpieczeństwie i zgodności, oraz platforma do analizy danych oparta na interfejsie Gemini API, która optymalizuje szybkość rozwoju.

Wcześniej Optimal AI miał problemy z szybkością i zrozumieniem kontekstu, które są niezbędne do skutecznego sprawdzania kodu za pomocą AI. „Największym wyzwaniem było zrozumienie kontekstu – potrzebowaliśmy modelu, który potrafiłby analizować zestawy zmian w kodzie i umieszczać je w odpowiednim kontekście” – wyjaśnia Syed Ahmed, współzałożyciel i dyrektor ds. technicznych.

Większa wydajność

Dzięki integracji interfejsu Gemini API firma Optimal AI znacznie rozszerzyła swoją ofertę:

- Zwiększona szybkość i dokładność weryfikacji kodu: Optibot, oparty na interfejsie Gemini API, automatycznie sprawdza żądania scalenia pod kątem luk w zabezpieczeniach, ryzyka związanego z zgodnością i wzorców kodowania, dostarczając praktyczne opinie i znacznie skracając czas weryfikacji.

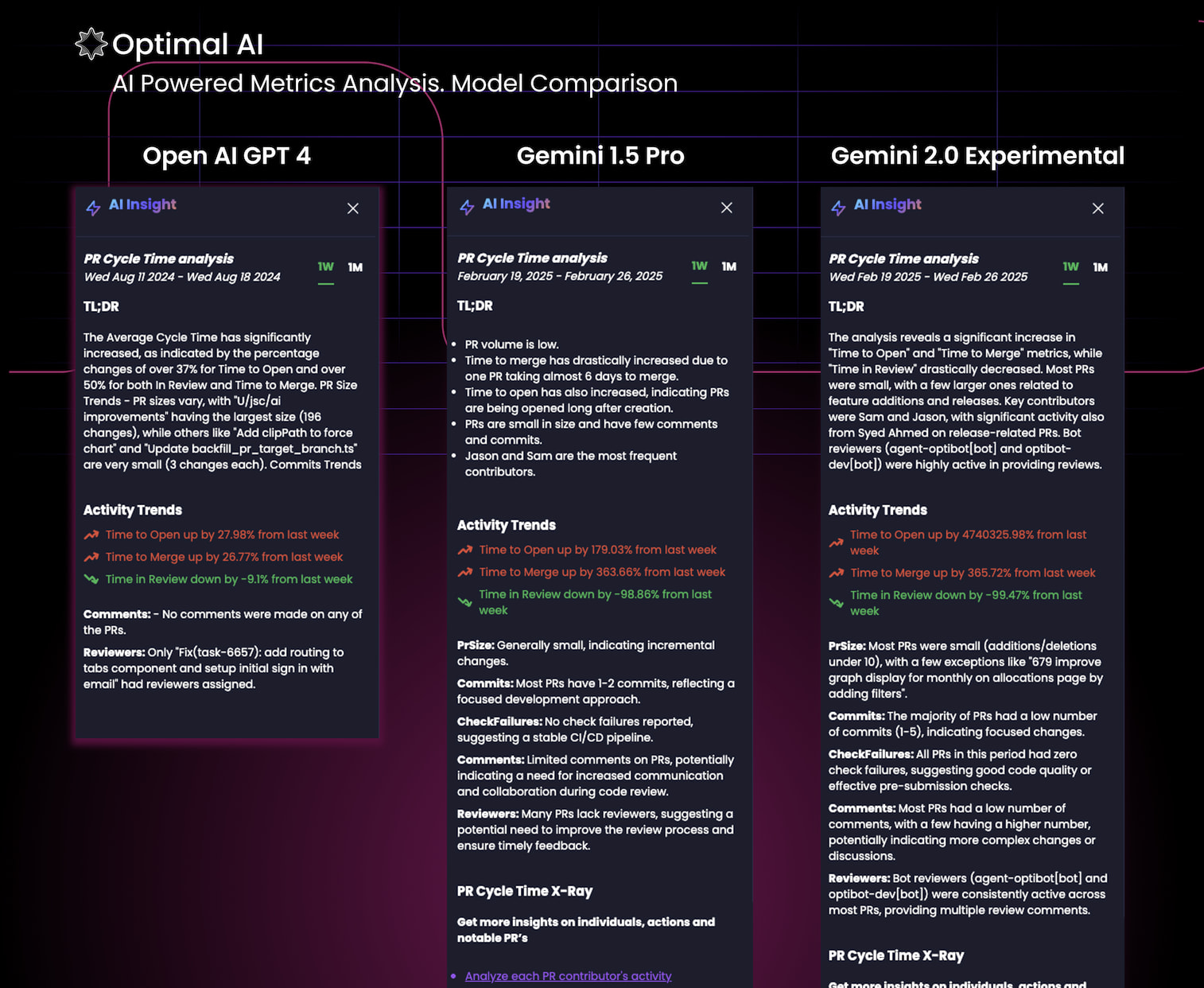

- Wyodrębnianie przydatnych statystyk inżynieryjnych: modele Gemini analizują dane z GitHub i Jira, aby identyfikować wąskie gardła i określać skuteczność inżynieryjną, skutecznie rozróżniając produktywną aktywność od zmian w kodzie.

- Równowaga między szybkością a zaawansowaniem: optymalna AI wykorzystuje Gemini 2.5 Pro do złożonych analiz i dogłębnego zrozumienia kodu, a Gemini 2.0 Flash zapewnia szybkość potrzebną do zadań o niskim poziomie opóźnień, takich jak szybkie podsumowania.

Jak Optimal AI korzysta z interfejsu Gemini API

Wdrożenie Optimal AI pokazuje elastyczność interfejsu Gemini API:

-

Użyte modele:

- Gemini 2.5 Pro: do szczegółowej analizy kodu, sprawdzania bezpieczeństwa, kontekstowych opinii na temat żądań scalenia i identyfikowania złożonych wzorców inżynieryjnych w celu uzyskania informacji o wydajności.

- Gemini 2.0 Flash: do zadań wymagających małych opóźnień, takich jak skanowanie drzewa plików i generowanie szybkich podsumowań.

-

Najważniejsze funkcje i wdrożenie::

- Zrozumienie kontekstu: duże okno kontekstu modeli Gemini ma kluczowe znaczenie dla interpretowania złożonych zmian w kodzie i zrozumienia szerszych wzorców inżynieryjnych.

- Obsługa wielu języków: ulepszona zdolność modeli Gemini do obsługi wielu języków programowania i frameworków była dla Optimal AI znaczącym osiągnięciem.

- Google AI Studio: zespół intensywnie korzysta z Google AI Studio do szybkiego testowania promptów, oceniania modeli i iteracji. „Możliwość wyświetlania wyników obok kodu implementacji znacznie ułatwiła naszym inżynierom przeprowadzanie eksperymentów” – zauważa Ahmed.

Wyniki: szybsze recenzje

Integracja Gemini miała znaczący wpływ na Optimal AI i jej klientów. Najważniejsze wyniki:

- Skrócenie czasu cyklu żądań scalenia o 50%: inżynierowie spędzają mniej czasu na oczekiwaniu na sprawdzenie kodu, a więcej na jego pisaniu.

- Szybkie wdrażanie i rozszerzanie przez klientów: firmy takie jak MongoDB znacznie zwiększyły wykorzystanie Optimal AI po tym, jak przekonały się o jego zaletach. Liczba inżynierów korzystających z tego narzędzia wzrosła z 5 do ponad 40.

- Udane zebranie 2,25 mln USD w ramach rundy finansowania przed zalążkowej: udało się to osiągnąć w prywatnej wersji beta, głównie dzięki popularności i wynikom funkcji opartych na interfejsie Gemini API.

„Zespoły uwielbiają to, że Optibot pomaga im skrócić o połowę czas sprawdzania próśb o scalenie, dzięki czemu inżynierowie mogą poświęcać więcej czasu na pisanie kodu zamiast czekać na zatwierdzenie”, mówi Ahmed.

Co dalej

Firma Optimal AI koncentruje się na rozwijaniu pakietu agentów AI, aby automatyzować jeszcze więcej powtarzalnych zadań. Obecnie pracują nad „Code Radar”, czyli agentem zaprojektowanym do autonomicznego monitorowania, poprawiania i zabezpieczania baz kodu. Syed Ahmed, podsumowując swoją przygodę z interfejsem Gemini API, daje innym deweloperom taką radę:

„Od razu przejdź do Google AI Studio – ma lepsze narzędzia i dokumentację, a eksperymentowanie jest w nim o wiele bardziej efektywne”. Podkreśla też: „W pełni wykorzystaj okno kontekstu modelu Gemini. Dostarczaj modelom jak najwięcej istotnych informacji kontekstowych. Im więcej kontekstu dostarczyliśmy, tym lepsze było rozumowanie AI”.

Sukces Optimal AI pokazuje, jak Gemini API może przekształcić proces tworzenia oprogramowania, umożliwiając zespołom szybsze tworzenie lepszego oprogramowania.

Chcesz zacząć? Zapoznaj się z dokumentacją Gemini API i zacznij korzystać z Google AI Studio już dziś.