LLMs mit LiteRT-LM auf dem Gerät ausführen

Produktionsreifes Open-Source-Inferenz-Framework für leistungsstarke, plattformübergreifende LLM-Bereitstellungen auf Edge-Geräten.

Warum LiteRT-LM?

Plattformübergreifend

LLMs auf Android-, iOS-, Web- und Desktop-Geräten bereitstellen

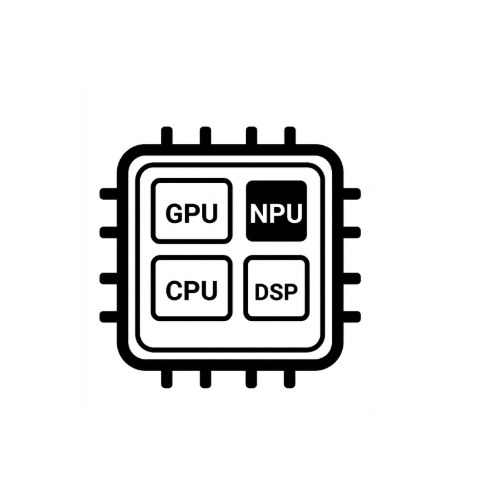

Hardwarebeschleunigt

Leistung mit GPU- und NPU-Beschleunigung maximieren

Umfassende GenAI-Funktionen

Unterstützung für gängige LLMs sowie Multimodalität (Vision, Audio) und Tool Use.

Gleich mit dem Erstellen loslegen

Teil der Community werden

LiteRT-LM auf GitHub

Sie können zum Open-Source-Projekt beitragen, Probleme melden und Beispiele ansehen.

Hugging Face

Laden Sie vorkonvertierte Modelle (Gemma, Qwen und mehr) herunter und beteiligen Sie sich an der Diskussion.

Blogs und Ankündigungen

Mit Gemma 4 können Sie modernste agentische Fähigkeiten an den Edge bringen.

Mit LiteRT-LM können Sie Gemma 4 in der App und auf einer Vielzahl von Geräten mit hervorragender Leistung und Reichweite bereitstellen.

On-Device-GenAI in Chrome, Chromebook Plus und Pixel Watch

Mit LiteRT-LM können Sie Sprachmodelle auf Wearables und browserbasierten Plattformen bereitstellen.

Funktionsaufrufe auf dem Gerät in der Google AI Edge-Galerie

Hier erfahren Sie, wie Sie FunctionGemma optimieren und Funktionsaufruffunktionen aktivieren, die auf LiteRT-LM Tool Use APIs basieren.

Google AI Edge – Small Language Models, Multimodalität und Funktionsaufrufe

Aktuelle Informationen zu RAG, Multimodalität und Funktionsaufrufen für Edge-Sprachmodelle.