הפעלת מודלים של LLM במכשיר באמצעות LiteRT-LM

מסגרת הסקת מסקנות בקוד פתוח שמוכנה לשימוש בסביבת ייצור, ומיועדת לפריסות של מודלים גדולים של שפה (LLM) בפלטפורמות שונות במכשירי קצה, עם ביצועים גבוהים.

למה LiteRT-LM?

פלטפורמות שונות

פריסת מודלים של שפה גדולה ב-Android, ב-iOS, באינטרנט ובמחשב.

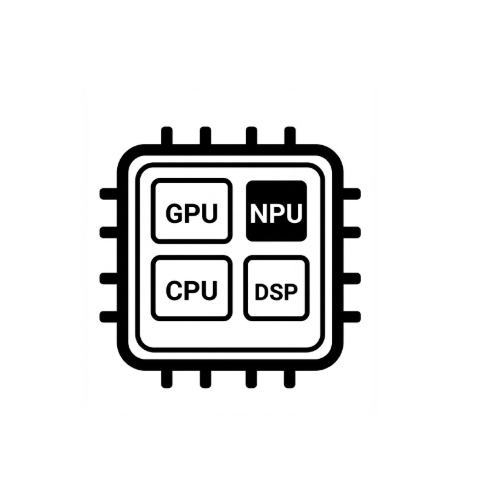

שיפור מהירות באמצעות חומרה

שיפור הביצועים באמצעות האצת GPU ו-NPU.

יכולות רחבות של AI גנרטיבי

תמיכה במודלים פופולריים של LLM, כמו גם במולטי-מודאליות (ראייה, אודיו) ובשימוש בכלי עזר.

אני רוצה להתחיל לפתח

להצטרפות לקהילה

LiteRT-LM ב-GitHub

אפשר לתרום לפרויקט הקוד הפתוח, לדווח על בעיות ולראות דוגמאות.

Hugging Face

אתם יכולים להוריד מודלים שעברו המרה מראש (Gemma, Qwen ועוד) ולהצטרף לדיון.

בלוגים והודעות

עם Gemma 4, אתם יכולים להשתמש ביכולות המתקדמות ביותר של AI אקטיבי.

אפשר לפרוס את Gemma 4 באפליקציה ובמגוון רחב יותר של מכשירים עם ביצועים מעולים ופוטנציאל חשיפה רחב באמצעות LiteRT-LM.

AI גנרטיבי במכשיר ב-Chrome, ב-Chromebook Plus וב-Pixel Watch

פריסת מודלים של שפה במכשירים לבישים ובפלטפורמות מבוססות-דפדפן באמצעות LiteRT-LM בקנה מידה נרחב.

קריאה לפונקציות במכשיר בגלריית Google AI Edge API

במאמר הזה מוסבר איך לבצע כוונון עדין של FunctionGemma ואיך להפעיל יכולות של בקשות להפעלת פונקציות שמבוססות על ממשקי API של LiteRT-LM Tool Use.

מודלים קטנים של שפה (LLM) של Google AI Edge, מולטי-מודאליות וקריאה לפונקציות

תובנות עדכניות לגבי RAG, מולטי-מודאליות ובקשות להפעלת פונקציות במודלים של שפה שפועלים במכשירים.