Chạy LLM trên thiết bị bằng LiteRT-LM

Khung suy luận nguồn mở, sẵn sàng cho sản xuất, được thiết kế để cung cấp các hoạt động triển khai LLM hiệu suất cao, nhiều nền tảng trên các thiết bị biên.

Tại sao nên dùng LiteRT-LM?

Nhiều nền tảng

Triển khai LLM trên Android, iOS, Web và máy tính.

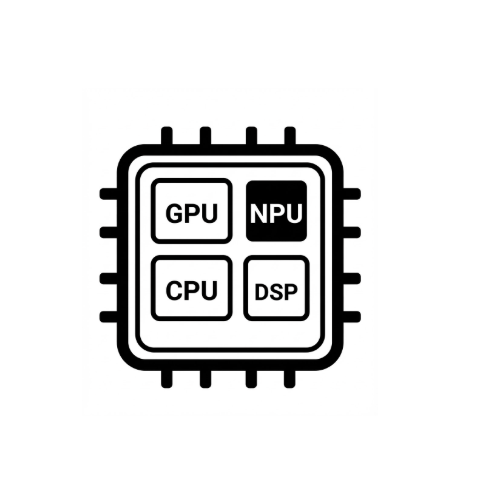

Được tăng tốc bằng phần cứng

Tối đa hoá hiệu suất bằng tính năng tăng tốc GPU và NPU.

Nhiều chức năng AI tạo sinh

Hỗ trợ các LLM phổ biến cũng như đa phương thức (Thị giác, Âm thanh) và Sử dụng công cụ.

Tham gia cộng đồng

LiteRT-LM trên GitHub

Đóng góp cho dự án nguồn mở, báo cáo vấn đề và xem ví dụ.

Khuôn mặt ôm

Tải các mô hình đã chuyển đổi trước (Gemma, Qwen và nhiều mô hình khác) xuống và tham gia thảo luận.

Blog và thông báo

Đưa các kỹ năng của tác nhân AI tiên tiến đến thiết bị biên bằng Gemma 4.

Triển khai Gemma 4 trong ứng dụng và trên nhiều loại thiết bị hơn với hiệu suất và phạm vi tiếp cận vượt trội bằng cách sử dụng LiteRT-LM.

AI tạo sinh trên thiết bị trong Chrome, Chromebook Plus và Pixel Watch

Triển khai mô hình ngôn ngữ trên các nền tảng dựa trên trình duyệt và thiết bị đeo bằng LiteRT-LM ở quy mô lớn.

Tính năng gọi hàm trên thiết bị trong Google AI Edge Gallery

Khám phá cách tinh chỉnh FunctionGemma và bật các chức năng gọi hàm nhờ API Sử dụng công cụ LiteRT-LM.

Mô hình ngôn ngữ nhỏ, đa phương thức và gọi hàm của Google AI Edge

Thông tin chi tiết mới nhất về RAG, tính đa phương thức và tính năng gọi hàm cho các mô hình ngôn ngữ biên.