La tarea del Reconocedor de gestos de MediaPipe te permite reconocer gestos manuales en tiempo real y proporciona los resultados reconocidos de los gestos manuales y los puntos de referencia de las manos detectadas. En estas instrucciones, se muestra cómo usar el Reconocedor de gestos con apps para Android. La muestra de código que se describe en estas instrucciones está disponible en GitHub.

Puedes ver esta tarea en acción si miras la demostración web. Para obtener más información sobre las funciones, los modelos y las opciones de configuración de esta tarea, consulta la descripción general.

Ejemplo de código

El código de ejemplo de MediaPipe Tasks es una implementación simple de una app de Gesture Recognizer para Android. En el ejemplo, se usa la cámara de un dispositivo Android físico para detectar gestos de la mano de forma continua y también se pueden usar imágenes y videos de la galería del dispositivo para detectar gestos de forma estática.

Puedes usar la app como punto de partida para tu propia app para Android o consultarla cuando modifiques una app existente. El código de ejemplo del detector de gestos se aloja en GitHub.

Descarga el código

En las siguientes instrucciones, se muestra cómo crear una copia local del código de ejemplo con la herramienta de línea de comandos git.

Para descargar el código de ejemplo, sigue estos pasos:

- Clona el repositorio de git con el siguiente comando:

git clone https://github.com/google-ai-edge/mediapipe-samples

- De manera opcional, configura tu instancia de git para usar el control de revisión disperso, de modo que solo tengas los archivos de la app de ejemplo de Gesture Recognizer:

cd mediapipe-samples git sparse-checkout init --cone git sparse-checkout set examples/gesture_recognizer/android

Después de crear una versión local del código de ejemplo, puedes importar el proyecto a Android Studio y ejecutar la app. Para obtener instrucciones, consulta la Guía de configuración para Android.

Componentes clave

Los siguientes archivos contienen el código fundamental de esta aplicación de ejemplo de reconocimiento de gestos con la mano:

- GestureRecognizerHelper.kt: Inicializa el reconocedor de gestos y controla el modelo y la selección del delegado.

- MainActivity.kt: Implementa la aplicación, incluida la llamada a

GestureRecognizerHelperyGestureRecognizerResultsAdapter. - GestureRecognizerResultsAdapter.kt: Administra y da formato a los resultados.

Configuración

En esta sección, se describen los pasos clave para configurar tu entorno de desarrollo y codificar proyectos específicamente para usar el Reconocedor de gestos. Si deseas obtener información general sobre cómo configurar tu entorno de desarrollo para usar tareas de MediaPipe, incluidos los requisitos de la versión de la plataforma, consulta la Guía de configuración para Android.

Dependencias

La tarea del Gestor de gestos usa la biblioteca com.google.mediapipe:tasks-vision. Agrega esta dependencia al archivo build.gradle de tu app para Android:

dependencies {

implementation 'com.google.mediapipe:tasks-vision:latest.release'

}

Modelo

La tarea del Reconocedor de gestos de MediaPipe requiere un paquete de modelos entrenados que sea compatible con esta tarea. Para obtener más información sobre los modelos entrenados disponibles para el Reconocedor de gestos, consulta la sección Modelos de la descripción general de la tarea.

Selecciona y descarga el modelo, y guárdalo en el directorio de tu proyecto:

<dev-project-root>/src/main/assets

Especifica la ruta de acceso del modelo dentro del parámetro ModelAssetPath. En el código de ejemplo, el modelo se define en el archivo GestureRecognizerHelper.kt:

baseOptionBuilder.setModelAssetPath(MP_RECOGNIZER_TASK)

Crea la tarea

La tarea del Reconocedor de gestos de MediaPipe usa la función createFromOptions() para configurarla. La función createFromOptions() acepta valores para

las opciones de configuración. Para obtener más información sobre las opciones de configuración, consulta Opciones de configuración.

El Reconocedor de gestos admite 3 tipos de datos de entrada: imágenes fijas, archivos de video y transmisiones de video en vivo. Cuando crees la tarea, debes especificar el modo de ejecución correspondiente a tu tipo de datos de entrada. Elige la pestaña correspondiente a tu tipo de datos de entrada para ver cómo crear la tarea y ejecutar la inferencia.

Imagen

val baseOptionsBuilder = BaseOptions.builder().setModelAssetPath(MP_RECOGNIZER_TASK)

val baseOptions = baseOptionBuilder.build()

val optionsBuilder =

GestureRecognizer.GestureRecognizerOptions.builder()

.setBaseOptions(baseOptions)

.setMinHandDetectionConfidence(minHandDetectionConfidence)

.setMinTrackingConfidence(minHandTrackingConfidence)

.setMinHandPresenceConfidence(minHandPresenceConfidence)

.setRunningMode(RunningMode.IMAGE)

val options = optionsBuilder.build()

gestureRecognizer =

GestureRecognizer.createFromOptions(context, options)

Video

val baseOptionsBuilder = BaseOptions.builder().setModelAssetPath(MP_RECOGNIZER_TASK)

val baseOptions = baseOptionBuilder.build()

val optionsBuilder =

GestureRecognizer.GestureRecognizerOptions.builder()

.setBaseOptions(baseOptions)

.setMinHandDetectionConfidence(minHandDetectionConfidence)

.setMinTrackingConfidence(minHandTrackingConfidence)

.setMinHandPresenceConfidence(minHandPresenceConfidence)

.setRunningMode(RunningMode.VIDEO)

val options = optionsBuilder.build()

gestureRecognizer =

GestureRecognizer.createFromOptions(context, options)

Transmisión en vivo

val baseOptionsBuilder = BaseOptions.builder().setModelAssetPath(MP_RECOGNIZER_TASK)

val baseOptions = baseOptionBuilder.build()

val optionsBuilder =

GestureRecognizer.GestureRecognizerOptions.builder()

.setBaseOptions(baseOptions)

.setMinHandDetectionConfidence(minHandDetectionConfidence)

.setMinTrackingConfidence(minHandTrackingConfidence)

.setMinHandPresenceConfidence(minHandPresenceConfidence)

.setResultListener(this::returnLivestreamResult)

.setErrorListener(this::returnLivestreamError)

.setRunningMode(RunningMode.LIVE_STREAM)

val options = optionsBuilder.build()

gestureRecognizer =

GestureRecognizer.createFromOptions(context, options)

La implementación del código de ejemplo del Reconocedor de gestos permite al usuario cambiar entre los modos de procesamiento. El enfoque hace que el código de creación de tareas sea más complicado y es posible que no sea adecuado para tu caso de uso. Puedes ver este código en la función setupGestureRecognizer() del archivo GestureRecognizerHelper.kt.

Opciones de configuración

Esta tarea tiene las siguientes opciones de configuración para apps para Android:

| Nombre de la opción | Descripción | Rango de valores | Valor predeterminado | |

|---|---|---|---|---|

runningMode |

Establece el modo de ejecución de la tarea. Existen tres modos: IMAGE: Es el modo para entradas de una sola imagen. VIDEO: Es el modo para los fotogramas decodificados de un video. LIVE_STREAM: Es el modo de transmisión en vivo de datos de entrada, como los de una cámara. En este modo, se debe llamar a resultListener para configurar un objeto de escucha que reciba resultados de forma asíncrona. |

{IMAGE, VIDEO, LIVE_STREAM} |

IMAGE |

|

numHands |

GestureRecognizer puede detectar la cantidad máxima de manos.

|

Any integer > 0 |

1 |

|

minHandDetectionConfidence |

Es la puntuación de confianza mínima para que la detección de la mano se considere exitosa en el modelo de detección de la palma. | 0.0 - 1.0 |

0.5 |

|

minHandPresenceConfidence |

Es la puntuación de confianza mínima de la puntuación de presencia de la mano en el modelo de detección de puntos de referencia de la mano. En el modo de video y en el modo de transmisión en vivo del Reconocedor de gestos, si la puntuación de confianza de la presencia de la mano del modelo de punto de referencia de la mano está por debajo de este umbral, se activa el modelo de detección de palmas. De lo contrario, se usa un algoritmo de seguimiento de manos ligero para determinar la ubicación de las manos para la detección de puntos de referencia posterior. | 0.0 - 1.0 |

0.5 |

|

minTrackingConfidence |

Es la puntuación de confianza mínima para que el seguimiento de manos se considere exitoso. Este es el umbral de IoU del cuadro de límite entre las manos en el fotograma actual y el último. En el modo de video y el modo de transmisión del Reconocedor de gestos, si el seguimiento falla, el Reconocedor de gestos activa la detección de la mano. De lo contrario, se omite la detección de manos. | 0.0 - 1.0 |

0.5 |

|

cannedGesturesClassifierOptions |

Son opciones para configurar el comportamiento del clasificador de gestos predefinidos. Los gestos predeterminados son ["None", "Closed_Fist", "Open_Palm", "Pointing_Up", "Thumb_Down", "Thumb_Up", "Victory", "ILoveYou"]. |

|

|

|

customGesturesClassifierOptions |

Son opciones para configurar el comportamiento del clasificador de gestos personalizados. |

|

|

|

resultListener |

Establece el objeto de escucha de resultados para que reciba los resultados de la clasificación de forma asíncrona cuando el reconocedor de gestos esté en el modo de transmisión en vivo.

Solo se puede usar cuando el modo de ejecución está configurado como LIVE_STREAM. |

ResultListener |

N/A | N/A |

errorListener |

Establece un objeto de escucha de errores opcional. | ErrorListener |

N/A | N/A |

Preparar los datos

El Reconocedor de gestos funciona con imágenes, archivos de video y videos de transmisión en vivo. La tarea controla el procesamiento previo de la entrada de datos, incluido el cambio de tamaño, la rotación y la normalización de valores.

En el siguiente código, se muestra cómo transferir datos para su procesamiento. Estos ejemplos incluyen detalles sobre cómo controlar los datos de imágenes, archivos de video y transmisiones de video en vivo.

Imagen

import com.google.mediapipe.framework.image.BitmapImageBuilder import com.google.mediapipe.framework.image.MPImage // Convert the input Bitmap object to an MPImage object to run inference val mpImage = BitmapImageBuilder(image).build()

Video

import com.google.mediapipe.framework.image.BitmapImageBuilder import com.google.mediapipe.framework.image.MPImage val argb8888Frame = if (frame.config == Bitmap.Config.ARGB_8888) frame else frame.copy(Bitmap.Config.ARGB_8888, false) // Convert the input Bitmap object to an MPImage object to run inference val mpImage = BitmapImageBuilder(argb8888Frame).build()

Transmisión en vivo

import com.google.mediapipe.framework.image.BitmapImageBuilder import com.google.mediapipe.framework.image.MPImage // Convert the input Bitmap object to an MPImage object to run inference val mpImage = BitmapImageBuilder(rotatedBitmap).build()

En el código de ejemplo del Reconocedor de gestos, la preparación de datos se controla en el archivo GestureRecognizerHelper.kt.

Ejecuta la tarea

El Reconocedor de gestos usa las funciones recognize, recognizeForVideo y recognizeAsync para activar inferencias. En el caso del reconocimiento de gestos, esto implica el procesamiento previo de los datos de entrada, la detección de manos en la imagen, la detección de puntos de referencia de la mano y el reconocimiento de gestos de la mano a partir de los puntos de referencia.

En el siguiente código, se muestra cómo ejecutar el procesamiento con el modelo de tareas. Estas muestras incluyen detalles sobre cómo controlar los datos de imágenes, archivos de video y transmisiones de video en vivo.

Imagen

val result = gestureRecognizer?.recognize(mpImage)

Video

val timestampMs = i * inferenceIntervalMs gestureRecognizer?.recognizeForVideo(mpImage, timestampMs) ?.let { recognizerResult -> resultList.add(recognizerResult) }

Transmisión en vivo

val mpImage = BitmapImageBuilder(rotatedBitmap).build()

val frameTime = SystemClock.uptimeMillis()

gestureRecognizer?.recognizeAsync(mpImage, frameTime)

Ten en cuenta lo siguiente:

- Cuando se ejecuta en el modo de video o en el modo de transmisión en vivo, también debes proporcionar la marca de tiempo del fotograma de entrada a la tarea del Reconocedor de gestos.

- Cuando se ejecuta en la imagen o en el modo de video, la tarea del detector de gestos bloqueará el subproceso actual hasta que termine de procesar la imagen o el fotograma de entrada. Para evitar bloquear la interfaz de usuario, ejecuta el procesamiento en un subproceso en segundo plano.

- Cuando se ejecuta en el modo de transmisión en vivo, la tarea del detector de gestos no bloquea el subproceso actual, sino que se muestra de inmediato. Invocará su objeto de escucha de resultados con el resultado del reconocimiento cada vez que termine de procesar una trama de entrada. Si se llama a la función de reconocimiento cuando la tarea del Reconocedor de gestos está ocupada procesando otro fotograma, la tarea ignorará el nuevo fotograma de entrada.

En el código de ejemplo del Gestor de gestos, las funciones recognize, recognizeForVideo y recognizeAsync se definen en el archivo GestureRecognizerHelper.kt.

Cómo controlar y mostrar los resultados

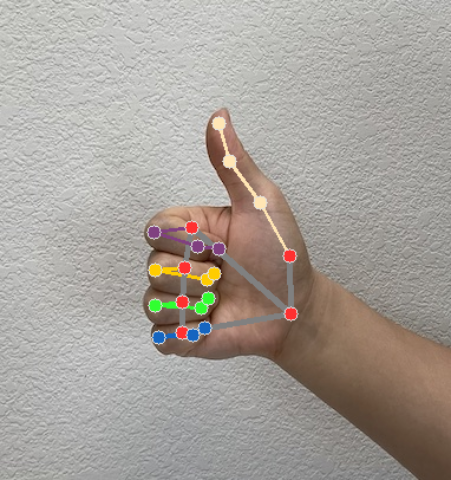

El Gesto Recognizer genera un objeto de resultado de detección de gestos para cada ejecución de reconocimiento. El objeto resultante contiene puntos de referencia de la mano en coordenadas de imagen, puntos de referencia de la mano en coordenadas mundiales, lateralidad(mano izquierda o derecha) y categorías de gestos de la mano de las manos detectadas.

A continuación, se muestra un ejemplo de los datos de resultado de esta tarea:

El GestureRecognizerResult resultante contiene cuatro componentes, y cada componente es un array, en el que cada elemento contiene el resultado detectado de una sola mano detectada.

Lateralidad

La mano dominante indica si las manos detectadas son izquierda o derecha.

Gestos

Las categorías de gestos reconocidas de las manos detectadas.

Puntos de referencia

Hay 21 puntos de referencia de la mano, cada uno compuesto por coordenadas

x,yyz. Las coordenadasxyyse normalizan a [0.0, 1.0] según el ancho y la altura de la imagen, respectivamente. La coordenadazrepresenta la profundidad del punto de referencia, y la profundidad en la muñeca es el origen. Cuanto menor sea el valor, más cerca estará el punto de referencia de la cámara. La magnitud dezusa aproximadamente la misma escala quex.Monumentos universales

Los 21 puntos de referencia de la mano también se presentan en coordenadas mundiales. Cada punto de referencia se compone de

x,yyz, que representan coordenadas 3D del mundo real en metros con el origen en el centro geométrico de la mano.

GestureRecognizerResult:

Handedness:

Categories #0:

index : 0

score : 0.98396

categoryName : Left

Gestures:

Categories #0:

score : 0.76893

categoryName : Thumb_Up

Landmarks:

Landmark #0:

x : 0.638852

y : 0.671197

z : -3.41E-7

Landmark #1:

x : 0.634599

y : 0.536441

z : -0.06984

... (21 landmarks for a hand)

WorldLandmarks:

Landmark #0:

x : 0.067485

y : 0.031084

z : 0.055223

Landmark #1:

x : 0.063209

y : -0.00382

z : 0.020920

... (21 world landmarks for a hand)

En las siguientes imágenes, se muestra una visualización del resultado de la tarea:

En el código de ejemplo del Gestor de gestos, la clase GestureRecognizerResultsAdapter del archivo GestureRecognizerResultsAdapter.kt controla los resultados.