Tugas Pengenal Gestur MediaPipe memungkinkan Anda mengenali gestur tangan secara real time, dan memberikan hasil gestur tangan yang dikenali serta penanda tangan dari tangan yang terdeteksi. Petunjuk ini menunjukkan cara menggunakan Pengenal Gestur dengan aplikasi Android. Contoh kode yang dijelaskan dalam petunjuk ini tersedia di GitHub.

Anda dapat melihat cara kerja tugas ini dengan melihat demo web. Untuk informasi selengkapnya tentang kemampuan, model, dan opsi konfigurasi tugas ini, lihat Ringkasan.

Contoh kode

Kode contoh MediaPipe Tasks adalah implementasi sederhana dari aplikasi Pengenal Gestur untuk Android. Contoh ini menggunakan kamera di perangkat Android fisik untuk terus mendeteksi gestur tangan, dan juga dapat menggunakan gambar dan video dari galeri perangkat untuk mendeteksi gestur secara statis.

Anda dapat menggunakan aplikasi ini sebagai titik awal untuk aplikasi Android Anda sendiri, atau merujuknya saat mengubah aplikasi yang ada. Kode contoh Pengenal Gestur dihosting di GitHub.

Mendownload kode

Petunjuk berikut menunjukkan cara membuat salinan lokal contoh kode menggunakan alat command line git.

Untuk mendownload kode contoh:

- Clone repositori git menggunakan perintah berikut:

git clone https://github.com/google-ai-edge/mediapipe-samples

- Secara opsional, konfigurasikan instance git Anda untuk menggunakan checkout jarang,

sehingga Anda hanya memiliki file untuk aplikasi contoh Pengenal Gestur:

cd mediapipe-samples git sparse-checkout init --cone git sparse-checkout set examples/gesture_recognizer/android

Setelah membuat versi lokal kode contoh, Anda dapat mengimpor project ke Android Studio dan menjalankan aplikasi. Untuk mendapatkan petunjuk, lihat Panduan Penyiapan untuk Android.

Komponen utama

File berikut berisi kode penting untuk aplikasi contoh pengenalan gestur tangan ini:

- GestureRecognizerHelper.kt - Melakukan inisialisasi pengenal gestur dan menangani model serta pemilihan delegasi.

- MainActivity.kt -

Mengimplementasikan aplikasi, termasuk memanggil

GestureRecognizerHelperdanGestureRecognizerResultsAdapter. - GestureRecognizerResultsAdapter.kt - Menangani dan memformat hasil.

Penyiapan

Bagian ini menjelaskan langkah-langkah utama untuk menyiapkan lingkungan pengembangan dan project kode Anda secara khusus untuk menggunakan Pengenal Gestur. Untuk informasi umum tentang menyiapkan lingkungan pengembangan untuk menggunakan tugas MediaPipe, termasuk persyaratan versi platform, lihat Panduan penyiapan untuk Android.

Dependensi

Tugas Pengenal Gestur menggunakan library

com.google.mediapipe:tasks-vision. Tambahkan dependensi ini ke file build.gradle aplikasi Android Anda:

dependencies {

implementation 'com.google.mediapipe:tasks-vision:latest.release'

}

Model

Tugas MediaPipe Gesture Recognizer memerlukan paket model terlatih yang kompatibel dengan tugas ini. Untuk informasi selengkapnya tentang model terlatih yang tersedia untuk Pengenal Gestur, lihat bagian Model ringkasan tugas.

Pilih dan download model, lalu simpan dalam direktori project Anda:

<dev-project-root>/src/main/assets

Tentukan jalur model dalam parameter ModelAssetPath. Dalam

kode contoh,

model ditentukan dalam file

GestureRecognizerHelper.kt:

baseOptionBuilder.setModelAssetPath(MP_RECOGNIZER_TASK)

Membuat tugas

Tugas Pengenal Gestur MediaPipe menggunakan fungsi createFromOptions() untuk menyiapkan

tugas. Fungsi createFromOptions() menerima nilai untuk opsi konfigurasi. Untuk informasi selengkapnya tentang opsi konfigurasi,

lihat Opsi konfigurasi.

Pengenal Gestur mendukung 3 jenis data input: gambar diam, file video, dan streaming video live. Anda harus menentukan mode operasi yang sesuai dengan jenis data input saat membuat tugas. Pilih tab yang sesuai dengan jenis data input Anda untuk melihat cara membuat tugas dan menjalankan inferensi.

Gambar

val baseOptionsBuilder = BaseOptions.builder().setModelAssetPath(MP_RECOGNIZER_TASK)

val baseOptions = baseOptionBuilder.build()

val optionsBuilder =

GestureRecognizer.GestureRecognizerOptions.builder()

.setBaseOptions(baseOptions)

.setMinHandDetectionConfidence(minHandDetectionConfidence)

.setMinTrackingConfidence(minHandTrackingConfidence)

.setMinHandPresenceConfidence(minHandPresenceConfidence)

.setRunningMode(RunningMode.IMAGE)

val options = optionsBuilder.build()

gestureRecognizer =

GestureRecognizer.createFromOptions(context, options)

Video

val baseOptionsBuilder = BaseOptions.builder().setModelAssetPath(MP_RECOGNIZER_TASK)

val baseOptions = baseOptionBuilder.build()

val optionsBuilder =

GestureRecognizer.GestureRecognizerOptions.builder()

.setBaseOptions(baseOptions)

.setMinHandDetectionConfidence(minHandDetectionConfidence)

.setMinTrackingConfidence(minHandTrackingConfidence)

.setMinHandPresenceConfidence(minHandPresenceConfidence)

.setRunningMode(RunningMode.VIDEO)

val options = optionsBuilder.build()

gestureRecognizer =

GestureRecognizer.createFromOptions(context, options)

Live stream

val baseOptionsBuilder = BaseOptions.builder().setModelAssetPath(MP_RECOGNIZER_TASK)

val baseOptions = baseOptionBuilder.build()

val optionsBuilder =

GestureRecognizer.GestureRecognizerOptions.builder()

.setBaseOptions(baseOptions)

.setMinHandDetectionConfidence(minHandDetectionConfidence)

.setMinTrackingConfidence(minHandTrackingConfidence)

.setMinHandPresenceConfidence(minHandPresenceConfidence)

.setResultListener(this::returnLivestreamResult)

.setErrorListener(this::returnLivestreamError)

.setRunningMode(RunningMode.LIVE_STREAM)

val options = optionsBuilder.build()

gestureRecognizer =

GestureRecognizer.createFromOptions(context, options)

Penerapan kode contoh Pengenal Gestur memungkinkan pengguna beralih antara

mode pemrosesan. Pendekatan ini membuat kode pembuatan tugas menjadi lebih rumit dan

mungkin tidak sesuai untuk kasus penggunaan Anda. Anda dapat melihat kode ini dalam

fungsi setupGestureRecognizer() di

file

GestureRecognizerHelper.kt.

Opsi konfigurasi

Tugas ini memiliki opsi konfigurasi berikut untuk aplikasi Android:

| Nama Opsi | Deskripsi | Rentang Nilai | Nilai Default | |

|---|---|---|---|---|

runningMode |

Menetapkan mode berjalan untuk tugas. Ada tiga

mode: GAMBAR: Mode untuk input gambar tunggal. VIDEO: Mode untuk frame video yang didekode. LIVE_STREAM: Mode untuk live stream data input, seperti dari kamera. Dalam mode ini, resultListener harus dipanggil untuk menyiapkan pemroses guna menerima hasil secara asinkron. |

{IMAGE, VIDEO, LIVE_STREAM} |

IMAGE |

|

numHands |

Jumlah maksimum tangan dapat dideteksi oleh

GestureRecognizer.

|

Any integer > 0 |

1 |

|

minHandDetectionConfidence |

Skor keyakinan minimum agar deteksi tangan dianggap berhasil dalam model deteksi telapak tangan. | 0.0 - 1.0 |

0.5 |

|

minHandPresenceConfidence |

Skor keyakinan minimum dari skor kehadiran tangan dalam model deteksi penanda tangan. Dalam mode Video dan mode Live stream Pengenal Gestur, jika skor keyakinan kehadiran tangan dari model penanda tangan berada di bawah ambang batas ini, skor tersebut akan memicu model deteksi telapak tangan. Jika tidak, algoritma pelacakan tangan ringan akan digunakan untuk menentukan lokasi tangan untuk deteksi penanda berikutnya. | 0.0 - 1.0 |

0.5 |

|

minTrackingConfidence |

Skor keyakinan minimum agar pelacakan tangan dianggap berhasil. Ini adalah nilai minimum IoU kotak pembatas antara tangan dalam frame saat ini dan frame terakhir. Dalam mode Video dan mode Streaming Pengenal Gestur, jika pelacakan gagal, Pengenal Gestur akan memicu deteksi tangan. Jika tidak, deteksi tangan akan dilewati. | 0.0 - 1.0 |

0.5 |

|

cannedGesturesClassifierOptions |

Opsi untuk mengonfigurasi perilaku pengklasifikasi gestur standar. Gestur standar adalah ["None", "Closed_Fist", "Open_Palm", "Pointing_Up", "Thumb_Down", "Thumb_Up", "Victory", "ILoveYou"] |

|

|

|

customGesturesClassifierOptions |

Opsi untuk mengonfigurasi perilaku pengklasifikasi gestur kustom. |

|

|

|

resultListener |

Menetapkan pemroses hasil untuk menerima hasil klasifikasi secara asinkron saat pengenal gestur berada dalam mode live stream.

Hanya dapat digunakan jika mode berjalan disetel ke LIVE_STREAM |

ResultListener |

T/A | T/A |

errorListener |

Menetapkan pemroses error opsional. | ErrorListener |

T/A | T/A |

Menyiapkan data

Pengenal Gestur berfungsi dengan gambar, file video, dan video live stream. Tugas ini menangani pra-pemrosesan input data, termasuk pengubahan ukuran, rotasi, dan normalisasi nilai.

Kode berikut menunjukkan cara menyerahkan data untuk diproses. Contoh ini mencakup detail tentang cara menangani data dari gambar, file video, dan streaming video live.

Gambar

import com.google.mediapipe.framework.image.BitmapImageBuilder import com.google.mediapipe.framework.image.MPImage // Convert the input Bitmap object to an MPImage object to run inference val mpImage = BitmapImageBuilder(image).build()

Video

import com.google.mediapipe.framework.image.BitmapImageBuilder import com.google.mediapipe.framework.image.MPImage val argb8888Frame = if (frame.config == Bitmap.Config.ARGB_8888) frame else frame.copy(Bitmap.Config.ARGB_8888, false) // Convert the input Bitmap object to an MPImage object to run inference val mpImage = BitmapImageBuilder(argb8888Frame).build()

Live stream

import com.google.mediapipe.framework.image.BitmapImageBuilder import com.google.mediapipe.framework.image.MPImage // Convert the input Bitmap object to an MPImage object to run inference val mpImage = BitmapImageBuilder(rotatedBitmap).build()

Dalam

kode contoh Pengenal Gestur, persiapan data ditangani dalam

file

GestureRecognizerHelper.kt.

Menjalankan tugas

Pengenal Gestur menggunakan fungsi recognize, recognizeForVideo, dan recognizeAsync

untuk memicu inferensi. Untuk pengenalan gestur, hal ini melibatkan

prapemrosesan data input, mendeteksi tangan dalam gambar, mendeteksi penanda tangan, dan mengenali gestur tangan dari penanda.

Kode berikut menunjukkan cara menjalankan pemrosesan dengan model tugas. Contoh ini mencakup detail tentang cara menangani data dari gambar, file video, dan streaming video live.

Gambar

val result = gestureRecognizer?.recognize(mpImage)

Video

val timestampMs = i * inferenceIntervalMs gestureRecognizer?.recognizeForVideo(mpImage, timestampMs) ?.let { recognizerResult -> resultList.add(recognizerResult) }

Live stream

val mpImage = BitmapImageBuilder(rotatedBitmap).build()

val frameTime = SystemClock.uptimeMillis()

gestureRecognizer?.recognizeAsync(mpImage, frameTime)

Perhatikan hal berikut:

- Saat berjalan dalam mode video atau mode live stream, Anda juga harus memberikan stempel waktu frame input ke tugas Pengenal Gestur.

- Saat berjalan dalam mode gambar atau video, tugas Pengenal Gestur akan memblokir thread saat ini hingga selesai memproses gambar atau frame input. Untuk menghindari pemblokiran antarmuka pengguna, jalankan pemrosesan di thread latar belakang.

- Saat berjalan dalam mode live stream, tugas Pengenal Gestur tidak memblokir thread saat ini, tetapi segera ditampilkan. Fungsi ini akan memanggil pemroses hasil dengan hasil pengenalan setiap kali selesai memproses frame input. Jika fungsi pengenalan dipanggil saat tugas Pengenal Gestur sibuk memproses frame lain, tugas akan mengabaikan frame input baru.

Dalam

kode contoh Pengenal Gestur, fungsi recognize, recognizeForVideo, dan

recognizeAsync ditentukan dalam

file

GestureRecognizerHelper.kt.

Menangani dan menampilkan hasil

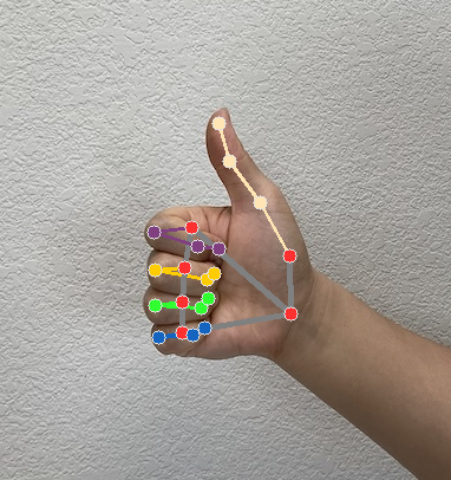

Pengenal Gestur menghasilkan objek hasil deteksi gestur untuk setiap pengenalan yang dijalankan. Objek hasil berisi penanda tangan dalam koordinat gambar, penanda tangan dalam koordinat dunia, tangan dominan(tangan kiri/kanan), dan kategori gestur tangan dari tangan yang terdeteksi.

Berikut adalah contoh data output dari tugas ini:

GestureRecognizerResult yang dihasilkan berisi empat komponen, dan setiap komponen adalah array, dengan setiap elemen berisi hasil deteksi dari satu tangan yang terdeteksi.

Tangan dominan

Kecenderungan tangan menunjukkan apakah tangan yang terdeteksi adalah tangan kiri atau kanan.

Gestur

Kategori gestur yang dikenali dari tangan yang terdeteksi.

Tempat terkenal

Ada 21 penanda tangan, masing-masing terdiri dari koordinat

x,y, danz. Koordinatxdanydinormalisasi ke [0,0, 1,0] berdasarkan lebar dan tinggi gambar. Koordinatzmewakili kedalaman penanda, dengan kedalaman di pergelangan tangan sebagai asal. Makin kecil nilainya, makin dekat penanda ke kamera. Besarzmenggunakan skala yang kira-kira sama denganx.Landmark Dunia

21 penanda tangan juga ditampilkan dalam koordinat dunia. Setiap penanda geografis terdiri dari

x,y, danz, yang mewakili koordinat 3D dunia nyata dalam meter dengan asal di pusat geometris tangan.

GestureRecognizerResult:

Handedness:

Categories #0:

index : 0

score : 0.98396

categoryName : Left

Gestures:

Categories #0:

score : 0.76893

categoryName : Thumb_Up

Landmarks:

Landmark #0:

x : 0.638852

y : 0.671197

z : -3.41E-7

Landmark #1:

x : 0.634599

y : 0.536441

z : -0.06984

... (21 landmarks for a hand)

WorldLandmarks:

Landmark #0:

x : 0.067485

y : 0.031084

z : 0.055223

Landmark #1:

x : 0.063209

y : -0.00382

z : 0.020920

... (21 world landmarks for a hand)

Gambar berikut menunjukkan visualisasi output tugas:

Dalam

kode contoh Pengenal Gestur, class GestureRecognizerResultsAdapter dalam

file

GestureRecognizerResultsAdapter.kt menangani hasilnya.