Uygulamanıza üretken yapay zeka eklemek, uygulamanıza devasa bir güç ve değer katabilir. ancak aynı zamanda gizlilik ve güvenlik konusunda çok dikkatli yardımcı olur.

Güvenliği temel alan tasarım

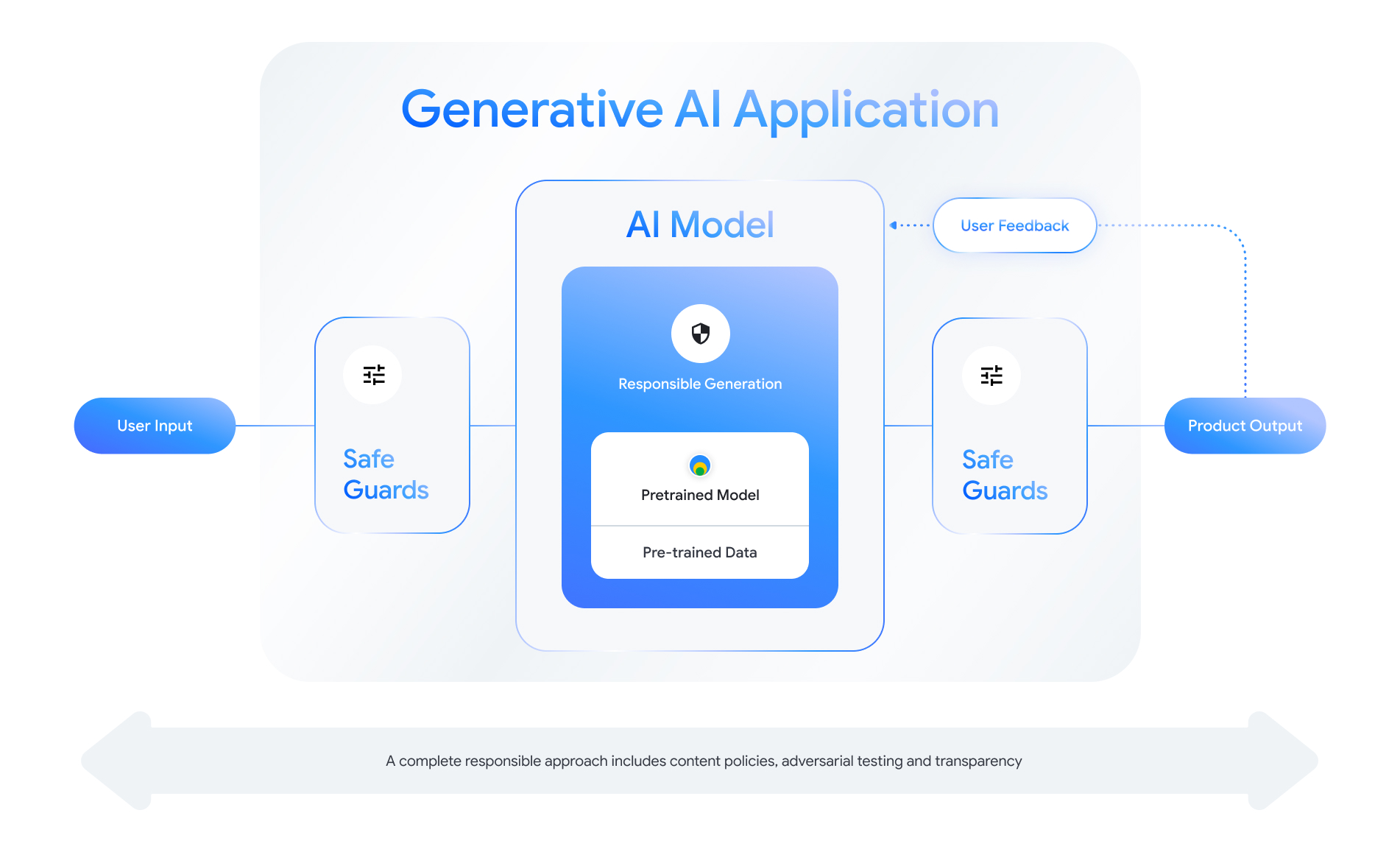

Üretken yapay zekanın etkinleştirildiği her özellik, güvenlik katmanları tasarlama fırsatları sunar. Farklı şekilde gösterildiği üzere, güvenlik üzerine düşünebileceğiniz bir yol, Merkezde bu özelliği etkinleştiren yapay zeka modeli. Bu model şu özelliklere sahip olmalıdır:

- Atanan görevi yerine getirmek için uyumlu;

- Sınırların dışına çıkması için güvenlik önlemleriyle korunur giriş ve çıkışların reddedilmesi; ve

- Modelin ve Google Ads'in performansını değerlendirmek için bütün olarak değerlendirilir nasıl tepki vereceğini kestirmeye çalışın.

Şu bölüme göz atın: "Sorumlu Yapay Zeka Ürünleri Oluşturma" oturumu Google I/O 2024'te tasarım hakkında önemli noktalar, düşünce alıştırmaları, becerilerinizi geliştirmenize yardımcı olabilecek prototip yöntemleri ve yöntemler kullanarak inceleyebilirsiniz.

Ayrıca, en iyi uygulamaları öğrenebilir ve aşağıdakilerle ilgili örnekler görebilirsiniz:

- Yapay zekanın davranış biçimini yönetecek politikaları tanımlamak uygulamanız;

- İletişim kurmak için şeffaflık yapıları oluşturma kullanıcılarınıza karşı sorumlu yaklaşımınız; ve

- Uygulamanızı kötü amaçlı kullanıma karşı koruma altına alma.

Hepsinden önemlisi, güvenlik ve sorumluluk konusunda sağlam bir yaklaşımın ve teknik, kültürel ve sürece uyum sağlayabilen, kendini yansıtan, meydan okumalara değineceğiz. Kendinizi ve ekibinizi düzenli olarak eleştirel incelemeler yaparak, en iyi sonuçları elde etmek için müzakere tekniği de sunar.

Sistem düzeyinde politikalar tanımlayın

İçerik güvenliği politikaları, hangi zararlı içerik türlerine izin verilmediğini tanımlar online bir platformda çalışır. Platformların içerik politikalarına aşina olabilirsiniz. (ör. YouTube veya Google Play) İçerik üretken yapay zeka uygulamalarına yönelik politikalar benzerdir: Bu politikaların ne tür bir uygulamanızın oluşturmaması gereken içerikleri gösterir ve modellerin nasıl inceleneceğini gösterir. ve hangi uygun güvenlik önlemlerinin ekleneceğini belirler.

Politikalarınız uygulamanızın kullanım alanını yansıtmalıdır. Örneğin, Üretken yapay zeka ürünü topluluk önerilerinin, aşağıdakilerin türetmesini yasaklayan bir politikası olabilir: kullanıcılar için zararlı olabileceği için doğası gereği şiddet barındıran içerikler. Öte yandan kullanıcıların önerdiği bilim kurgu hikayesi fikirlerini özetleyen şiddetin oluşturulmasına izin vermek istiyoruz. Çünkü, daha fazla bilgi edineceksiniz.

Güvenlik politikalarınız, zararlı içeriklerin oluşturulmasını yasaklamalıdır kullanıcılara göstermeli ve oluşturulan içerik türlerinin ne tür içeriklerin bu çubuğa da göz atabilirsiniz. Ayrıca, riskleri azaltmak için Eğitsel, belgesel, bilimsel veya sanatsal bağlama sahip içerikler için Aksi takdirde zararlı olarak kabul edilebilir.

Aşağıdakiler dahil olmak üzere son derece ayrıntılı bir ayrıntı düzeyiyle net politikalar tanımlamak, örneklerle açıklamak, sorumlu bir şekilde hareket etmenin belirler. Politikalarınız, model geliştirme sürecinizin her adımında kullanılır. Veriler için verilerin doğru etiketlenmemesi, verilerin yanlış etiketlenmesine, aşırı kaldırılmaya veya Bu durum, modelinizin güvenlikle ilgili yanıtlarını etkileyecek verilerin kaldırılmamasıdır. Örneğin, olması nedeniyle, kötü tanımlanmış politikalar, değerlendiriciler arası modelinizin güvenliğinizi karşılayıp karşılamadığını anlamayı zorlaştırabilir. yardımcı olur.

Varsayımsal politikalar (yalnızca açıklama amaçlıdır)

Aşağıda, işletmeniz için kullanabileceğiniz politikalarla ilgili bazı örnekler verilmiştir: kullanım alanınızla aynı olması şartıyla

| Politika kategorisi | Politika |

|---|---|

| Hassas Kimlik Bilgileri (SPII) | Uygulama, hassas ve kimliği tanımlayabilecek bilgiler içermez bilgiler (ör. e-posta, kredi kartı numarası veya vatandaşlık numarası) |

| Nefret Söylemi | Uygulama olumsuz veya zararlı içerik oluşturmayacak kimliği ve/veya korunan özellikleri hedefleyen (ör. ırkçı hakaretler, ayrımcılığın teşvik edilmesi, koruma altındaki kişilere karşı şiddete çağrı grupları) kullanabilirsiniz. |

| Taciz | Uygulama, kötü amaçlı, göz korkutucu, zorbalık içeren veya veya kötüye kullanım amaçlı içerik (ör. fiziksel tehditler, trajik olayların inkar edilmesi, mağdurları küçümseme şiddet). |

| Tehlikeli İçerikler | Uygulama, kullanıcılara zarar verme ile ilgili talimatlar veya tavsiye oluşturmaz. kendisi ve/veya başkaları (ör. ateşli silahlara erişmek veya ateşli silahlar üretmek ve patlayıcı cihazlar, terörizmi teşvik etme, intihar). |

| Müstehcen | Uygulama, cinsel eylemler veya diğer müstehcen içerik (ör. cinsel içerikli sansürsüz) açıklamalar, uyarılma amaçlı içerikler). |

| Zararlı Ürün ve Hizmetlere Erişim Sağlama | Uygulama, tanıtım veya imkân sunan hiçbir içeriği Potansiyel olarak zararlı ürünlere, hizmetlere ve etkinliklere erişim (ör. kumar, ilaç, şirket gibi ürünlerin tanıtımını yapan havai fişekler, cinsel hizmetler). |

| Kötü Amaçlı İçerik | Uygulama, yasa dışı işlemler gerçekleştirmek için talimat oluşturmayacak veya yanıltıcı etkinlikler (ör. kimlik avı dolandırıcılığı, spam veya (toplu olarak teşvike yönelik içerikler, yazılımı kırma yöntemleri) için geçerlidir. |

Şeffaflık yapıları

Belgeleme, geliştiriciler açısından şeffaflığın anahtarıdır. resmi kurumlar, politika aktörleri ve ürününüzün son kullanıcıları. Buna şunlar dahildir: ayrıntılı teknik raporlar veya model, veri ve sistem kartları yayınlayarak kamuya açık olan temel bilgileri güvenlik ve başka modellere dayalı olarak uygun şekilde değerlendirmeleridir. Şeffaflık eserleri iletişim araçlarından çok daha fazlasıdır; onlar yapay zeka araştırmacıları, dağıtımcılar ve aşağı akış geliştiricileri için de sorumlu bir şekilde kullanılmasıdır. Bu bilgiler Google Apps'ın son kullanıcıları için modelle ilgili ayrıntıları anlamak isteyen kişilere de hitap edebilirsiniz.

Göz önünde bulundurulması gereken bazı şeffaflık yönergeleri:

- Deneysel bir sürümle etkileşime giren kullanıcılara karşı net olun üretken yapay zeka teknolojisini ve beklenmedik modellerin mümkün olduğunu vurgular. gösterir.

- Üretken yapay zeka hizmeti veya ürününün anlaşılır bir dil kullanarak çalışır. Yapılandırılmış bir yayın oluşturun şeffaflık yapıları gibi. Bu kartlar sayesinde kullanma amacınız doğrultusunda belirleyebilir ve geçmişte yapılan değerlendirmeleri model geliştirme süreci boyunca gerçekleşen tüm sonuçlar.

- Kullanıcılara nasıl geri bildirim verebileceklerini ve kontrolün nasıl ellerinde olduklarını gösterin

yön:

- Kullanıcıların gerçeğe dayalı soruları doğrulamasına yardımcı olacak mekanizmalar sağlama

- Kullanıcı geri bildirimi için beğenme ve beğenme simgeleri

- Sorunları bildirme ve hızlı yanıt için destek sunma bağlantıları kullanıcı geri bildirimi

- Kullanıcı etkinliğini depolamak veya silmek için kullanıcı denetimi

Güvenli Yapay Zeka Sistemleri

Üretken yapay zeka destekli uygulamalar karmaşık saldırı yüzeyleri sunar. Bu durum, geleneksel uygulamalara göre daha fazla çeşitlilik içeren çözümleri gerektirebilir. Google'ın Güvenli Yapay Zeka Çerçevesi (SAIF), Google'ın Üretken yapay zeka destekli uygulamanızı nasıl tasarlayacağınızı ele alan kavramsal çerçeve güvenli kullanımlar için sunar. Bu çerçeve, ekibinizi nasıl uygulayacağınızı uyumsuzluk, zıt değerlendirme ve uygulamanızın güvenliğini sağlamaya yardımcı olmak için etkili bir şekilde tehlikeye atılır, Ancak bunların yalnızca başlangıç noktaları olduğunu unutmayın. Ek değişiklikler izleme ve uyarılar sürecin gerekli olduğundan kullanım alanınız ve bağlamınız için güvenlik hedeflerinize ulaşmanıza yardımcı olabilir.

Geliştirici kaynakları

Üretken yapay zeka politikalarına örnekler:

- Cloud Gemini API ve PaLM API, kullanıcı güvenliğini sağlamak için temel oluşturabilecek güvenlik özelliklerinin listesi politikalar.

- 2023 Google Yapay Zeka İlkeleri İlerleme Durumu Güncellemesi.

- Temelinde bir mühendislik konsorsiyumu olan MLCommons Derneği yapay zeka sistemlerini iyileştirmek için açık işbirliği felsefesi, referans 6 bir parçası olarak yapay zeka güvenliği ile ilgili modelleri değerlendirdikleri Yapay Zeka Güvenlik Karşılaştırması.

Şeffaflık yapıları için tek bir şablon yoktur Ancak mevcut model kartları, başlangıç noktası olarak kendi şablonunuzu oluşturun:

- Gemma'nın model kartı

- Orijinal model kart kağıdından alınan model kart şablonu

- Google Cloud API'lerinden alınan model kartları