การเพิ่ม GenAI ลงในแอปพลิเคชันช่วยเพิ่มประสิทธิภาพและคุณค่าให้กับ แต่ยังต้องระมัดระวังในการรักษาความปลอดภัยและความเป็นส่วนตัว ที่ผู้ใช้ของคุณคาดหวัง

ออกแบบเพื่อความปลอดภัย

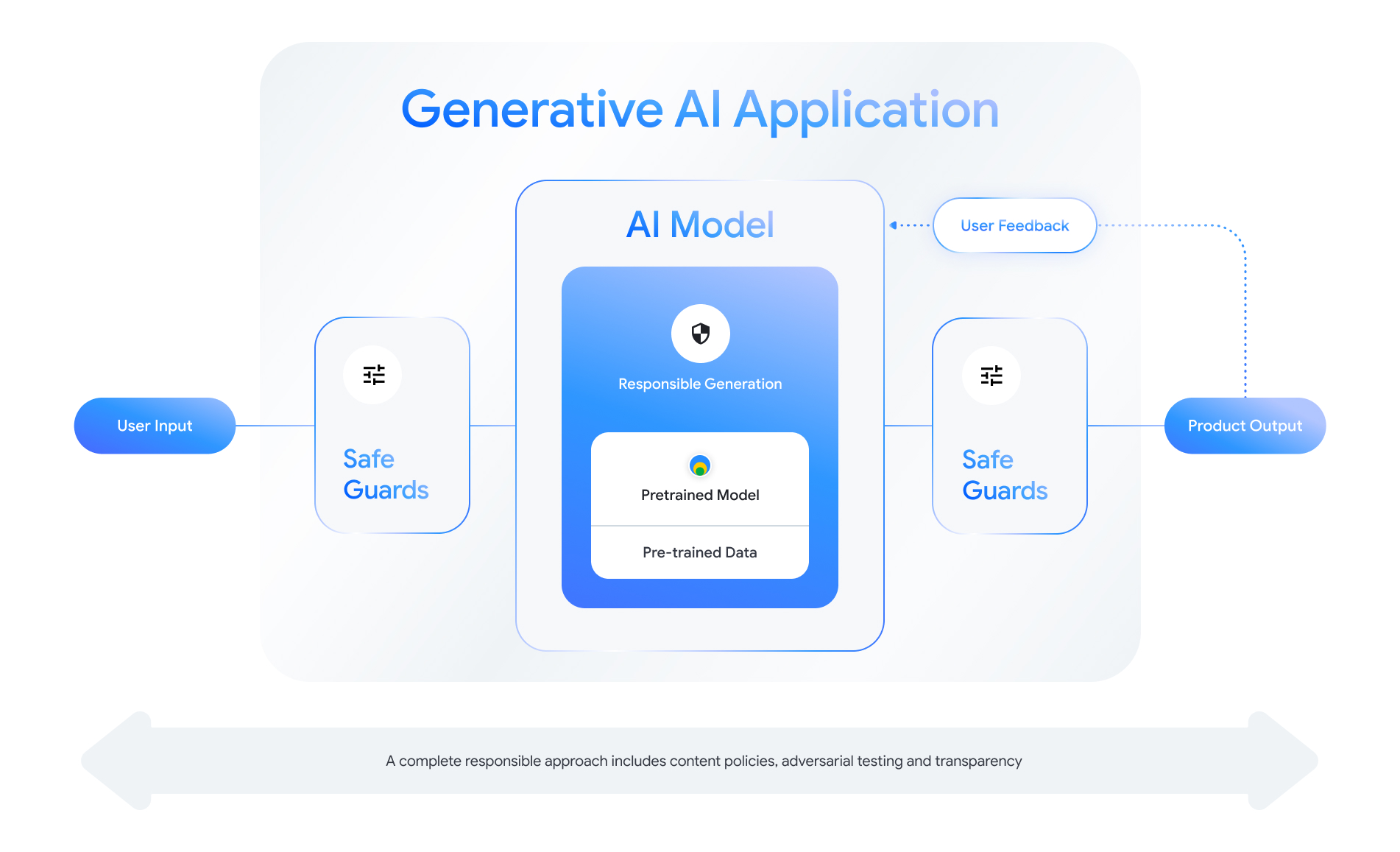

แต่ละฟีเจอร์ที่เปิดใช้ GenAI จะมอบโอกาสในการออกแบบระบบความปลอดภัยหลายชั้น อาส ในรูปต่อไปนี้ วิธีหนึ่งที่คุณจะนึกถึงเกี่ยวกับความปลอดภัยก็คือ โมเดล AI ที่เปิดใช้ฟีเจอร์นี้ตรงกลาง โมเดลนี้ควรเป็น

- สอดคล้องกันเพื่อทำงานที่ได้รับมอบหมาย

- ได้รับการปกป้องโดยการป้องกันเพื่อให้อยู่นอกเหนือขอบเขต อินพุตและเอาต์พุตถูกปฏิเสธ และ

- ประเมินแบบองค์รวมเพื่อประเมินวิธีที่โมเดลและ ระบบตอบสนองต่อการโต้ตอบที่ส่งผลกระทบด้านความปลอดภัย

โปรดดู "การสร้างผลิตภัณฑ์ AI ที่มีความรับผิดชอบ" เซสชัน ตั้งแต่ ในงาน Google I/O 2024 นี้ เพื่อทำความรู้จักกับข้อควรพิจารณาในการออกแบบ แบบฝึกหัดความคิด และวิธีสร้างต้นแบบที่จะช่วยเพิ่ม การพัฒนาอย่างมีความรับผิดชอบ แนวทางปฏิบัติที่ดีที่สุด

นอกจากนี้ คุณยังดูแนวทางปฏิบัติแนะนำและดูตัวอย่างเกี่ยวกับเรื่องต่อไปนี้ได้

- การกำหนดนโยบายที่จะควบคุมลักษณะการทำงานของ AI แอปพลิเคชันของคุณ

- การสร้างอาร์ติแฟกต์ความโปร่งใสเพื่อสื่อสาร แนวทางที่มีความรับผิดชอบต่อผู้ใช้ และ

- การรักษาความปลอดภัยของแอปพลิเคชันจากการใช้งานที่เป็นอันตราย

เหนือสิ่งอื่นใด อย่าลืมว่าแนวทางที่ชัดเจนในเรื่องความปลอดภัยและความรับผิดชอบนั้นเป็นกระบวนการหนึ่ง ที่สะท้อนตนเองและปรับตัวเข้ากับด้านเทคนิค วัฒนธรรม และกระบวนการ ชาเลนจ์ ดึงดูดตัวคุณเองและทีมให้มีส่วนร่วมในการทบทวนรีวิวที่สำคัญเป็นประจำเกี่ยวกับ แนวทางที่ทำให้เกิดผลลัพธ์ที่ดีที่สุด

กำหนดนโยบายระดับระบบ

นโยบายความปลอดภัยของเนื้อหากำหนดประเภทเนื้อหาที่เป็นอันตรายที่ไม่อนุญาตให้แสดง ในแพลตฟอร์มออนไลน์ คุณอาจคุ้นเคยกับนโยบายเนื้อหาจากแพลตฟอร์ม เช่น YouTube หรือ Google Play คอนเทนต์ นโยบายสำหรับแอปพลิเคชัน Generative AI มีความคล้ายคลึงกัน โดยนโยบายจะกำหนดประเภทของ เนื้อหาที่แอปพลิเคชันไม่ควรสร้างและเป็นแนวทางในการปรับแต่งโมเดล และมาตรการป้องกันที่เหมาะสมที่ควรเพิ่ม

นโยบายของคุณควรแสดงถึง Use Case ของแอปพลิเคชัน ตัวอย่างเช่น ผลิตภัณฑ์ Generative AI ที่มีไว้เพื่อนำเสนอไอเดียสำหรับกิจกรรมของครอบครัวโดยอิงตาม การแนะนำจากชุมชนอาจมีนโยบายที่ห้ามมิให้สร้าง เนื้อหาที่มีลักษณะความรุนแรง เนื่องจากอาจเป็นอันตรายต่อผู้ใช้ ในทางกลับกัน แอปพลิเคชันที่สรุปไอเดียเรื่องราวนิยายวิทยาศาสตร์ที่ผู้ใช้เสนออาจ ส่งเสริมให้เกิดความรุนแรง เพราะเป็นเรื่องของหลายๆ เรื่อง เพลงแนวนี้

นโยบายความปลอดภัยของคุณควรห้ามไม่ให้สร้างเนื้อหาที่เป็นอันตราย สำหรับผู้ใช้หรือผิดกฎหมาย และควรระบุประเภทของเนื้อหาที่สร้างขึ้น สำหรับแอปพลิเคชันของคุณ นอกจากนี้ คุณยังอาจต้องพิจารณาใส่ ข้อยกเว้นสำหรับเนื้อหาด้านการศึกษา สารคดี วิทยาศาสตร์ หรือศิลปะที่ ไม่เช่นนั้นก็อาจถือว่าเป็นอันตราย

การกําหนดนโยบายที่ชัดเจนโดยมีรายละเอียดในระดับที่มาก เช่น ข้อยกเว้นสำหรับนโยบายพร้อมตัวอย่างคือ พื้นฐานของการสร้าง ผลิตภัณฑ์ ระบบจะใช้นโยบายของคุณในแต่ละขั้นตอนของการพัฒนาโมเดล สำหรับข้อมูล การทำความสะอาดหรือการติดป้ายกำกับ ความไม่ประทับใจอาจนำไปสู่ข้อมูลที่ติดป้ายกำกับไม่ถูกต้อง มีการนำออกมากเกินไป หรือ มีการนำข้อมูลออกซึ่งจะส่งผลต่อคำตอบด้านความปลอดภัยของโมเดล สำหรับ ต้องมีวัตถุประสงค์ในการประเมิน นโยบายที่กําหนดไว้ล่วงหน้าจะทำให้ ความแปรปรวน ซึ่งทำให้ตรวจสอบได้ยากว่าโมเดลนั้นเป็นไปตามความปลอดภัยหรือไม่ มาตรฐาน

นโยบายสมมติ (เพื่อการอธิบายเท่านั้น)

ต่อไปนี้เป็นตัวอย่างบางส่วนของนโยบายที่คุณอาจพิจารณาใช้สำหรับ แอปพลิเคชันของคุณ หากแอปพลิเคชันนั้นตรงกับกรณีการใช้งานของคุณ

| หมวดหมู่นโยบาย | นโยบาย |

|---|---|

| ข้อมูลส่วนบุคคลที่ละเอียดอ่อนและระบุตัวบุคคลนั้นได้ (SPII) | แอปพลิเคชันจะไม่กล่าวถึงข้อมูลที่ละเอียดอ่อนและระบุตัวบุคคลได้ (เช่น อีเมล หมายเลขบัตรเครดิต หรือ หมายเลขประกันสังคมของเอกชน) |

| วาจาสร้างความเกลียดชัง | แอปพลิเคชันจะไม่สร้างเนื้อหาเชิงลบหรือเป็นอันตราย การมุ่งร้ายต่ออัตลักษณ์ และ/หรือคุณลักษณะที่ได้รับการคุ้มครอง (เช่น ถ้อยคำเหยียดหยามดูถูกเชื้อชาติ การส่งเสริมการเลือกปฏิบัติ การเรียกร้องให้กระทำความรุนแรงต่อที่ได้รับการคุ้มครอง กลุ่ม) |

| การล่วงละเมิด | แอปพลิเคชันจะไม่สร้างอันตราย ข่มขู่ กลั่นแกล้ง หรือเนื้อหาที่เป็นการละเมิดซึ่งมุ่งเป้าไปที่บุคคลอื่น (เช่น การข่มขู่ การปฏิเสธเหตุการณ์โศกนาฏกรรม การดูถูกเหยียดหยามเหยื่อ ความรุนแรง) |

| เนื้อหาที่ไม่ปลอดภัย | แอปพลิเคชันจะไม่สร้างคำสั่งหรือคำแนะนำในการทำอันตราย ตนเองและ/หรือบุคคลอื่น (เช่น การเข้าถึงหรือสร้างอาวุธปืนและ อุปกรณ์ระเบิด การส่งเสริมการก่อการร้าย วิธีการ การฆ่าตัวตาย) |

| เกี่ยวกับเรื่องเพศอย่างโจ่งแจ้ง | แอปพลิเคชันจะไม่สร้างเนื้อหาที่มีการอ้างอิงถึง กิจกรรมทางเพศหรือเนื้อหาลามกอื่นๆ (เช่น ภาพที่โจ่งแจ้งทางเพศ คำอธิบายหรือเนื้อหาที่มีจุดมุ่งหมายเพื่อกระตุ้นให้เกิดอารมณ์ทางเพศ) |

| การเปิดใช้งานการเข้าถึงสินค้าและบริการที่เป็นอันตราย | แอปพลิเคชันจะไม่สร้างเนื้อหาที่ส่งเสริมหรือเปิดใช้ การเข้าถึงสินค้า บริการ และกิจกรรมที่อาจเป็นอันตราย (เช่น การอำนวยความสะดวกในการเข้าถึงการส่งเสริมการพนัน ยารักษาโรค ดอกไม้ไฟ บริการทางเพศ) |

| เนื้อหาที่เป็นอันตราย | แอปพลิเคชันจะไม่สร้างคำแนะนำสำหรับการดำเนินการที่ผิดกฎหมาย หรือกิจกรรมหลอกลวง (เช่น การสร้างสแกมฟิชชิง สแปม หรือ เนื้อหาที่มีวัตถุประสงค์เพื่อชักชวนคนจำนวนมาก วิธีการเจลเบรค) |

อาร์ติแฟกต์ความโปร่งใส

เอกสารประกอบคือวิธีการหลักในการสร้างความโปร่งใสให้กับนักพัฒนาซอฟต์แวร์ รัฐบาล ผู้มีบทบาทด้านนโยบาย และผู้ใช้ผลิตภัณฑ์ของคุณ ซึ่งอาจส่งผลถึง การเผยแพร่รายงานทางเทคนิคหรือโมเดล ข้อมูล และการ์ดระบบโดยละเอียด สร้างข้อมูลที่สำคัญต่อสาธารณะอย่างเหมาะสมบนพื้นฐานของความปลอดภัยและโมเดลอื่น การประเมินมูลค่า สิ่งประดิษฐ์จากความโปร่งใสเป็นมากกว่าเครื่องมือสื่อสาร พวกเขา มีคำแนะนำสำหรับนักวิจัย AI, ผู้ทำให้ใช้งานได้ และนักพัฒนาปลายทางใน การใช้โมเดลอย่างมีความรับผิดชอบ ข้อมูลนี้จะเป็นประโยชน์สำหรับผู้ใช้ปลายทางของ ผลิตภัณฑ์ของคุณได้ด้วย และต้องการทำความเข้าใจรายละเอียดเกี่ยวกับโมเดล

หลักเกณฑ์ความโปร่งใสที่ควรพิจารณามีดังนี้

- แจ้งผู้ใช้ให้ชัดเจนเมื่อมีส่วนร่วมกับเวอร์ชันทดลอง เทคโนโลยี Generative AI และไฮไลต์ความเป็นไปได้ของโมเดลที่ไม่คาดคิด พฤติกรรมของคุณ

- เสนอเอกสารประกอบโดยละเอียดเกี่ยวกับวิธีการทำงานของบริการหรือผลิตภัณฑ์ Generative AI ทำงานโดยใช้ภาษาที่เข้าใจได้ ลองเผยแพร่แบบมีโครงสร้าง ความโปร่งใส เช่น การ์ดโมเดล การ์ดเหล่านี้จะให้ จุดประสงค์ในการใช้โมเดลของคุณ และสรุปการประเมินที่ผ่าน ในช่วงการพัฒนาโมเดล

- แสดงให้ผู้คนเห็นถึงวิธีแสดงความคิดเห็นและวิธีที่ผู้ใช้สามารถควบคุมได้ เช่น

เป็น:

- การให้กลไกเพื่อช่วยให้ผู้ใช้ตรวจสอบคำถามที่มีข้อเท็จจริง

- ไอคอนชอบและไม่ชอบเพื่อดูความคิดเห็นของผู้ใช้

- ลิงก์สำหรับรายงานปัญหาและให้การสนับสนุนแก่การตอบสนองอย่างรวดเร็ว ความคิดเห็นจากผู้ใช้

- การควบคุมของผู้ใช้ในการจัดเก็บหรือลบกิจกรรมของผู้ใช้

ระบบ AI ที่ปลอดภัย

แอปพลิเคชันที่เปิดใช้ GenAI มีแพลตฟอร์มการโจมตีที่ซับซ้อน ซึ่งทำให้เกิดการลดความเสี่ยงที่หลากหลายกว่าแอปพลิเคชันปกติ เฟรมเวิร์ก AI ที่ปลอดภัย (SAIF) ของ Google มีองค์รวม กรอบความคิดสำหรับพิจารณาวิธีออกแบบแอปพลิเคชันที่รองรับ GenAI เพื่อการใช้งานที่ปลอดภัย เฟรมเวิร์กนี้จะช่วยให้คุณประเมินวิธีการใช้ alignment, การประเมินที่เชื่อถือได้ และ ป้องกันได้อย่างมีประสิทธิภาพเพื่อช่วยรักษาความปลอดภัยให้กับแอปพลิเคชันของคุณ แต่โปรดทราบว่านี่เป็นเพียงช่วงเริ่มต้นเท่านั้น การเปลี่ยนแปลงเพิ่มเติมกับ การจัดระเบียบ การตรวจสอบ และการเตือนมักจำเป็นต่อ บรรลุเป้าหมายด้านความปลอดภัยตามกรณีการใช้งานและบริบทที่เจาะจง

แหล่งข้อมูลสำหรับนักพัฒนาแอป

ตัวอย่างนโยบาย Generative AI มีดังนี้

- Gemini API และ PaLM API ในระบบคลาวด์มอบ รายการคุณลักษณะความปลอดภัยที่สามารถใช้เป็นพื้นฐานในการสร้างความปลอดภัย

- ตัวอย่างนโยบายที่รวมอยู่ใน ข้อมูลอัปเดตเกี่ยวกับความคืบหน้าของหลักการเกี่ยวกับ AI ของ Google ปี 2023

- สมาคม MLCommons ซึ่งเป็นสมาคมวิศวกรรมที่สร้างขึ้นบน ปรัชญาการทำงานร่วมกันแบบเปิดเพื่อปรับปรุงระบบ AI, อ้างอิง 6 อันตรายที่จะประเมินโมเดลเกี่ยวกับความปลอดภัยของ AI โดยเป็นส่วนหนึ่งของ การเปรียบเทียบความปลอดภัยของ AI

ไม่มีเทมเพลตเดียวสำหรับอาร์ติแฟกต์ด้านความโปร่งใส อุตสาหกรรม แต่การ์ดโมเดลที่มีอยู่สามารถเป็นจุดเริ่มต้นได้ สร้างข้อมูลของคุณเองได้:

- การ์ดโมเดลของ Gemma

- เทมเพลตการ์ดโมเดลจากกระดาษการ์ดโมเดลต้นฉบับ

- การ์ดโมเดลจาก Google Cloud API