Запускайте LLM-модули на устройстве с помощью LiteRT-LM.

Готовая к использованию в производственных условиях платформа вывода с открытым исходным кодом, разработанная для обеспечения высокопроизводительного кроссплатформенного развертывания LLM на периферийных устройствах.

Почему именно LiteRT-LM?

Кросс-платформенный

Внедряйте LLM-приложения на платформах Android, iOS, Web и Desktop.

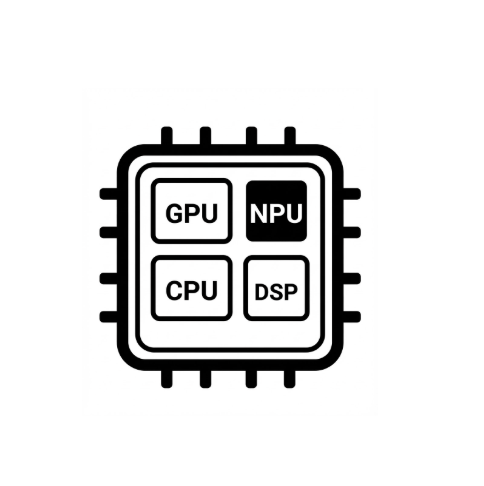

Аппаратное ускорение

Максимальная производительность достигается за счет ускорения с помощью графического и нейронного процессоров.

Широкие возможности GenAI

Поддержка популярных LLM-модулей, а также мультимодальности (зрение, звук) и использования инструментов.

Начать строительство

Присоединяйтесь к сообществу

LiteRT-LM на GitHub

Внесите свой вклад в проект с открытым исходным кодом, сообщайте о проблемах и смотрите примеры.

Обнимающее лицо

Скачайте предварительно конвертированные модели (Джемма, Квен и другие) и присоединяйтесь к обсуждению.

Блоги и объявления

Примените самые современные агентские навыки на самом краю пропасти с помощью Gemma 4.

Разверните Gemma 4 в приложении и на более широком спектре устройств с превосходной производительностью и охватом, используя LiteRT-LM.

Встроенная функция GenAI в Chrome, Chromebook Plus и Pixel Watch

Развертывайте языковые модели на носимых устройствах и браузерных платформах с использованием LiteRT-LM в масштабе предприятия.

Вызов функций на устройстве в Google AI Edge Gallery

Узнайте, как точно настроить FunctionGemma и включить возможности вызова функций, предоставляемые API-интерфейсами LiteRT-LM Tool Use.

Google AI Edge: небольшие языковые модели, мультимодальность и вызов функций.

Последние данные о RAG, мультимодальности и вызове функций для языковых моделей на периферии сети.