使用 LiteRT-LM 在设备端运行 LLM

一款可用于生产用途的开源推理框架,旨在在边缘设备上实现高性能、跨平台的 LLM 部署。

为什么选择 LiteRT-LM?

跨平台

在 Android、iOS、Web 和桌面设备上部署 LLM。

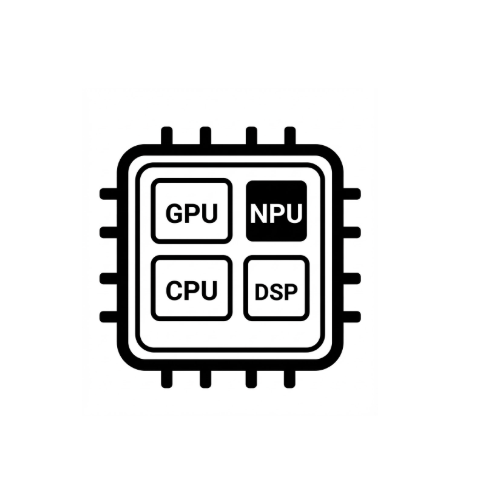

硬件加速

利用 GPU 和 NPU 加速功能最大限度地提升性能。

广泛的生成式 AI 功能

支持热门 LLM,以及多模态(视觉、音频)和工具使用。

加入社群

GitHub 上的 LiteRT-LM

为开源项目做出贡献、报告问题并查看示例。

Hugging Face

下载预转换模型(Gemma、Qwen 等),并加入讨论。

博客和公告

利用 Gemma 4 将先进的智能体技能引入边缘设备。

使用 LiteRT-LM 在应用内和更广泛的设备上部署 Gemma 4,实现出色的性能和覆盖面。

Chrome、Chromebook Plus 和 Pixel Watch 中的设备端生成式 AI

使用 LiteRT-LM 在穿戴式设备和基于浏览器的平台上大规模部署语言模型。

Google AI Edge Gallery 中的设备端函数调用

了解如何对 FunctionGemma 进行微调,并启用由 LiteRT-LM 工具使用 API 提供支持的函数调用功能。

Google AI Edge 小语言模型、多模态和函数调用

有关边缘端语言模型的 RAG、多模态和函数调用的最新见解。