使用 LiteRT-LM 在裝置上執行 LLM

開放原始碼推論架構,可用於正式環境,專為在邊緣裝置上部署高效能的跨平台 LLM 而設計。

為什麼要使用 LiteRT-LM?

跨平台

在 Android、iOS、網頁和電腦上部署 LLM。

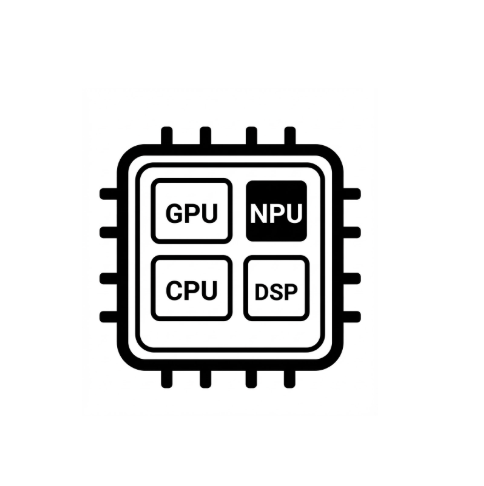

硬體加速

透過 GPU 和 NPU 加速功能,盡量提升效能。

廣泛的生成式 AI 功能

支援熱門 LLM,以及多模態 (Vision、Audio) 和工具使用。

加入社群

GitHub 上的 LiteRT-LM

貢獻心力給開放原始碼專案、回報問題,以及查看範例。

Hugging Face

下載預先轉換的模型 (Gemma、Qwen 等),並加入討論。

網誌和公告

運用 Gemma 4,為邊緣裝置提供最先進的代理能力。

使用 LiteRT-LM 在應用程式內和更廣泛的裝置上部署 Gemma 4,提供出色的效能和觸及率。

Chrome、Chromebook Plus 和 Pixel Watch 的裝置端生成式 AI

使用 LiteRT-LM 大規模在穿戴式裝置和瀏覽器平台部署語言模型。

Google AI Edge Gallery 的裝置端函式呼叫

瞭解如何微調 FunctionGemma,並啟用由 LiteRT-LM Tool Use API 支援的函式呼叫功能。

Google AI Edge 小型語言模型、多模態和函式呼叫

邊緣語言模型的 RAG、多模態和函式呼叫最新洞察資料。