Oparta na sprawdzonej platformie TensorFlow Lite

LiteRT to nie tylko nowość, ale też nowa generacja najczęściej wdrażanego na świecie środowiska wykonawczego uczenia maszynowego. Umożliwia działanie aplikacji, których używasz na co dzień, zapewniając niskie opóźnienia i wysoki poziom prywatności na miliardach urządzeń.

Zaufane przez najważniejsze aplikacje Google

Ponad 100 tys. aplikacji i miliardy użytkowników na całym świecie

Najważniejsze informacje o LiteRT

Gotowość do działania na wielu platformach

Wykorzystaj generatywną AI

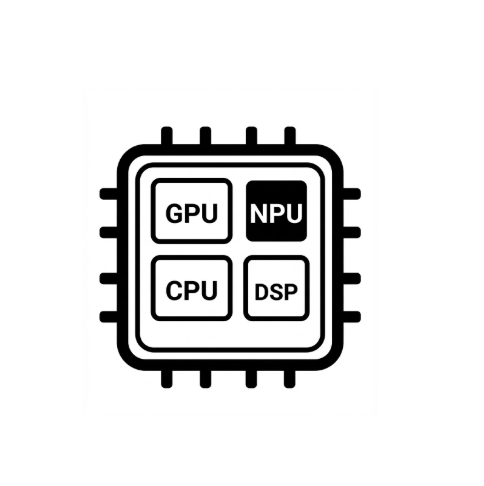

Uproszczona akceleracja sprzętowa

Obsługa wielu platform

Wdrażanie za pomocą LiteRT

Uprość przepływ pracy deep learningu od trenowania po wdrażanie na urządzeniu.

1.Uzyskaj model

Używaj wstępnie wytrenowanych modeli .tflite lub konwertuj modele PyTorch, JAX lub TensorFlow na format .tflite.

2.Optymalizacja

Użyj zestawu narzędzi do optymalizacji LiteRT, aby skwantyzować modele po trenowaniu.

3.Bieg

Wdróż model za pomocą LiteRT i wybierz optymalny akcelerator dla swojej aplikacji.

Wybierz ścieżkę rozwoju

Używaj LiteRT do wdrażania AI w dowolnym miejscu – od wydajnych aplikacji mobilnych po urządzenia IoT o ograniczonych zasobach.

Dotychczasowy użytkownik TFLite

Przejście na LiteRT, aby korzystać z większej wydajności i ujednoliconych interfejsów API na różnych platformach (Android, komputery, internet).

BYOM : Bring your own Models

Masz model PyTorch i chcesz wdrożyć na urządzeniu funkcje związane z obrazem lub dźwiękiem.

Wdrażanie modeli generatywnej AI

Tworzenie zaawansowanych chatbotów na urządzeniach przy użyciu zoptymalizowanych modeli generatywnej AI o otwartej architekturze, takich jak Gemma lub inny model o otwartej architekturze.

[Zaawansowane] Ekspert ds. modeli

Tworzenie modeli niestandardowych lub przeprowadzanie szczegółowych optymalizacji sprzętowych pod kątem procesora, karty graficznej lub jednostki NPU w celu uzyskania maksymalnej wydajności.

Próbki, modele i wersje demonstracyjne

Zobacz przykładową aplikację LiteRT na GitHubie

Kompletne aplikacje przykładowe.

Zobacz modele generatywnej AI

Wytrenowane, gotowe do użycia modele generatywnej AI.

Zobacz wersje demonstracyjne – aplikacja Galeria AI Edge od Google

Galeria prezentująca przypadki użycia uczenia maszynowego i generatywnej AI na urządzeniu z użyciem LiteRT.

Blogi i ogłoszenia

Bądź na bieżąco z najnowszymi ogłoszeniami, szczegółowymi informacjami technicznymi i testami wydajności zespołu LiteRT.

Tworzenie działającej na urządzeniu AI w świecie rzeczywistym za pomocą LiteRT i NPU

Dowiedz się, jak liderzy branży tworzą wydajne aplikacje AI na urządzenia mobilne, które działają w rzeczywistych warunkach, przy użyciu LiteRT i procesorów NPU.

Wykorzystaj najnowocześniejsze funkcje agentowe na urządzeniach brzegowych dzięki Gemmie 4

Wdrażaj na urządzeniu funkcje planowania wieloetapowego i z użyciem agenta dzięki nowej rodzinie modeli Gemma 4 i LiteRT.

LiteRT: uniwersalna platforma AI na urządzeniu

Ujednolicona platforma ML Google na urządzeniu, która powstała na bazie TFLite i umożliwia wdrażanie o wysokiej wydajności.

Procesor NPU i technologia LiteRT od MediaTek: wspieranie nowej generacji AI na urządzeniu

Rozszerzenie obsługi akceleracji NPU na chipsety MediaTek w celu zapewnienia wysokiej wydajności AI.

Osiąganie najwyższej wydajności na procesorze NPU firmy Qualcomm dzięki LiteRT

Zapewnianie przełomowej wydajności generatywnej AI na jednostkach NPU firmy Qualcomm.

LiteRT: maksymalna wydajność w uproszczonej formie

Przedstawiamy interfejs CompiledModel API do automatycznego wybierania sprzętu i wykonywania asynchronicznego.

Generatywna AI na urządzeniu w Chrome, Chromebooku Plus i Pixel Watch z LiteRT-LM

Wdrażaj modele językowe na urządzeniach do noszenia i platformach przeglądarkowych za pomocą LiteRT-LM.

Małe modele językowe, multimodalność i wywoływanie funkcji w AI Edge od Google

Najnowsze informacje o systemach RAG, multimodalności i wywoływaniu funkcji w przypadku modeli językowych na urządzeniach brzegowych

Dołącz do społeczności

Społeczność LiteRT na GitHubie

Bezpośrednio uczestniczyć w projekcie i współpracować z głównymi deweloperami.

Hugging Face Hub

Uzyskaj dostęp do zoptymalizowanych modeli z otwartymi wagami w centrum Hugging Face.