Việc thêm AI tạo sinh vào ứng dụng có thể mang lại sức mạnh và giá trị to lớn cho người dùng, nhưng điều này cũng đòi hỏi bạn phải chú ý để duy trì sự an toàn và quyền riêng tư mong đợi của người dùng.

Thiết kế để đảm bảo an toàn

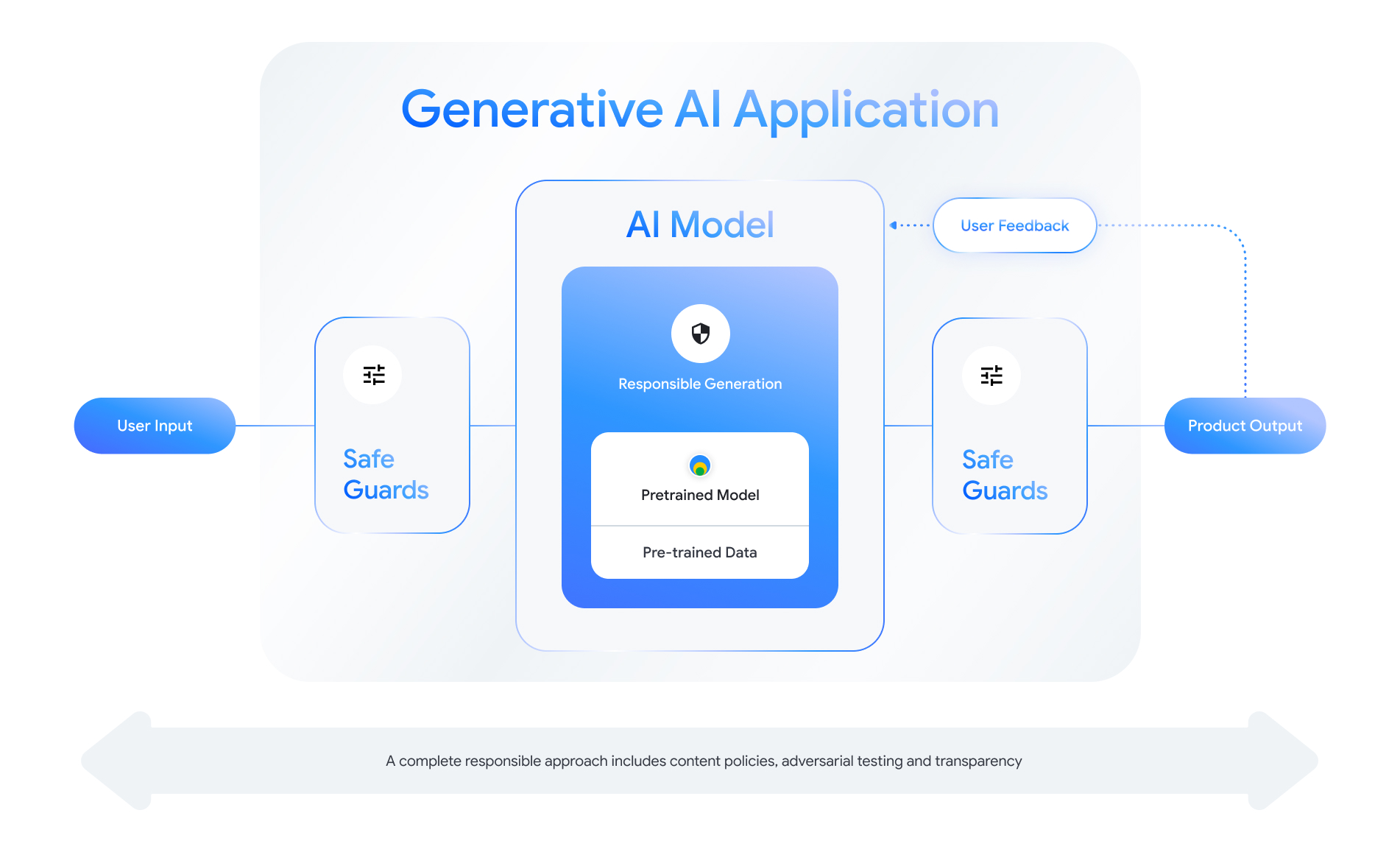

Mỗi tính năng hỗ trợ AI tạo sinh đều mang đến cơ hội thiết kế nhiều lớp an toàn. Như như minh hoạ trong hình sau, có một cách giúp bạn có thể nghĩ về an toàn là đặt Mô hình AI giúp bật tính năng này ở trung tâm. Mô hình này sẽ:

- Được điều chỉnh để thực hiện nhiệm vụ được giao;

- Được bảo vệ bằng các biện pháp bảo vệ để đảm bảo việc nằm ngoài giới hạn đầu vào và đầu ra bị từ chối; và

- Được đánh giá một cách toàn diện để xác định cách mô hình và các hoạt động tương tác ảnh hưởng đến sự an toàn.

Xem "Tạo sản phẩm AI có trách nhiệm" phiên hoạt động từ Google I/O 2024 để tìm hiểu thêm về các cân nhắc khi thiết kế, bài tập tư duy, và phương pháp tạo nguyên mẫu có thể giúp đẩy nhanh quá trình phát triển có trách nhiệm thực tiễn.

Ngoài ra, bạn có thể tìm hiểu các phương pháp hay nhất và xem ví dụ về:

- Xác định những chính sách chi phối cách AI hoạt động ứng dụng của bạn;

- Tạo cấu phần phần mềm về tính minh bạch để giao tiếp cách tiếp cận có trách nhiệm đối với người dùng của bạn; và

- Bảo vệ ứng dụng của bạn khỏi hành vi sử dụng độc hại.

Trên hết, hãy nhớ rằng bạn cần có một hướng tiếp cận hợp lý về sự an toàn và trách nhiệm tự suy ngẫm và thích ứng với kỹ thuật, văn hoá và quy trình thách thức. Thường xuyên tham gia các cuộc đánh giá phê bình về để đảm bảo kết quả tốt nhất.

Xác định chính sách cấp hệ thống

Chính sách an toàn về nội dung quy định những loại nội dung gây hại không được cho phép trên nền tảng trực tuyến. Có thể bạn đã nắm rõ các chính sách nội dung trên các nền tảng như YouTube hoặc Google Play. Nội dung chính sách của các ứng dụng AI tạo sinh cũng tương tự nhau: Các chính sách này xác định loại nội dung mà ứng dụng của bạn không được tạo ra và chúng hướng dẫn cách điều chỉnh các mô hình và cần thêm biện pháp bảo vệ nào thích hợp.

Các chính sách của bạn phải phản ánh trường hợp sử dụng của ứng dụng. Ví dụ: một AI tạo sinh nhằm cung cấp ý tưởng cho các hoạt động của gia đình, dựa trên đề xuất của cộng đồng có thể có chính sách cấm tạo nội dung có tính chất bạo lực vì có thể gây hại cho người dùng. Ngược lại, một ứng dụng tóm tắt các ý tưởng truyện khoa học viễn tưởng do người dùng đề xuất có thể muốn tạo điều kiện cho hành vi bạo lực vì đó là chủ đề của rất nhiều câu chuyện thể loại này.

Chính sách an toàn của bạn phải nghiêm cấm việc tạo nội dung gây hại cho người dùng hay bất hợp pháp và phải nêu rõ những loại nội dung được tạo thanh đó cho ứng dụng của bạn. Bạn cũng có thể cân nhắc đưa vào các trường hợp ngoại lệ đối với nội dung mang tính giáo dục, tư liệu, khoa học hoặc nghệ thuật có thể bị coi là gây hại.

Xác định chính sách rõ ràng với mức độ chi tiết cao, bao gồm các ngoại lệ của chính sách kèm theo ví dụ, là nền tảng để xây dựng của Google. Các chính sách của bạn được sử dụng ở mỗi bước trong quá trình phát triển mô hình. Đối với dữ liệu việc vệ sinh hoặc gắn nhãn, sự không chính xác có thể dẫn đến việc dữ liệu bị gắn nhãn sai, bị xoá quá mức hoặc loại bỏ dữ liệu quá mức, ảnh hưởng đến các biện pháp đảm bảo an toàn cho mô hình của bạn. Để cho mục đích đánh giá, chính sách không rõ ràng sẽ dẫn đến điểm số cao phương sai, khiến khó biết được liệu mô hình của bạn có đáp ứng yêu cầu an toàn hay không chuẩn.

Chính sách giả định (chỉ để minh hoạ)

Sau đây là một số ví dụ về các chính sách mà bạn có thể cân nhắc sử dụng cho tài khoản của mình miễn là chúng phù hợp với trường hợp sử dụng của bạn.

| Danh mục chính sách | Chính sách |

|---|---|

| Thông tin nhận dạng cá nhân nhạy cảm (SPII) | Ứng dụng sẽ không đề cập đến thông tin nhạy cảm và có thể nhận dạng cá nhân (ví dụ: email, số thẻ tín dụng hoặc số an sinh xã hội của một cá nhân bình thường). |

| Lời nói hận thù | Ứng dụng sẽ không tạo nội dung tiêu cực hoặc gây hại nhắm đến danh tính và/hoặc các thuộc tính được bảo vệ (ví dụ: lời nói phân biệt chủng tộc, cổ xuý hành vi phân biệt đối xử, lời kêu gọi bạo lực nhằm chống lại những người được bảo vệ ). |

| Quấy rối | Ứng dụng sẽ không tạo ra hành vi độc hại, gây hăm dọa, bắt nạt, hoặc nội dung lạm dụng nhắm đến một cá nhân khác (ví dụ: đe doạ, phủ nhận các sự kiện bi thảm, miệt thị nạn nhân của nội dung bạo lực). |

| Nội dung nguy hiểm | Ứng dụng này sẽ không tạo hướng dẫn hoặc lời khuyên về cách gây tổn hại của bản thân và/hoặc người khác (ví dụ: tiếp cận hoặc chế tạo súng cầm tay và thiết bị nổ, cổ xuý chủ nghĩa khủng bố, hướng dẫn tự tử). |

| Khiêu dâm | Ứng dụng sẽ không tạo nội dung chứa tham chiếu đến hoạt động tình dục hoặc nội dung khiêu dâm khác (ví dụ: hình ảnh khiêu dâm nội dung mô tả, nội dung nhằm mục đích gây kích thích). |

| Cho phép truy cập vào hàng hoá và dịch vụ gây hại | Ứng dụng này sẽ không tạo nội dung cổ xuý hoặc hỗ trợ tiếp cận hàng hoá, dịch vụ và hoạt động có khả năng gây hại (ví dụ: tạo điều kiện tiếp cận quảng cáo cờ bạc, dược phẩm, pháo hoa, dịch vụ tình dục). |

| Nội dung độc hại | Ứng dụng sẽ không tạo hướng dẫn để thực hiện các hành động bất hợp pháp hoặc các hoạt động lừa đảo (ví dụ: tạo các thủ đoạn lừa đảo, thư rác hoặc nội dung nhằm mục đích chào mời hàng loạt, phương pháp bẻ khoá). |

Cấu phần phần mềm về tính minh bạch

Tài liệu là phương pháp chính để đạt được tính minh bạch đối với các nhà phát triển, chính phủ, đối tác chính sách và người dùng cuối của sản phẩm. Quá trình này có thể bao gồm phát hành các báo cáo kỹ thuật chi tiết hoặc thẻ mô hình, dữ liệu và thẻ hệ thống công khai thông tin cần thiết một cách thích hợp dựa trên mức độ an toàn và mô hình khác các đánh giá. Các cấu phần phần mềm về tính minh bạch không chỉ là phương tiện giao tiếp; chúng cũng cung cấp hướng dẫn cho các nhà nghiên cứu, nhà triển khai và nhà phát triển hạ nguồn AI về việc sử dụng mô hình một cách có trách nhiệm. Thông tin này rất hữu ích cho người dùng cuối của cả sản phẩm của bạn và muốn biết chi tiết về mô hình.

Dưới đây là một số nguyên tắc về tính minh bạch mà bạn có thể cân nhắc:

- Nêu rõ với người dùng khi họ đang tương tác với một thử nghiệm công nghệ AI tạo sinh và nhấn mạnh khả năng có được mô hình ngoài dự kiến hành vi.

- Cung cấp tài liệu toàn diện về cách thức dịch vụ hoặc sản phẩm AI tạo sinh hoạt động bằng ngôn ngữ dễ hiểu. Cân nhắc việc xuất bản nội dung có cấu trúc cấu phần phần mềm về tính minh bạch, chẳng hạn như thẻ mô hình. Những thẻ này cung cấp mục đích sử dụng mô hình của bạn và tóm tắt các đánh giá đã được được thực hiện trong suốt quá trình phát triển mô hình.

- Cho mọi người thấy cách đưa ra ý kiến phản hồi và nắm quyền kiểm soát, chẳng hạn như

dưới dạng:

- Cung cấp cơ chế giúp người dùng xác thực các câu hỏi dựa trên tính xác thực

- Biểu tượng thích và không thích cho phản hồi của người dùng

- Các liên kết tới báo cáo sự cố và cung cấp hỗ trợ phản hồi nhanh cho phản hồi của người dùng

- Quyền kiểm soát của người dùng để lưu trữ hoặc xoá hoạt động của người dùng

Hệ thống AI bảo mật

Các ứng dụng có sử dụng AI tạo sinh tạo ra những khu vực dễ bị tấn công cần đến nhiều giải pháp giảm thiểu đa dạng hơn so với các ứng dụng thông thường. Khung AI bảo mật (SAIF) của Google cung cấp kiến thức toàn diện khung khái niệm để xem xét cách thiết kế ứng dụng có sử dụng AI tạo sinh để sử dụng một cách an toàn. Khung này có thể giúp bạn đánh giá cách triển khai điều chỉnh, đánh giá nghịch đảo và các biện pháp bảo vệ hiệu quả để giúp bảo mật ứng dụng của bạn, nhưng hãy nhớ rằng đây chỉ là các bước khởi đầu. Các thay đổi khác đối với các biện pháp của tổ chức, giám sát và cảnh báo thường là những việc bắt buộc đạt được mục tiêu bảo mật cho bối cảnh và trường hợp sử dụng cụ thể của bạn.

Tài nguyên dành cho nhà phát triển

Ví dụ về các chính sách liên quan đến AI tạo sinh:

- Gemini API và PaLM API của Cloud cung cấp danh sách các thuộc tính an toàn có thể dùng làm cơ sở để xây dựng tính an toàn Google Cloud.

- Ví dụ về các chính sách có trong Nội dung cập nhật về tiến trình trong Nguyên tắc về trí tuệ nhân tạo của Google năm 2023.

- Hiệp hội MLCommons, một tập đoàn kỹ thuật được xây dựng dựa trên triết lý cộng tác mở để cải thiện các hệ thống AI (tài liệu tham khảo 6) những mối nguy hiểm mà họ đánh giá các mô hình về mức độ an toàn của AI Điểm chuẩn an toàn dựa trên AI.

Không có mẫu duy nhất nào cho cấu phần phần mềm trong suốt trên nhưng các thẻ mô hình hiện có có thể đóng vai trò là điểm bắt đầu để tạo lượt chuyển đổi của riêng bạn:

- Thẻ mô hình của Gemma

- Mẫu thẻ mô hình từ giấy thẻ mẫu gốc

- Thẻ mô hình từ API Google Cloud