Dieses Toolkit bietet Ressourcen und Tools, mit denen Sie Best Practices verantwortungsvoller Umgang mit offenen Modellen wie Gemma, einschließlich:

- Informationen zum Festlegen von Sicherheitsrichtlinien, zur Feinabstimmung der Sicherheit und zu Sicherheitsklassifikatoren und Modellbewertung.

- Das Interpretierbarkeitstool für die Untersuchung und Debugging von Gemmas Verhalten als Reaktion auf Prompts

- Der LLM Comparator zum Ausführen und Visualisieren von Vergleichstests Bewertungsergebnisse.

- Methode zum Erstellen zuverlässiger Sicherheitsklassifikatoren mit minimalen Beispielen.

Diese Version des Toolkits konzentriert sich ausschließlich auf englische Text-zu-Text-Modelle. Ich kann Feedback geben, um dieses Toolkit durch das Feedback unten auf der Seite.

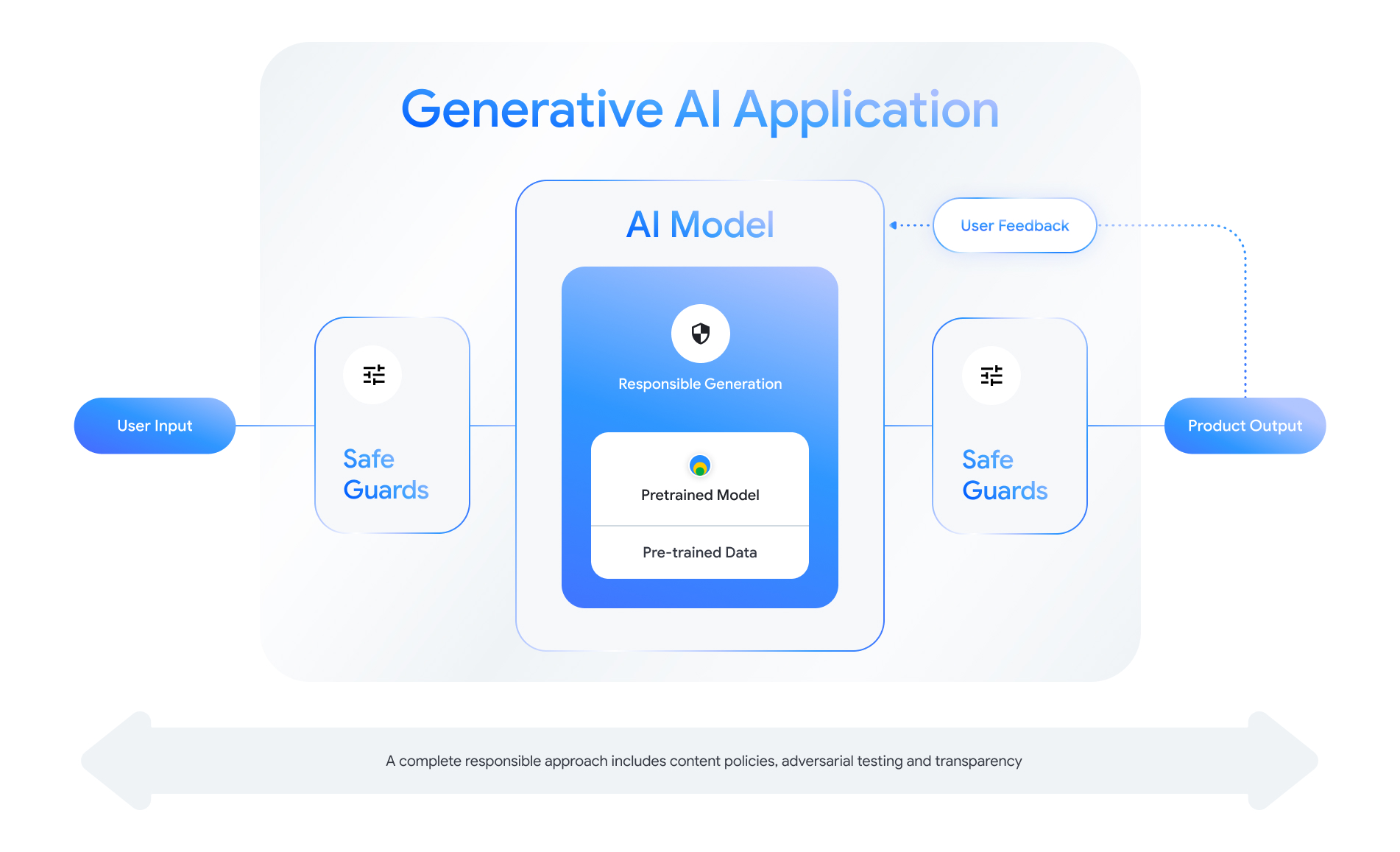

Bei der Entwicklung mit Gemma sollten Sie einen ganzheitlichen Ansatz verfolgen, und alle möglichen Herausforderungen auf Anwendungs- und Modellebene zu berücksichtigen. Dieses Toolkit deckt Risiko- und Minderungstechniken im Hinblick auf Sicherheit, Datenschutz, Fairness und Verantwortlichkeit.

Weitere Informationen und Anleitungen finden Sie auch im Rest dieses Toolkits: