ساخته شده بر پایه TensorFlow Lite که در نبردها آزمایش شده است

LiteRT فقط یک پلتفرم جدید نیست؛ بلکه نسل بعدیِ گستردهترین محیط اجرای یادگیری ماشین در جهان است. این پلتفرم، برنامههایی را که هر روز استفاده میکنید، قدرتمند میکند و تأخیر کم و حریم خصوصی بالایی را در میلیاردها دستگاه ارائه میدهد.

مورد اعتماد مهمترین برنامههای گوگل

بیش از ۱۰۰ هزار برنامه، میلیاردها کاربر جهانی

نکات برجسته LiteRT

آماده برای پلتفرمهای مختلف

GenAI را آزاد کنید

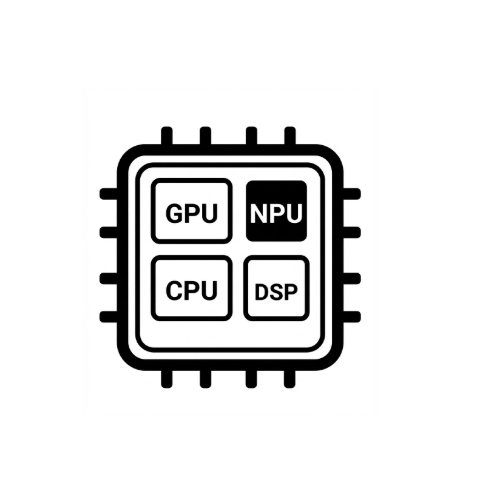

شتاب سختافزاری سادهشده

پشتیبانی از چند فریمورک

استقرار از طریق LiteRT

جریان کاری یادگیری عمیق خود را از آموزش تا استقرار روی دستگاه، ساده کنید.

۱. یک مدل تهیه کنید

از مدلهای از پیش آموزشدیدهی .tflite استفاده کنید یا مدلهای PyTorch، JAX یا TensorFlow را به .tflite تبدیل کنید.

۲. بهینهسازی

از جعبه ابزار بهینهسازی LiteRT برای کوانتیزه کردن مدلهای خود پس از آموزش استفاده کنید.

۳. بدوید

مدل خود را با LiteRT مستقر کنید و شتابدهنده بهینه را برای برنامه خود انتخاب کنید.

مسیر توسعه خود را انتخاب کنید

از LiteRT برای استقرار هوش مصنوعی در هر مکانی استفاده کنید - از برنامههای تلفن همراه با کارایی بالا گرفته تا دستگاههای اینترنت اشیا با محدودیت منابع.

کاربر فعلی TFLite

انتقال به LiteRT برای بهرهمندی از عملکرد بهبود یافته و APIهای یکپارچه در پلتفرمهای مختلف (اندروید، دسکتاپ، وب).

BYOM: مدلهای خودتان را بیاورید

یک مدل PyTorch داشته باشید و به دنبال پیادهسازی تجربیات بصری یا صوتی روی دستگاه باشید.

استقرار مدلهای هوش مصنوعی مولد

ایجاد چتباتهای پیشرفته روی دستگاه با استفاده از مدلهای GenAI با وزن باز بهینهشده مانند Gemma یا سایر مدلهای با وزن باز.

[پیشرفته] متخصص مدل

نوشتن مدلهای سفارشی یا انجام بهینهسازیهای عمیق CPU/GPU/NPU مخصوص سختافزار برای دستیابی به حداکثر عملکرد.

نمونهها، مدلها و نسخههای نمایشی

نمونه برنامه LiteRT را در GitHub ببینید

برنامههای نمونه کامل و جامع.

مدلهای genAI را ببینید

مدلهای هوش مصنوعی نسل جدید از پیش آموزشدیده و آماده.

مشاهده دموها - برنامه گالری Google AI Edge

گالری که موارد استفاده از ML/GenAI روی دستگاه را با استفاده از LiteRT نمایش میدهد.

وبلاگها و اطلاعیهها

با آخرین اطلاعیهها، بررسیهای فنی عمیق و بنچمارکهای عملکرد تیم LiteRT بهروز باشید.

LiteRT: چارچوب جهانی برای هوش مصنوعی روی دستگاه

چارچوب یکپارچه یادگیری ماشین روی دستگاه گوگل، که از TFLite برای استقرار با کارایی بالا تکامل یافته است.

واحد پردازش عصبی مدیاتک و LiteRT: قدرتبخش نسل بعدی هوش مصنوعی درون دستگاهی

گسترش پشتیبانی از شتابدهی NPU به تراشههای مدیاتک برای هوش مصنوعی با راندمان بالا.

دستیابی به اوج عملکرد در واحد پردازش عصبی کوالکام با LiteRT

دستیابی به عملکرد فوقالعاده برای هوش مصنوعی مولد در واحدهای پردازش عصبی کوالکام.

LiteRT: حداکثر عملکرد، ساده شده

معرفی رابط برنامهنویسی کاربردی CompiledModel برای انتخاب خودکار سختافزار و اجرای ناهمگام.

GenAI روی دستگاه در کروم، کرومبوک پلاس و پیکسل واچ با LiteRT-LM

با استفاده از LiteRT-LM، مدلهای زبانی را روی پوشیدنیها و پلتفرمهای مبتنی بر مرورگر مستقر کنید.

مدلهای زبان کوچک، چندوجهی بودن و فراخوانی تابع در Google AI Edge

آخرین بینشها در مورد RAG، چندوجهی بودن و تابعی که مدلهای زبان لبه را فراخوانی میکند

به انجمن بپیوندید

انجمن گیتهاب LiteRT

مستقیماً در پروژه مشارکت کنید و با توسعهدهندگان اصلی همکاری کنید.

هاب صورت بغل کننده

به مدلهای بهینهشده با وزن آزاد در Hugging Face Hub دسترسی داشته باشید.