Gemini API มีการตั้งค่าความปลอดภัยที่คุณปรับได้ในระหว่างขั้นตอนการสร้างต้นแบบเพื่อพิจารณาว่าแอปพลิเคชันของคุณต้องมีการกำหนดค่าความปลอดภัยที่เข้มงวดมากขึ้นหรือน้อยลง คุณสามารถปรับการตั้งค่าเหล่านี้ในตัวกรอง 4 หมวดหมู่เพื่อจำกัดหรืออนุญาตเนื้อหาบางประเภท

คู่มือนี้ครอบคลุมวิธีที่ Gemini API จัดการการตั้งค่าความปลอดภัยและการกรอง รวมถึงวิธีเปลี่ยนการตั้งค่าความปลอดภัยสำหรับแอปพลิเคชัน

ตัวกรองความปลอดภัย

ตัวกรองความปลอดภัยที่ปรับได้ของ Gemini API ครอบคลุมหมวดหมู่ต่อไปนี้

| หมวดหมู่ | คำอธิบาย |

|---|---|

| การคุกคาม | ความคิดเห็นเชิงลบหรือเป็นอันตรายที่มุ่งเป้าไปที่อัตลักษณ์และ/หรือคุณลักษณะที่ได้รับการคุ้มครอง |

| วาจาสร้างความเกลียดชัง | เนื้อหาที่ไม่สุภาพ ไม่ให้เกียรติ หรือหยาบคาย |

| เกี่ยวกับเรื่องเพศอย่างโจ่งแจ้ง | มีการอ้างอิงถึงการมีเพศสัมพันธ์หรือเนื้อหาลามกอื่นๆ |

| อันตราย | ส่งเสริม สนับสนุน หรือกระตุ้นให้เกิดการกระทำที่เป็นอันตราย |

หมวดหมู่เหล่านี้กำหนดไว้ใน HarmCategory. คุณสามารถใช้ตัวกรองเหล่านี้เพื่อปรับเนื้อหาที่เหมาะสมกับกรณีการใช้งานของคุณ เช่น หากคุณกำลังสร้างบทสนทนาในวิดีโอเกม คุณอาจพิจารณาว่าการอนุญาตเนื้อหาเพิ่มเติมที่ได้รับการจัดประเภทเป็น อันตราย นั้นยอมรับได้เนื่องจากลักษณะของเกม

นอกจากตัวกรองความปลอดภัยที่ปรับได้แล้ว Gemini API ยังมีการป้องกันในตัวเพื่อป้องกันอันตรายหลักๆ เช่น เนื้อหาที่อาจเป็นอันตรายต่อความปลอดภัยของเด็ก ระบบจะบล็อกอันตรายประเภทนี้เสมอและไม่สามารถปรับได้

ระดับการกรองความปลอดภัยของเนื้อหา

Gemini API จัดประเภทระดับความน่าจะเป็นที่เนื้อหาจะไม่ปลอดภัยเป็น

HIGH, MEDIUM, LOW, หรือ NEGLIGIBLE

Gemini API จะบล็อกเนื้อหาตามความน่าจะเป็นที่เนื้อหาจะไม่ปลอดภัย ไม่ใช่ตามระดับความรุนแรง คุณควรพิจารณาเรื่องนี้เนื่องจากเนื้อหาบางรายการอาจมีความน่าจะเป็นต่ำที่จะไม่ปลอดภัย แม้ว่าระดับความรุนแรงของอันตรายจะยังสูงอยู่ก็ตาม ตัวอย่างเช่น การเปรียบเทียบประโยคต่อไปนี้

- หุ่นยนต์ชกฉัน

- หุ่นยนต์ฟันฉัน

ประโยคแรกอาจมีความน่าจะเป็นสูงกว่าที่จะไม่ปลอดภัย แต่คุณอาจพิจารณาว่าประโยคที่ 2 มีระดับความรุนแรงสูงกว่าในแง่ของความรุนแรง ดังนั้น คุณจึงควรทดสอบอย่างละเอียดและพิจารณาว่าจำเป็นต้องมีระดับการบล็อกที่เหมาะสมใดบ้างเพื่อรองรับกรณีการใช้งานหลักๆ ของคุณ พร้อมกับลดอันตรายต่อผู้ใช้ปลายทางให้เหลือน้อยที่สุด

การกรองความปลอดภัยต่อคำขอ

คุณสามารถปรับการตั้งค่าความปลอดภัยสำหรับคำขอแต่ละรายการที่ส่งไปยัง API เมื่อคุณส่งคำขอ ระบบจะวิเคราะห์เนื้อหาและกำหนดระดับความปลอดภัย ระดับความปลอดภัยประกอบด้วยหมวดหมู่และความน่าจะเป็นของการจัดประเภทอันตราย เช่น หากระบบบล็อกเนื้อหาเนื่องจากหมวดหมู่การคุกคาม

มีความน่าจะเป็นสูง ระดับความปลอดภัยที่แสดงผลจะมี

หมวดหมู่เท่ากับ HARASSMENT และความน่าจะเป็นของอันตรายตั้งค่าเป็น HIGH

เนื่องจากความปลอดภัยโดยธรรมชาติของโมเดล ระบบจึงปิด ตัวกรองเพิ่มเติมไว้โดยค่าเริ่มต้น หากเลือกเปิดใช้ คุณสามารถกำหนดค่าระบบให้บล็อกเนื้อหาตามความน่าจะเป็นที่เนื้อหาจะไม่ปลอดภัย ลักษณะการทำงานเริ่มต้นของโมเดลครอบคลุมกรณีการใช้งานส่วนใหญ่ ดังนั้นคุณควรปรับการตั้งค่าเหล่านี้ก็ต่อเมื่อแอปพลิเคชันของคุณต้องใช้การตั้งค่าเหล่านี้อย่างสม่ำเสมอ

ตารางต่อไปนี้อธิบายการตั้งค่าการบล็อกที่คุณปรับได้สำหรับแต่ละหมวดหมู่ เช่น หากคุณตั้งค่าการบล็อกเป็นบล็อกบางรายการ สำหรับหมวดหมู่วาจาสร้างความเกลียดชัง ระบบจะบล็อกทุกรายการที่มีความน่าจะเป็นสูงที่จะเป็นเนื้อหาวาจาสร้างความเกลียดชัง แต่จะอนุญาตรายการที่มีความน่าจะเป็นต่ำกว่า

| เกณฑ์ (Google AI Studio) | เกณฑ์ (API) | คำอธิบาย |

|---|---|---|

| ปิด | OFF |

ปิดตัวกรองความปลอดภัย |

| ไม่บล็อก | BLOCK_NONE |

แสดงเสมอไม่ว่าความน่าจะเป็นที่เนื้อหาจะไม่ปลอดภัยจะเป็นเท่าใดก็ตาม |

| บล็อกบางรายการ | BLOCK_ONLY_HIGH |

บล็อกเมื่อมีความน่าจะเป็นสูงที่เนื้อหาจะไม่ปลอดภัย |

| บล็อกบางรายการ | BLOCK_MEDIUM_AND_ABOVE |

บล็อกเมื่อมีความน่าจะเป็นปานกลางหรือสูงที่เนื้อหาจะไม่ปลอดภัย |

| บล็อกส่วนใหญ่ | BLOCK_LOW_AND_ABOVE |

บล็อกเมื่อมีความน่าจะเป็นต่ำ ปานกลาง หรือสูงที่เนื้อหาจะไม่ปลอดภัย |

| ไม่มี | HARM_BLOCK_THRESHOLD_UNSPECIFIED |

ไม่ได้ระบุเกณฑ์ไว้ ให้บล็อกโดยใช้เกณฑ์เริ่มต้น |

หากไม่ได้ตั้งค่าเกณฑ์ไว้ เกณฑ์การบล็อกเริ่มต้นจะเป็นปิด สำหรับโมเดล Gemini 2.5 และ 3

คุณสามารถตั้งค่าเหล่านี้สำหรับคำขอแต่ละรายการที่ส่งไปยังบริการ Generative

ดูรายละเอียดได้ที่เอกสารอ้างอิง API ของ HarmBlockThreshold

ความคิดเห็นด้านความปลอดภัย

generateContent

จะแสดงผล

GenerateContentResponse ซึ่ง

รวมถึงความคิดเห็นด้านความปลอดภัย

ความคิดเห็นเกี่ยวกับพรอมต์จะรวมอยู่ใน

promptFeedback หากตั้งค่า promptFeedback.blockReason ไว้ แสดงว่าระบบบล็อกเนื้อหาของพรอมต์

ความคิดเห็นเกี่ยวกับตัวเลือกคำตอบจะรวมอยู่ใน

Candidate.finishReason และ

Candidate.safetyRatings หากระบบบล็อกเนื้อหาคำตอบและ finishReason เป็น SAFETY คุณสามารถตรวจสอบ safetyRatings เพื่อดูรายละเอียดเพิ่มเติม ระบบจะไม่แสดงผลเนื้อหาที่ถูกบล็อก

ปรับการตั้งค่าความปลอดภัย

ส่วนนี้จะอธิบายวิธีปรับการตั้งค่าความปลอดภัยทั้งใน Google AI Studio และในโค้ด

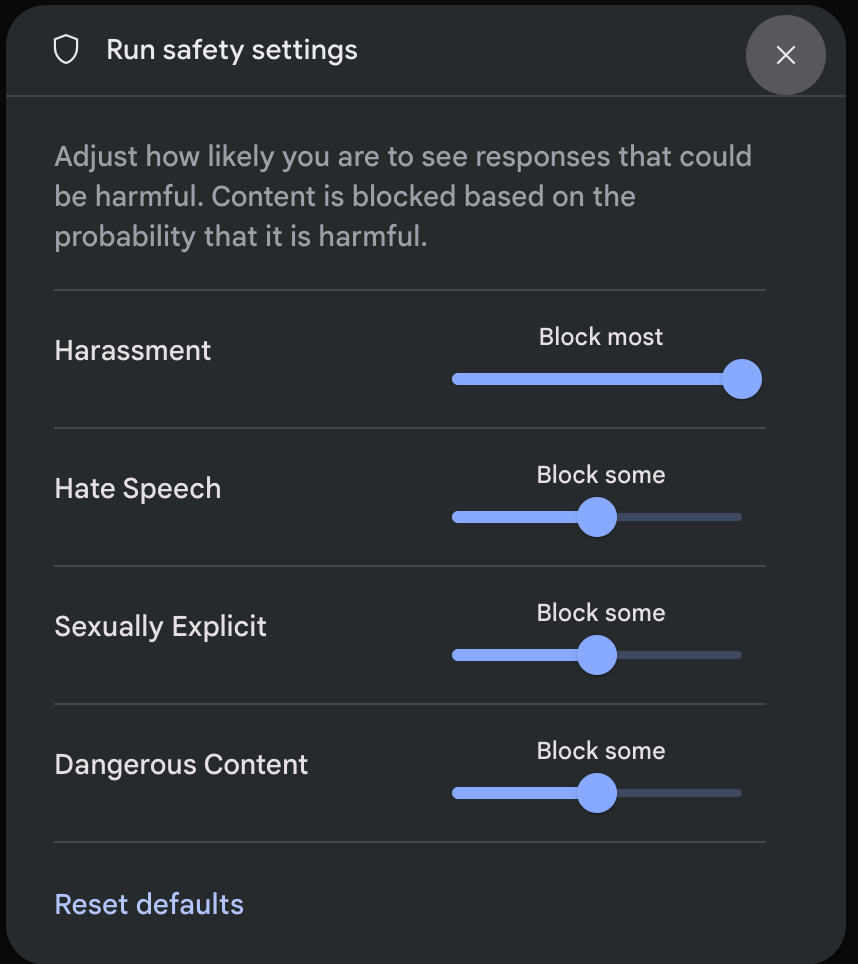

Google AI Studio

คุณสามารถปรับการตั้งค่าความปลอดภัยใน Google AI Studio

คลิกการตั้งค่าความปลอดภัย ในส่วนการตั้งค่าขั้นสูง ในแผงการตั้งค่าการเรียกใช้ เพื่อเปิดโมดัลการตั้งค่าความปลอดภัยในการเรียกใช้ ในโมดัล คุณสามารถใช้แถบเลื่อนเพื่อปรับระดับการกรองเนื้อหาตามหมวดหมู่ความปลอดภัยได้ ดังนี้

เมื่อคุณส่งคำขอ (เช่น ถามคำถามกับโมเดล) ข้อความ เนื้อหาถูกบล็อก จะปรากฏขึ้นหากระบบบล็อกเนื้อหาของคำขอ หากต้องการดูรายละเอียดเพิ่มเติม ให้วางตัวชี้เหนือข้อความเนื้อหาถูกบล็อก เพื่อดูหมวดหมู่และความน่าจะเป็นของการจัดประเภทอันตราย

ตัวอย่างโค้ด

ข้อมูลโค้ดต่อไปนี้แสดงวิธีตั้งค่าความปลอดภัยในการเรียก GenerateContent ซึ่งจะตั้งค่าเกณฑ์สำหรับหมวดหมู่วาจาสร้างความเกลียดชัง (HARM_CATEGORY_HATE_SPEECH) การตั้งค่าหมวดหมู่นี้เป็น BLOCK_LOW_AND_ABOVE จะบล็อกเนื้อหาที่มีความน่าจะเป็นต่ำหรือสูงกว่าที่จะเป็นวาจาสร้างความเกลียดชัง หากต้องการทำความเข้าใจการตั้งค่าเกณฑ์ โปรดดู การกรองความปลอดภัย

ต่อคำขอ

Python

from google import genai

from google.genai import types

client = genai.Client()

response = client.models.generate_content(

model="gemini-3-flash-preview",

contents="Some potentially unsafe prompt",

config=types.GenerateContentConfig(

safety_settings=[

types.SafetySetting(

category=types.HarmCategory.HARM_CATEGORY_HATE_SPEECH,

threshold=types.HarmBlockThreshold.BLOCK_LOW_AND_ABOVE,

),

]

)

)

print(response.text)

Go

package main

import (

"context"

"fmt"

"log"

"google.golang.org/genai"

)

func main() {

ctx := context.Background()

client, err := genai.NewClient(ctx, nil)

if err != nil {

log.Fatal(err)

}

config := &genai.GenerateContentConfig{

SafetySettings: []*genai.SafetySetting{

{

Category: "HARM_CATEGORY_HATE_SPEECH",

Threshold: "BLOCK_LOW_AND_ABOVE",

},

},

}

response, err := client.Models.GenerateContent(

ctx,

"gemini-3-flash-preview",

genai.Text("Some potentially unsafe prompt."),

config,

)

if err != nil {

log.Fatal(err)

}

fmt.Println(response.Text())

}

JavaScript

import { GoogleGenAI } from "@google/genai";

const ai = new GoogleGenAI({});

const safetySettings = [

{

category: "HARM_CATEGORY_HATE_SPEECH",

threshold: "BLOCK_LOW_AND_ABOVE",

},

];

async function main() {

const response = await ai.models.generateContent({

model: "gemini-3-flash-preview",

contents: "Some potentially unsafe prompt.",

config: {

safetySettings: safetySettings,

},

});

console.log(response.text);

}

await main();

Java

SafetySetting hateSpeechSafety = new SafetySetting(HarmCategory.HATE_SPEECH,

BlockThreshold.LOW_AND_ABOVE);

GenerativeModel gm = new GenerativeModel(

"gemini-3-flash-preview",

BuildConfig.apiKey,

null, // generation config is optional

Arrays.asList(hateSpeechSafety)

);

GenerativeModelFutures model = GenerativeModelFutures.from(gm);

REST

curl "https://generativelanguage.googleapis.com/v1beta/models/gemini-3-flash-preview:generateContent" \

-H "x-goog-api-key: $GEMINI_API_KEY" \

-H "Content-Type: application/json" \

-X POST \

-d '{

"safetySettings": [

{"category": "HARM_CATEGORY_HATE_SPEECH", "threshold": "BLOCK_LOW_AND_ABOVE"}

],

"contents": [{

"parts":[{

"text": "'\''Some potentially unsafe prompt.'\''"

}]

}]

}'

ขั้นตอนถัดไป

- ดูเอกสารอ้างอิง API เพื่อดูข้อมูลเพิ่มเติมเกี่ยวกับ API ทั้งหมด

- อ่านคำแนะนำด้านความปลอดภัยเพื่อดูภาพรวมของข้อควรพิจารณาด้านความปลอดภัย เมื่อพัฒนาด้วย LLM

- ดูข้อมูลเพิ่มเติมเกี่ยวกับการประเมินความน่าจะเป็นเทียบกับระดับความรุนแรงจากทีม Jigsaw

- ดูข้อมูลเพิ่มเติมเกี่ยวกับผลิตภัณฑ์ที่ช่วยสร้างโซลูชันด้านความปลอดภัย เช่น Perspective API * คุณสามารถใช้การตั้งค่าความปลอดภัยเหล่านี้เพื่อสร้างตัวแยกประเภทความเป็นพิษ ดูตัวอย่างการแยกประเภท เพื่อ เริ่มต้นใช้งาน