La tâche Détecteur d'objets vous permet de détecter la présence et l'emplacement de plusieurs classes d'objets. Par exemple, un détecteur d'objets peut localiser des chiens dans une image. Ces instructions vous expliquent comment utiliser la tâche Object Detector sur iOS. L'exemple de code décrit dans ces instructions est disponible sur GitHub.

Pour voir cette tâche en action, regardez cette démo Web. Pour en savoir plus sur les fonctionnalités, les modèles et les options de configuration de cette tâche, consultez la section Présentation.

Exemple de code

L'exemple de code MediaPipe Tasks est une implémentation de base d'une application de détection d'objets pour iOS. L'exemple utilise l'appareil photo d'un appareil iOS physique pour détecter en continu des objets. Il peut également utiliser des images et des vidéos de la galerie de l'appareil pour détecter des objets de manière statique.

Vous pouvez utiliser l'application comme point de départ pour votre propre application iOS ou vous y référer lorsque vous modifiez une application existante. L'exemple de code du détecteur d'objets est hébergé sur GitHub.

Télécharger le code

Les instructions suivantes vous expliquent comment créer une copie locale de l'exemple de code à l'aide de l'outil de ligne de commande git.

Pour télécharger l'exemple de code:

Clonez le dépôt Git à l'aide de la commande suivante:

git clone https://github.com/google-ai-edge/mediapipe-samplesVous pouvez également configurer votre instance git pour utiliser un "checkout" clairsemé afin de n'avoir que les fichiers de l'application exemple Object Detector:

cd mediapipe-samples git sparse-checkout init --cone git sparse-checkout set examples/object_detection/ios/

Après avoir créé une version locale de l'exemple de code, vous pouvez installer la bibliothèque de tâches MediaPipe, ouvrir le projet à l'aide de Xcode et exécuter l'application. Pour obtenir des instructions, consultez le guide de configuration pour iOS.

Composants clés

Les fichiers suivants contiennent le code essentiel de l'application exemple Object Detector:

- ObjectDetectorService.swift : initialise le détecteur, gère la sélection du modèle et exécute l'inférence sur les données d'entrée.

- CameraViewController.swift : implémente l'UI pour le mode d'entrée du flux de caméra en direct et visualise les résultats de détection.

- MediaLibraryViewController.swift : implémente l'UI pour le mode d'importation d'images fixes et de fichiers vidéo, et visualise les résultats de détection.

Configuration

Cette section décrit les étapes clés à suivre pour configurer votre environnement de développement et vos projets de code afin d'utiliser Object Detector. Pour obtenir des informations générales sur la configuration de votre environnement de développement pour utiliser les tâches MediaPipe, y compris les exigences concernant les versions de la plate-forme, consultez le guide de configuration pour iOS.

Dépendances

Le détecteur d'objets utilise la bibliothèque MediaPipeTasksVision, qui doit être installée à l'aide de CocoaPods. La bibliothèque est compatible avec les applications Swift et Objective-C, et ne nécessite aucune configuration supplémentaire spécifique à la langue.

Pour savoir comment installer CocoaPods sur macOS, consultez le guide d'installation de CocoaPods.

Pour savoir comment créer un Podfile avec les pods nécessaires à votre application, consultez la section Utiliser CocoaPods.

Ajoutez le pod MediaPipeTasksVision dans Podfile à l'aide du code suivant:

target 'MyObjectDetectorApp' do

use_frameworks!

pod 'MediaPipeTasksVision'

end

Si votre application inclut des cibles de test unitaire, consultez le guide de configuration pour iOS pour en savoir plus sur la configuration de votre Podfile.

Modèle

La tâche de détection d'objets MediaPipe nécessite un modèle entraîné compatible avec cette tâche. Pour en savoir plus sur les modèles entraînés disponibles pour le détecteur d'objets, consultez la section Modèles de la présentation de la tâche.

Sélectionnez et téléchargez un modèle, puis ajoutez-le au répertoire de votre projet à l'aide de Xcode. Pour savoir comment ajouter des fichiers à votre projet Xcode, consultez Gérer les fichiers et les dossiers dans votre projet Xcode.

Utilisez la propriété BaseOptions.modelAssetPath pour spécifier le chemin d'accès au modèle dans votre app bundle. Pour obtenir un exemple de code, consultez la section suivante.

Créer la tâche

Vous pouvez créer la tâche du détecteur d'objets en appelant l'un de ses initialiseurs. L'initialiseur ObjectDetector(options:) définit les valeurs des options de configuration, y compris le mode d'exécution, les paramètres régionaux des noms à afficher, le nombre maximal de résultats, le seuil de confiance, la liste d'autorisation et la liste de refus des catégories.

Si vous n'avez pas besoin d'un détecteur d'objets initialisé avec des options de configuration personnalisées, vous pouvez utiliser l'initialiseur ObjectDetector(modelPath:) pour créer un détecteur d'objets avec les options par défaut. Pour en savoir plus sur les options de configuration, consultez la section Présentation de la configuration.

La tâche Détecteur d'objets est compatible avec trois types de données d'entrée: les images fixes, les fichiers vidéo et les flux vidéo en direct. Par défaut, ObjectDetector(modelPath:) initialise une tâche pour les images fixes. Si vous souhaitez que votre tâche soit initialisée pour traiter des fichiers vidéo ou des flux vidéo en direct, utilisez ObjectDetector(options:) pour spécifier le mode d'exécution de la vidéo ou de la diffusion en direct. Le mode diffusion en direct nécessite également l'option de configuration objectDetectorLiveStreamDelegate supplémentaire, qui permet au détecteur d'objets de transmettre les résultats de détection au délégué de manière asynchrone.

Sélectionnez l'onglet correspondant à votre mode d'exécution pour découvrir comment créer la tâche et exécuter l'inférence.

Swift

Image

import MediaPipeTasksVision let modelPath = Bundle.main.path(forResource: "model", ofType: "tflite") let options = ObjectDetectorOptions() options.baseOptions.modelAssetPath = modelPath options.runningMode = .image options.maxResults = 5 let objectDetector = try ObjectDetector(options: options)

Vidéo

import MediaPipeTasksVision let modelPath = Bundle.main.path(forResource: "model", ofType: "tflite") let options = ObjectDetectorOptions() options.baseOptions.modelAssetPath = modelPath options.runningMode = .video options.maxResults = 5 let objectDetector = try ObjectDetector(options: options)

diffusion en direct

import MediaPipeTasksVision // Class that conforms to the `ObjectDetectorLiveStreamDelegate` protocol and // implements the method that the object detector calls once it // finishes performing detection on each input frame. class ObjectDetectorResultProcessor: NSObject, ObjectDetectorLiveStreamDelegate { func objectDetector( _ objectDetector: ObjectDetector, didFinishDetection objectDetectionResult: ObjectDetectorResult?, timestampInMilliseconds: Int, error: Error?) { // Process the detection result or errors here. } } let modelPath = Bundle.main.path(forResource: "model", ofType: "tflite") let options = ObjectDetectorOptions() options.baseOptions.modelAssetPath = modelPath options.runningMode = .liveStream options.maxResults = 5 // Assign an object of the class to the `objectDetectorLiveStreamDelegate` // property. let processor = ObjectDetectorResultProcessor() options.objectDetectorLiveStreamDelegate = processor let objectDetector = try ObjectDetector(options: options)

Objective-C

Image

@import MediaPipeTasksVision; NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"model" ofType:@"tflite"]; MPPObjectDetectorOptions *options = [[MPPObjectDetectorOptions alloc] init]; options.baseOptions.modelAssetPath = modelPath; options.runningMode = MPPRunningModeImage; options.maxResults = 5; MPPObjectDetector *objectDetector = [[MPPObjectDetector alloc] initWithOptions:options error:nil];

Vidéo

@import MediaPipeTasksVision; NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"model" ofType:@"tflite"]; MPPObjectDetectorOptions *options = [[MPPObjectDetectorOptions alloc] init]; options.baseOptions.modelAssetPath = modelPath; options.runningMode = MPPRunningModeVideo; options.maxResults = 5; MPPObjectDetector *objectDetector = [[MPPObjectDetector alloc] initWithOptions:options error:nil];

diffusion en direct

@import MediaPipeTasksVision; // Class that conforms to the `ObjectDetectorLiveStreamDelegate` protocol and // implements the method that the object detector calls once it // finishes performing detection on each input frame. @interface APPObjectDetectorResultProcessor : NSObject@end @implementation MPPObjectDetectorResultProcessor - (void)objectDetector:(MPPObjectDetector *)objectDetector didFinishDetectionWithResult:(MPPObjectDetectorResult *)ObjectDetectorResult timestampInMilliseconds:(NSInteger)timestampInMilliseconds error:(NSError *)error { // Process the detection result or errors here. } @end NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"model" ofType:@"tflite"]; MPPObjectDetectorOptions *options = [[MPPObjectDetectorOptions alloc] init]; options.baseOptions.modelAssetPath = modelPath; options.runningMode = MPPRunningModeLiveStream; options.maxResults = 5; // Assign an object of the class to the `objectDetectorLiveStreamDelegate` // property. APPObjectDetectorResultProcessor *processor = [APPObjectDetectorResultProcessor new]; options.objectDetectorLiveStreamDelegate = processor; MPPObjectDetector *objectDetector = [[MPPObjectDetector alloc] initWithOptions:options error:nil];

Options de configuration

Cette tâche propose les options de configuration suivantes pour les applications iOS:

| Nom de l'option | Description | Plage de valeurs | Valeur par défaut |

|---|---|---|---|

runningMode |

Définit le mode d'exécution de la tâche. Il existe trois modes: IMAGE: mode pour les entrées d'une seule image. VIDEO: mode des images décodées d'une vidéo. LIVE_STREAM: mode de diffusion en direct des données d'entrée, par exemple à partir d'une caméra. Dans ce mode, resultListener doit être appelé pour configurer un écouteur afin de recevoir les résultats de manière asynchrone. |

{RunningMode.image, RunningMode.video, RunningMode.liveStream} |

RunningMode.image |

displayNamesLocales |

Définit la langue des libellés à utiliser pour les noms à afficher fournis dans les métadonnées du modèle de la tâche, le cas échéant. La valeur par défaut est en pour l'anglais. Vous pouvez ajouter des libellés localisés aux métadonnées d'un modèle personnalisé à l'aide de l'API TensorFlow Lite Metadata Writer.

|

Code de paramètres régionaux | en |

maxResults |

Définit le nombre maximal facultatif de résultats de détection les plus élevés à renvoyer. | N'importe quel nombre positif | -1 (tous les résultats sont renvoyés) |

scoreThreshold |

Définit le seuil de score de prédiction qui remplace celui fourni dans les métadonnées du modèle (le cas échéant). Les résultats inférieurs à cette valeur sont rejetés. | N'importe quelle superposition | Non défini |

categoryAllowlist |

Définit la liste facultative des noms de catégories autorisés. Si cet ensemble n'est pas vide, les résultats de détection dont le nom de catégorie ne figure pas dans cet ensemble seront filtrés. Les noms de catégories en double ou inconnus sont ignorés.

Cette option s'exclut mutuellement avec categoryDenylist. L'utilisation des deux entraîne une erreur. |

Toutes les chaînes | Non défini |

categoryDenylist |

Définit la liste facultative des noms de catégories non autorisés. Si cet ensemble n'est pas vide, les résultats de détection dont le nom de catégorie figure dans cet ensemble seront filtrés. Les noms de catégories en double ou inconnus sont ignorés. Cette option s'exclut mutuellement avec categoryAllowlist. L'utilisation des deux entraîne une erreur. |

Toutes les chaînes | Non défini |

Configuration de la diffusion en direct

Lorsque le mode d'exécution est défini sur "streaming en direct", le détecteur d'objets nécessite l'option de configuration objectDetectorLiveStreamDelegate supplémentaire, qui permet au détecteur de fournir des résultats de détection de manière asynchrone. Le délégué implémente la méthode objectDetector(_objectDetector:didFinishDetection:timestampInMilliseconds:error:), que le détecteur d'objets appelle après avoir traité le résultat de la détection pour chaque frame.

| Nom de l'option | Description | Plage de valeurs | Valeur par défaut |

|---|---|---|---|

objectDetectorLiveStreamDelegate |

Permet au détecteur d'objets de recevoir les résultats de détection de manière asynchrone en mode diffusion en direct. La classe dont l'instance est définie sur cette propriété doit implémenter la méthode objectDetector(_:didFinishDetection:timestampInMilliseconds:error:). |

Non applicable | Non défini |

Préparer les données

Vous devez convertir l'image ou le frame d'entrée en objet MPImage avant de le transmettre au détecteur d'objets. MPImage est compatible avec différents types de formats d'images iOS et peut les utiliser dans n'importe quel mode d'exécution pour l'inférence. Pour en savoir plus sur MPImage, consultez l'API MPImage.

Choisissez un format d'image iOS en fonction de votre cas d'utilisation et du mode d'exécution requis par votre application.MPImage accepte les formats d'image iOS UIImage, CVPixelBuffer et CMSampleBuffer.

UIImage

Le format UIImage est adapté aux modes d'exécution suivants:

Images: les images d'un bundle d'application, d'une galerie utilisateur ou d'un système de fichiers au format

UIImagepeuvent être converties en objetMPImage.Vidéos: utilisez AVAssetImageGenerator pour extraire les images vidéo au format CGImage, puis les convertir en images

UIImage.

Swift

// Load an image on the user's device as an iOS `UIImage` object. // Convert the `UIImage` object to a MediaPipe's Image object having the default // orientation `UIImage.Orientation.up`. let image = try MPImage(uiImage: image)

Objective-C

// Load an image on the user's device as an iOS `UIImage` object. // Convert the `UIImage` object to a MediaPipe's Image object having the default // orientation `UIImageOrientationUp`. MPImage *image = [[MPPImage alloc] initWithUIImage:image error:nil];

L'exemple initialise un MPImage avec l'orientation par défaut UIImage.Orientation.Up. Vous pouvez initialiser un MPImage avec l'une des valeurs UIImage.Orientation acceptées. Le détecteur d'objets n'est pas compatible avec les orientations en miroir telles que .upMirrored, .downMirrored, .leftMirrored et .rightMirrored.

Pour en savoir plus sur UIImage, consultez la documentation pour les développeurs Apple sur UIImage.

CVPixelBuffer

Le format CVPixelBuffer est adapté aux applications qui génèrent des frames et utilisent le framework CoreImage iOS pour le traitement.

Le format CVPixelBuffer est adapté aux modes d'exécution suivants:

Images: les applications qui génèrent des images

CVPixelBufferaprès un traitement à l'aide du frameworkCoreImaged'iOS peuvent être envoyées au détecteur d'objets en mode d'exécution d'image.Vidéos: les images vidéo peuvent être converties au format

CVPixelBufferpour le traitement, puis envoyées au détecteur d'objets en mode vidéo.streaming en direct: les applications qui utilisent une caméra iOS pour générer des images peuvent être converties au format

CVPixelBufferpour le traitement avant d'être envoyées au détecteur d'objets en mode streaming en direct.

Swift

// Obtain a CVPixelBuffer. // Convert the `CVPixelBuffer` object to a MediaPipe's Image object having the default // orientation `UIImage.Orientation.up`. let image = try MPImage(pixelBuffer: pixelBuffer)

Objective-C

// Obtain a CVPixelBuffer. // Convert the `CVPixelBuffer` object to a MediaPipe's Image object having the // default orientation `UIImageOrientationUp`. MPImage *image = [[MPPImage alloc] initWithUIImage:image error:nil];

Pour en savoir plus sur CVPixelBuffer, consultez la documentation pour les développeurs Apple sur CVPixelBuffer.

CMSampleBuffer

Le format CMSampleBuffer stocke des échantillons multimédias d'un type multimédia uniforme et est adapté au mode d'exécution de la diffusion en direct. Les images en direct des caméras iOS sont transmises de manière asynchrone au format CMSampleBuffer par AVCaptureVideoDataOutput sur iOS.

Swift

// Obtain a CMSampleBuffer. // Convert the `CMSampleBuffer` object to a MediaPipe's Image object having the default // orientation `UIImage.Orientation.up`. let image = try MPImage(sampleBuffer: sampleBuffer)

Objective-C

// Obtain a `CMSampleBuffer`. // Convert the `CMSampleBuffer` object to a MediaPipe's Image object having the // default orientation `UIImageOrientationUp`. MPImage *image = [[MPPImage alloc] initWithSampleBuffer:sampleBuffer error:nil];

Pour en savoir plus sur CMSampleBuffer, consultez la documentation pour les développeurs Apple sur CMSampleBuffer.

Exécuter la tâche

Pour exécuter le détecteur d'objets, utilisez la méthode detect() spécifique au mode d'exécution attribué:

- Image fixe:

detect(image:) - Vidéo :

detect(videoFrame:timestampInMilliseconds:) - livestream:

detectAsync(image:)

Les exemples de code suivants montrent comment exécuter le détecteur d'objets dans ces différents modes d'exécution:

Swift

Image

let objectDetector.detect(image:image)

Vidéo

let objectDetector.detect(videoFrame:image)

diffusion en direct

let objectDetector.detectAsync(image:image)

Objective-C

Image

MPPObjectDetectorResult *result = [objectDetector detectInImage:image error:nil];

Vidéo

MPPObjectDetectorResult *result = [objectDetector detectInVideoFrame:image timestampInMilliseconds:timestamp error:nil];

diffusion en direct

BOOL success = [objectDetector detectAsyncInImage:image timestampInMilliseconds:timestamp error:nil];

L'exemple de code du détecteur d'objets montre plus en détail les implémentations de chacun de ces modes : detect(image:), detect(videoFrame:) et detectAsync(image:). L'exemple de code permet à l'utilisateur de basculer entre les modes de traitement, ce qui n'est peut-être pas nécessaire pour votre cas d'utilisation.

Veuillez noter les points suivants :

Lorsque vous exécutez la tâche en mode vidéo ou en mode diffusion en direct, vous devez également fournir le code temporel du frame d'entrée à la tâche Détecteur d'objets.

Lorsqu'elle s'exécute en mode image ou vidéo, la tâche du détecteur d'objets bloque le thread actuel jusqu'à ce qu'elle ait terminé de traiter l'image ou le frame d'entrée. Pour éviter de bloquer le thread actuel, exécutez le traitement dans un thread en arrière-plan à l'aide des frameworks iOS Dispatch ou NSOperation.

Lorsqu'elle s'exécute en mode diffusion en direct, la tâche du détecteur d'objets renvoie immédiatement un résultat et ne bloque pas le thread en cours. Il appelle la méthode

objectDetector(_objectDetector:didFinishDetection:timestampInMilliseconds:error:)avec le résultat de la détection après avoir traité chaque frame d'entrée. Le détecteur d'objets appelle cette méthode de manière asynchrone sur une file d'attente de distribution série dédiée. Pour afficher les résultats dans l'interface utilisateur, distribuez-les dans la file d'attente principale après les avoir traités. Si la fonctiondetectAsyncest appelée lorsque la tâche du détecteur d'objets est occupée à traiter un autre frame, le détecteur d'objets ignore le nouveau frame d'entrée.

Gérer et afficher les résultats

Lors de l'exécution de l'inférence, la tâche Object Detector renvoie un objet ObjectDetectorResult qui décrit les objets qu'elle a trouvés dans l'image d'entrée.

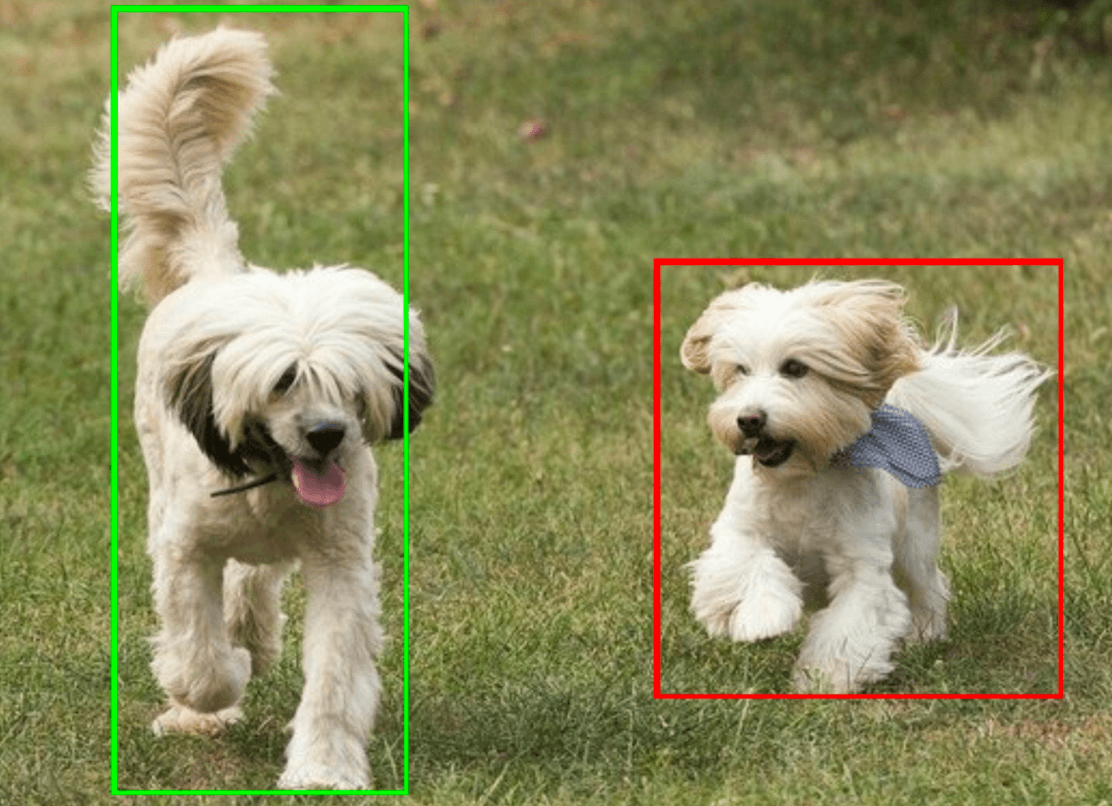

Voici un exemple des données de sortie de cette tâche:

ObjectDetectorResult:

Detection #0:

Box: (x: 355, y: 133, w: 190, h: 206)

Categories:

index : 17

score : 0.73828

class name : dog

Detection #1:

Box: (x: 103, y: 15, w: 138, h: 369)

Categories:

index : 17

score : 0.73047

class name : dog

L'image suivante présente une visualisation du résultat de la tâche:

L'exemple de code du détecteur d'objets montre comment afficher les résultats de détection renvoyés par la tâche. Pour en savoir plus, consultez l'exemple de code.