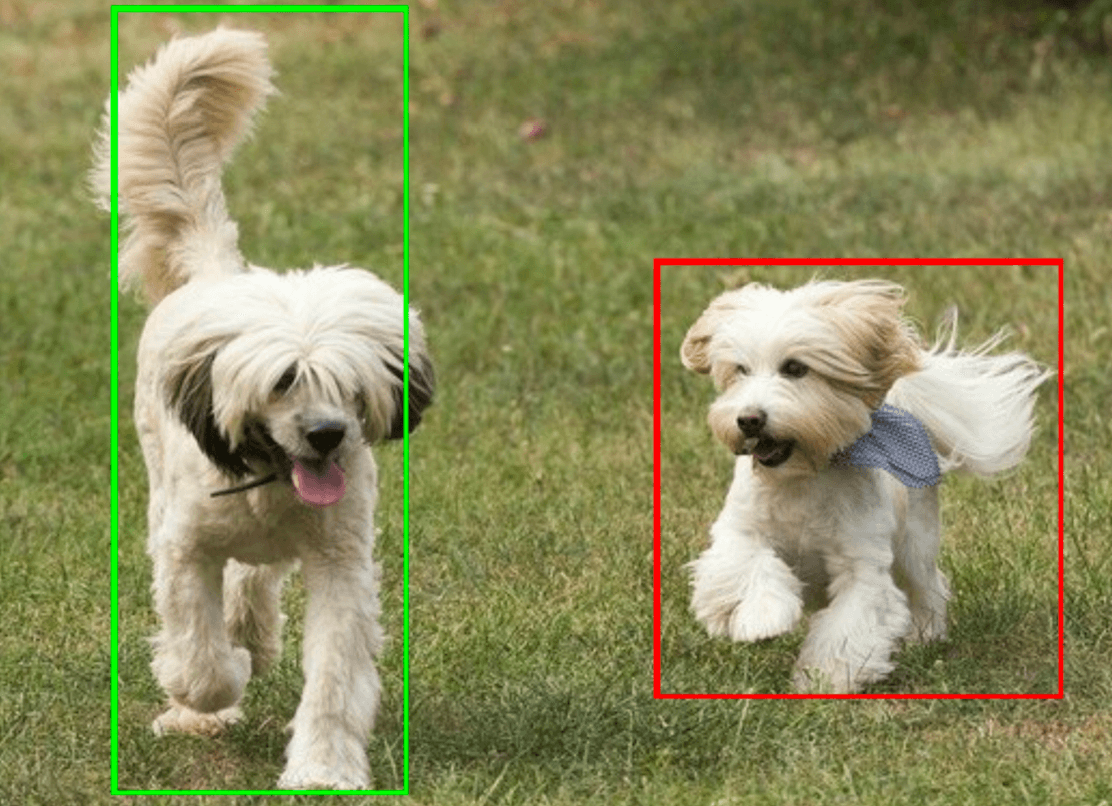

המשימה 'זיהוי אובייקטים' מאפשרת לזהות את הנוכחות והמיקום של כמה סוגים של אובייקטים. לדוגמה, מכשיר לזיהוי אובייקטים יכול לאתר כלבים בתמונה. ההוראות האלה מוסברות איך להשתמש במשימה 'זיהוי אובייקטים' ב-iOS. דוגמת הקוד שמתוארת בהוראות האלה זמינה ב-GitHub.

אתם יכולים לראות את המשימה הזו בפעולה בהדגמה הזו לאינטרנט. למידע נוסף על היכולות, המודלים והאפשרויות להגדרה של המשימה הזו, קראו את הסקירה הכללית.

קוד לדוגמה

קוד הדוגמה של MediaPipe Tasks הוא הטמעה בסיסית של אפליקציית זיהוי אובייקטים ל-iOS. בדוגמה הזו נעשה שימוש במצלמה של מכשיר iOS פיזי כדי לזהות אובייקטים באופן רציף, ואפשר גם להשתמש בתמונות ובסרטונים מהגלריה של המכשיר כדי לזהות אובייקטים באופן סטטי.

אפשר להשתמש באפליקציה כנקודת התחלה לאפליקציית iOS משלכם, או להיעזר בה כשמשנים אפליקציה קיימת. קוד הדוגמה של 'זיהוי אובייקטים' מתארח ב-GitHub.

הורדת הקוד

בהוראות הבאות מוסבר איך ליצור עותק מקומי של קוד הדוגמה באמצעות כלי שורת הפקודה git.

כדי להוריד את הקוד לדוגמה:

משכפלים את מאגר git באמצעות הפקודה הבאה:

git clone https://github.com/google-ai-edge/mediapipe-samplesלחלופין, אפשר להגדיר את מכונה של git כך שתשתמש ב-sparse checkout, כך שיישארו רק הקבצים של אפליקציית הדוגמה לזיהוי אובייקטים:

cd mediapipe-samples git sparse-checkout init --cone git sparse-checkout set examples/object_detection/ios/

אחרי שיוצרים גרסה מקומית של קוד הדוגמה, אפשר להתקין את ספריית המשימות של MediaPipe, לפתוח את הפרויקט באמצעות Xcode ולהפעיל את האפליקציה. להוראות, אפשר לעיין במדריך ההגדרה ל-iOS.

רכיבים מרכזיים

הקבצים הבאים מכילים את הקוד החשוב לאפליקציית הדוגמה של Object Detector:

- ObjectDetectorService.swift: הפונקציה הזו מאתחלת את הגלאי, מטפלת בבחירת המודל ומריצה את ההסקה על נתוני הקלט.

- CameraViewController.swift: הקוד הזה מטמיע את ממשק המשתמש של מצב הקלט של פיד המצלמה בשידור חי, ומציג חזותית את תוצאות הזיהוי.

- MediaLibraryViewController.swift: הקוד הזה מטמיע את ממשק המשתמש של מצב הקלט של קובצי תמונות וסרטונים סטטיים, ומציג חזותית את תוצאות הזיהוי.

הגדרה

בקטע הזה מוסבר איך להגדיר את סביבת הפיתוח ואת פרויקטי הקוד כך שיעבדקו באמצעות Object Detector. מידע כללי על הגדרת סביבת הפיתוח לשימוש במשימות של MediaPipe, כולל דרישות לגבי גרסת הפלטפורמה, זמין במדריך ההגדרה ל-iOS.

יחסי תלות

הספרייה MediaPipeTasksVision משמשת לזיהוי אובייקטים, וצריך להתקין אותה באמצעות CocoaPods. הספרייה תואמת לאפליקציות Swift וגם לאפליקציות Objective-C, ולא נדרשת הגדרה נוספת ספציפית לשפה.

הוראות להתקנת CocoaPods ב-macOS מפורטות במדריך להתקנת CocoaPods.

הוראות ליצירת Podfile עם ה-pods הנדרשים לאפליקציה מפורטות במאמר שימוש ב-CocoaPods.

מוסיפים את ה-pod MediaPipeTasksVision ב-Podfile באמצעות הקוד הבא:

target 'MyObjectDetectorApp' do

use_frameworks!

pod 'MediaPipeTasksVision'

end

אם האפליקציה כוללת יעדי בדיקת יחידה, תוכלו לעיין במדריך ההגדרה ל-iOS כדי לקבל מידע נוסף על הגדרת Podfile.

דגם

כדי לבצע את המשימה 'גלאי אובייקטים של MediaPipe' נדרש מודל מאומן שתואם למשימה הזו. מידע נוסף על המודלים המאומנים הזמינים לזיהוי אובייקטים זמין בקטע 'מודלים' שבסקירה הכללית של המשימה.

בוחרים מודל ומורידים אותו, ומוסיפים אותו לספריית הפרויקט באמצעות Xcode. הוראות להוספת קבצים לפרויקט ב-Xcode מפורטות במאמר ניהול קבצים ותיקיות בפרויקט ב-Xcode.

משתמשים במאפיין BaseOptions.modelAssetPath כדי לציין את הנתיב למודל בקובץ האפליקציה. דוגמה לקוד מופיעה בקטע הבא.

יצירת המשימה

כדי ליצור את המשימה Object Detector, קוראים לאחת מהפונקציות להפעלה (initializers) שלה. ה-initializer של ObjectDetector(options:) מגדיר ערכים לאפשרויות ההגדרה, כולל מצב ריצה, אזור גיאוגרפי של שמות מוצגים, מספר תוצאות מקסימלי, ערך סף ביטחון, רשימת ההיתרים והרשימת הדחייה של הקטגוריות.

אם אתם לא צריכים גלאי אובייקטים שמאותחלים עם אפשרויות תצורה בהתאמה אישית, תוכלו להשתמש ב-initializer ObjectDetector(modelPath:) כדי ליצור גלאי אובייקטים עם אפשרויות ברירת המחדל. מידע נוסף על אפשרויות ההגדרה זמין במאמר סקירה כללית על הגדרות.

המשימה 'זיהוי אובייקטים' תומכת ב-3 סוגי נתוני קלט: תמונות סטילס, קובצי וידאו ושידור וידאו בשידור חי. כברירת מחדל, ObjectDetector(modelPath:) מאתחלת משימה לתמונות סטילס. אם רוצים שהמשימה תאופס לעיבוד קובצי וידאו או סטרימינג של וידאו בשידור חי, צריך להשתמש ב-ObjectDetector(options:) כדי לציין את מצב ההפעלה של הסרטון או השידור החי. כדי להשתמש במצב של שידור חי, צריך גם להגדיר את האפשרות הנוספת objectDetectorLiveStreamDelegate, שמאפשרת ל-Object Detector לשלוח את תוצאות הזיהוי לגורם המורשה באופן אסינכרוני.

בוחרים את הכרטיסייה שמתאימה למצב ההפעלה כדי לראות איך יוצרים את המשימה ומפעילים את ההסקה.

Swift

תמונה

import MediaPipeTasksVision let modelPath = Bundle.main.path(forResource: "model", ofType: "tflite") let options = ObjectDetectorOptions() options.baseOptions.modelAssetPath = modelPath options.runningMode = .image options.maxResults = 5 let objectDetector = try ObjectDetector(options: options)

וידאו

import MediaPipeTasksVision let modelPath = Bundle.main.path(forResource: "model", ofType: "tflite") let options = ObjectDetectorOptions() options.baseOptions.modelAssetPath = modelPath options.runningMode = .video options.maxResults = 5 let objectDetector = try ObjectDetector(options: options)

שידור חי

import MediaPipeTasksVision // Class that conforms to the `ObjectDetectorLiveStreamDelegate` protocol and // implements the method that the object detector calls once it // finishes performing detection on each input frame. class ObjectDetectorResultProcessor: NSObject, ObjectDetectorLiveStreamDelegate { func objectDetector( _ objectDetector: ObjectDetector, didFinishDetection objectDetectionResult: ObjectDetectorResult?, timestampInMilliseconds: Int, error: Error?) { // Process the detection result or errors here. } } let modelPath = Bundle.main.path(forResource: "model", ofType: "tflite") let options = ObjectDetectorOptions() options.baseOptions.modelAssetPath = modelPath options.runningMode = .liveStream options.maxResults = 5 // Assign an object of the class to the `objectDetectorLiveStreamDelegate` // property. let processor = ObjectDetectorResultProcessor() options.objectDetectorLiveStreamDelegate = processor let objectDetector = try ObjectDetector(options: options)

Objective-C

תמונה

@import MediaPipeTasksVision; NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"model" ofType:@"tflite"]; MPPObjectDetectorOptions *options = [[MPPObjectDetectorOptions alloc] init]; options.baseOptions.modelAssetPath = modelPath; options.runningMode = MPPRunningModeImage; options.maxResults = 5; MPPObjectDetector *objectDetector = [[MPPObjectDetector alloc] initWithOptions:options error:nil];

וידאו

@import MediaPipeTasksVision; NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"model" ofType:@"tflite"]; MPPObjectDetectorOptions *options = [[MPPObjectDetectorOptions alloc] init]; options.baseOptions.modelAssetPath = modelPath; options.runningMode = MPPRunningModeVideo; options.maxResults = 5; MPPObjectDetector *objectDetector = [[MPPObjectDetector alloc] initWithOptions:options error:nil];

שידור חי

@import MediaPipeTasksVision; // Class that conforms to the `ObjectDetectorLiveStreamDelegate` protocol and // implements the method that the object detector calls once it // finishes performing detection on each input frame. @interface APPObjectDetectorResultProcessor : NSObject@end @implementation MPPObjectDetectorResultProcessor - (void)objectDetector:(MPPObjectDetector *)objectDetector didFinishDetectionWithResult:(MPPObjectDetectorResult *)ObjectDetectorResult timestampInMilliseconds:(NSInteger)timestampInMilliseconds error:(NSError *)error { // Process the detection result or errors here. } @end NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"model" ofType:@"tflite"]; MPPObjectDetectorOptions *options = [[MPPObjectDetectorOptions alloc] init]; options.baseOptions.modelAssetPath = modelPath; options.runningMode = MPPRunningModeLiveStream; options.maxResults = 5; // Assign an object of the class to the `objectDetectorLiveStreamDelegate` // property. APPObjectDetectorResultProcessor *processor = [APPObjectDetectorResultProcessor new]; options.objectDetectorLiveStreamDelegate = processor; MPPObjectDetector *objectDetector = [[MPPObjectDetector alloc] initWithOptions:options error:nil];

אפשרויות הגדרה

למשימה הזו יש את אפשרויות התצורה הבאות לאפליקציות ל-iOS:

| שם האפשרות | תיאור | טווח ערכים | ערך ברירת מחדל |

|---|---|---|---|

runningMode |

הגדרת מצב ההפעלה של המשימה. יש שלושה מצבים: IMAGE: המצב להזנת תמונה אחת. VIDEO: המצב של פריימים מפוענחים של סרטון. LIVE_STREAM: המצב של סטרימינג בשידור חי של נתוני קלט, למשל ממצלמה. במצב הזה, צריך להפעיל את resultListener כדי להגדיר מאזין שיקבל את התוצאות באופן אסינכרוני. |

{RunningMode.image, RunningMode.video, RunningMode.liveStream} |

RunningMode.image |

displayNamesLocales |

הגדרת השפה של התוויות לשימוש בשמות התצוגה שסופקו במטא-נתונים של מודל המשימה, אם הם זמינים. ברירת המחדל היא en לאנגלית. אפשר להוסיף תוויות מותאמות לשוק המקומי למטא-נתונים של מודל מותאם אישית באמצעות TensorFlow Lite Metadata Writer API

|

קוד לוקאל | en |

maxResults |

מגדיר את המספר המקסימלי האופציונלי של תוצאות זיהוי עם הדירוג הגבוה ביותר שיוחזר. | מספרים חיוביים | -1 (כל התוצאות מוצגות) |

scoreThreshold |

הגדרת הסף של ציון התחזית, שמבטל את הסף שצוין במטא-נתונים של המודל (אם קיים). תוצאות מתחת לערך הזה נדחות. | כל ערך צף | לא מוגדר |

categoryAllowlist |

הגדרת רשימה אופציונלית של שמות קטגוריות מותרים. אם הערך לא ריק, תוצאות הזיהוי ששם הקטגוריה שלהן לא נמצא בקבוצה הזו יוסר. המערכת מתעלמת משמות קטגוריות כפולים או לא מוכרים.

האפשרות הזו לא תואמת לאפשרות categoryDenylist, ושימוש בשתיהן גורם לשגיאה. |

מחרוזות כלשהן | לא מוגדר |

categoryDenylist |

הגדרת רשימה אופציונלית של שמות קטגוריות אסורים. אם הערך לא ריק, תוצאות הזיהוי ששם הקטגוריה שלהן נמצא בקבוצה הזו יסוננו. המערכת מתעלמת משמות קטגוריות כפולים או לא מוכרים. האפשרות הזו לא תואמת לאפשרות categoryAllowlist, ושימוש בשתיהן גורם לשגיאה. |

מחרוזות כלשהן | לא מוגדר |

הגדרת שידור חי

כשמגדירים את מצב ההפעלה כשידור חי, נדרש ל-Object Detector את אפשרות ההגדרה הנוספת objectDetectorLiveStreamDelegate, שמאפשרת לגלאי לספק את תוצאות הזיהוי באופן אסינכרוני. ה-delegate מטמיע את השיטה objectDetector(_objectDetector:didFinishDetection:timestampInMilliseconds:error:), שנקראת על ידי Object Detector אחרי עיבוד תוצאת הזיהוי של כל פריים.

| שם האפשרות | תיאור | טווח ערכים | ערך ברירת מחדל |

|---|---|---|---|

objectDetectorLiveStreamDelegate |

הפעלת Object Detector לקבלת תוצאות זיהוי באופן אסינכרוני במצב של שידור חי. המחלקה שהמכונה שלה מוגדרת למאפיין הזה צריכה להטמיע את השיטה objectDetector(_:didFinishDetection:timestampInMilliseconds:error:). |

לא רלוונטי | לא מוגדר |

הכנת הנתונים

צריך להמיר את התמונה או את המסגרת של הקלט לאובייקט MPImage לפני שמעבירים אותו ל-Object Detector. MPImage תומך בסוגים שונים של פורמטים של תמונות ב-iOS, וניתן להשתמש בהם בכל מצב ריצה לצורך הסקת מסקנות. למידע נוסף על MPImage, אפשר לעיין במאמר MPImage API.

בוחרים את פורמט התמונה ל-iOS בהתאם לתרחיש לדוגמה ולמצב ההפעלה שנדרש לאפליקציה.MPImage תומך בפורמטים של תמונות ל-iOS UIImage, CVPixelBuffer ו-CMSampleBuffer.

UIImage

הפורמט UIImage מתאים במיוחד למצבי ההפעלה הבאים:

תמונות: אפשר להמיר תמונות מחבילת אפליקציות, מגלריית משתמשים או ממערכת קבצים בפורמט

UIImageלאובייקטMPImage.סרטונים: משתמשים ב-AVAssetImageGenerator כדי לחלץ פריימים של סרטונים לפורמט CGImage, ואז ממירים אותם לתמונות

UIImage.

Swift

// Load an image on the user's device as an iOS `UIImage` object. // Convert the `UIImage` object to a MediaPipe's Image object having the default // orientation `UIImage.Orientation.up`. let image = try MPImage(uiImage: image)

Objective-C

// Load an image on the user's device as an iOS `UIImage` object. // Convert the `UIImage` object to a MediaPipe's Image object having the default // orientation `UIImageOrientationUp`. MPImage *image = [[MPPImage alloc] initWithUIImage:image error:nil];

בדוגמה מתבצעת אתחול של MPImage עם כיוון ברירת המחדל UIImage.Orientation.Up. אפשר לאתחל את MPImage עם כל אחד מהערכים הנתמכים של UIImage.Orientation. 'זיהוי אובייקטים' לא תומך בכיוונים מוחזרים כמו .upMirrored, .downMirrored, .leftMirrored, .rightMirrored.

מידע נוסף על UIImage זמין במסמכי התיעוד למפתחים של Apple בנושא UIImage.

CVPixelBuffer

הפורמט CVPixelBuffer מתאים לאפליקציות שיוצרות פריימים ומשתמשות במסגרת CoreImage של iOS לעיבוד.

הפורמט CVPixelBuffer מתאים במיוחד למצבי ההפעלה הבאים:

תמונות: אפליקציות שיוצרות תמונות

CVPixelBufferאחרי עיבוד מסוים באמצעות מסגרתCoreImageשל iOS יכולות להישלח ל-Object Detector במצב 'הפעלת תמונה'.סרטונים: אפשר להמיר את הפריימים של הסרטון לפורמט

CVPixelBufferלצורך עיבוד, ואז לשלוח אותם ל-Object Detector במצב וידאו.שידור חי: יכול להיות שאפליקציות שמשתמשות במצלמת iOS כדי ליצור פריימים יומרו לפורמט

CVPixelBufferלצורך עיבוד לפני שהן נשלחות ל-Object Detector במצב שידור חי.

Swift

// Obtain a CVPixelBuffer. // Convert the `CVPixelBuffer` object to a MediaPipe's Image object having the default // orientation `UIImage.Orientation.up`. let image = try MPImage(pixelBuffer: pixelBuffer)

Objective-C

// Obtain a CVPixelBuffer. // Convert the `CVPixelBuffer` object to a MediaPipe's Image object having the // default orientation `UIImageOrientationUp`. MPImage *image = [[MPPImage alloc] initWithUIImage:image error:nil];

מידע נוסף על CVPixelBuffer זמין במסמכי התיעוד למפתחים של Apple בנושא CVPixelBuffer.

CMSampleBuffer

בפורמט CMSampleBuffer מאוחסנות דגימות מדיה מסוג מדיה אחיד, והוא מתאים במיוחד למצב ההפעלה של שידור חי. פריימים בשידור חי ממצלמות iOS מועברים באופן אסינכרוני בפורמט CMSampleBuffer על ידי AVCaptureVideoDataOutput של iOS.

Swift

// Obtain a CMSampleBuffer. // Convert the `CMSampleBuffer` object to a MediaPipe's Image object having the default // orientation `UIImage.Orientation.up`. let image = try MPImage(sampleBuffer: sampleBuffer)

Objective-C

// Obtain a `CMSampleBuffer`. // Convert the `CMSampleBuffer` object to a MediaPipe's Image object having the // default orientation `UIImageOrientationUp`. MPImage *image = [[MPPImage alloc] initWithSampleBuffer:sampleBuffer error:nil];

מידע נוסף על CMSampleBuffer זמין במסמכי העזרה למפתחים של Apple בנושא CMSampleBuffer.

הרצת המשימה

כדי להפעיל את Object Detector, משתמשים בשיטה detect() הספציפית למצב ההפעלה שהוקצה:

- תמונה סטטית:

detect(image:) - סרטון:

detect(videoFrame:timestampInMilliseconds:) - livestream:

detectAsync(image:)

בדוגמאות הקוד הבאות מפורטות דוגמאות בסיסיות להפעלת Object Detector במצבי ההפעלה השונים:

Swift

תמונה

let objectDetector.detect(image:image)

וידאו

let objectDetector.detect(videoFrame:image)

שידור חי

let objectDetector.detectAsync(image:image)

Objective-C

תמונה

MPPObjectDetectorResult *result = [objectDetector detectInImage:image error:nil];

וידאו

MPPObjectDetectorResult *result = [objectDetector detectInVideoFrame:image timestampInMilliseconds:timestamp error:nil];

שידור חי

BOOL success = [objectDetector detectAsyncInImage:image timestampInMilliseconds:timestamp error:nil];

בדוגמת הקוד של גלאי האובייקטים מוצגות ההטמעות של כל אחד מהמצבים האלה בפירוט רב יותר: detect(image:), detect(videoFrame:) ו-detectAsync(image:). קוד הדוגמה מאפשר למשתמש לעבור בין מצבי עיבוד, שיכול להיות שלא נדרשים לתרחיש לדוגמה שלכם.

שימו לב לנקודות הבאות:

כשמריצים את הקוד במצב וידאו או במצב שידור חי, צריך לספק גם את חותמת הזמן של פריים הקלט למשימה של 'זיהוי אובייקטים'.

כשהיא פועלת במצב תמונה או סרטון, המשימה 'זיהוי אובייקטים' חוסמת את השרשור הנוכחי עד שהיא מסיימת לעבד את התמונה או את הפריים של הקלט. כדי למנוע חסימה של השרשור הנוכחי, צריך להריץ את העיבוד בשרשור רקע באמצעות מסגרות ה-iOS Dispatch או NSOperation.

כשהיא פועלת במצב של שידור חי, המשימה של Object Detector חוזרת מיד ולא חוסמת את השרשור הנוכחי. הוא מפעיל את השיטה

objectDetector(_objectDetector:didFinishDetection:timestampInMilliseconds:error:)עם תוצאת הזיהוי אחרי עיבוד כל מסגרת קלט. ה-Object Detector מפעיל את השיטה הזו באופן אסינכרוני בתוך תור עיבוד נתונים טורית ייעודי. כדי להציג את התוצאות בממשק המשתמש, שולחים את התוצאות לתור הראשי אחרי העיבוד שלהן. אם הפונקציהdetectAsyncמופעלת בזמן שהמשימה של 'זיהוי אובייקטים' עסוקה בעיבוד של פריים אחר, 'זיהוי אובייקטים' מתעלם מפריים הקלט החדש.

טיפול בתוצאות והצגתן

לאחר הפעלת ההסקה, המשימה 'זיהוי אובייקטים' מחזירה אובייקט ObjectDetectorResult שמתאר את האובייקטים שאותרו בתמונה שהוזנה.

בהמשך מוצגת דוגמה לנתוני הפלט של המשימה הזו:

ObjectDetectorResult:

Detection #0:

Box: (x: 355, y: 133, w: 190, h: 206)

Categories:

index : 17

score : 0.73828

class name : dog

Detection #1:

Box: (x: 103, y: 15, w: 138, h: 369)

Categories:

index : 17

score : 0.73047

class name : dog

בתמונה הבאה מוצגת תצוגה חזותית של הפלט של המשימה:

בקוד לדוגמה של Object Detector מוסבר איך להציג את תוצאות הזיהוי שמוחזרות מהמשימה. פרטים נוספים זמינים בקוד לדוגמה.