تتيح Live API التفاعل مع Gemini صوتيًا ومرئيًا في الوقت الفعلي وبزمن انتقال منخفض. تعالج هذه الواجهة تدفقات مستمرة من الصوت والصور والنصوص لتقديم ردود فورية منطوقة تشبه ردود البشر، ما يتيح للمستخدمين تجربة محادثة طبيعية.

حالات الاستخدام

يمكن استخدام Live API لإنشاء وكلاء صوتيين في الوقت الفعلي لمجموعة متنوعة من المجالات، بما في ذلك:

- التجارة الإلكترونية والبيع بالتجزئة: مساعدو التسوّق الذين يقدّمون اقتراحات مخصّصة ووكلاء الدعم الذين يحلّون مشاكل العملاء

- الألعاب: شخصيات تفاعلية لا يتحكّم بها اللاعب (NPC) ومساعدون داخل اللعبة وترجمة في الوقت الفعلي للمحتوى داخل اللعبة

- الجيل التالي من واجهات المستخدم: تجارب تستخدم الصوت والفيديو في الروبوتات والنظارات الذكية والمركبات

- الرعاية الصحية: رفقاء صحيون لتقديم الدعم للمرضى وتثقيفهم

- الخدمات المالية: مستشارون يعملون بالذكاء الاصطناعي لإدارة الثروات وتقديم إرشادات حول الاستثمار

- التعليم: مرشدون ومرافقون للمتعلّمين يستندون إلى الذكاء الاصطناعي ويقدّمون تعليمات وملاحظات مخصّصة.

الميزات الرئيسية

تقدّم Live API مجموعة شاملة من الميزات لإنشاء وكلاء صوتيين فعّالين:

- دعم لغات متعددة: يمكنك التحدّث بـ 70 لغة متاحة.

- المقاطعة: يمكن للمستخدمين مقاطعة النموذج في أي وقت لإجراء تفاعلات سريعة الاستجابة.

- استخدام الأدوات: يدمج هذا الخيار أدوات مثل ميزة "طلب تنفيذ وظيفة" و"بحث Google" لإجراء تفاعلات ديناميكية.

- تحويل الصوت إلى نص: توفّر هذه الميزة نصوصًا من بيانات أدخلها المستخدم ومن مخرجات النموذج.

- الاستجابة الصوتية الاستباقية: تتيح لك التحكّم في وقت استجابة النموذج والسياقات التي يستجيب فيها.

- حوار تفاعلي تعاطفي: يعدّل أسلوب الرد ونبرته ليناسبا تعبيرات المستخدم.

المواصفات الفنية

يوضّح الجدول التالي المواصفات الفنية لواجهة Live API:

| الفئة | التفاصيل |

|---|---|

| طرق الإدخال | الصوت (صوت PCM خام بمعدل 16 بت، 16 كيلوهرتز، ترتيب البايتات الأصغر أولاً)، والصور (JPEG <= 1 لقطة في الثانية)، والنصوص |

| طُرق الإخراج | الصوت (صوت PCM خام بمعدل 16 بت، و24 كيلوهرتز، وترتيب وحدات البايت الأصغر أولاً) |

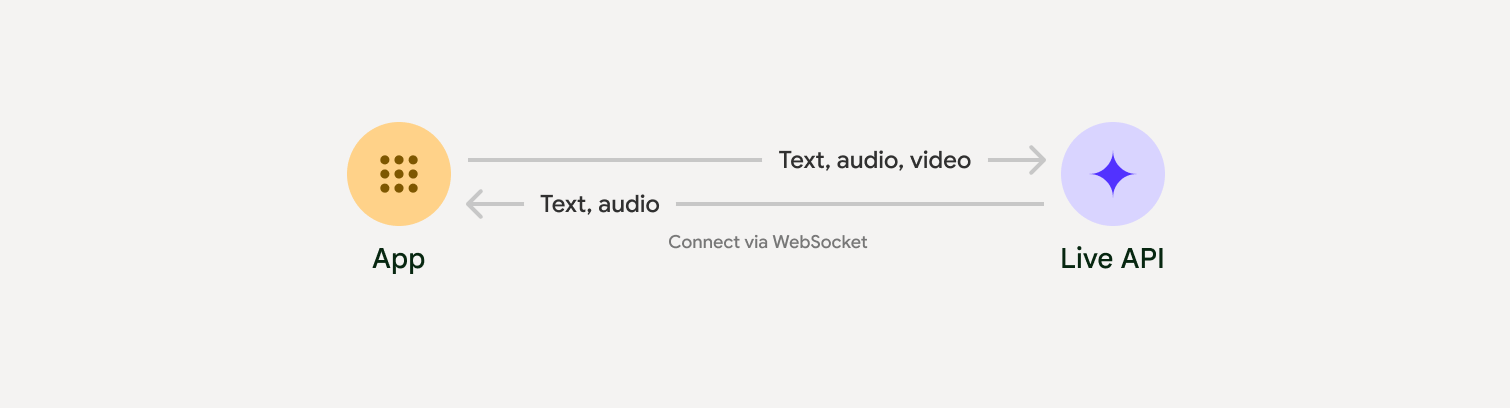

| البروتوكول | اتصال WebSocket ذو الحالة (WSS) |

اختيار طريقة التنفيذ

عند الدمج مع Live API، عليك اختيار أحد أساليب التنفيذ التالية:

- من الخادم إلى الخادم: يتصل الخلفية بواجهة Live API باستخدام WebSockets. عادةً، يرسل العميل بيانات البث (الصوت والفيديو والنص) إلى الخادم، الذي يعيد توجيهها إلى Live API.

- من العميل إلى الخادم: يتصل رمز الواجهة الأمامية مباشرةً بواجهة برمجة التطبيقات Live API باستخدام WebSockets لبث البيانات، ما يؤدي إلى تجاوز الواجهة الخلفية.

البدء

اختَر الدليل الذي يتوافق مع بيئة التطوير:

برنامج تعليمي حول حزمة تطوير البرامج (SDK) للذكاء الاصطناعي التوليدي

يمكنك الربط بواجهة Gemini Live API باستخدام حزمة GenAI SDK لإنشاء تطبيق متعدّد الوسائط في الوقت الفعلي مع خادم خلفي بلغة Python.

برنامج تعليمي حول WebSocket

يمكنك الربط بواجهة Gemini Live API باستخدام WebSockets لإنشاء تطبيق متعدّد الوسائط في الوقت الفعلي مع واجهة أمامية JavaScript ورموز مميزة مؤقتة.

برنامج تعليمي حول حزمة تطوير التطبيقات لنظام Android

أنشئ وكيلاً واستخدِم ميزة "البث المباشر" في "مجموعة أدوات تطوير الوكلاء" (ADK) لتفعيل التواصل الصوتي والمرئي.

عمليات الدمج مع الشركاء

لتسهيل عملية تطوير تطبيقات الصوت والفيديو في الوقت الفعلي، يمكنك استخدام عملية دمج تابعة لجهة خارجية تتوافق مع واجهة برمجة التطبيقات Gemini Live عبر WebRTC أو WebSockets.

LiveKit

استخدام Gemini Live API مع LiveKit Agents

Pipecat by Daily

إنشاء روبوت دردشة بالذكاء الاصطناعي في الوقت الفعلي باستخدام Gemini Live وPipecat

Fishjam من Software Mansion

يمكنك إنشاء تطبيقات لبث الفيديو المباشر والصوت باستخدام Fishjam.

وكلاء Vision حسب البث

يمكنك إنشاء تطبيقات ذكاء اصطناعي للصوت والفيديو في الوقت الفعلي باستخدام Vision Agents.

Voximplant

ربط المكالمات الواردة والصادرة بواجهة برمجة التطبيقات Live API باستخدام Voximplant

Agora

إنشاء تطبيقات ذكاء اصطناعي حوارية في الوقت الفعلي باستخدام Agora

Firebase AI SDK

ابدأ استخدام Gemini Live API من خلال Firebase AI Logic.