Live API を使用すると、Gemini と音声とビジョンによるやり取りを低レイテンシかつリアルタイムで行うことができます。音声、画像、テキストの連続ストリームを処理して、人間のような音声による応答を即座に提供し、ユーザーに自然な会話エクスペリエンスを提供します。

ユースケース

Live API を使用すると、次のようなさまざまな業界向けのリアルタイム音声エージェントを構築できます。

- e コマースと小売: パーソナライズされたおすすめを提供するショッピング アシスタントや、お客様の問題を解決するサポート エージェント。

- ゲーム: インタラクティブなノンプレーヤー キャラクター(NPC)、ゲーム内ヘルプ アシスタント、ゲーム内コンテンツのリアルタイム翻訳。

- 次世代インターフェース: ロボット、スマートグラス、車両での音声と動画に対応したエクスペリエンス。

- ヘルスケア: 患者のサポートと教育のためのヘルス コンパニオン。

- 金融サービス: 資産管理と投資ガイダンスのための AI アドバイザー。

- 教育: パーソナライズされた指導とフィードバックを提供する AI メンターと学習者コンパニオン。

主な機能

Live API は、堅牢な音声エージェントを構築するための包括的な機能セットを提供します。

- 多言語サポート: 70 の言語で会話できます。

- 割り込み: ユーザーはいつでもモデルを中断して、応答性の高いやり取りを行うことができます。

- ツールの使用: 関数呼び出しや Google 検索などのツールを統合して、動的な やり取りを実現します。

- 音声文字変換: ユーザー入力とモデル出力の両方のテキスト文字変換を提供します。

- プロアクティブ音声: モデルが応答するタイミングやコンテキストを制御できます。

- アフェクティブ ダイアログ: ユーザーの入力表現に合わせて、回答のスタイルとトーンを調整します。

技術仕様

次の表に、Live API の技術仕様の概要を示します。

| カテゴリ | 詳細 |

|---|---|

| 入力モダリティ | 音声(RAW 16 ビット PCM 音声、16kHz、リトル エンディアン)、画像(JPEG <= 1FPS)、テキスト |

| 出力モダリティ | 音声(RAW 16 ビット PCM 音声、24kHz、リトル エンディアン) |

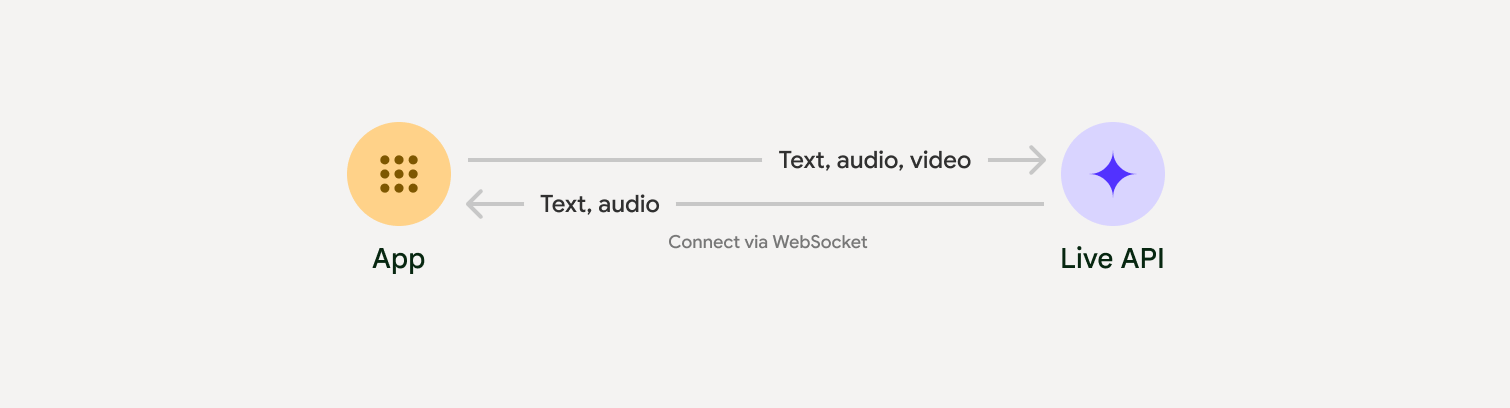

| プロトコル | ステートフル WebSocket 接続(WSS) |

実装方法を選択する

Live API と統合する場合は、次のいずれかの実装方法を選択する必要があります。

- サーバー間: バックエンドは Live API に WebSockets を使用して接続します。通常、クライアントはストリーム データ(音声、動画、テキスト)をサーバーに送信し、サーバーはそれを Live API に転送します。

- クライアントからサーバー: フロントエンド コードは Live API に直接接続し、WebSockets を使用してバックエンドをバイパスしてデータをストリーミングします。

始める

開発環境に一致するガイドを選択してください。

GenAI SDK のチュートリアル

GenAI SDK を使用して Gemini Live API に接続し、Python バックエンドでリアルタイムのマルチモーダル アプリケーションを構築します。

WebSocket のチュートリアル

WebSocket を使用して Gemini Live API に接続し、JavaScript フロントエンドとエフェメラル トークンを使用してリアルタイムのマルチモーダル アプリケーションを構築します。

ADK のチュートリアル

エージェントを作成し、Agent Development Kit(ADK)ストリーミングを使用して音声と動画の通信を有効にします。

パートナーとの統合

リアルタイムの音声アプリと動画アプリの開発を効率化するには、 WebRTC または WebSocket 経由で Gemini Live API をサポートするサードパーティ統合を使用します。

LiveKit

Gemini Live API を LiveKit エージェントで使用します。

Daily の Pipecat

Gemini Live と Pipecat を使用してリアルタイムの AI チャットボットを作成します。

Software Mansion の Fishjam

Fishjam を使用してライブ動画と音声のストリーミング アプリケーションを作成します。

Stream の Vision Agents

Vision Agents を使用してリアルタイムの音声と動画の AI アプリケーションを構築します。

Voximplant

Voximplant を使用して、インバウンド通話とアウトバウンド通話を Live API に接続します。

Agora

Agora を使用してリアルタイムの会話型 AI アプリケーションを構築します。

Firebase AI SDK

Firebase AI Logic を使用して Gemini Live API を使ってみましょう。