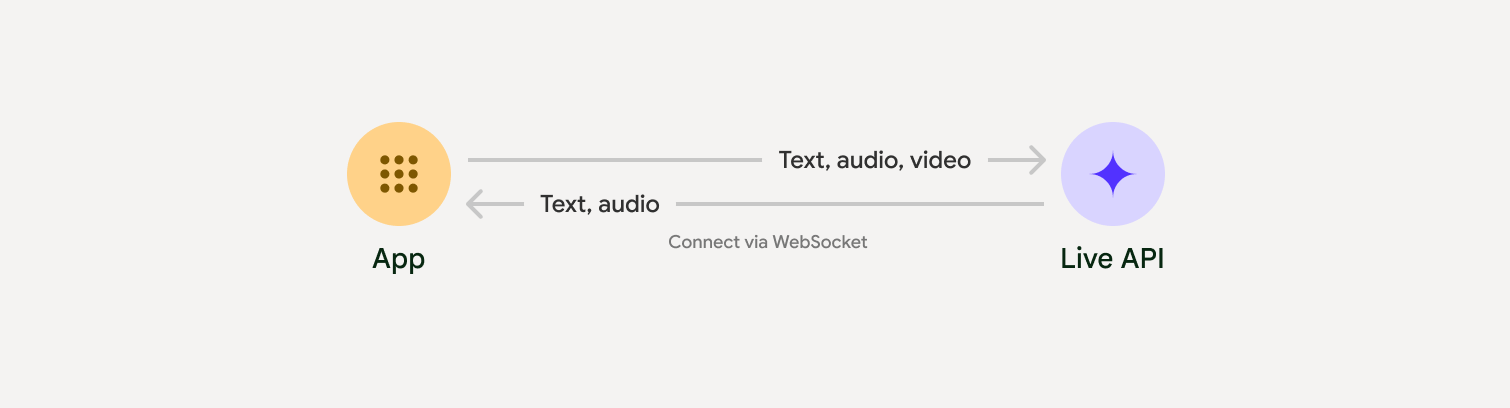

Live API는 Gemini와의 지연 시간이 짧은 실시간 음성 및 시각 상호작용을 지원합니다. 연속적인 오디오, 이미지, 텍스트 스트림을 처리하여 즉각적이고 사람과 유사한 음성 대답을 제공하므로 사용자에게 자연스러운 대화형 환경을 제공합니다.

사용 사례

Live API를 사용하여 다음을 비롯한 다양한 업계의 실시간 음성 에이전트를 빌드할 수 있습니다.

- 전자상거래 및 소매: 맞춤형 추천을 제공하는 쇼핑 어시스턴트와 고객 문제를 해결하는 지원 에이전트

- 게임: 대화형 논플레이어 캐릭터(NPC), 인게임 도움말 어시스턴트, 인게임 콘텐츠의 실시간 번역

- 차세대 인터페이스: 로봇 공학, 스마트 글라스, 차량에서 음성 및 동영상 지원 환경

- 의료: 환자 지원 및 교육을 위한 건강 도우미

- 금융 서비스: 자산 관리 및 투자 안내를 위한 AI 자문가

- 교육: 맞춤형 안내와 의견을 제공하는 AI 멘토 및 학습자 도우미

주요 특징

Live API는 강력한 음성 에이전트를 빌드하기 위한 포괄적인 기능 세트를 제공합니다.

- 다국어 지원: 지원되는 70개 언어로 대화할 수 있습니다.

- 통화 참여: 사용자는 언제든지 모델을 중단하여 응답형 상호작용을 할 수 있습니다.

- 도구 사용: 함수 호출 및 Google 검색과 같은 도구를 통합하여 역동적인 상호작용을 지원합니다.

- 오디오 스크립트 작성: 사용자 입력과 모델 출력의 텍스트 스크립트를 제공합니다.

- 능동적 오디오: 모델이 응답하는 시점과 컨텍스트를 제어할 수 있습니다.

- 공감형 대화: 사용자의 입력 표현에 맞게 대답 스타일과 어조를 조정합니다.

기술 사양

다음 표에는 Live API의 기술 사양이 나와 있습니다.

| 카테고리 | 세부정보 |

|---|---|

| 입력 모달리티 | 오디오 (원시 16비트 PCM 오디오, 16kHz, 리틀 엔디안), 이미지 (JPEG <= 1FPS), 텍스트 |

| 출력 모달리티 | 오디오 (원시 16비트 PCM 오디오, 24kHz, 리틀 엔디안) |

| 프로토콜 | 스테이트풀 WebSocket 연결(WSS) |

구현 접근 방식 선택

Live API와 통합할 때는 다음 구현 접근 방식 중 하나를 선택해야 합니다.

- 서버 간: 백엔드가 WebSockets를 사용하여 Live API에 연결됩니다. 일반적으로 클라이언트는 스트림 데이터 (오디오, 동영상, 텍스트)를 서버로 전송하고 서버는 이를 Live API로 전달합니다.

- 클라이언트-서버: 프런트엔드 코드가 WebSockets을 사용하여 Live API에 직접 연결하여 데이터를 스트리밍하고 백엔드를 우회합니다.

시작하기

개발 환경에 맞는 가이드를 선택합니다.

WebSocket 튜토리얼

WebSocket을 사용하여 Gemini Live API에 연결하여 JavaScript 프런트엔드와 일회성 토큰으로 실시간 멀티모달 애플리케이션을 빌드합니다.

파트너 연동

실시간 오디오 및 동영상 앱의 개발을 간소화하려면 WebRTC 또는 WebSocket을 통해 Gemini Live API를 지원하는 서드 파티 통합을 사용하면 됩니다.

LiveKit

LiveKit 에이전트와 함께 Gemini Live API를 사용합니다.

Daily의 Pipecat

Gemini Live 및 Pipecat을 사용하여 실시간 AI 챗봇을 만드세요.

Software Mansion의 Fishjam

Fishjam으로 라이브 동영상 및 오디오 스트리밍 애플리케이션을 만드세요.

스트림의 Vision Agents

Vision Agent로 실시간 음성 및 동영상 AI 애플리케이션을 빌드하세요.

Voximplant

Voximplant를 사용하여 인바운드 및 아웃바운드 통화를 Live API에 연결합니다.

Agora

Agora로 실시간 대화형 AI 애플리케이션을 빌드하세요.

Firebase AI SDK

Firebase AI Logic을 사용하여 Gemini Live API를 시작하세요.