A API Live permite interações de voz e visão em tempo real e de baixa latência com o Gemini. Ela processa streams contínuos de áudio, imagens e texto para oferecer respostas faladas imediatas e semelhantes às humanas, criando uma experiência de conversa natural para os usuários.

Casos de uso

A API Live pode ser usada para criar agentes de voz em tempo real para vários setores, incluindo:

- E-commerce e varejo:assistentes de compras que oferecem recomendações personalizadas e representantes de suporte ao cliente que resolvem problemas dos clientes.

- Jogos:personagens não jogáveis (NPCs) interativos, assistentes de ajuda no jogo e tradução em tempo real do conteúdo do jogo.

- Interfaces de última geração:experiências ativadas por voz e vídeo em robótica, óculos inteligentes e veículos.

- Saúde:acompanhantes de saúde para suporte e educação de pacientes.

- Serviços financeiros:consultores de IA para gestão de patrimônio e orientação de investimentos.

- Educação:mentores de IA e acompanhantes de estudantes que oferecem instrução e feedback personalizados.

Principais recursos

A API Live oferece um conjunto abrangente de recursos para criar agentes de voz robustos:

- Suporte multilíngue: Converse em 70 idiomas compatíveis.

- Interrupção: os usuários podem interromper o modelo a qualquer momento para interações responsivas.

- Uso de ferramentas: integra ferramentas como chamadas de função e a Pesquisa Google para interações dinâmicas.

- Transcrições de áudio: fornece transcrições de texto da entrada do usuário e da saída do modelo.

- Áudio proativo: permite controlar quando e em quais contextos o modelo responde.

- Diálogo afetivo: adapta o estilo e o tom da resposta para corresponder à expressão de entrada do usuário.

Especificações técnicas

A tabela a seguir descreve as especificações técnicas da API Live:

| Categoria | Detalhes |

|---|---|

| Modalidades de entrada | Áudio (áudio PCM bruto de 16 bits, 16 kHz, little-endian), imagens (JPEG <= 1 FPS), texto |

| Modalidades de saída | Áudio (áudio PCM bruto de 16 bits, 24 kHz, little-endian) |

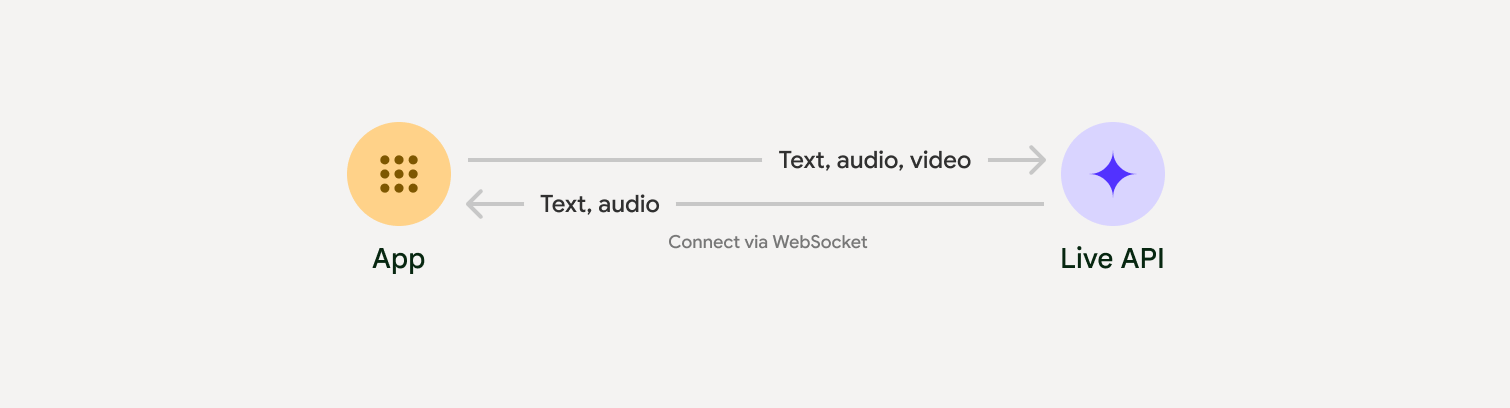

| Protocolo | Conexão WebSocket com estado (WSS) |

Escolher uma abordagem de implementação

Ao fazer a integração com a API Live, você precisa escolher uma das seguintes abordagens de implementação:

- Servidor para servidor: seu back-end se conecta à API Live usando WebSockets. Normalmente, o cliente envia dados de stream (áudio, vídeo, texto) para o servidor, que os encaminha para a API Live.

- Cliente para servidor: o código de front-end se conecta diretamente à API Live usando WebSockets para transmitir dados, ignorando o back-end.

Primeiros passos

Selecione o guia que corresponde ao seu ambiente de desenvolvimento:

Tutorial do SDK GenAI

Conecte-se à API Gemini Live usando o SDK GenAI para criar um aplicativo multimodal em tempo real com um back-end Python.

Tutorial do WebSocket

Conecte-se à API Gemini Live usando WebSockets para criar um aplicativo multimodal em tempo real com um front-end JavaScript e tokens efêmeros.

Tutorial do ADK

Crie um agente e use o Kit de Desenvolvimento de Agentes (ADK) Streaming para ativar a comunicação de voz e vídeo.

Integrações com parceiros

Para simplificar o desenvolvimento de apps de áudio e vídeo em tempo real, use uma integração de terceiros que ofereça suporte à API Gemini Live no WebRTC ou WebSockets.

LiveKit

Use a API Gemini Live com agentes do LiveKit.

Pipecat by Daily

Crie um chatbot de IA em tempo real usando o Gemini Live e o Pipecat.

Fishjam by Software Mansion

Crie aplicativos de streaming de áudio e vídeo ao vivo com o Fishjam.

Vision Agents by Stream

Crie aplicativos de IA de voz e vídeo em tempo real com o Vision Agents.

Voximplant

Conecte chamadas recebidas e efetuadas à API Live com o Voximplant.

Agora

Crie aplicativos de IA conversacional em tempo real com o Agora.

SDK de IA do Firebase

Comece a usar a API Gemini Live com o Firebase AI Logic.