L'API Gemini permet la génération augmentée par récupération (RAG) grâce à l'outil de recherche de fichiers. La recherche de fichiers importe, segmente et indexe vos données pour permettre une récupération rapide des informations pertinentes en fonction d'une requête fournie. Ces informations sont ensuite utilisées comme contexte pour le modèle, ce qui lui permet de fournir des réponses plus précises et pertinentes.

Pour rendre la recherche de fichiers simple et abordable pour les développeurs, nous proposons sans frais le stockage de fichiers et la génération d'embeddings au moment de la requête. Vous ne payez que pour la création d'embeddings lors de la première indexation de vos fichiers (au coût applicable du modèle d'embedding) et pour le coût normal des jetons d'entrée / de sortie du modèle Gemini. Ce nouveau modèle de facturation facilite et rend plus rentable la création et la mise à l'échelle de l'outil de recherche de fichiers.

Importer directement dans le magasin de recherche de fichiers

Cet exemple montre comment importer directement un fichier dans le magasin de recherche de fichiers :

Python

from google import genai

from google.genai import types

import time

client = genai.Client()

# File name will be visible in citations

file_search_store = client.file_search_stores.create(config={'display_name': 'your-fileSearchStore-name'})

operation = client.file_search_stores.upload_to_file_search_store(

file='sample.txt',

file_search_store_name=file_search_store.name,

config={

'display_name' : 'display-file-name',

}

)

while not operation.done:

time.sleep(5)

operation = client.operations.get(operation)

response = client.models.generate_content(

model="gemini-3-flash-preview",

contents="""Can you tell me about [insert question]""",

config=types.GenerateContentConfig(

tools=[

types.Tool(

file_search=types.FileSearch(

file_search_store_names=[file_search_store.name]

)

)

]

)

)

print(response.text)

JavaScript

const { GoogleGenAI } = require('@google/genai');

const ai = new GoogleGenAI({});

async function run() {

// File name will be visible in citations

const fileSearchStore = await ai.fileSearchStores.create({

config: { displayName: 'your-fileSearchStore-name' }

});

let operation = await ai.fileSearchStores.uploadToFileSearchStore({

file: 'file.txt',

fileSearchStoreName: fileSearchStore.name,

config: {

displayName: 'file-name',

}

});

while (!operation.done) {

await new Promise(resolve => setTimeout(resolve, 5000));

operation = await ai.operations.get({ operation });

}

const response = await ai.models.generateContent({

model: "gemini-3-flash-preview",

contents: "Can you tell me about [insert question]",

config: {

tools: [

{

fileSearch: {

fileSearchStoreNames: [fileSearchStore.name]

}

}

]

}

});

console.log(response.text);

}

run();

Pour en savoir plus, consultez la documentation de référence de l'API pour uploadToFileSearchStore.

Importation de fichiers

Vous pouvez également importer un fichier existant dans votre magasin de recherche de fichiers :

Python

from google import genai

from google.genai import types

import time

client = genai.Client()

# File name will be visible in citations

sample_file = client.files.upload(file='sample.txt', config={'name': 'display_file_name'})

file_search_store = client.file_search_stores.create(config={'display_name': 'your-fileSearchStore-name'})

operation = client.file_search_stores.import_file(

file_search_store_name=file_search_store.name,

file_name=sample_file.name

)

while not operation.done:

time.sleep(5)

operation = client.operations.get(operation)

response = client.models.generate_content(

model="gemini-3-flash-preview",

contents="""Can you tell me about [insert question]""",

config=types.GenerateContentConfig(

tools=[

types.Tool(

file_search=types.FileSearch(

file_search_store_names=[file_search_store.name]

)

)

]

)

)

print(response.text)

JavaScript

const { GoogleGenAI } = require('@google/genai');

const ai = new GoogleGenAI({});

async function run() {

// File name will be visible in citations

const sampleFile = await ai.files.upload({

file: 'sample.txt',

config: { name: 'file-name' }

});

const fileSearchStore = await ai.fileSearchStores.create({

config: { displayName: 'your-fileSearchStore-name' }

});

let operation = await ai.fileSearchStores.importFile({

fileSearchStoreName: fileSearchStore.name,

fileName: sampleFile.name

});

while (!operation.done) {

await new Promise(resolve => setTimeout(resolve, 5000));

operation = await ai.operations.get({ operation: operation });

}

const response = await ai.models.generateContent({

model: "gemini-3-flash-preview",

contents: "Can you tell me about [insert question]",

config: {

tools: [

{

fileSearch: {

fileSearchStoreNames: [fileSearchStore.name]

}

}

]

}

});

console.log(response.text);

}

run();

Pour en savoir plus, consultez la documentation de référence de l'API pour importFile.

Configuration de la segmentation

Lorsque vous importez un fichier dans un magasin de recherche de fichiers, il est automatiquement divisé en segments, intégré, indexé et importé dans votre magasin de recherche de fichiers. Si vous

avez besoin de plus de contrôle sur la stratégie de segmentation, vous pouvez spécifier un

chunking_config paramètre

pour définir un nombre maximal de jetons par segment et un nombre maximal de jetons qui se chevauchent.

Python

from google import genai

from google.genai import types

import time

client = genai.Client()

operation = client.file_search_stores.upload_to_file_search_store(

file_search_store_name=file_search_store.name,

file_name=sample_file.name,

config={

'chunking_config': {

'white_space_config': {

'max_tokens_per_chunk': 200,

'max_overlap_tokens': 20

}

}

}

)

while not operation.done:

time.sleep(5)

operation = client.operations.get(operation)

print("Custom chunking complete.")

JavaScript

const { GoogleGenAI } = require('@google/genai');

const ai = new GoogleGenAI({});

let operation = await ai.fileSearchStores.uploadToFileSearchStore({

file: 'file.txt',

fileSearchStoreName: fileSearchStore.name,

config: {

displayName: 'file-name',

chunkingConfig: {

whiteSpaceConfig: {

maxTokensPerChunk: 200,

maxOverlapTokens: 20

}

}

}

});

while (!operation.done) {

await new Promise(resolve => setTimeout(resolve, 5000));

operation = await ai.operations.get({ operation });

}

console.log("Custom chunking complete.");

Pour utiliser votre magasin de recherche de fichiers, transmettez-le en tant qu'outil à la generateContent

méthode, comme indiqué dans les exemples d'importation.

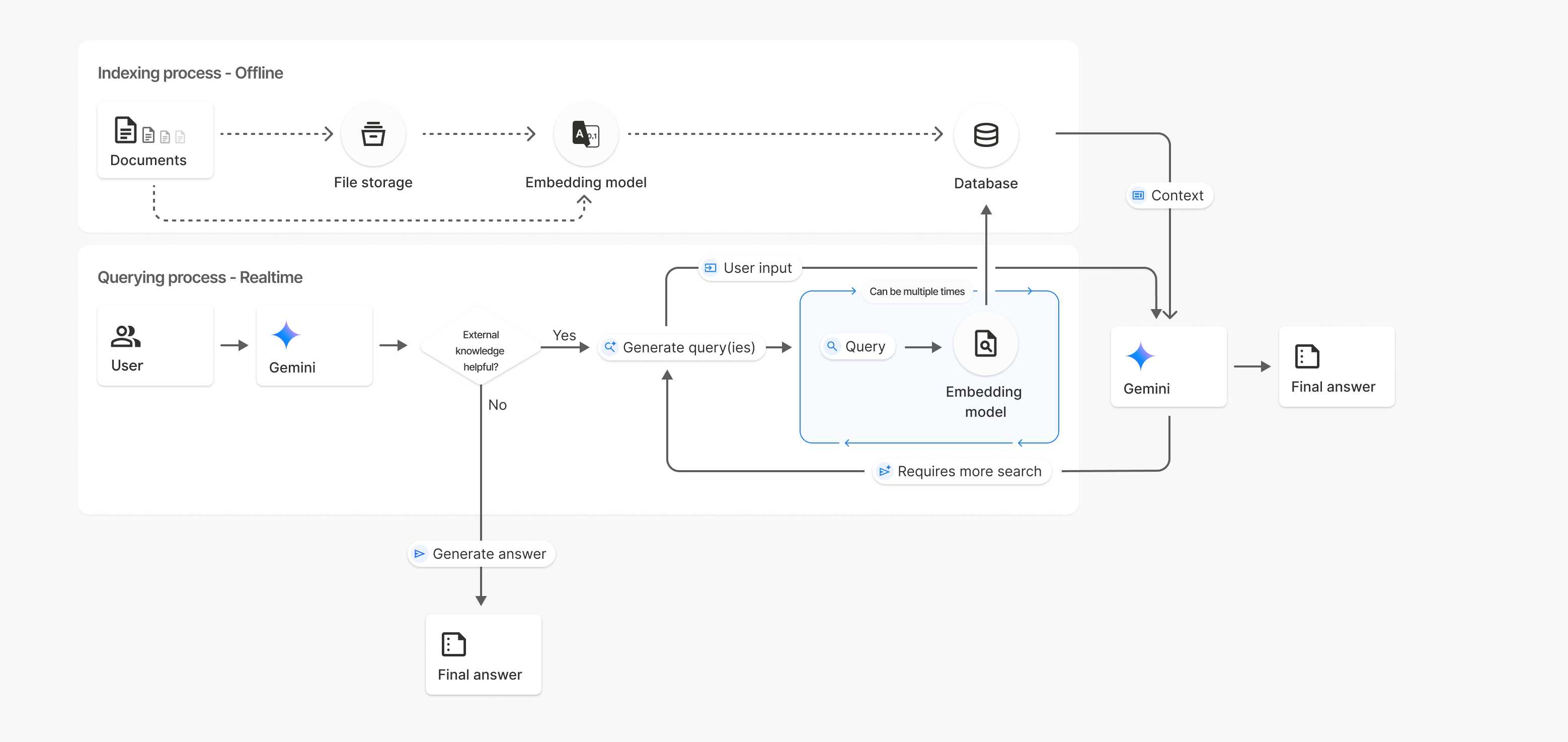

Fonctionnement

La recherche de fichiers utilise une technique appelée recherche sémantique pour trouver des informations pertinentes pour la requête de l'utilisateur. Contrairement à la recherche standard basée sur des mots clés, la recherche sémantique comprend la signification et le contexte de votre requête.

Lorsque vous importez un fichier, il est converti en représentations numériques appelées embeddings, qui capturent la signification sémantique de le texte. Ces embeddings sont stockés dans une base de données de recherche de fichiers spécialisée. Lorsque vous effectuez une requête, elle est également convertie en embedding. Le système effectue ensuite une recherche de fichiers pour trouver les segments de document les plus similaires et pertinents dans le magasin de recherche de fichiers.

Il n'y a pas de durée de vie (TTL) pour les embeddings et les fichiers. Ils sont conservés jusqu'à ce qu'ils soient supprimés manuellement ou lorsque le modèle est obsolète.

Voici le processus d'utilisation de l'API uploadToFileSearchStore de recherche de fichiers :

Créer un magasin de recherche de fichiers : un magasin de recherche de fichiers contient les données traitées de vos fichiers. Il s'agit du conteneur persistant pour les embeddings sur lesquels la recherche sémantique fonctionnera.

Importer un fichier dans un magasin de recherche de fichiers : importez simultanément un fichier et importez les résultats dans votre magasin de recherche de fichiers. Cela crée un objet

Filetemporaire, qui est une référence à votre document brut. Ces données sont ensuite segmentées, converties en embeddings de recherche de fichiers et indexées. L'objetFileest supprimé au bout de 48 heures, tandis que les données importées dans le magasin de recherche de fichiers sont stockées indéfiniment jusqu'à ce que vous choisissiez de les supprimer.Effectuer une requête avec la recherche de fichiers : enfin, vous utilisez l'outil

FileSearchdans un appelgenerateContent. Dans la configuration de l'outil, vous spécifiez unFileSearchRetrievalResource, qui pointe vers leFileSearchStoredans lequel vous souhaitez effectuer une recherche. Cela indique au modèle d'effectuer une recherche sémantique dans ce magasin de recherche de fichiers spécifique pour trouver des informations pertinentes afin d'ancrer sa réponse.

Dans ce schéma, la ligne en pointillés de Documents à Modèle d'embedding

(à l'aide de gemini-embedding-001)

représente l'API uploadToFileSearchStore (en contournant Stockage de fichiers).

Sinon, l'utilisation de l'API Files pour créer séparément

et ensuite importer des fichiers déplace le processus d'indexation de Documents vers

Stockage de fichiers et ensuite vers Modèle d'embedding.

Magasins de recherche de fichiers

Un magasin de recherche de fichiers est un conteneur pour les embeddings de vos documents. Bien que les fichiers bruts importés via l'API Files soient supprimés au bout de 48 heures, les données importées dans un magasin de recherche de fichiers sont stockées indéfiniment jusqu'à ce que vous les supprimiez manuellement. Vous pouvez créer plusieurs magasins de recherche de fichiers pour organiser vos documents. L'API FileSearchStore vous permet de créer, de lister, d'obtenir et de supprimer des magasins de recherche de fichiers pour les gérer. Les noms des magasins de recherche de fichiers ont une portée globale.

Voici quelques exemples de gestion de vos magasins de recherche de fichiers :

Python

file_search_store = client.file_search_stores.create(config={'display_name': 'my-file_search-store-123'})

for file_search_store in client.file_search_stores.list():

print(file_search_store)

my_file_search_store = client.file_search_stores.get(name='fileSearchStores/my-file_search-store-123')

client.file_search_stores.delete(name='fileSearchStores/my-file_search-store-123', config={'force': True})

JavaScript

const fileSearchStore = await ai.fileSearchStores.create({

config: { displayName: 'my-file_search-store-123' }

});

const fileSearchStores = await ai.fileSearchStores.list();

for await (const store of fileSearchStores) {

console.log(store);

}

const myFileSearchStore = await ai.fileSearchStores.get({

name: 'fileSearchStores/my-file_search-store-123'

});

await ai.fileSearchStores.delete({

name: 'fileSearchStores/my-file_search-store-123',

config: { force: true }

});

REST

curl -X POST "https://generativelanguage.googleapis.com/v1beta/fileSearchStores?key=${GEMINI_API_KEY}" \

-H "Content-Type: application/json"

-d '{ "displayName": "My Store" }'

curl "https://generativelanguage.googleapis.com/v1beta/fileSearchStores?key=${GEMINI_API_KEY}" \

curl "https://generativelanguage.googleapis.com/v1beta/fileSearchStores/my-file_search-store-123?key=${GEMINI_API_KEY}"

curl -X DELETE "https://generativelanguage.googleapis.com/v1beta/fileSearchStores/my-file_search-store-123?key=${GEMINI_API_KEY}"

Documents de recherche de fichiers

Vous pouvez gérer des documents individuels dans vos magasins de fichiers avec l'

API File Search Documents pour list chaque document

dans un magasin de recherche de fichiers, get des informations sur un document et delete un

document par nom.

Python

for document_in_store in client.file_search_stores.documents.list(parent='fileSearchStores/my-file_search-store-123'):

print(document_in_store)

file_search_document = client.file_search_stores.documents.get(name='fileSearchStores/my-file_search-store-123/documents/my_doc')

print(file_search_document)

client.file_search_stores.documents.delete(name='fileSearchStores/my-file_search-store-123/documents/my_doc')

JavaScript

const documents = await ai.fileSearchStores.documents.list({

parent: 'fileSearchStores/my-file_search-store-123'

});

for await (const doc of documents) {

console.log(doc);

}

const fileSearchDocument = await ai.fileSearchStores.documents.get({

name: 'fileSearchStores/my-file_search-store-123/documents/my_doc'

});

await ai.fileSearchStores.documents.delete({

name: 'fileSearchStores/my-file_search-store-123/documents/my_doc'

});

REST

curl "https://generativelanguage.googleapis.com/v1beta/fileSearchStores/my-file_search-store-123/documents?key=${GEMINI_API_KEY}"

curl "https://generativelanguage.googleapis.com/v1beta/fileSearchStores/my-file_search-store-123/documents/my_doc?key=${GEMINI_API_KEY}"

curl -X DELETE "https://generativelanguage.googleapis.com/v1beta/fileSearchStores/my-file_search-store-123/documents/my_doc?key=${GEMINI_API_KEY}"

Métadonnées des fichiers

Vous pouvez ajouter des métadonnées personnalisées à vos fichiers pour les filtrer ou fournir un contexte supplémentaire. Les métadonnées sont un ensemble de paires clé/valeur.

Python

op = client.file_search_stores.import_file(

file_search_store_name=file_search_store.name,

file_name=sample_file.name,

custom_metadata=[

{"key": "author", "string_value": "Robert Graves"},

{"key": "year", "numeric_value": 1934}

]

)

JavaScript

let operation = await ai.fileSearchStores.importFile({

fileSearchStoreName: fileSearchStore.name,

fileName: sampleFile.name,

config: {

customMetadata: [

{ key: "author", stringValue: "Robert Graves" },

{ key: "year", numericValue: 1934 }

]

}

});

Cela est utile lorsque vous avez plusieurs documents dans un magasin de recherche de fichiers et que vous ne souhaitez effectuer une recherche que dans un sous-ensemble d'entre eux.

Python

response = client.models.generate_content(

model="gemini-3-flash-preview",

contents="Tell me about the book 'I, Claudius'",

config=types.GenerateContentConfig(

tools=[

types.Tool(

file_search=types.FileSearch(

file_search_store_names=[file_search_store.name],

metadata_filter="author=Robert Graves",

)

)

]

)

)

print(response.text)

JavaScript

const response = await ai.models.generateContent({

model: "gemini-3-flash-preview",

contents: "Tell me about the book 'I, Claudius'",

config: {

tools: [

{

fileSearch: {

fileSearchStoreNames: [fileSearchStore.name],

metadataFilter: 'author="Robert Graves"',

}

}

]

}

});

console.log(response.text);

REST

curl "https://generativelanguage.googleapis.com/v1beta/models/gemini-3-flash-preview:generateContent?key=${GEMINI_API_KEY}" \

-H 'Content-Type: application/json' \

-X POST \

-d '{

"contents": [{

"parts":[{"text": "Tell me about the book I, Claudius"}]

}],

"tools": [{

"file_search": {

"file_search_store_names":["'$STORE_NAME'"],

"metadata_filter": "author = \"Robert Graves\""

}

}]

}' 2> /dev/null > response.json

cat response.json

Pour obtenir des conseils sur l'implémentation de la syntaxe de filtre de liste pour metadata_filter, consultez

google.aip.dev/160.

Citations

Lorsque vous utilisez la recherche de fichiers, la réponse du modèle peut inclure des citations qui spécifient les parties de vos documents importés qui ont été utilisées pour générer la réponse. Cela facilite la vérification des faits.

Vous pouvez accéder aux informations de citation via l'attribut grounding_metadata de la réponse.

Python

print(response.candidates[0].grounding_metadata)

JavaScript

console.log(JSON.stringify(response.candidates?.[0]?.groundingMetadata, null, 2));

Pour obtenir des informations détaillées sur la structure des métadonnées d'ancrage, consultez les exemples du livre de recettes de la recherche de fichiers ou la section sur l'ancrage de la documentation sur l'ancrage avec la recherche Google.

Métadonnées personnalisées dans les données d'ancrage

Si vous avez ajouté des métadonnées personnalisées à vos fichiers, vous pouvez y accéder dans les métadonnées d'ancrage de la réponse du modèle. Cela est utile pour transmettre un contexte supplémentaire (comme des URL, des numéros de page ou des auteurs) de vos documents sources à la logique de votre application. Chaque grounding_chunk dans le retrieved_context contient ces métadonnées personnalisées.

Python

response = client.models.generate_content(

model="gemini-3-flash-preview",

contents="Tell me about [insert question]",

config=types.GenerateContentConfig(

tools=[

types.Tool(

file_search=types.FileSearch(

file_search_store_names=[file_search_store.name]

)

)

]

)

)

for chunk in response.candidates[0].grounding_metadata.grounding_chunks:

if chunk.retrieved_context:

print(f"Text: {chunk.retrieved_context.text}")

if chunk.retrieved_context.custom_metadata:

for metadata in chunk.retrieved_context.custom_metadata:

print(f"Metadata Key: {metadata.key}")

print(f"Value: {metadata.string_value or metadata.numeric_value}")

JavaScript

const response = await ai.models.generateContent({

model: "gemini-3-flash-preview",

contents: "Tell me about [insert question]",

config: {

tools: [

{

fileSearch: {

fileSearchStoreNames: [fileSearchStore.name]

}

}

]

}

});

const groundingMetadata = response.candidates[0].groundingMetadata;

groundingMetadata.groundingChunks.forEach((chunk) => {

if (chunk.retrievedContext) {

console.log(`Text: ${chunk.retrievedContext.text}`);

if (chunk.retrievedContext.customMetadata) {

chunk.retrievedContext.customMetadata.forEach((metadata) => {

console.log(`Metadata Key: ${metadata.key}`);

console.log(`Value: ${metadata.stringValue || metadata.numericValue}`);

});

}

}

});

REST

{

"candidates": [

{

"content": { ... },

"grounding_metadata": {

"grounding_chunks": [

{

"retrieved_context": {

"text": "...",

"title": "...",

"uri": "...",

"custom_metadata": [

{

"key": "author",

"string_value": "Robert Graves"

},

{

"key": "year",

"numeric_value": 1934

}

]

}

}

],

"grounding_supports": [ ... ]

}

}

]

}

Sortie structurée

À partir des modèles Gemini 3, vous pouvez combiner l'outil de recherche de fichiers avec des sorties structurées.

Python

from pydantic import BaseModel, Field

class Money(BaseModel):

amount: str = Field(description="The numerical part of the amount.")

currency: str = Field(description="The currency of amount.")

response = client.models.generate_content(

model="gemini-3-flash-preview",

contents="What is the minimum hourly wage in Tokyo right now?",

config=types.GenerateContentConfig(

tools=[

types.Tool(

file_search=types.FileSearch(

file_search_store_names=[file_search_store.name]

)

)

],

response_mime_type="application/json",

response_schema=Money.model_json_schema()

)

)

result = Money.model_validate_json(response.text)

print(result)

JavaScript

import { z } from "zod";

const moneySchema = z.object({

amount: z.string().describe("The numerical part of the amount."),

currency: z.string().describe("The currency of amount."),

});

async function run() {

const response = await ai.models.generateContent({

model: "gemini-3-flash-preview",

contents: "What is the minimum hourly wage in Tokyo right now?",

config: {

tools: [

{

fileSearch: {

fileSearchStoreNames: [file_search_store.name],

},

},

],

responseMimeType: "application/json",

responseJsonSchema: z.toJSONSchema(moneySchema),

},

});

const result = moneySchema.parse(JSON.parse(response.text));

console.log(result);

}

run();

REST

curl "https://generativelanguage.googleapis.com/v1beta/models/gemini-3-flash-preview:generateContent" \

-H "x-goog-api-key: $GEMINI_API_KEY" \

-H 'Content-Type: application/json' \

-X POST \

-d '{

"contents": [{

"parts": [{"text": "What is the minimum hourly wage in Tokyo right now?"}]

}],

"tools": [

{

"fileSearch": {

"fileSearchStoreNames": ["$FILE_SEARCH_STORE_NAME"]

}

}

],

"generationConfig": {

"responseMimeType": "application/json",

"responseJsonSchema": {

"type": "object",

"properties": {

"amount": {"type": "string", "description": "The numerical part of the amount."},

"currency": {"type": "string", "description": "The currency of amount."}

},

"required": ["amount", "currency"]

}

}

}'

Modèles compatibles

Les modèles suivants sont compatibles avec la recherche de fichiers :

| Modèle | Recherche de fichiers |

|---|---|

| Gemini 3.1 Pro (preview) | ✔️ |

| Gemini 3.1 Flash-Lite (preview) | ✔️ |

| Gemini 3 Flash (preview) | ✔️ |

| Gemini 2.5 Pro | ✔️ |

| Gemini 2.5 Flash-Lite | ✔️ |

Combinaisons d'outils compatibles

Les modèles Gemini 3 sont compatibles avec la combinaison d'outils intégrés (comme la recherche de fichiers) et d'outils personnalisés (appel de fonction). Pour en savoir plus, consultez la page sur les combinaisons d'outils.

Types de fichiers compatibles

La recherche de fichiers est compatible avec un large éventail de formats de fichiers, listés dans les sections suivantes.

Types de fichiers d'application

application/dartapplication/ecmascriptapplication/jsonapplication/ms-javaapplication/mswordapplication/pdfapplication/sqlapplication/typescriptapplication/vnd.curlapplication/vnd.dartapplication/vnd.ibm.secure-containerapplication/vnd.jupyterapplication/vnd.ms-excelapplication/vnd.oasis.opendocument.textapplication/vnd.openxmlformats-officedocument.presentationml.presentationapplication/vnd.openxmlformats-officedocument.spreadsheetml.sheetapplication/vnd.openxmlformats-officedocument.wordprocessingml.documentapplication/vnd.openxmlformats-officedocument.wordprocessingml.templateapplication/x-cshapplication/x-hwpapplication/x-hwp-v5application/x-latexapplication/x-phpapplication/x-powershellapplication/x-shapplication/x-shellscriptapplication/x-texapplication/x-zshapplication/xmlapplication/zip

Types de fichiers texte

text/1d-interleaved-parityfectext/REDtext/SGMLtext/cache-manifesttext/calendartext/cqltext/cql-extensiontext/cql-identifiertext/csstext/csvtext/csv-schematext/dnstext/encaprtptext/enrichedtext/exampletext/fhirpathtext/flexfectext/fwdredtext/gff3text/grammar-ref-listtext/hl7v2text/htmltext/javascripttext/jcr-cndtext/jsxtext/markdowntext/mizartext/n3text/parameterstext/parityfectext/phptext/plaintext/provenance-notationtext/prs.fallenstein.rsttext/prs.lines.tagtext/prs.prop.logictext/raptorfectext/rfc822-headerstext/rtftext/rtp-enc-aescm128text/rtploopbacktext/rtxtext/sgmltext/shaclctext/shextext/spdxtext/stringstext/t140text/tab-separated-valuestext/texmacstext/trofftext/tsvtext/tsxtext/turtletext/ulpfectext/uri-listtext/vcardtext/vnd.DMClientScripttext/vnd.IPTC.NITFtext/vnd.IPTC.NewsMLtext/vnd.atext/vnd.abctext/vnd.ascii-arttext/vnd.curltext/vnd.debian.copyrighttext/vnd.dvb.subtitletext/vnd.esmertec.theme-descriptortext/vnd.exchangeabletext/vnd.familysearch.gedcomtext/vnd.ficlab.flttext/vnd.flytext/vnd.fmi.flexstortext/vnd.gmltext/vnd.graphviztext/vnd.hanstext/vnd.hgltext/vnd.in3d.3dmltext/vnd.in3d.spottext/vnd.latex-ztext/vnd.motorola.reflextext/vnd.ms-mediapackagetext/vnd.net2phone.commcenter.commandtext/vnd.radisys.msml-basic-layouttext/vnd.senx.warpscripttext/vnd.sositext/vnd.sun.j2me.app-descriptortext/vnd.trolltech.linguisttext/vnd.wap.sitext/vnd.wap.sltext/vnd.wap.wmltext/vnd.wap.wmlscripttext/vtttext/wgsltext/x-asmtext/x-bibtextext/x-bootext/x-ctext/x-c++hdrtext/x-c++srctext/x-cassandratext/x-chdrtext/x-coffeescripttext/x-componenttext/x-cshtext/x-csharptext/x-csrctext/x-cudatext/x-dtext/x-difftext/x-dsrctext/x-emacs-lisptext/x-erlangtext/x-gff3text/x-gotext/x-haskelltext/x-javatext/x-java-propertiestext/x-java-sourcetext/x-kotlintext/x-lilypondtext/x-lisptext/x-literate-haskelltext/x-luatext/x-moctext/x-objcsrctext/x-pascaltext/x-pcs-gcdtext/x-perltext/x-perl-scripttext/x-pythontext/x-python-scripttext/x-r-markdowntext/x-rsrctext/x-rsttext/x-ruby-scripttext/x-rusttext/x-sasstext/x-scalatext/x-schemetext/x-script.pythontext/x-scsstext/x-setexttext/x-sfvtext/x-shtext/x-siestatext/x-sostext/x-sqltext/x-swifttext/x-tcltext/x-textext/x-vbasictext/x-vcalendartext/xmltext/xml-dtdtext/xml-external-parsed-entitytext/yaml

Limites

- API Live : la recherche de fichiers n'est pas compatible avec l' API Live.

- Incompatibilité des outils : pour le moment, la recherche de fichiers ne peut pas être combinée avec d'autres outils tels que l'ancrage avec la recherche Google, le contexte d'URL, etc.

Limites de débit

L'API File Search présente les limites suivantes pour garantir la stabilité du service :

- Taille maximale des fichiers / limite par document : 100 Mo

- Taille totale des magasins de recherche de fichiers du projet (en fonction du niveau de l'utilisateur) :

- Sans frais : 1 Go

- Niveau 1 : 10 Go

- Niveau 2 : 100 Go

- Niveau 3 : 1 To

- Recommandation : limitez la taille de chaque magasin de recherche de fichiers à moins de 20 Go pour garantir des latences de récupération optimales.

Tarifs

- Les développeurs sont facturés pour les embeddings au moment de l'indexation en fonction des tarifs existants pour les embeddings (0,15 $ par million de jetons).

- Le stockage est sans frais.

- Les embeddings au moment de la requête sont sans frais.

- Les jetons de document récupérés sont facturés comme des jetons de contexte standards .

Étape suivante

- Consultez la documentation de référence de l'API pour les magasins de recherche de fichiers et les documents de recherche de fichiers.