Live API מאפשר אינטראקציות קוליות וחזותיות בזמן אמת עם Gemini, עם זמן טעינה נמוך. היא מעבדת זרמים רציפים של אודיו, תמונות וטקסט כדי לספק תשובות מיידיות בדיבור שנשמע טבעי, וכך ליצור חוויה טבעית של שיחה למשתמשים.

תרחישים לדוגמה

אפשר להשתמש ב-Live API כדי ליצור סוכנים קוליים בזמן אמת למגוון תעשיות, כולל:

- מסחר אלקטרוני וקמעונאות: עוזרים לקניות שמציעים המלצות מותאמות אישית וסוכני תמיכה שמטפלים בבעיות של לקוחות.

- גיימינג: דמויות אינטראקטיביות שאי אפשר לשחק איתן (NPC), עוזרים במשחק ותרגום בזמן אמת של תוכן במשחק.

- ממשקי דור חדש: חוויות שכוללות קול ווידאו ברובוטיקה, במשקפיים חכמים ובכלי רכב.

- שירותי בריאות: עוזרים בתחום הבריאות לתמיכה במטופלים ולחינוך שלהם.

- שירותים פיננסיים: יועצים מבוססי-AI לניהול כספים ולייעוץ בנושא השקעות.

- Education: מורים ומלווים ללמידה מבוססי-AI שמספקים הדרכה ומשוב בהתאמה אישית.

תכונות עיקריות

ממשק API בזמן אמת מציע מגוון רחב של תכונות ליצירת סוכנים קוליים חזקים:

- תמיכה רב-לשונית: אפשר לנהל שיחות ב-70 שפות נתמכות.

- התפרצות לשיחה: המשתמשים יכולים לקטוע את המודל בכל שלב כדי ליצור אינטראקציות דינמיות.

- שימוש בכלים: משלב כלים כמו קריאה לפונקציות וחיפוש Google כדי ליצור אינטראקציות דינמיות.

- תמלולי אודיו: מספק תמלילי טקסט של קלט של משתמשים והפלט מהמודל.

- אודיו פרואקטיבי: מאפשר לכם לקבוע מתי המודל יגיב ובאילו הקשרים.

- שיחה מותאמת-רגש: התאמת סגנון התגובה והטון שלהם לביטוי הקלט של המשתמש.

מפרטים טכניים

בטבלה הבאה מפורטות המפרטים הטכניים של Live API:

| קטגוריה | פרטים |

|---|---|

| אופני קלט | אודיו (אודיו PCM גולמי של 16 ביט, 16kHz, little-endian), תמונות (JPEG <= 1FPS), טקסט |

| אופנויות פלט | אודיו (אודיו PCM גולמי של 16 ביט, 24kHz, little-endian) |

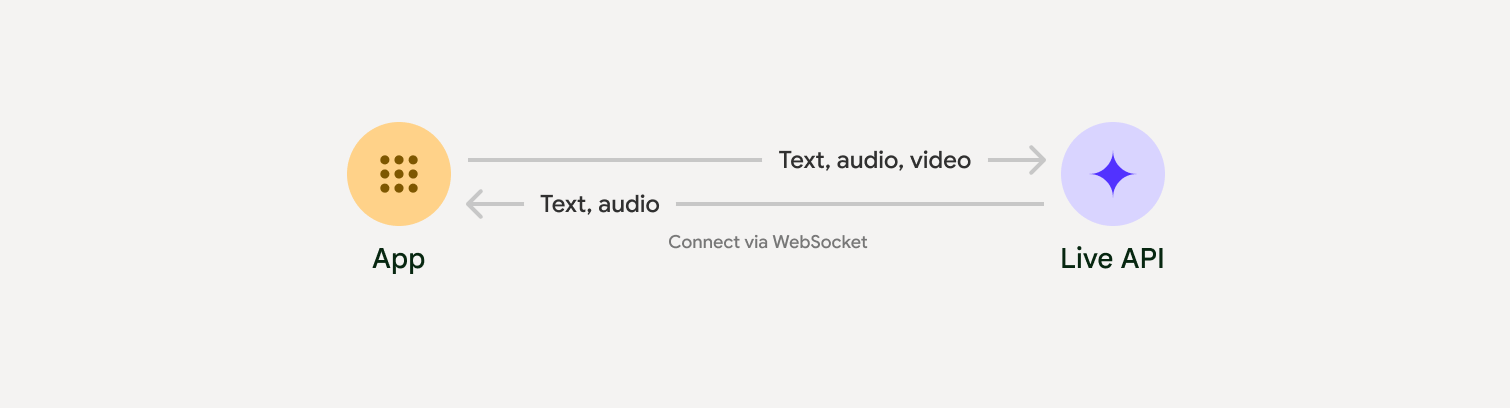

| פרוטוקול | חיבור WebSocket (WSS) עם שמירת מצב |

בחירת גישת הטמעה

כשמשלבים עם Live API, צריך לבחור אחת מהגישות הבאות להטמעה:

- שרת לשרת: הקצה העורפי מתחבר ל-Live API באמצעות WebSockets. בדרך כלל, הלקוח שולח נתוני שידור (אודיו, וידאו, טקסט) לשרת, והשרת מעביר אותם ל-Live API.

- לקוח לשרת: קוד הקצה הקדמי מתחבר ישירות ל-Live API באמצעות WebSockets כדי להזרים נתונים, בלי לעבור דרך הקצה העורפי.

שנתחיל?

בוחרים את המדריך שמתאים לסביבת הפיתוח שלכם:

מדריך ל-GenAI SDK

מתחברים ל-Gemini Live API באמצעות GenAI SDK כדי ליצור אפליקציה מולטי-מודאלית בזמן אמת עם קצה עורפי של Python.

WebSocket tutorial

אפשר להתחבר ל-Gemini Live API באמצעות WebSockets כדי ליצור אפליקציה מולטי-מודאלית בזמן אמת עם ממשק קצה ב-JavaScript וטוקנים זמניים.

מדריך ל-ADK

יצירת סוכן ושימוש ב-Agent Development Kit (ערכה לפיתוח סוכנים) Streaming כדי לאפשר תקשורת קולית ווידאו.

שילובים עם שותפים

כדי לייעל את הפיתוח של אפליקציות אודיו ווידאו בזמן אמת, אפשר להשתמש בשילוב של צד שלישי שתומך ב-API של Gemini Live באמצעות WebRTC או WebSockets.

LiveKit

איך משתמשים ב-Gemini Live API עם סוכני LiveKit.

Pipecat by Daily

איך יוצרים צ'אט בוט מבוסס-AI בזמן אמת באמצעות Gemini Live ו-Pipecat.

Fishjam by Software Mansion

יצירת אפליקציות לסטרימינג בשידור חי של וידאו ואודיו באמצעות Fishjam.

סוכני Vision לפי זרם

פיתוח אפליקציות AI לשיחות קוליות ולווידאו בזמן אמת באמצעות סוכני Vision.

Voximplant

אפשר לחבר שיחות נכנסות ויוצאות ל-Live API באמצעות Voximplant.

Agora

פיתוח אפליקציות AI בממשק שיחה בזמן אמת באמצעות Agora.

Firebase AI SDK

מתחילים להשתמש ב-Gemini Live API באמצעות Firebase AI Logic.